Clear Sky Science · zh

大型语言模型与以色列麻醉学资格考试中的人类考生表现对比

这对医生和患者为何重要

随着人工智能工具迅速进入医院和课堂,一个关键问题是它们在核心医学知识测试中与真实医生相比如何。该研究考察了两种先进语言模型与数百名以色列麻醉学住院医师在官方笔试中的比对,提供了人工智能在医学培训中可以做与不能做之事的一瞥。

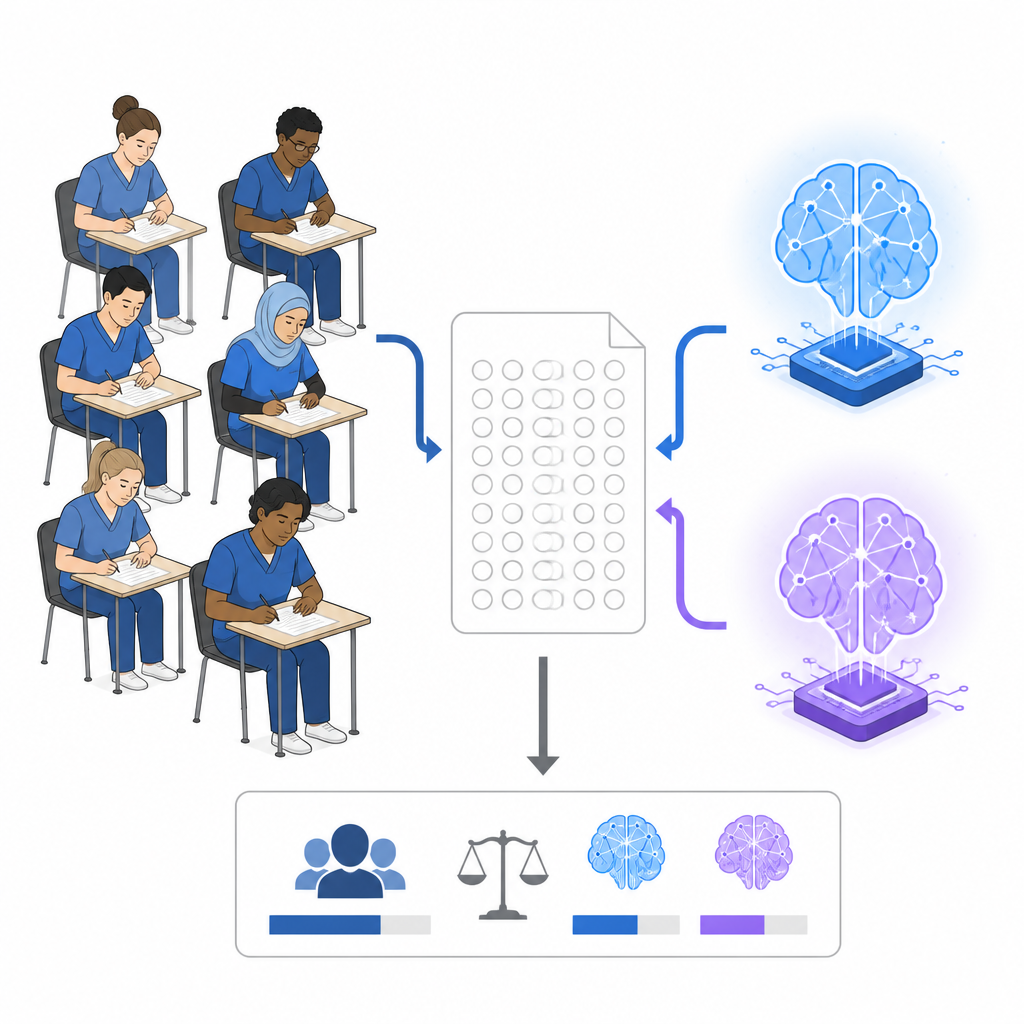

在人类与机器上使用同一试卷进行测试

研究者获取了连续三年的以色列 Step 1 麻醉学资格考试,这是一项在住院期中期进行的多项选择测试。每张试卷有 150 道希伯来语题目,涵盖基础科学、临床基础、亚专科麻醉和急救护理。除匿名的 381 名住院医师的群体成绩外,研究团队还在全部 450 道题上测试了两款商业化的人工智能系统——Claude 3.7 Sonnet 和 ChatGPT-4。模型以希伯来语作答,看到与考生相同的图像和波形,并被防止记忆先前题目。每个模型对每场考试都答题两次,以便团队测量准确性和内部一致性。

人工智能模型的成绩如何

在所有考试的平均表现中,Claude 3.7 Sonnet 大约正确回答四分之三的问题,明显高于考生总体约三分之二多一点的分数。ChatGPT-4 略优于住院医师,但差距不大。Claude 在每次尝试中都超过了官方及格线,而 ChatGPT-4 仅在一半情况下通过。然而,与成绩处于前四分之一、平均接近五题中答对四题的顶尖人类考生相比,两款人工智能系统仍落后。换言之,当前模型在这些笔试上胜过典型住院医师,但未能达到表现最佳的人类考生水平。

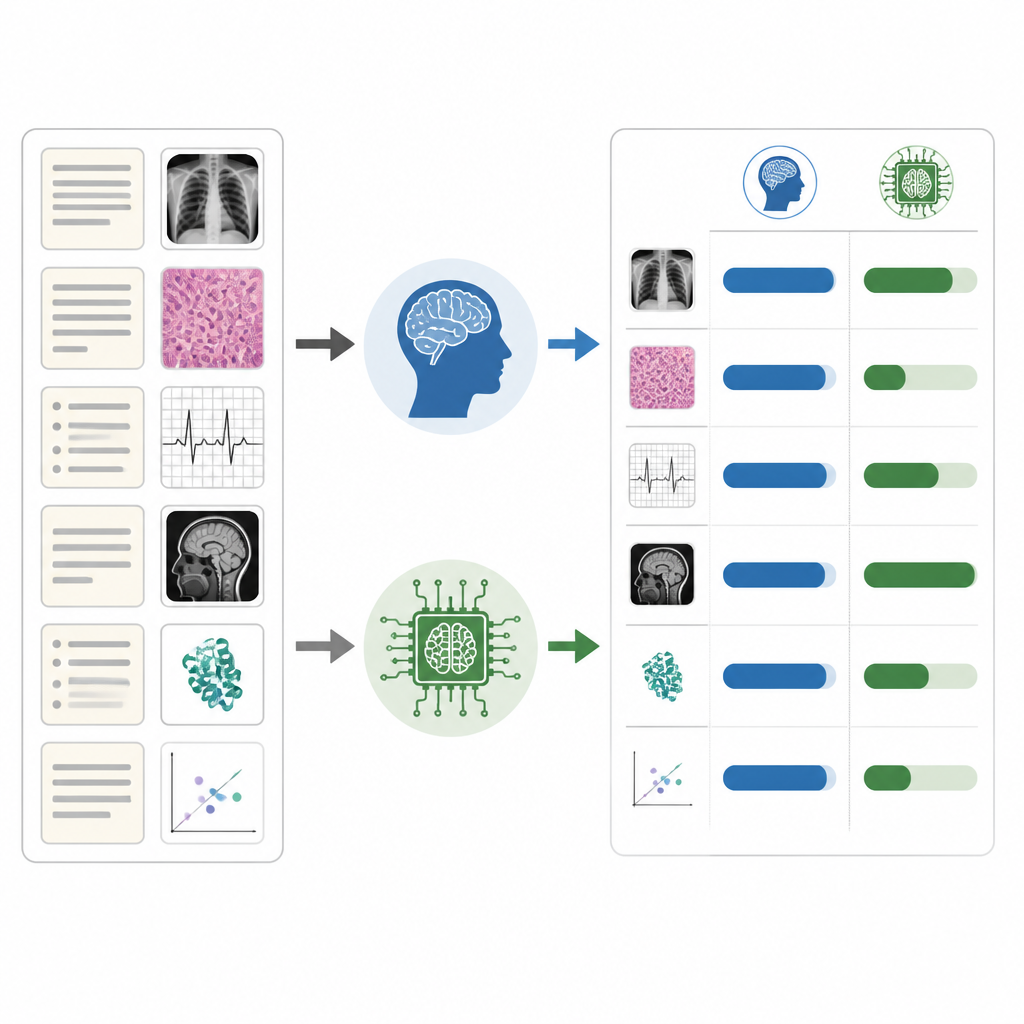

优势、弱点与表现不均

研究显示,这些人工智能系统在不同题型上的表现并不均衡。两款模型在较简单题目上表现很好,在理论性强的领域(如心脏功能)表现较佳,因为这些领域的规则和概念较为明确。它们在更难的题目以及像门诊麻醉与区域麻醉等实践性强的领域表现下降,这些领域更依赖情境、判断和细腻的临床经验。包含影像、扫描或监测波形的问题也比仅文本题更容易使其出错,而人类住院医师在两种题型上的得分相近。Claude 与 ChatGPT 在被要求重复同一场考试时表现出较高的内部一致性,但它们与人类考生的答题模式仅呈中度一致。

这对医学教育的含义

这种表现不均对如何在医生培养中使用人工智能有重要影响。由于模型在某些主题准确率接近完美而在另一些主题令人担忧地低,依赖它们作为主要学习来源可能会误导学习者。例如,住院医师可能在心脏生理学方面获得极佳的解释,但在某些麻醉技术上得到较差的指导却未能察觉差异。作者主张在教育中应谨慎使用这些工具,需有人类密切监督、事实核查,并明确意识到其盲点,尤其是在涉及影像和复杂现实决策的领域。

对人工智能与麻醉未来的启示

研究结论为:先进语言模型目前在一项具有挑战性的国家笔试上已优于平均麻醉学住院医师,但仍不及最佳人类考生,并且在各主题间存在较大差距。通过多项选择试验只是成为一名安全麻醉医师所需能力的一部分,其他还包括动手技能、危机管理以及与患者和团队的沟通。作者建议,人工智能的真正前景不在于取代临床医生,而在于支持他们——在与人类专业知识配合并经过深思熟虑的情况下,帮助强化学习与决策。

引用: Ronen, A., Fein, S., Orbach-Zinger, S. et al. Large language models versus human examinee performance on Israeli anesthesiology board examinations. Sci Rep 16, 14978 (2026). https://doi.org/10.1038/s41598-026-45411-6

关键词: 麻醉学教育, 资格考试, 大型语言模型, 医学人工智能评估, 临床能力