Clear Sky Science · pt

Modelos de linguagem de grande porte versus desempenho de examinados humanos nos exames de anestesiologia de Israel

Por que isso importa para médicos e pacientes

À medida que ferramentas de inteligência artificial avançam rapidamente em hospitais e salas de aula, uma questão central é como elas se comparam a médicos de verdade quando testadas em conhecimentos médicos essenciais. Este estudo examina como dois modelos de linguagem avançados se saíram frente a centenas de residentes de anestesiologia israelenses nos exames escritos oficiais do país, oferecendo um vislumbre do que a IA pode — e não pode — fazer no treinamento médico.

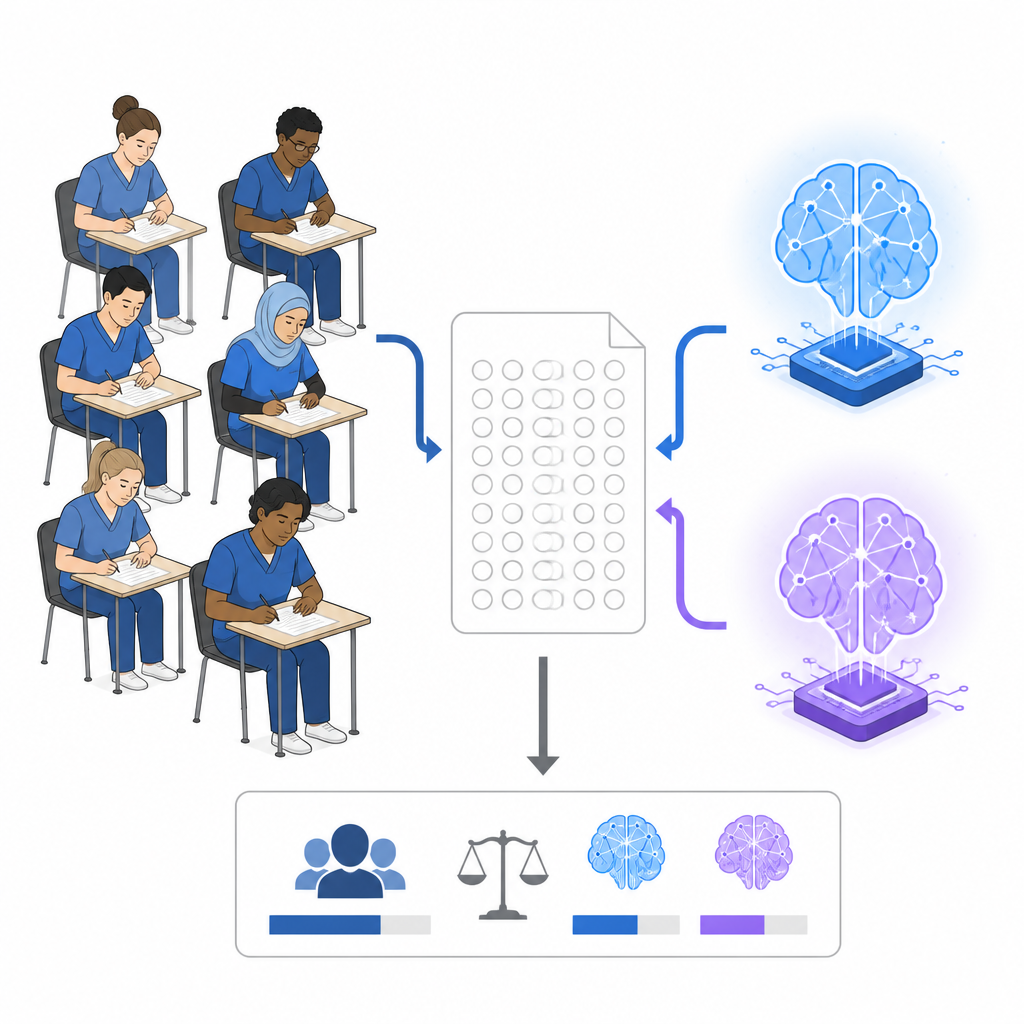

Testando humanos e máquinas no mesmo exame

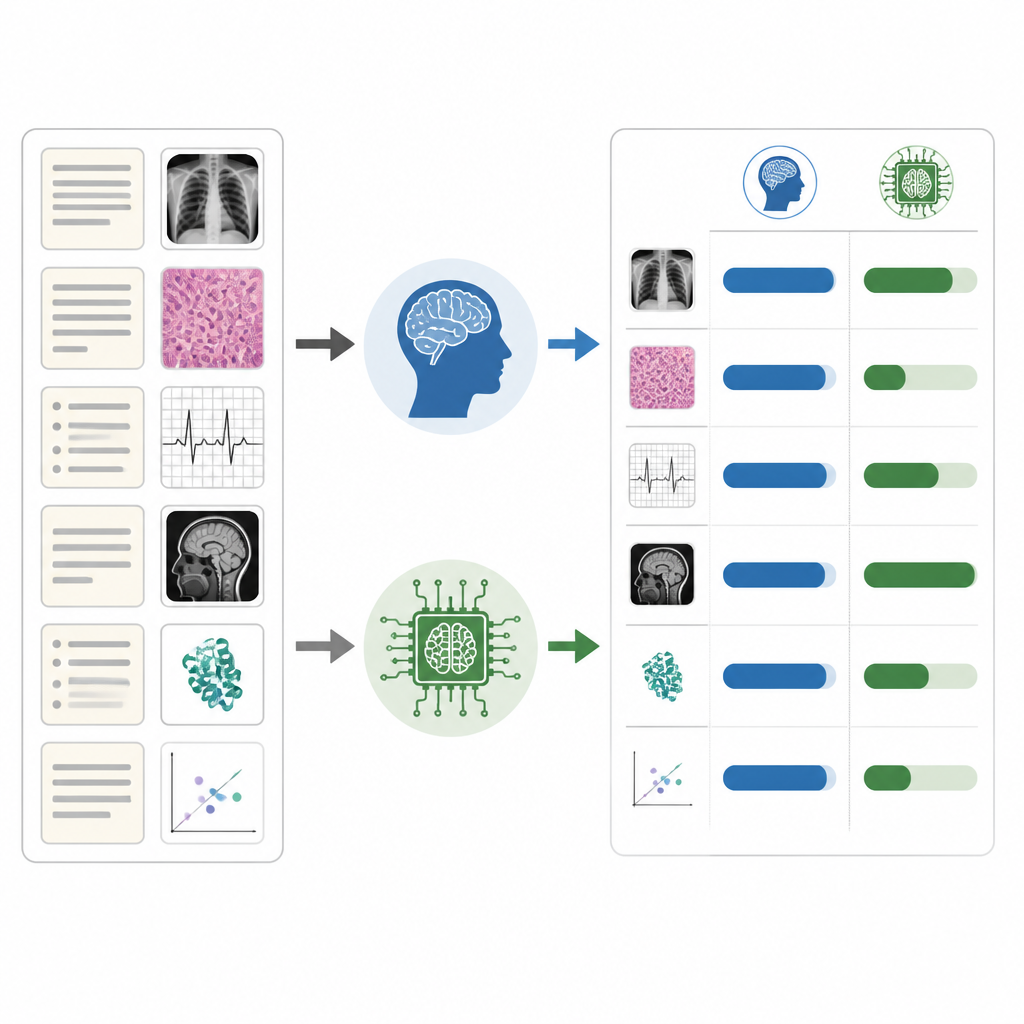

Os pesquisadores obtiveram três anos consecutivos dos exames Step 1 de anestesiologia de Israel, um teste de múltipla escolha realizado no meio da residência. Cada exame continha 150 questões em hebraico, cobrindo ciências básicas, fundamentos clínicos, subespecialidades em anestesia e atendimento de emergência. Além dos resultados anonimizados em grupo de 381 residentes, a equipe também testou dois sistemas comerciais de IA, Claude 3.7 Sonnet e ChatGPT-4, nas 450 questões. Os modelos responderam em hebraico, visualizaram as mesmas imagens e traçados que os residentes e foram impedidos de memorizar questões anteriores. Cada modelo fez todos os exames duas vezes para que a equipe pudesse medir tanto a precisão quanto a consistência interna.

Como os modelos de IA pontuaram

Em média, ao longo de todos os exames, o Claude 3.7 Sonnet respondeu cerca de três em cada quatro perguntas corretamente, claramente acima da pontuação geral dos residentes, pouco mais de três em cada cinco. O ChatGPT-4 teve desempenho ligeiramente superior ao dos residentes, mas não por uma margem ampla. O Claude superou o limite oficial de aprovação em todas as tentativas, enquanto o ChatGPT-4 passou apenas metade das vezes. Ainda assim, quando comparados com o quartil superior dos candidatos humanos, que tiveram em média próximo a quatro acertos em cada cinco, ambos os sistemas de IA ficaram atrás. Em outras palavras, os modelos atuais superaram o residente típico nesses testes escritos, mas não alcançaram os melhores examinados humanos.

Forças, fraquezas e desempenho desigual

O estudo revelou que os sistemas de IA não foram igualmente bons em todos os tipos de questões. Ambos os modelos lidaram muito bem com itens mais fáceis e foram relativamente melhores em áreas teóricas, como função cardíaca, onde regras e conceitos estão bem estabelecidos. O desempenho caiu em questões mais difíceis e em áreas práticas como anestesia ambulatorial e anestesia regional, onde contexto, julgamento e experiência clínica nuanceada importam. Questões que incluíam imagens, exames ou traçados de monitorização também os atrapalharam mais do que itens apenas em texto, enquanto os residentes humanos pontuaram de forma semelhante em ambos os formatos. Claude e ChatGPT mostraram consistência interna substancial quando responderam ao mesmo exame duas vezes, mas concordaram apenas moderadamente com os padrões de resposta dos examinados humanos.

O que isso significa para a educação médica

Esse quadro desigual tem implicações importantes sobre como a IA deve ser usada na formação de médicos. Como a acurácia dos modelos varia de quase perfeita em alguns temas a preocupantemente baixa em outros, confiar neles como fonte principal de estudo pode induzir os aprendizes ao erro. Por exemplo, um residente pode receber ótimas explicações sobre fisiologia cardíaca, mas orientação inadequada em certas técnicas anestésicas sem perceber a diferença. Os autores defendem que essas ferramentas sejam usadas com cautela na educação, com supervisão humana próxima, verificação de fatos e consciência clara de seus pontos cegos, especialmente em áreas que envolvem imagens e tomada de decisão complexa no mundo real.

Conclusão sobre o futuro da IA e da anestesia

O estudo conclui que modelos de linguagem avançados atualmente superam o residente médio de anestesiologia em um exigente exame nacional escrito, mas ainda ficam aquém dos melhores desempenhos humanos e exibem grandes lacunas entre temas. Passar em um teste de múltipla escolha é apenas uma parte do que significa ser um anestesiologista seguro, que também exige habilidades práticas, manejo de crises e comunicação com pacientes e equipes. Os autores sugerem que a promessa real da IA não está em substituir clínicos, mas em apoiá‑los, ajudando a fortalecer o aprendizado e a tomada de decisão quando usada de forma ponderada ao lado da expertise humana.

Citação: Ronen, A., Fein, S., Orbach-Zinger, S. et al. Large language models versus human examinee performance on Israeli anesthesiology board examinations. Sci Rep 16, 14978 (2026). https://doi.org/10.1038/s41598-026-45411-6

Palavras-chave: educação em anestesiologia, exames de certificação, modelos de linguagem de grande porte, avaliação de IA médica, competência clínica