Clear Sky Science · ru

Крупные языковые модели против результатов людей на израильских экзаменах по анестезиологии

Почему это важно для врачей и пациентов

Пока инструменты искусственного интеллекта проникают в больницы и аудитории, ключевой вопрос — как они сопоставимы с реальными врачами при проверке базовых медицинских знаний. В этом исследовании проанализировано, как две продвинутые языковые модели сравнивались со сотнями ординаторов анестезиологии в Израиле на официальных письменных экзаменах совета, давая представление о том, на что ИИ может и не может быть способен в медицинском обучении.

Тестирование людей и машин на одном экзамене

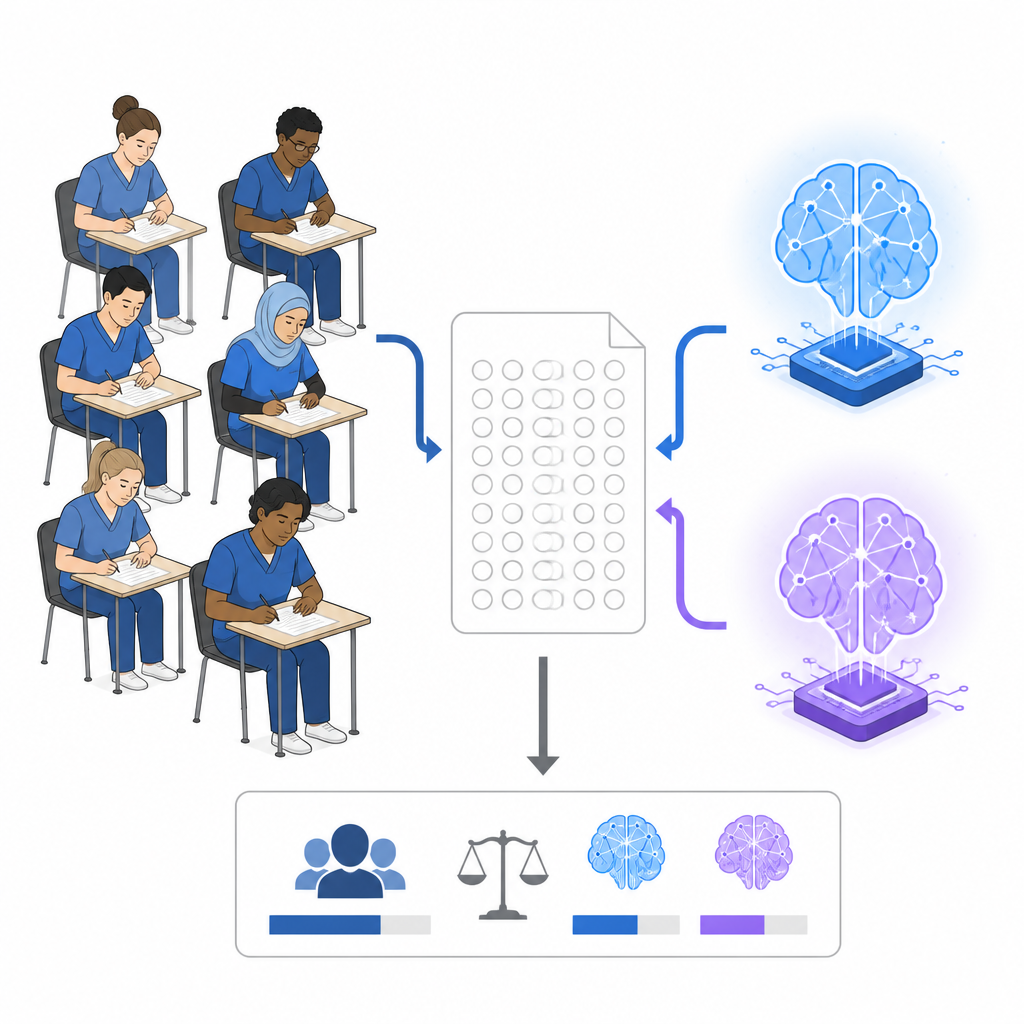

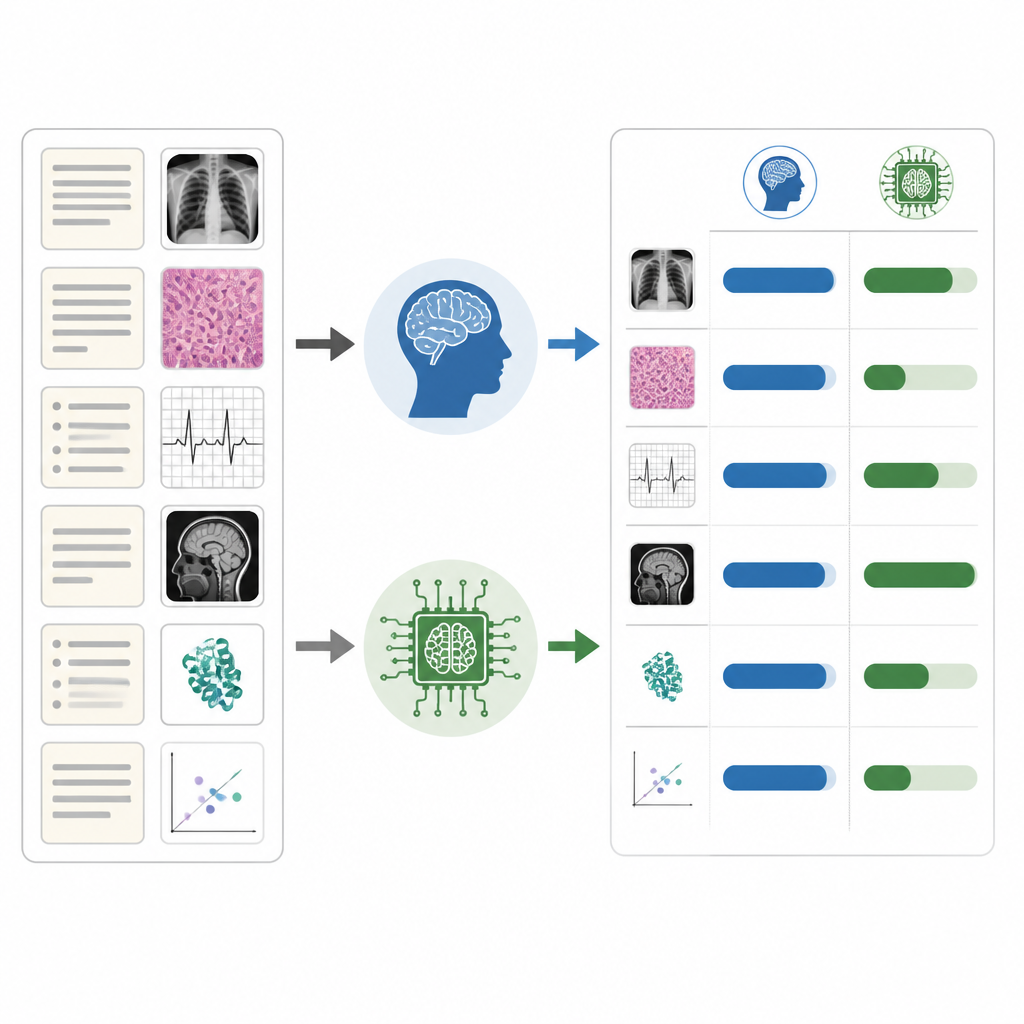

Исследователи получили три последовательных года экзаменов Step 1 по анестезиологии Израиля — тест в формате множественного выбора, который сдают в середине ординатуры. Каждый экзамен содержал 150 вопросов на иврите, охватывающих базовую науку, клинические основы, узкоспециализированную анестезию и неотложную помощь. Наряду с анонимизированными групповыми результатами 381 ординатора команда протестировала две коммерческие AI-системы, Claude 3.7 Sonnet и ChatGPT-4, по всем 450 вопросам. Модели отвечали на иврите, видели те же изображения и кривые мониторинга, что и ординаторы, и им препятствовали запоминать предыдущие вопросы. Каждая модель проходила каждый экзамен дважды, чтобы команда могла оценить как точность, так и внутреннюю согласованность.

Как хорошо показали себя модели ИИ

В среднем по всем экзаменам Claude 3.7 Sonnet правильно ответил примерно на три из четырёх вопросов, значительно превзойдя общий результат ординаторов — немного более трёх из пяти. ChatGPT-4 показал чуть лучшие результаты, чем ординаторы, но не с большим отрывом. Claude превысил официальный проходной балл при каждой попытке, тогда как ChatGPT-4 сдавал экзамен лишь в половине случаев. Однако по сравнению с лучшим квартилем участников, которые в среднем набирали близко к четырём правильным ответам из пяти, обе системы ИИ всё же отставали. Иными словами, текущие модели обгоняли типичного ординатора на этих письменных тестах, но не догоняли сильнейших людей.

Сильные и слабые стороны, неоднородная продуктивность

Исследование показало, что ИИ-системы были не одинаково эффективны по всем типам вопросов. Обе модели хорошо справлялись с более простыми задачами и лучше всего — в теоретических областях, таких как функционирование сердца, где правила и концепции хорошо установлены. Их результаты падали на более сложных вопросах и в практических областях, таких как амбулаторная анестезия и региональная анестезия, где важны контекст, суждение и тонкий клинический опыт. Вопросы с изображениями, сканами или следами мониторинга также выводили их из строя чаще, чем текстовые задачи, в то время как человеческие ординаторы показывали сопоставимые результаты в обоих форматах. Claude и ChatGPT демонстрировали существенную внутреннюю согласованность при повторном прохождении того же экзамена, однако их ответы лишь умеренно совпадали со схемами ответов людей.

Что это означает для медицинского образования

Эта неоднородная картина имеет важные последствия для того, как следует использовать ИИ в обучении врачей. Поскольку точность моделей колеблется от почти идеальной в одних темах до тревожно низкой в других, полагаться на них как на основной источник обучения может вводить обучающихся в заблуждение. Например, ординатор может получать отличные объяснения по физиологии сердца, но при этом — слабое руководство по некоторым анестезиологическим техникам, не осознавая разницы. Авторы утверждают, что эти инструменты следует применять осторожно в образовательных целях, с внимательным человеческим контролем, проверкой фактов и чётким осознанием их ограничений, особенно в областях, связанных с изображениями и сложным принятием решений в реальном мире.

Вывод для будущего ИИ и анестезии

Исследование делает вывод, что продвинутые языковые модели в настоящее время превосходят среднестатистического ординатора анестезиологии на сложном национальном письменном экзамене, но при этом им не удаётся догнать лучших человеческих исполнителей и наблюдаются значительные пробелы по темам. Сдача теста множественного выбора — лишь одна сторона того, что значит быть безопасным анестезиологом; также требуются практические навыки, управление кризисами и коммуникация с пациентами и командой. Авторы предлагают, что истинный потенциал ИИ заключается не в замене клиницистов, а в их поддержке — в усилении обучения и принятия решений при вдумчивом использовании вместе с человеческим опытом.

Цитирование: Ronen, A., Fein, S., Orbach-Zinger, S. et al. Large language models versus human examinee performance on Israeli anesthesiology board examinations. Sci Rep 16, 14978 (2026). https://doi.org/10.1038/s41598-026-45411-6

Ключевые слова: обучение анестезиологии, экзамены совета, крупные языковые модели, оценка медицинского ИИ, клиническая компетентность