Clear Sky Science · ja

イスラエル麻酔学認定試験における大規模言語モデルと人間受験者の成績比較

医師と患者にとってなぜ重要か

人工知能ツールが病院や教室に急速に導入されるなか、核心的な医学知識を試験した場合に実際の医師と比べてどうか、という問いは重要です。本研究は、二つの高度な言語モデルがイスラエルの公式筆記認定試験で数百人の麻酔科レジデントとどのように比較されたかを検討し、医療教育でAIが何をでき、何がまだ難しいかの一端を示します。

同一試験で人間と機械を評価する

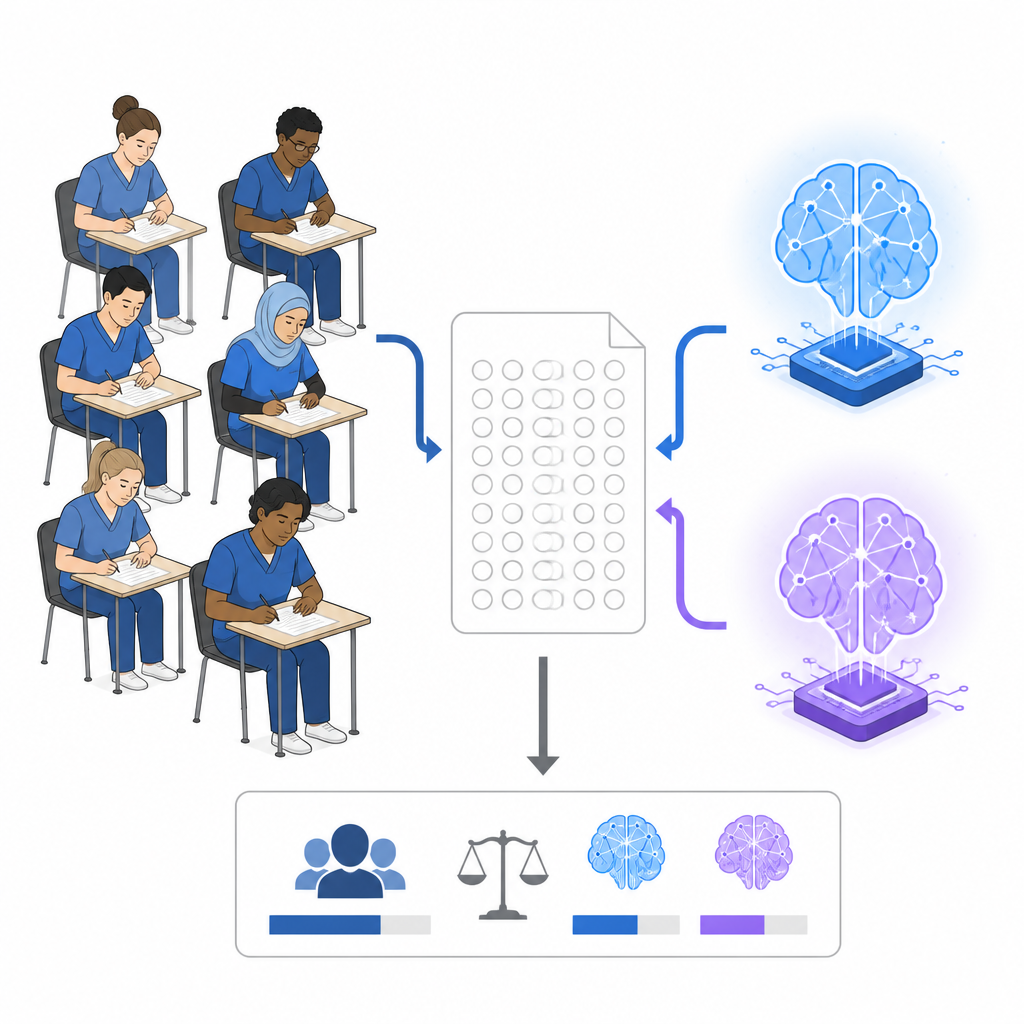

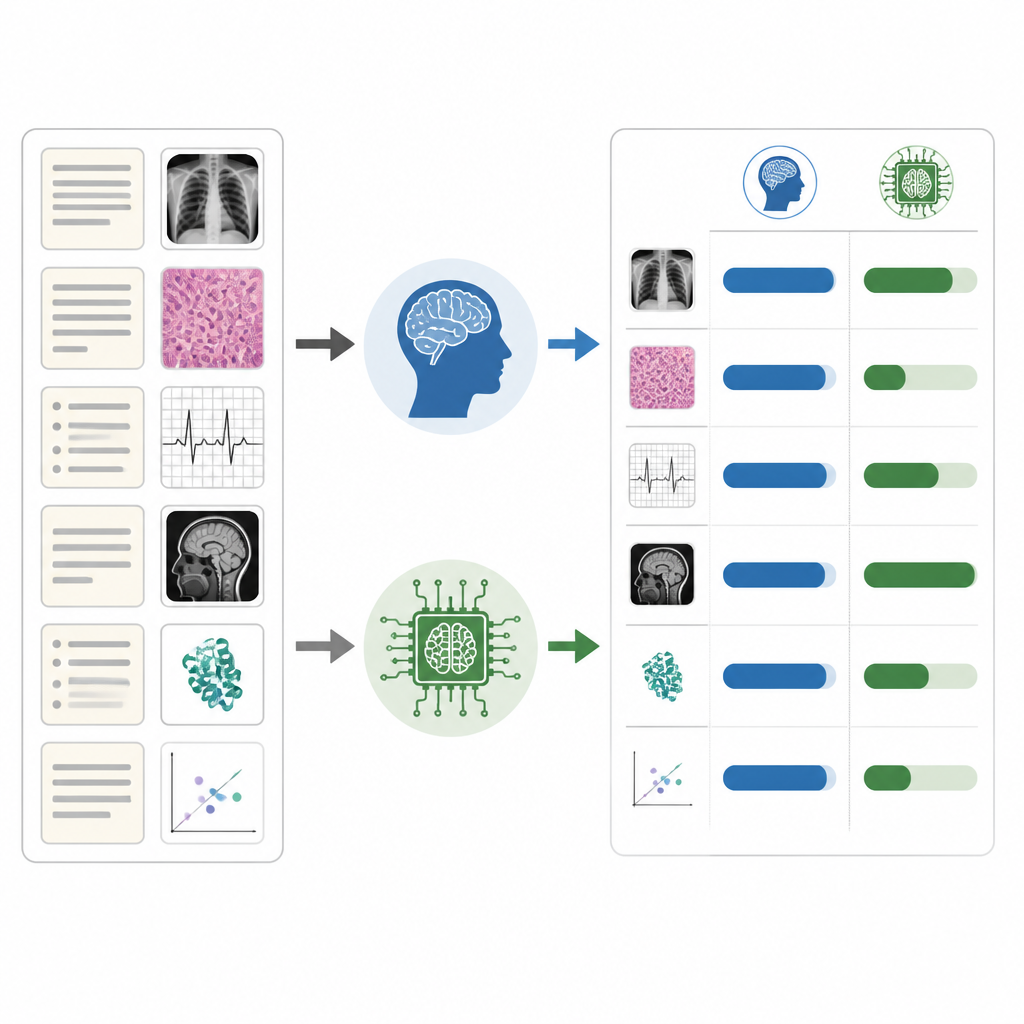

研究者らは、イスラエルのStep 1麻酔学認定試験の連続する3年分を入手しました。これは研修の中期に実施される多肢選択試験で、各試験はヘブライ語で150問、基礎科学、臨床基盤、専門領域の麻酔、救急治療を含みます。381名のレジデントの匿名化された集団結果に加え、研究チームは市販の二つのAIシステム、Claude 3.7 SonnetとChatGPT-4を450問すべてでテストしました。モデルはヘブライ語で回答し、受験者と同じ画像や波形を見せられ、以前の問題を記憶しないように制御されました。各モデルは正解率と内部一貫性を測るために各試験を二回ずつ解きました。

AIモデルの得点水準

全試験の平均で、Claude 3.7 Sonnetは約4問中3問を正解し、レジデントの平均(約5問中3問強)を明確に上回りました。ChatGPT-4はレジデントよりわずかに良い成績でしたが、大差はありませんでした。Claudeはすべての試行で公式の合格基準を超えた一方、ChatGPT-4は半分の試行でのみ合格しました。しかし、上位25%の受験者と比較すると(彼らはほぼ5問中4問の平均)、両AIは依然として及びませんでした。つまり、現行モデルはこれら筆記試験で典型的なレジデントより優れている一方で、最も成績の良い人間受験者には届いていませんでした。

強み、弱み、不均一な成績

研究は、AIシステムがすべての問題タイプで同等に得意というわけではないことを示しました。両モデルは比較的容易な問題に非常に強く、心機能のように規則や概念が確立された理論的領域で特に良好な成績を示しました。一方で、難易度の高い問題や外来麻酔や神経ブロックなどの実務的領域では成績が低下し、ここでは文脈判断や微妙な臨床経験が重要になります。画像、スキャン、モニタリング波形を含む問題はテキストのみの問題よりもAIを混乱させる傾向があり、人間のレジデントは両形式でほぼ同等の得点を出しました。ClaudeとChatGPTは同じ試験を二度解かせると高い内部一貫性を示しましたが、人間受験者の解答パターンとは中程度の一致にとどまりました。

医学教育にとっての意味

この不均一な結果は、AIを医師養成にどう使うべきかについて重要な示唆を与えます。モデルの正答率がある領域ではほぼ完璧に近く、別の領域では著しく低いことから、これらを学習の主たる情報源として頼ることは学習者を誤導しかねません。例えば、レジデントは心生理学については優れた説明を受ける一方で、特定の麻酔手技については不十分な指導を受けてもそれに気づかない可能性があります。著者らは、これらのツールは教育で慎重に用いられるべきであり、画像や複雑な実地判断を含む分野では特に、人間による監督、事実確認、盲点の明確な理解が必要だと論じています。

AIと麻酔の未来への要点

本研究は、高度な言語モデルが難易度の高い国家筆記試験において現在は平均的な麻酔科レジデントを上回る一方で、最優秀の人間受験者には及ばず、分野間で大きな差があると結論づけています。多肢選択試験に合格することは安全な麻酔科医であることの一側面にすぎず、実技、危機管理、患者やチームとのコミュニケーションも必要です。著者らは、AIの真の可能性は臨床家を置き換えることではなく、慎重に人間の専門知識と併用することで学習と意思決定を強化する支援にあると示唆しています。

引用: Ronen, A., Fein, S., Orbach-Zinger, S. et al. Large language models versus human examinee performance on Israeli anesthesiology board examinations. Sci Rep 16, 14978 (2026). https://doi.org/10.1038/s41598-026-45411-6

キーワード: 麻酔教育, 認定試験, 大規模言語モデル, 医療AIの評価, 臨床能力