Clear Sky Science · fr

Grands modèles de langage versus performance des candidats humains aux examens d’anesthésiologie israéliens

Pourquoi cela compte pour les médecins et les patients

À mesure que les outils d’intelligence artificielle s’invitent dans les hôpitaux et les salles de cours, une question centrale est de savoir comment ils se comparent aux médecins réels lorsqu’on teste leurs connaissances médicales essentielles. Cette étude examine comment deux modèles de langage avancés se sont comportés par rapport à des centaines d’internes en anesthésiologie lors des examens écrits officiels en Israël, offrant un aperçu de ce que l’IA peut — et ne peut pas encore — accomplir dans la formation médicale.

Tester humains et machines sur le même examen

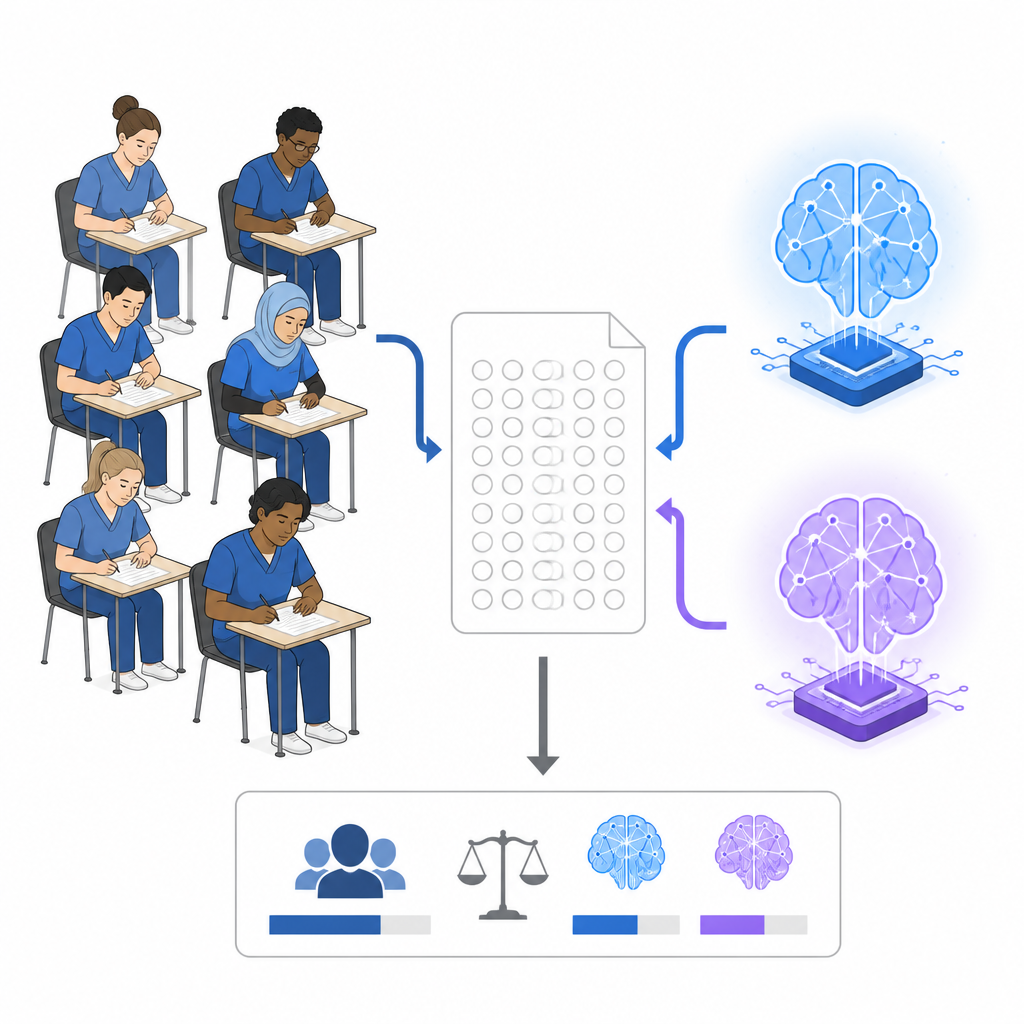

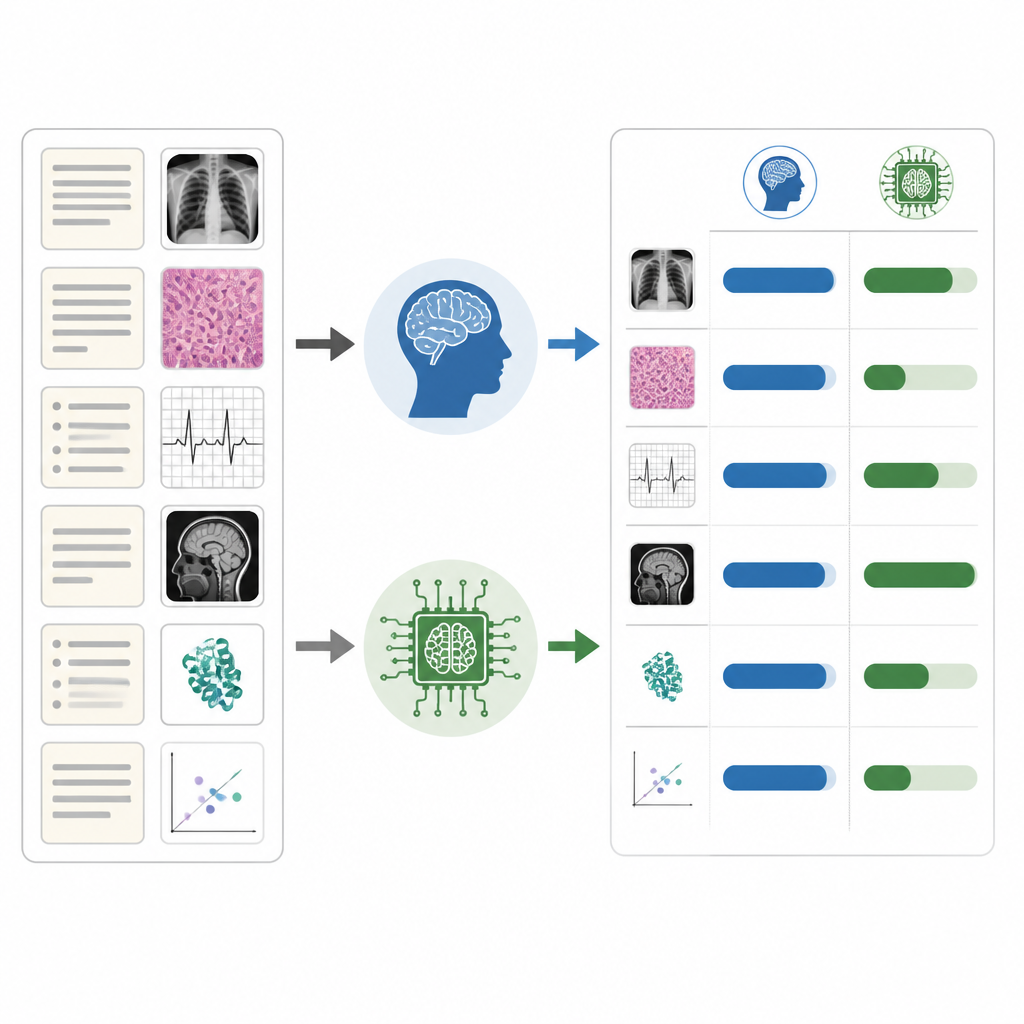

Les chercheurs ont obtenu les sujets des examens d’anesthésiologie Step 1 d’Israël pour trois années consécutives, un test à choix multiple passé au milieu de la résidence. Chaque examen comprenait 150 questions en hébreu, couvrant les sciences fondamentales, les bases cliniques, l’anesthésie de sous‑spécialité et les soins d’urgence. En parallèle des résultats anonymisés de groupe de 381 internes, l’équipe a testé deux systèmes commerciaux d’IA, Claude 3.7 Sonnet et ChatGPT‑4, sur les 450 questions. Les modèles ont répondu en hébreu, ont vu les mêmes images et tracés que les internes, et on leur a interdit de « se souvenir » des questions précédentes. Chaque modèle a passé chaque examen deux fois afin de mesurer à la fois la précision et la cohérence interne.

Quels scores ont obtenu les modèles d’IA

En moyenne sur l’ensemble des examens, Claude 3.7 Sonnet a répondu correctement à environ trois questions sur quatre, nettement au‑dessus du score global des internes d’un peu plus de trois bonnes réponses sur cinq. ChatGPT‑4 a fait légèrement mieux que les internes mais sans un écart important. Claude a dépassé la note officielle de passage à chaque tentative, tandis que ChatGPT‑4 n’a réussi que la moitié du temps. Pourtant, comparés au quart supérieur des candidats humains, qui obtenaient en moyenne près de quatre bonnes réponses sur cinq, les deux systèmes d’IA restaient en retrait. Autrement dit, les modèles actuels ont surpassé le résident typique sur ces tests écrits mais n’ont pas égalé les meilleurs candidats humains.

Forces, faiblesses et performance inégale

L’étude a montré que les systèmes d’IA n’étaient pas également performants selon les types de questions. Les deux modèles ont bien traité les items plus faciles et ont obtenu leurs meilleurs résultats dans des domaines théoriques comme la physiologie cardiaque, où règles et concepts sont bien établis. Leur performance chutait sur les questions plus difficiles et dans les domaines pratiques tels que l’anesthésie ambulatoire et l’anesthésie régionale, où le contexte, le jugement et l’expérience clinique nuancée comptent. Les questions incluant des images, des examens d’imagerie ou des tracés de surveillance les ont également plus souvent piégés que les items purement textuels, tandis que les internes obtenaient des scores similaires sur les deux formats. Claude et ChatGPT ont montré une cohérence interne substantielle lorsqu’on leur a présenté le même examen deux fois, mais ils n’étaient qu’en accord modéré avec les schémas de réponses des candidats humains.

Ce que cela implique pour l’éducation médicale

Cette image inégale a des conséquences importantes sur l’usage de l’IA dans la formation des médecins. Comme la précision des modèles varie de quasi parfaite dans certains sujets à préoccupante dans d’autres, s’en remettre à eux comme source principale d’étude pourrait induire les apprenants en erreur. Par exemple, un interne pourrait recevoir d’excellentes explications en physiologie cardiaque mais de mauvaises orientations pour certaines techniques anesthésiques sans s’en rendre compte. Les auteurs soutiennent que ces outils doivent être utilisés avec prudence en éducation, sous étroite supervision humaine, avec vérification des faits et conscience claire de leurs angles morts, en particulier pour les domaines impliquant des images et des décisions complexes en conditions réelles.

Conclusion pour l’avenir de l’IA et de l’anesthésie

L’étude conclut que les modèles de langage avancés surpassent désormais le résident moyen en anesthésiologie à un examen national écrit exigeant, mais qu’ils restent inférieurs aux meilleurs performeurs humains et présentent d’importantes lacunes selon les sujets. Réussir un QCM n’est qu’un aspect de ce que signifie être un anesthésiste sûr, qui nécessite aussi des compétences pratiques, la gestion de crises et la communication avec les patients et les équipes. Les auteurs suggèrent que la véritable promesse de l’IA réside non pas dans le remplacement des cliniciens, mais dans leur soutien — pour renforcer l’apprentissage et la prise de décision lorsqu’elle est utilisée de manière réfléchie aux côtés de l’expertise humaine.

Citation: Ronen, A., Fein, S., Orbach-Zinger, S. et al. Large language models versus human examinee performance on Israeli anesthesiology board examinations. Sci Rep 16, 14978 (2026). https://doi.org/10.1038/s41598-026-45411-6

Mots-clés: enseignement en anesthésiologie, examens du conseil, grands modèles de langage, évaluation de l’IA médicale, compétence clinique