Clear Sky Science · tr

Büyük dil modelleri ile insan sınav performansı: İsrail anesteziyoloji board sınavları karşılaştırması

Doktorlar ve hastalar için neden önemli

Yapay zekâ araçları hastanelere ve sınıflara hızla girerken, temel bir soru bu araçların çekirdek tıbbi bilgi testlerinde gerçek doktorlarla nasıl karşılaştırıldığıdır. Bu çalışma, iki gelişmiş dil modelinin İsrail’in resmi yazılı board sınavlarında yüzlerce anesteziyoloji asistanıyla nasıl kıyaslandığını inceliyor ve yapay zekânın tıp eğitiminde neleri yapmaya hazır olup olmadığını gösteren bir bakış sunuyor.

İnsanları ve makineleri aynı sınavda test etmek

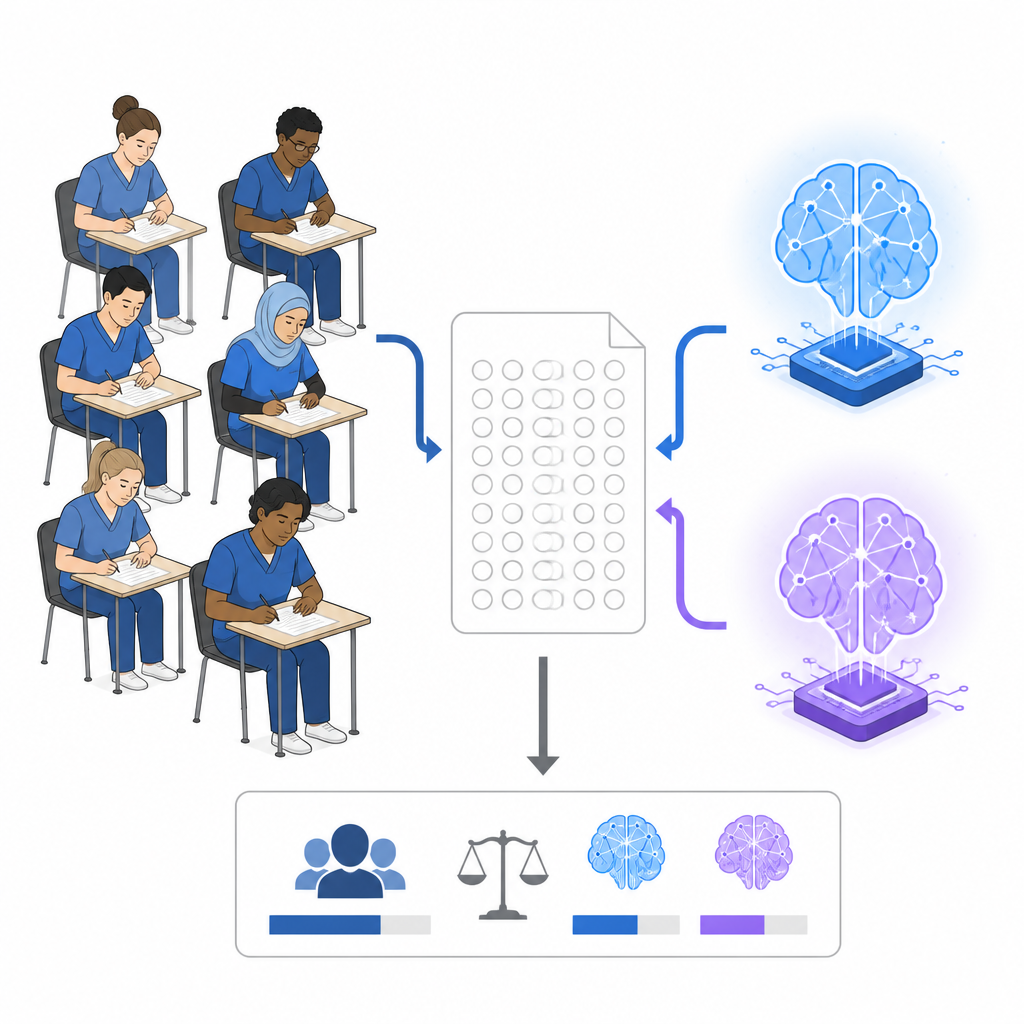

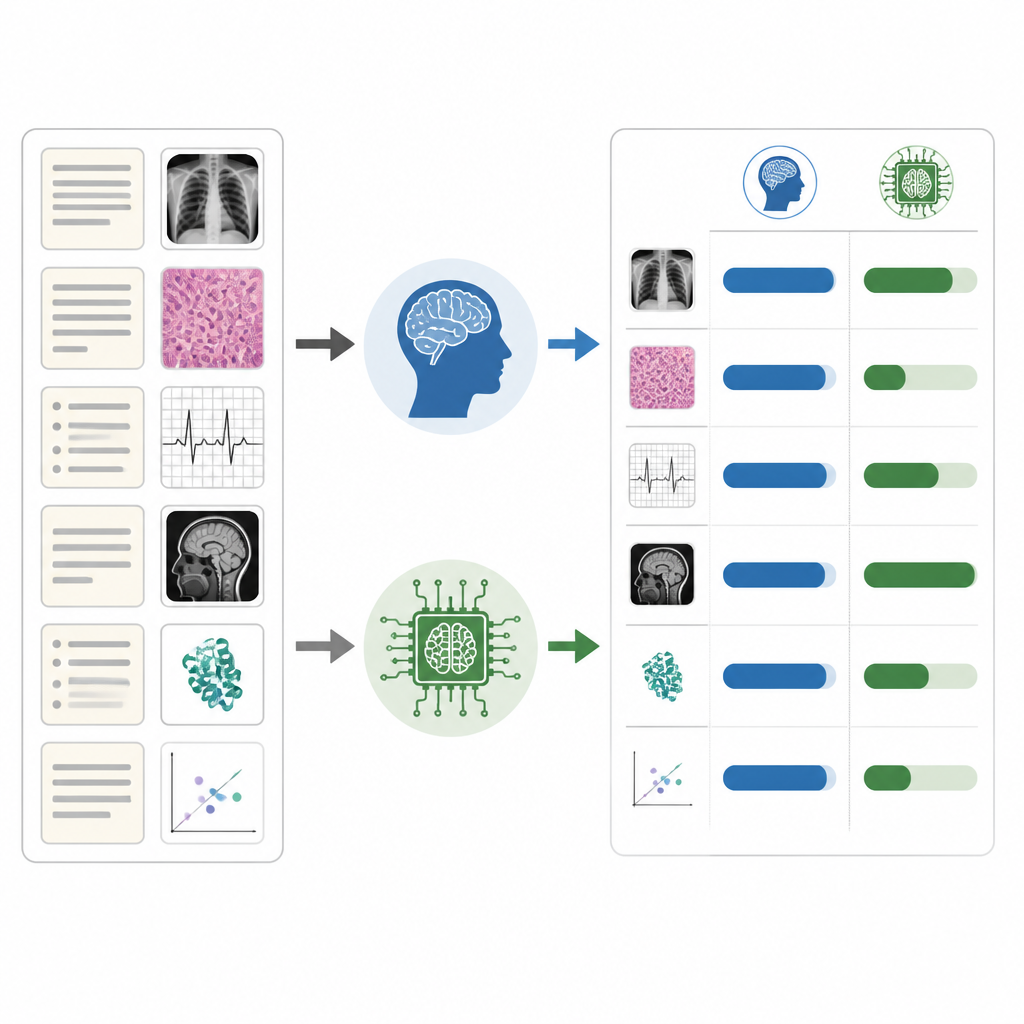

Araştırmacılar, asistanlık sürecinin ortasında yapılan çoktan seçmeli bir test olan İsrail’in Ardışık 3 yıllık Step 1 anesteziyoloji board sınavlarına erişti. Her sınav 150 İbranice soru içeriyordu ve temel bilim, klinik temeller, alt uzmanlık anesteziyisi ile acil bakım konularını kapsıyordu. 381 asistanın anonim grup sonuçlarına ek olarak ekip, iki ticari yapay zekâ sistemini — Claude 3.7 Sonnet ve ChatGPT-4 — tüm 450 soruda test etti. Modeller İbranice cevapladı, asistanların gördüğü aynı görüntüleri ve dalga formlarını gördü ve önceki soruları hatırlamaları engellendi. Her model her sınavı iki kez aldı; böylece ekip hem doğruluğu hem de iç tutarlılığı ölçebildi.

Yapay zekâ modelleri ne kadar puan aldı

Tüm sınavlar ortalamasında Claude 3.7 Sonnet yaklaşık dört sorudan üçünü doğru yanıtladı; bu, asistanların genel puanı olan beş sorudan biraz fazla üçün üzerinde açıkça daha yüksekti. ChatGPT-4, asistanlardan biraz daha iyi performans gösterdi ancak fark büyük değildi. Claude her denemede resmi geçme notunu aştı; ChatGPT-4 ise yalnızca yarı zamanlı geçti. Yine de en iyi %25’lik insan sınav katılımcılarıyla karşılaştırıldığında — ortalama yaklaşık beş sorudan dörde yakın doğru — her iki yapay zekâ sistemi de geride kaldı. Başka bir deyişle, mevcut modeller bu yazılı testlerde tipik asistanın üzerinde performans gösterse de en güçlü insan sınav katılımcılarıyla eşleşmiyordu.

Güçlü ve zayıf yönler ile düzensiz performans

Araştırma, yapay zekâ sistemlerinin tüm soru türlerinde eşit derecede iyi olmadığını ortaya koydu. Her iki model de daha kolay maddeleri çok iyi çözdü ve kuralların ve kavramların iyi yerleştiği teorik alanlarda — örneğin kalp fonksiyonu gibi — nispeten en iyi performansı gösterdi. Performansları daha zor sorularda ve bağlam, yargı ve nüanslı klinik deneyimin önemi olduğu uygulamalı alanlarda, örneğin ayaktan anestezi ve bölgesel anestezi gibi konularda düştü. Görüntü, tarama veya izleme izleri içeren sorular da yalnızca metin içeren maddelere kıyasla onları daha çok yanıltırken, insan asistanlar her iki formatta benzer puan aldı. Claude ve ChatGPT, aynı sınav iki kez sorulduğunda kayda değer iç tutarlılık gösterdi; ancak insan sınav katılımcılarının cevap örüntüleriyle yalnızca orta düzeyde bir örtüşme sergilediler.

Tıp eğitimi için anlamı

Bu düzensiz tablo, yapay zekânın doktor yetiştirmede nasıl kullanılacağı konusunda önemli sonuçlar taşıyor. Modellerin doğruluğu bazı konularda neredeyse mükemmel düzeyden diğerlerinde endişe verici derecede düşük düzeye kadar değiştiği için, onları birincil çalışma kaynağı olarak kullanmak öğrenenleri yanıltabilir. Örneğin bir asistan kalp fizyolojisi konusunda mükemmel açıklamalar alırken belli anestezi tekniklerinde yetersiz rehberlik alabilir ve farkına varmayabilir. Yazarlar, bu araçların eğitimde insan denetimi, doğrulama ve görüntülerle ve karmaşık gerçek dünya kararlarıyla ilgili kör noktaların açık farkındalığıyla dikkatle kullanılmasını savunuyor.

Anestezi ve yapay zekânın geleceği için çıkarım

Çalışma, gelişmiş dil modellerinin şu anda zorlu bir ulusal yazılı sınavda ortalama anesteziyoloji asistanından daha iyi performans gösterdiğini fakat hâlâ en iyi insan performanslarına yetişemediğini ve konular arasında büyük boşluklar sergilediğini sonuçlandırıyor. Çoktan seçmeli bir sınavı geçmek, güvenli bir anesteziyolog olmak için gerekenlerin yalnızca bir parçasıdır; aynı zamanda uygulamalı beceriler, kriz yönetimi ve hastalar ve ekiplerle iletişim gereklidir. Yazarlar, yapay zekânın gerçek vaatinin klinisyenlerin yerini almak değil, onları desteklemek; insan uzmanlığıyla birlikte düşünceli şekilde kullanıldığında öğrenmeyi ve karar vermeyi güçlendirmek olduğunu öne sürüyor.

Atıf: Ronen, A., Fein, S., Orbach-Zinger, S. et al. Large language models versus human examinee performance on Israeli anesthesiology board examinations. Sci Rep 16, 14978 (2026). https://doi.org/10.1038/s41598-026-45411-6

Anahtar kelimeler: anesteziyoloji eğitimi, board sınavları, büyük dil modelleri, tıbbi yapay zekâ değerlendirmesi, klinik yeterlik