Clear Sky Science · pl

Duże modele językowe a wyniki ludzkich zdających na izraelskich egzaminach z anestezjologii

Dlaczego to ma znaczenie dla lekarzy i pacjentów

W miarę jak narzędzia sztucznej inteligencji wkraczają do szpitali i sal wykładowych, kluczowe pytanie brzmi: jak wypadają w porównaniu z prawdziwymi lekarzami, gdy testuje się ich z podstawowej wiedzy medycznej. To badanie analizuje, jak dwa zaawansowane modele językowe porównały się z setkami izraelskich rezydentów anestezjologii na oficjalnych pisemnych egzaminach państwowych, dając obraz tego, co AI może, a czego jeszcze nie jest gotowa zrobić w kształceniu medycznym.

Badanie ludzi i maszyn na tym samym teście

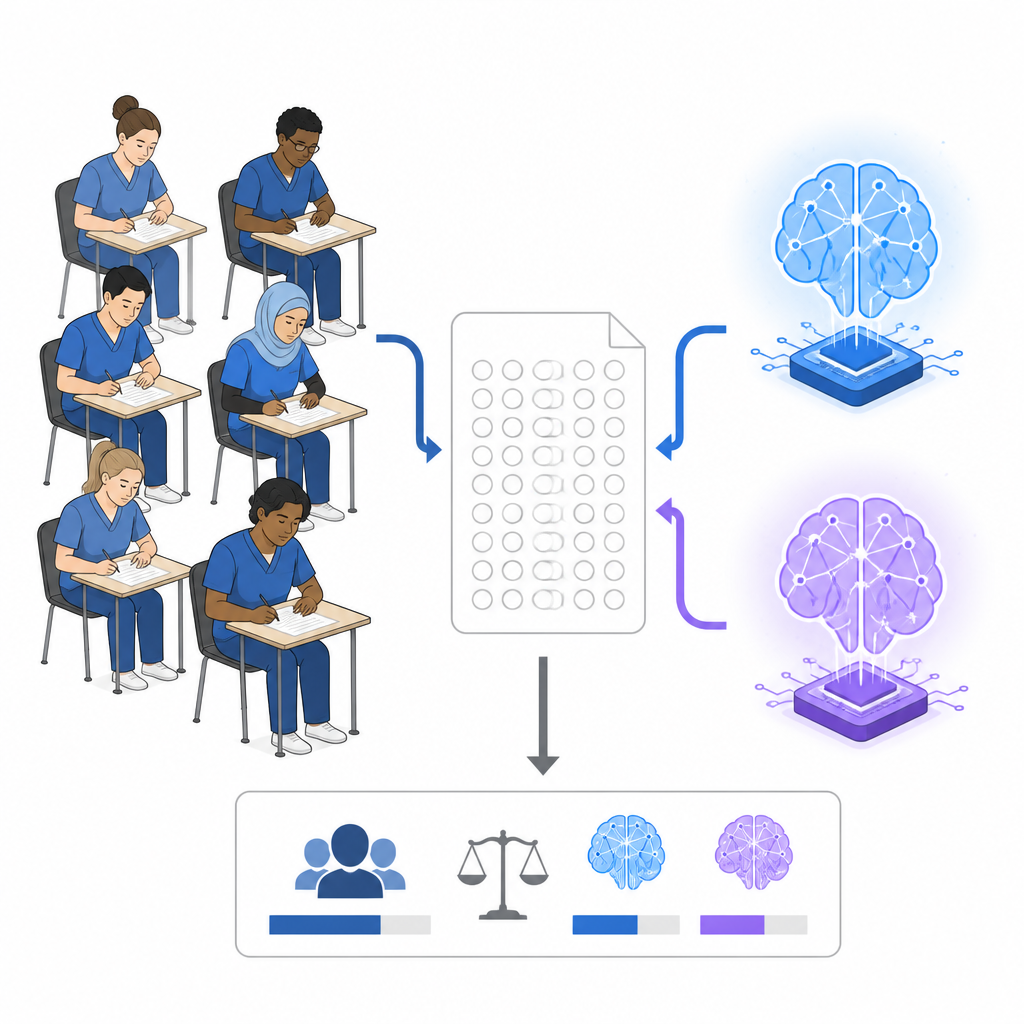

Naukowcy uzyskali trzy kolejne roczniki izraelskich egzaminów Step 1 z anestezjologii, test wielokrotnego wyboru odbywany w połowie rezydentury. Każdy egzamin zawierał 150 pytań w języku hebrajskim, obejmujących nauki podstawowe, podstawy kliniczne, anestezję w podspecjalnościach oraz opiekę w nagłych wypadkach. Oprócz zanonimizowanych wyników grupowych 381 rezydentów zespół przetestował także dwa komercyjne systemy AI, Claude 3.7 Sonnet i ChatGPT-4, na wszystkich 450 pytaniach. Modele odpowiadały po hebrajsku, widziały takie same obrazy i wykresy co rezydenci i nie mogły zapamiętywać wcześniejszych pytań. Każdy model rozwiązał każdy egzamin dwukrotnie, aby zespół mógł zmierzyć zarówno trafność, jak i wewnętrzną spójność.

Jak dobrze poradziły sobie modele AI

Średnio we wszystkich egzaminach Claude 3.7 Sonnet poprawnie odpowiedział na około trzy z czterech pytań, co było wyraźnie powyżej ogólnego wyniku rezydentów wynoszącego nieco ponad trzy z pięciu. ChatGPT-4 wypadł nieco lepiej niż rezydenci, ale nie znacząco. Claude przekroczył oficjalny próg zdawalności przy każdej próbie, podczas gdy ChatGPT-4 zdał jedynie w połowie przypadków. Jednak w porównaniu z najlepszą ćwiartką ludzkich zdających, którzy osiągali średnio blisko czterech poprawnych odpowiedzi na pięć, oba systemy AI wciąż pozostawały w tyle. Innymi słowy, obecne modele przewyższały przeciętnego rezydenta na tych testach pisemnych, ale nie dorównywały najsilniejszym ludzkim uczestnikom.

Mocne strony, słabości i nierówna wydajność

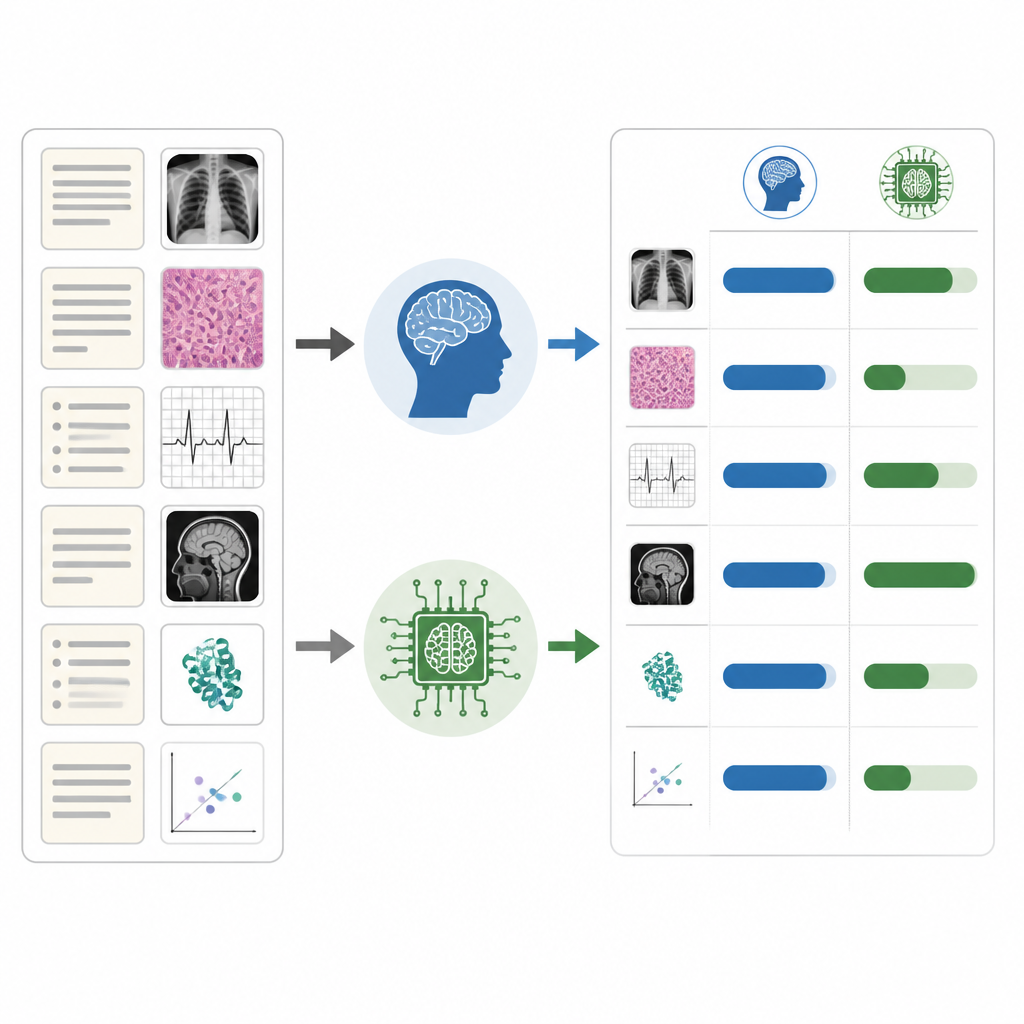

Badanie wykazało, że systemy AI nie były równie skuteczne we wszystkich typach pytań. Oba modele radziły sobie bardzo dobrze z łatwiejszymi zadaniami i najlepiej w obszarach teoretycznych, takich jak funkcja serca, gdzie reguły i pojęcia są dobrze określone. Ich wyniki spadały przy trudniejszych pytaniach oraz w praktycznych dziedzinach, takich jak anestezja ambulatoryjna i anestezja regionalna, gdzie znaczenie mają kontekst, osąd i subtelne doświadczenie kliniczne. Pytania zawierające obrazy, skany lub ślady monitorowania sprawiały im większe trudności niż pozycje tekstowe, podczas gdy rezydenci osiągali podobne wyniki w obu formatach. Claude i ChatGPT wykazały znaczną wewnętrzną spójność przy dwukrotnym podejściu do tego samego egzaminu, jednak ich wzorce odpowiedzi jedynie umiarkowanie pokrywały się z wzorcami ludzkich zdających.

Co to oznacza dla kształcenia medycznego

Ta nierówna mapa wyników ma istotne implikacje dla sposobu wykorzystania AI w szkoleniu lekarzy. Ponieważ dokładność modeli waha się od niemal doskonałej w niektórych tematach do niepokojąco niskiej w innych, poleganie na nich jako głównym źródle nauki może wprowadzać w błąd uczących się. Na przykład rezydent może otrzymać doskonałe wyjaśnienia z fizjologii serca, a jednocześnie otrzymać słabe wskazówki dotyczące pewnych technik anestezjologicznych, nie zdając sobie sprawy z różnicy. Autorzy argumentują, że narzędzia te powinny być stosowane ostrożnie w edukacji, pod ścisłym nadzorem człowieka, z weryfikacją faktów i jasną świadomością ich ograniczeń, szczególnie w obszarach obejmujących obrazy i złożone decyzje w rzeczywistych warunkach.

Wnioski dla przyszłości AI i anestezjologii

Badanie konkluduje, że zaawansowane modele językowe obecnie przewyższają przeciętnego rezydenta anestezjologii na wymagającym narodowym egzaminie pisemnym, ale wciąż ustępują najlepszym ludzkim wykonawcom i wykazują duże luki tematyczne. Zdanie testu wielokrotnego wyboru to tylko jeden aspekt bycia bezpiecznym anestezjologiem; istotne są także umiejętności praktyczne, zarządzanie kryzysowe oraz komunikacja z pacjentami i zespołem. Autorzy sugerują, że prawdziwa obietnica AI nie leży w zastępowaniu klinicystów, lecz w ich wspieraniu — pomaganiu w nauce i podejmowaniu decyzji, gdy jest używana rozważnie razem z ludzką ekspertyzą.

Cytowanie: Ronen, A., Fein, S., Orbach-Zinger, S. et al. Large language models versus human examinee performance on Israeli anesthesiology board examinations. Sci Rep 16, 14978 (2026). https://doi.org/10.1038/s41598-026-45411-6

Słowa kluczowe: kształcenie w anestezjologii, egzaminy państwowe, duże modele językowe, ocena AI w medycynie, kompetencje kliniczne