Clear Sky Science · nl

Grote taalmodellen versus prestaties van menselijke kandidaten op Israëlische anesthesiologie-examens

Waarom dit ertoe doet voor artsen en patiënten

Naarmate hulpmiddelen met kunstmatige intelligentie steeds sneller hun intrede doen in ziekenhuizen en onderwijs, is een belangrijke vraag hoe ze het doen vergeleken met echte artsen wanneer ze getest worden op kernkennis van de geneeskunde. Deze studie onderzoekt hoe twee geavanceerde taalmodellen presteerden tegenover honderden menselijke anesthesiologieresidenten op de officiële schriftelijke bestuursexamens van Israël, en geeft daarmee een indruk van wat AI wel en niet klaar is om te doen in medische opleiding.

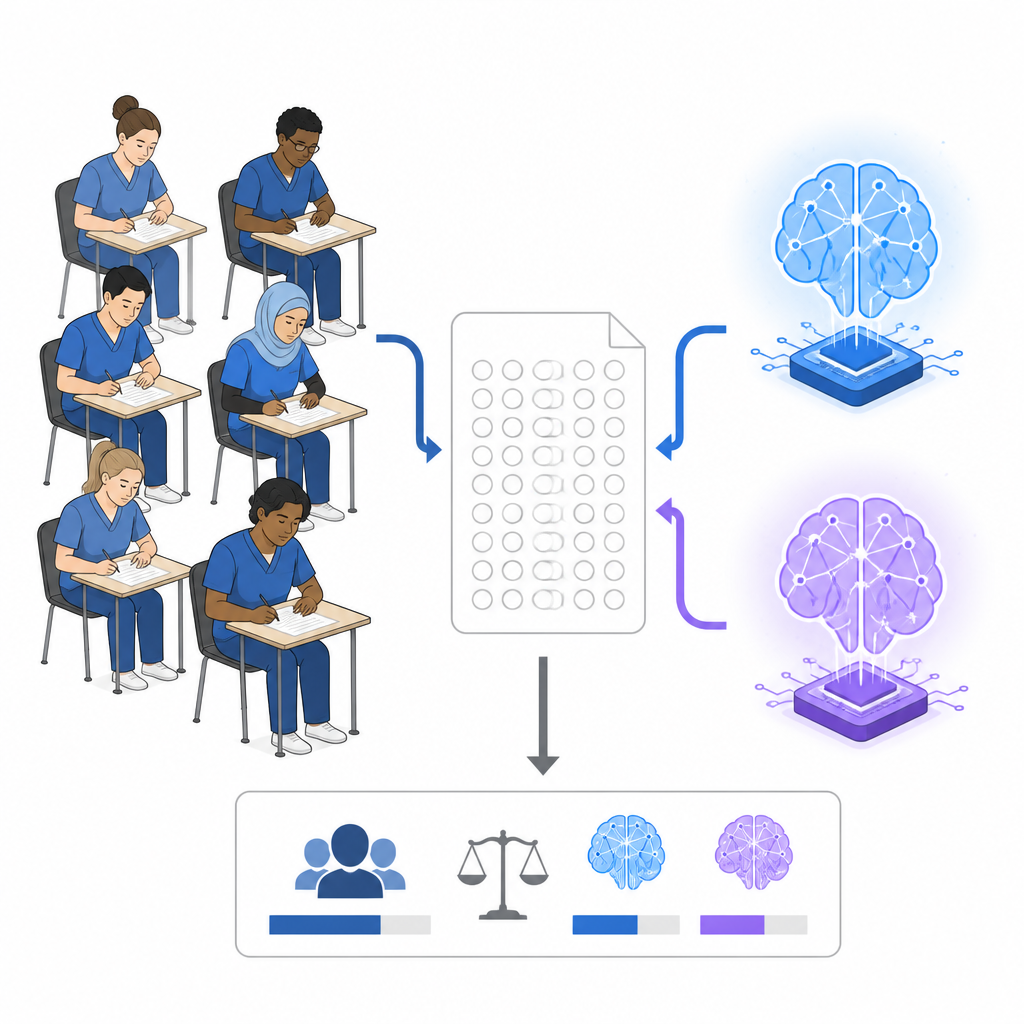

Het testen van mensen en machines op hetzelfde examen

De onderzoekers verkregen drie opeenvolgende jaren van Israëlische Step 1-anesthesiologie-examens, een meerkeuzetoets die halverwege de residentie wordt afgenomen. Elk examen bevatte 150 vragen in het Hebreeuws, met onderwerpen variërend van basiswetenschappen en klinische fundamenten tot subspecialistische anesthesie en spoedeisende zorg. Naast geanonimiseerde groepsresultaten van 381 residenten testte het team ook twee commerciële AI-systemen, Claude 3.7 Sonnet en ChatGPT-4, op alle 450 vragen. De modellen antwoordden in het Hebreeuws, zagen dezelfde afbeeldingen en golfformen als de residenten en werden verhinderd eerdere vragen te onthouden. Elk model maakte elk examen twee keer zodat het team zowel nauwkeurigheid als interne consistentie kon meten.

Hoe goed de AI-modellen scoorden

Gemiddeld over alle examens beantwoordde Claude 3.7 Sonnet ongeveer drie van de vier vragen correct, duidelijk boven de algemene score van de residenten van iets meer dan drie van de vijf. ChatGPT-4 deed iets beter dan de residenten maar niet met een grote voorsprong. Claude overschreed de officiële slaaggrens bij elke poging, terwijl ChatGPT-4 slechts de helft van de keren slaagde. Toch bleven beide AI-systemen achter bij het bovenste kwart van menselijke kandidaten, die gemiddeld dicht bij vier van de vijf vragen goed hadden. Met andere woorden: de huidige modellen presteerden beter dan de typische resident op deze schriftelijke toetsen, maar bereikten niet het niveau van de sterkste menselijke kandidaten.

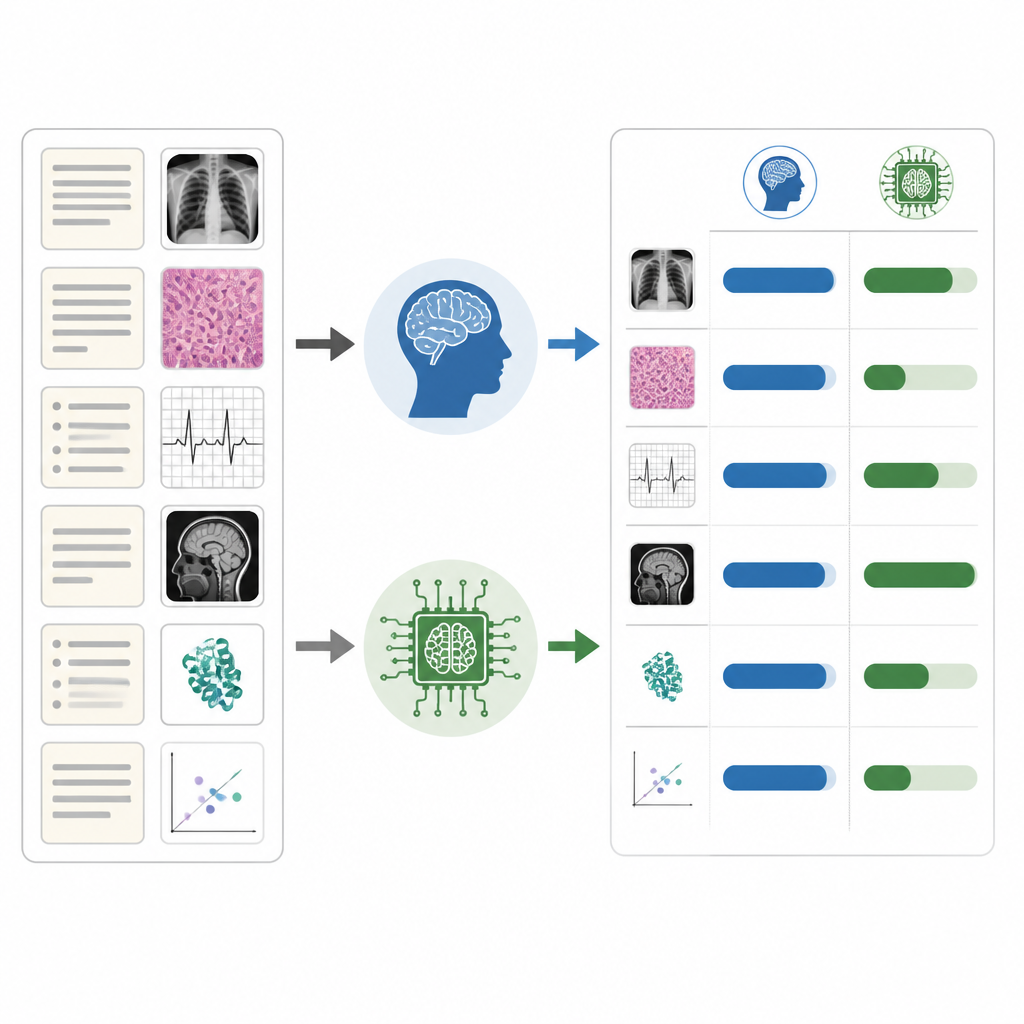

Sterke punten, zwakke punten en ongelijkmatige prestaties

De studie toonde aan dat de AI-systemen niet even goed waren over alle vraagtypes heen. Beide modellen behandelden makkelijkere items zeer goed en deden het relatief het beste op theoretische gebieden zoals hartfunctie, waar regels en concepten goed zijn vastgesteld. Hun prestatie nam af bij moeilijkere vragen en in praktische gebieden zoals poliklinische anesthesie en regionale anesthesie, waar context, oordeelsvorming en genuanceerde klinische ervaring belangrijk zijn. Vragen met afbeeldingen, scans of monitoringsporen leverden hen ook meer problemen op dan tekst-only items, terwijl menselijke residenten op beide formaten vergelijkbaar scoorden. Claude en ChatGPT vertoonden aanzienlijke interne consistentie wanneer ze hetzelfde examen twee keer kregen, maar ze kwamen slechts matig overeen met de antwoordpatronen van menselijke kandidaten.

Wat dit betekent voor medische opleiding

Dit ongelijkmatige beeld heeft belangrijke implicaties voor hoe AI in de opleiding van artsen gebruikt zou moeten worden. Omdat de nauwkeurigheid van de modellen varieert van bijna perfect in sommige onderwerpen tot verontrustend laag in andere, kan het vertrouwen op hen als hoofdbron tijdens het studeren misleidend zijn voor lerenden. Een resident kan bijvoorbeeld uitstekende uitleg krijgen over hartfysiologie maar slechte begeleiding over bepaalde anesthesietechnieken zonder het verschil te beseffen. De auteurs betogen dat deze hulpmiddelen voorzichtig in het onderwijs moeten worden ingezet, met nauwe menselijke supervisie, feitencontrole en helder bewustzijn van hun blinde vlekken, met name in domeinen die afbeeldingen en complexe beslissingen uit de echte wereld betreffen.

Conclusie voor de toekomst van AI en anesthesie

De studie concludeert dat geavanceerde taalmodellen nu beter presteren dan de gemiddelde anesthesiologieresident op een uitdagend nationaal schriftelijk examen, maar ze blijven achter bij de beste menselijke presteerders en vertonen grote hiaten tussen onderwerpen. Het slagen voor een meerkeuzetoets is slechts één deel van wat het betekent om een veilige anesthesioloog te zijn; dat vereist ook praktische vaardigheden, crisismanagement en communicatie met patiënten en teams. De auteurs suggereren dat de werkelijke belofte van AI niet ligt in het vervangen van clinici, maar in het ondersteunen van hen—het versterken van leren en besluitvorming wanneer het doordacht wordt gebruikt naast menselijke expertise.

Bronvermelding: Ronen, A., Fein, S., Orbach-Zinger, S. et al. Large language models versus human examinee performance on Israeli anesthesiology board examinations. Sci Rep 16, 14978 (2026). https://doi.org/10.1038/s41598-026-45411-6

Trefwoorden: anesthesiologie-opleiding, bestuurs examens, grote taalmodellen, medische AI-beoordeling, klinische bekwaamheid