Clear Sky Science · de

Große Sprachmodelle versus Leistungen menschlicher Prüflinge bei israelischen Anästhesiologie-Facharztprüfungen

Warum das für Ärzte und Patienten wichtig ist

Während künstliche Intelligenz immer häufiger in Krankenhäusern und Lehrveranstaltungen eingesetzt wird, stellt sich die zentrale Frage, wie sie im Vergleich zu echten Ärztinnen und Ärzten bei Tests des medizinischen Kernwissens abschneidet. Diese Studie untersucht, wie zwei fortgeschrittene Sprachmodelle im Vergleich zu Hunderten von Anästhesie-Assistenzärzten bei den offiziellen schriftlichen Facharztprüfungen in Israel abschnitten und liefert einen Einblick, was KI in der medizinischen Ausbildung leisten kann und was nicht.

Menschen und Maschinen mit derselben Prüfung testen

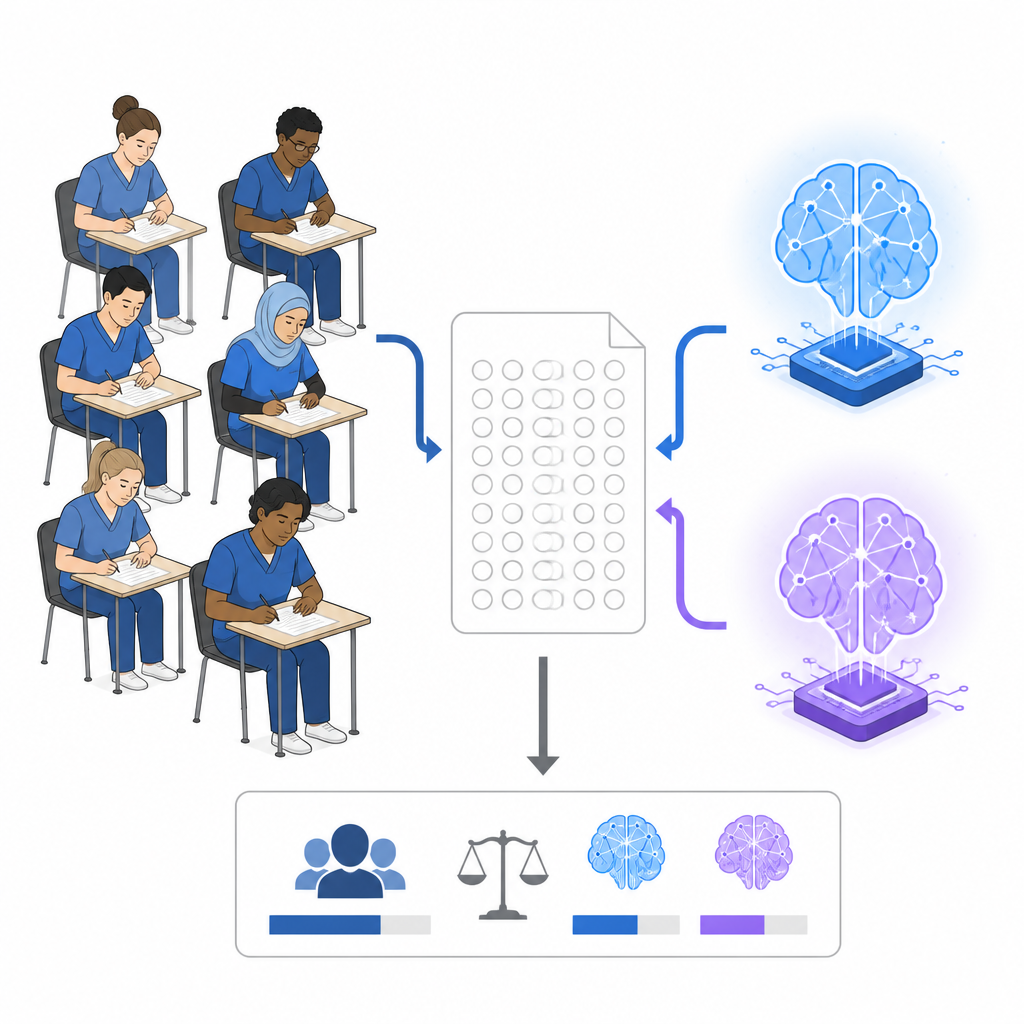

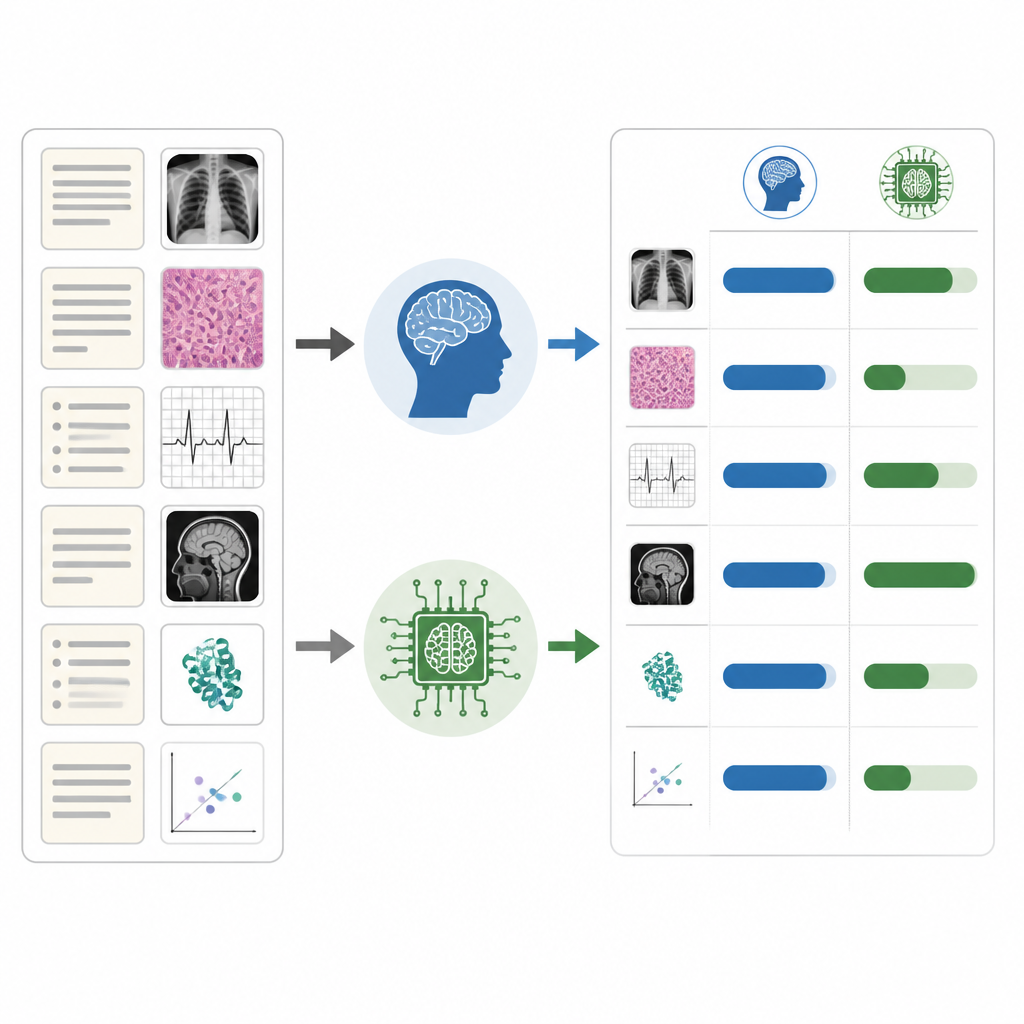

Die Forschenden erhielten drei aufeinanderfolgende Jahre der israelischen Step‑1-Anästhesie-Facharztprüfungen, einen Multiple‑Choice‑Test, der in der Mitte der Facharztausbildung abgelegt wird. Jede Prüfung enthielt 150 Fragen auf Hebräisch und deckte Grundlagenwissenschaften, klinische Grundlagen, Spezialgebiete der Anästhesie und Notfallversorgung ab. Neben anonymisierten Gruppenergebnissen von 381 Assistenzärzten testete das Team auch zwei kommerzielle KI‑Systeme, Claude 3.7 Sonnet und ChatGPT‑4, an allen 450 Fragen. Die Modelle antworteten auf Hebräisch, sahen dieselben Bilder und Kurven wie die Prüflinge und durften sich nicht an zuvor gestellte Fragen erinnern. Jedes Modell absolvierte jede Prüfung zweimal, damit die Forschenden sowohl Genauigkeit als auch interne Konsistenz messen konnten.

Wie gut die KI‑Modelle abschnitten

Im Durchschnitt über alle Prüfungen beantwortete Claude 3.7 Sonnet etwa drei von vier Fragen korrekt und lag damit deutlich über der Gesamtpunktzahl der Assistenzärzte von etwas mehr als drei von fünf. ChatGPT‑4 schnitt leicht besser als die Assistenzärzte ab, jedoch nicht um einen großen Abstand. Claude überschritt bei jedem Versuch die offizielle Bestehensgrenze, während ChatGPT‑4 nur in der Hälfte der Fälle bestand. Verglichen mit dem obersten Viertel der menschlichen Prüflinge, die im Schnitt nahe vier von fünf Fragen richtig hatten, lagen jedoch beide KI‑Systeme zurück. Anders gesagt: Aktuelle Modelle übertrafen den typischen Assistenzarzt in diesen schriftlichen Tests, erreichten aber nicht das Niveau der stärksten menschlichen Prüflinge.

Stärken, Schwächen und ungleichmäßige Leistung

Die Studie zeigte, dass die KI‑Systeme nicht in allen Fragetypen gleich gut abschnitten. Beide Modelle beherrschten leichtere Aufgaben sehr gut und erzielten relativ beste Ergebnisse in theoretischen Bereichen wie Herzfunktion, wo Regeln und Konzepte gut etabliert sind. Ihre Leistung sank bei schwierigeren Fragen und in praktischen Bereichen wie Ambulanter Anästhesie und Regionalanästhesie, wo Kontext, Urteilsvermögen und nuancierte klinische Erfahrung zählen. Fragen mit Bildern, Scans oder Monitorverläufen stellten sie stärker vor Probleme als rein textbasierte Aufgaben, während menschliche Assistenzärzte in beiden Formaten ähnlich punkteten. Claude und ChatGPT zeigten eine beträchtliche interne Konsistenz, wenn sie dieselbe Prüfung zweimal beantworteten, stimmten jedoch nur mäßig mit den Antwortmustern der menschlichen Prüflinge überein.

Was das für die medizinische Ausbildung bedeutet

Dieses uneinheitliche Bild hat wichtige Implikationen dafür, wie KI in der Ausbildung von Ärztinnen und Ärzten eingesetzt werden sollte. Da die Genauigkeit der Modelle in einigen Themen nahezu perfekt und in anderen besorgniserregend niedrig ist, könnte die ausschließliche Nutzung als Hauptlernquelle Lernende in die Irre führen. Ein Assistenzarzt könnte zum Beispiel exzellente Erklärungen zur Herzphysiologie erhalten, aber mangelhafte Anleitung zu bestimmten Anästhesietechniken, ohne den Unterschied zu bemerken. Die Autorinnen und Autoren plädieren dafür, diese Werkzeuge in der Ausbildung vorsichtig einzusetzen, mit enger menschlicher Aufsicht, Faktenprüfung und klarer Kenntnis ihrer blinden Flecken, insbesondere in Bereichen mit Bildmaterial und komplexen realen Entscheidungsprozessen.

Fazit für die Zukunft von KI und Anästhesie

Die Studie kommt zu dem Schluss, dass fortgeschrittene Sprachmodelle mittlerweile den durchschnittlichen Anästhesie‑Assistenzarzt in einer anspruchsvollen nationalen schriftlichen Prüfung übertreffen, aber weiterhin hinter den besten menschlichen Leistungsträgern zurückbleiben und große Lücken zwischen den Themen aufweisen. Das Bestehen eines Multiple‑Choice‑Tests ist nur ein Aspekt dessen, was es heißt, ein sicherer Anästhesist zu sein; dazu gehören zudem praktische Fertigkeiten, Krisenmanagement und Kommunikation mit Patientinnen und Patienten sowie Teams. Die Autorinnen und Autoren schlagen vor, dass das eigentliche Potenzial der KI nicht darin liegt, klinisches Personal zu ersetzen, sondern es zu unterstützen und Lernen sowie Entscheidungsfindung zu stärken, wenn sie bedacht neben menschlicher Expertise eingesetzt wird.

Zitation: Ronen, A., Fein, S., Orbach-Zinger, S. et al. Large language models versus human examinee performance on Israeli anesthesiology board examinations. Sci Rep 16, 14978 (2026). https://doi.org/10.1038/s41598-026-45411-6

Schlüsselwörter: Anästhesie-Ausbildung, Facharztprüfungen, große Sprachmodelle, medizinische KI-Bewertung, klinische Kompetenz