Clear Sky Science · ar

نماذج اللغة الكبيرة مقابل أداء الممتحن البشري في امتحانات مجلس التخدير الإسرائيلية

لماذا هذا مهم للأطباء والمرضى

مع تسارع دخول أدوات الذكاء الاصطناعي إلى المستشفيات وقاعات التدريس، يبقى سؤال أساسي حول كيفية مقارنتها بالأطباء الحقيقيين عند اختبارها على المعارف الطبية الأساسية. تدرس هذه الدراسة كيف قارن نموذجان لغويان متقدمان مع مئات من مقيمي التخدير البشريين في إسرائيل في امتحانات المجلس الكتابية الرسمية، موفرة لمحة عما قد تكون عليه قدرة الذكاء الاصطناعي وما قد لا يكون جاهزًا له في التدريب الطبي.

اختبار البشر والآلات على نفس الامتحان

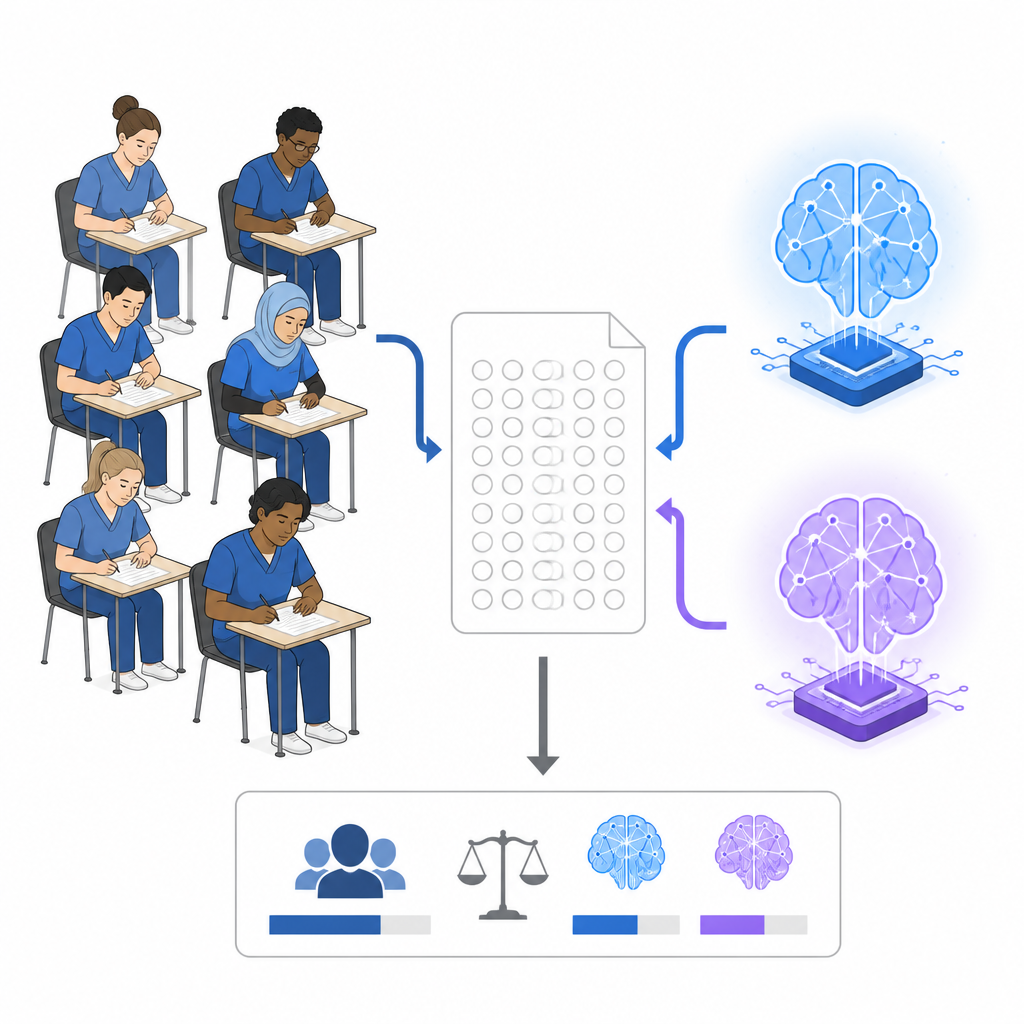

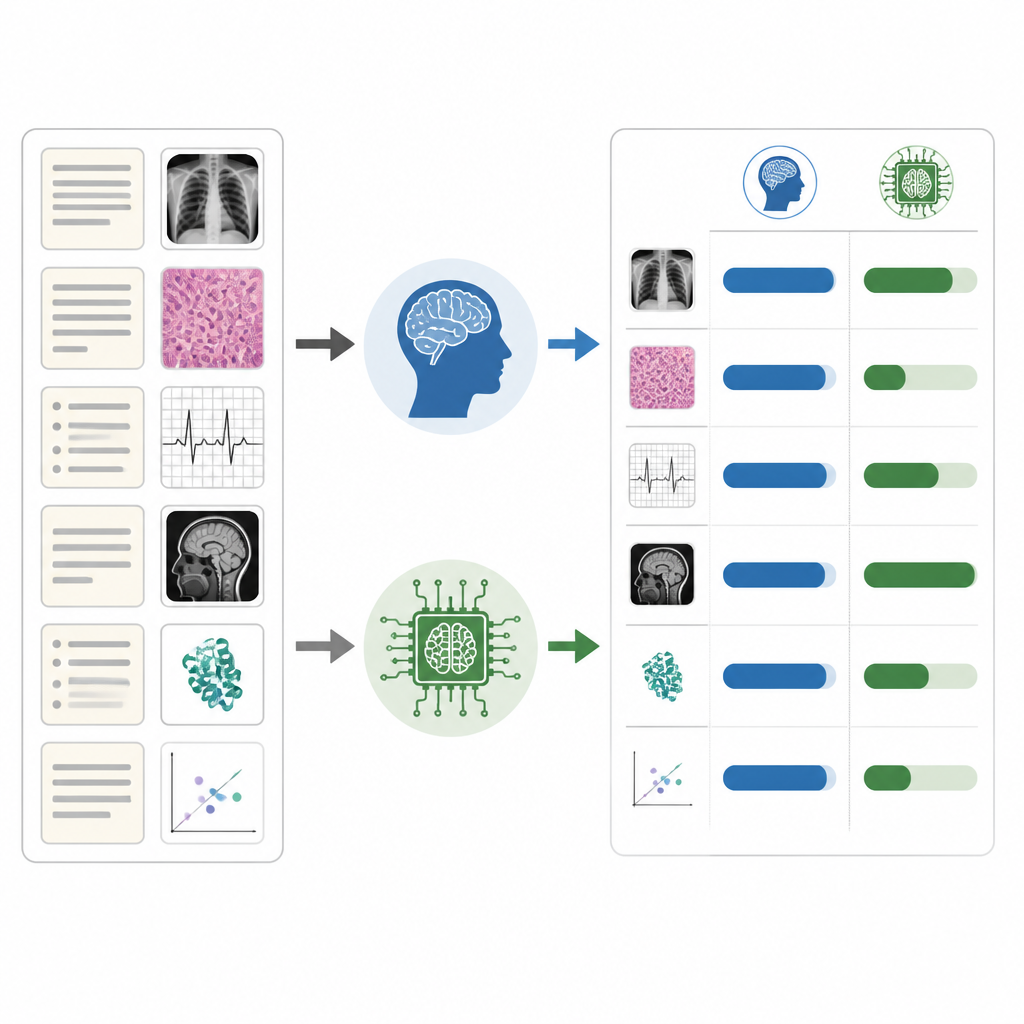

حصل الباحثون على ثلاث سنوات متتالية من امتحانات مجلس التخدير في إسرائيل للمرحلة الأولى، وهو اختبار متعدد الخيارات يُجرى منتصف فترة الاختصاص. احتوى كل امتحان على 150 سؤالًا باللغة العبرية، تغطي العلوم الأساسية، والأسس السريرية، وتخدير التخصصات الفرعية، ورعاية الطوارئ. إلى جانب نتائج مجمعة مُجهّلة لهوية 381 مُقيمًا، اختبر الفريق أيضًا نظاميْن تجارييْن للذكاء الاصطناعي، Claude 3.7 Sonnet وChatGPT-4، على جميع الأسئلة البالغ عددها 450. أجاوبت النماذج بالعبرية، ورأت نفس الصور ومخططات المراقبة مثل المقيمين، ومنعت من استذكار أسئلة سابقة. اجتاز كل نموذج كل امتحان مرتين حتى يتمكن الفريق من قياس الدقة والاتساق الداخلي.

كيف سجلت نماذج الذكاء الاصطناعي

في المتوسط عبر جميع الامتحانات، أجاب Claude 3.7 Sonnet عن نحو ثلاثة من كل أربعة أسئلة بشكل صحيح، متفوقًا بوضوح على النتيجة الإجمالية للمقيمين التي كانت قليلاً أكثر من ثلاثة من كل خمسة. أدت ChatGPT-4 أداءً أفضل قليلاً من المقيمين لكن ليس بفارق كبير. تجاوز Claude علامة النجاح الرسمية في كل محاولة، بينما نجح ChatGPT-4 في نصف المحاولات فقط. ومع ذلك، مقارنةً بالربع العلوي من الممتحنين البشريين الذين حققوا تقريبًا أربعة إجابات صحيحة من كل خمسة، ظل كلا النظامين متخلفين. بعبارة أخرى، تفوقت النماذج الحالية على المقيم النموذجي في هذه الاختبارات الكتابية لكنها لم تضاهِ أقوى المؤدين البشريين.

نقاط القوة، والضعف، والأداء غير المتكافئ

كشفت الدراسة أن النظم الاصطناعية لم تكن متجانسة الأداء عبر كل أنواع الأسئلة. تعاملت النماذج جيدًا جدًا مع البنود الأسهل وأدّت أفضل نسبيًا في المجالات النظرية مثل وظيفة القلب، حيث القواعد والمفاهيم محددة جيدًا. تراجع أداؤها في الأسئلة الأصعب وفي المجالات العملية مثل تخدير المرضى الخارجيين والتخدير الإقليمي، حيث تلعب السياقات والحكم والخبرة السريرية الدقيقة دورًا أكبر. كما أُعاقت أكثر بالأسئلة التي تضمنت صورًا أو فحوصات أو اشارات مراقبة مقارنةً بالأسئلة النصية فقط، بينما سجل المقيمون البشريون درجات متقاربة على كلا الشكلين. أظهر كل من Claude وChatGPT اتساقًا داخليًا كبيرًا عند الإجابة على نفس الامتحان مرتين، لكن توافقهما مع أنماط إجابات البشر كان متوسطًا فقط.

ما يعنيه هذا للتعليم الطبي

للصورة غير المتكافئة هذه تداعيات مهمة على كيفية استخدام الذكاء الاصطناعي في تدريب الأطباء. نظرًا لتغير دقة النماذج من شبه مثالية في بعض الموضوعات إلى منخفضة بشكل مقلق في أخرى، قد يؤدي الاعتماد عليها كمصدر دراسي أساسي إلى توجيه المتعلمين بصورة مضللة. على سبيل المثال، قد يتلقى المُقيمُ تفسيرات ممتازة في فيزيولوجيا القلب لكن توجيهًا ضعيفًا في تقنيات تخدير معينة دون أن يدرك الفرق. يجادل المؤلفون بأنه ينبغي استخدام هذه الأدوات بحذر في التعليم، مع إشراف بشري دقيق، والتحقق من الحقائق، والوعي الواضح بنقاط ضعفها، لا سيما في المجالات التي تتضمن صورًا واتخاذ قرارات معقدة في العالم الحقيقي.

الخلاصة حول مستقبل الذكاء الاصطناعي والتخدير

تخلص الدراسة إلى أن نماذج اللغة المتقدمة تتفوق الآن على المقيم النموذجي في التخدير في امتحان وطني كتابي تحدي، لكنها لا تزال أقل من أفضل المؤدين البشريين وتظهر فروقًا كبيرة بين الموضوعات. النجاح في اختبار اختيار من متعدد هو مجرد جانب واحد لما يعنيه أن تكون طبيب تخدير آمنًا، والذي يتطلب أيضًا مهارات عملية، وإدارة الأزمات، والتواصل مع المرضى والفرق. يقترح المؤلفون أن الوعد الحقيقي للذكاء الاصطناعي يكمن في دعمه للممارسين بدلاً من استبدالهم، والمساعدة في تقوية التعلم واتخاذ القرار عند استخدامه بتفكير واعٍ جنبًا إلى جنب مع الخبرة البشرية.

الاستشهاد: Ronen, A., Fein, S., Orbach-Zinger, S. et al. Large language models versus human examinee performance on Israeli anesthesiology board examinations. Sci Rep 16, 14978 (2026). https://doi.org/10.1038/s41598-026-45411-6

الكلمات المفتاحية: تعليم التخدير, امتحانات المجلس, نماذج اللغة الكبيرة, تقييم الذكاء الاصطناعي الطبي, الكفاءة السريرية