Clear Sky Science · es

Modelos de lenguaje grandes frente al rendimiento de examinados humanos en los exámenes de la junta de anestesiología israelíes

Por qué esto importa para médicos y pacientes

A medida que las herramientas de inteligencia artificial irrumpen en hospitales y aulas, una pregunta clave es cómo se comparan con médicos reales cuando se les evalúa en conocimientos médicos fundamentales. Este estudio analiza cómo dos modelos avanzados de lenguaje se compararon con cientos de residentes de anestesiología en los exámenes escritos oficiales de Israel, ofreciendo una visión de lo que la IA puede y no puede estar preparada para hacer en la formación médica.

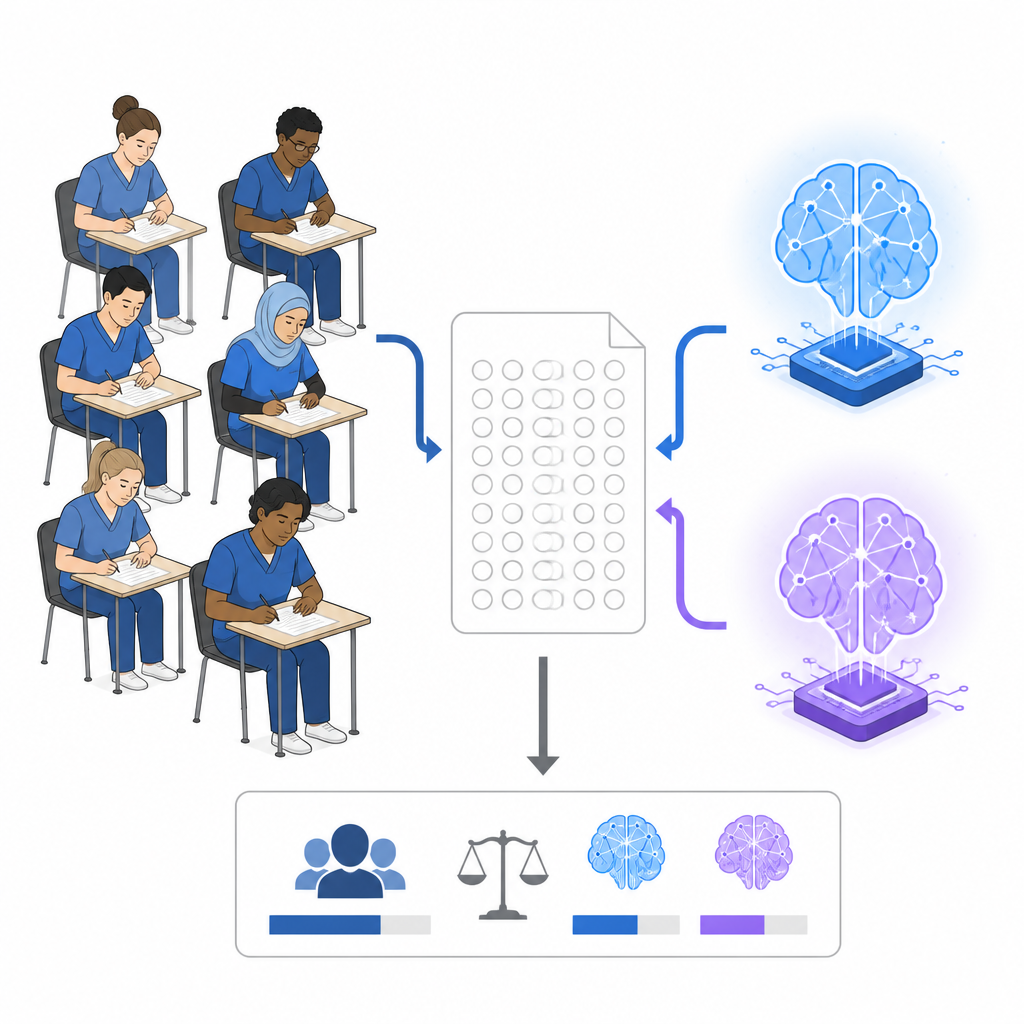

Evaluando a humanos y máquinas con el mismo examen

Los investigadores obtuvieron tres años consecutivos de los exámenes de la junta de anestesiología Step 1 de Israel, una prueba de opción múltiple realizada a mitad de la residencia. Cada examen contenía 150 preguntas en hebreo, que abarcaban ciencias básicas, fundamentos clínicos, anestesia de subespecialidad y atención de urgencias. Junto con los resultados anonimizados de 381 residentes, el equipo también probó dos sistemas comerciales de IA, Claude 3.7 Sonnet y ChatGPT-4, en las 450 preguntas. Los modelos respondieron en hebreo, vieron las mismas imágenes y trazados que los residentes y se les impidió recordar preguntas anteriores. Cada modelo realizó cada examen dos veces para que el equipo pudiera medir tanto la precisión como la consistencia interna.

Cómo puntuaron los modelos de IA

En promedio a lo largo de todos los exámenes, Claude 3.7 Sonnet respondió correctamente aproximadamente tres de cada cuatro preguntas, claramente por encima de la puntuación global de los residentes, algo más de tres de cada cinco. ChatGPT-4 obtuvo un rendimiento algo superior al de los residentes, pero no por un margen amplio. Claude superó la nota oficial de aprobado en todos los intentos, mientras que ChatGPT-4 aprobó solo la mitad de las veces. Sin embargo, al compararlos con el cuarto superior de los examinados humanos, que promediaron cerca de cuatro respuestas correctas de cada cinco, ambos sistemas de IA aún se quedaron atrás. En otras palabras, los modelos actuales superaron al residente típico en estas pruebas escritas pero no igualaron a los mejores examinandos humanos.

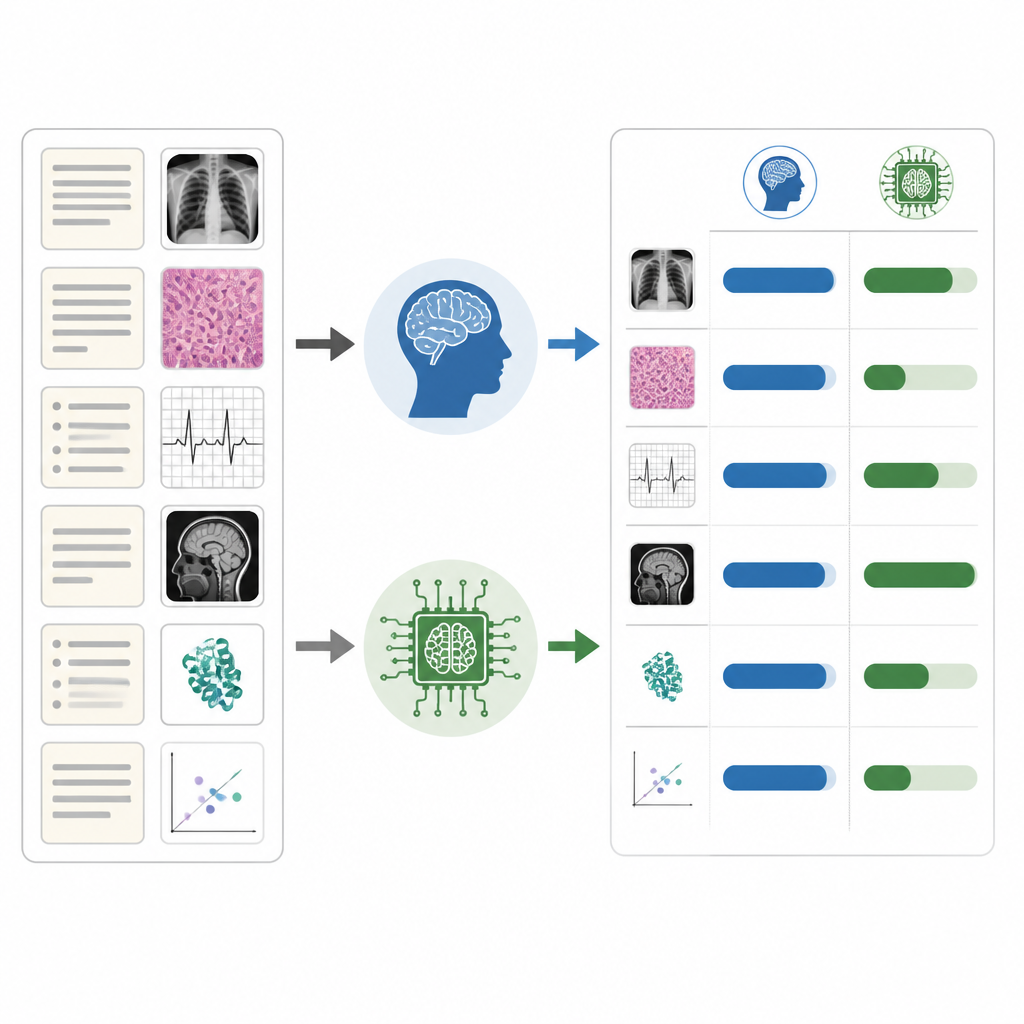

Fortalezas, debilidades y rendimiento desigual

El estudio reveló que los sistemas de IA no fueron igualmente buenos en todos los tipos de preguntas. Ambos modelos resolvieron muy bien los ítems más sencillos y rindieron relativamente mejor en áreas teóricas como la función cardíaca, donde las reglas y los conceptos están bien establecidos. Su rendimiento cayó en preguntas más difíciles y en áreas prácticas como anestesia ambulatoria y anestesia regional, donde el contexto, el juicio y la experiencia clínica matizada importan. Las preguntas que incluían imágenes, exploraciones o trazados de monitorización también los complicaron más que los ítems solo de texto, mientras que los residentes humanos puntuaron de forma similar en ambos formatos. Claude y ChatGPT mostraron una consistencia interna sustancial al repetir el mismo examen dos veces, aunque solo acordaron de forma moderada con los patrones de respuesta de los examinados humanos.

Qué significa esto para la educación médica

Este panorama desigual tiene implicaciones importantes sobre cómo debe usarse la IA en la formación de médicos. Dado que la precisión de los modelos oscila desde casi perfecta en algunos temas hasta preocupantemente baja en otros, confiar en ellos como fuente principal de estudio podría llevar a errores en el aprendizaje. Por ejemplo, un residente podría recibir excelentes explicaciones en fisiología cardíaca pero una guía deficiente en ciertas técnicas anestésicas sin darse cuenta de la diferencia. Los autores sostienen que estas herramientas deben usarse con cautela en la educación, con supervisión humana estrecha, verificación de hechos y conciencia clara de sus puntos ciegos, especialmente en áreas que implican imágenes y toma de decisiones complejas en el mundo real.

Conclusión sobre el futuro de la IA y la anestesia

El estudio concluye que los modelos avanzados de lenguaje ahora superan al residente medio de anestesiología en un exigente examen escrito nacional, pero aún están por debajo de los mejores intérpretes humanos y muestran grandes brechas entre temas. Aprobar una prueba de opción múltiple es solo una parte de lo que significa ser un anestesiólogo seguro, que también requiere habilidades prácticas, manejo de crisis y comunicación con pacientes y equipos. Los autores sugieren que la promesa real de la IA no está en reemplazar clínicos, sino en apoyarlos, ayudando a reforzar el aprendizaje y la toma de decisiones cuando se usa de forma reflexiva junto a la experiencia humana.

Cita: Ronen, A., Fein, S., Orbach-Zinger, S. et al. Large language models versus human examinee performance on Israeli anesthesiology board examinations. Sci Rep 16, 14978 (2026). https://doi.org/10.1038/s41598-026-45411-6

Palabras clave: educación en anestesiología, exámenes de la junta, modelos de lenguaje grandes, evaluación de IA médica, competencia clínica