Clear Sky Science · sv

Stora språkmodeller versus mänskliga provdeltagares prestationer på israeliska anestesiologiska styrelseprov

Varför detta är viktigt för läkare och patienter

När artificiella intelligensverktyg snabbt införs på sjukhus och i klassrum är en central fråga hur de står sig mot verkliga läkare när de testas på kärnmedicinsk kunskap. Denna studie undersöker hur två avancerade språkmodeller jämfördes med hundratals mänskliga anestesiologiresidenter på Israels officiella skriftliga styrelseprov och ger en inblick i vad AI kan och inte kan vara redo att göra inom medicinsk utbildning.

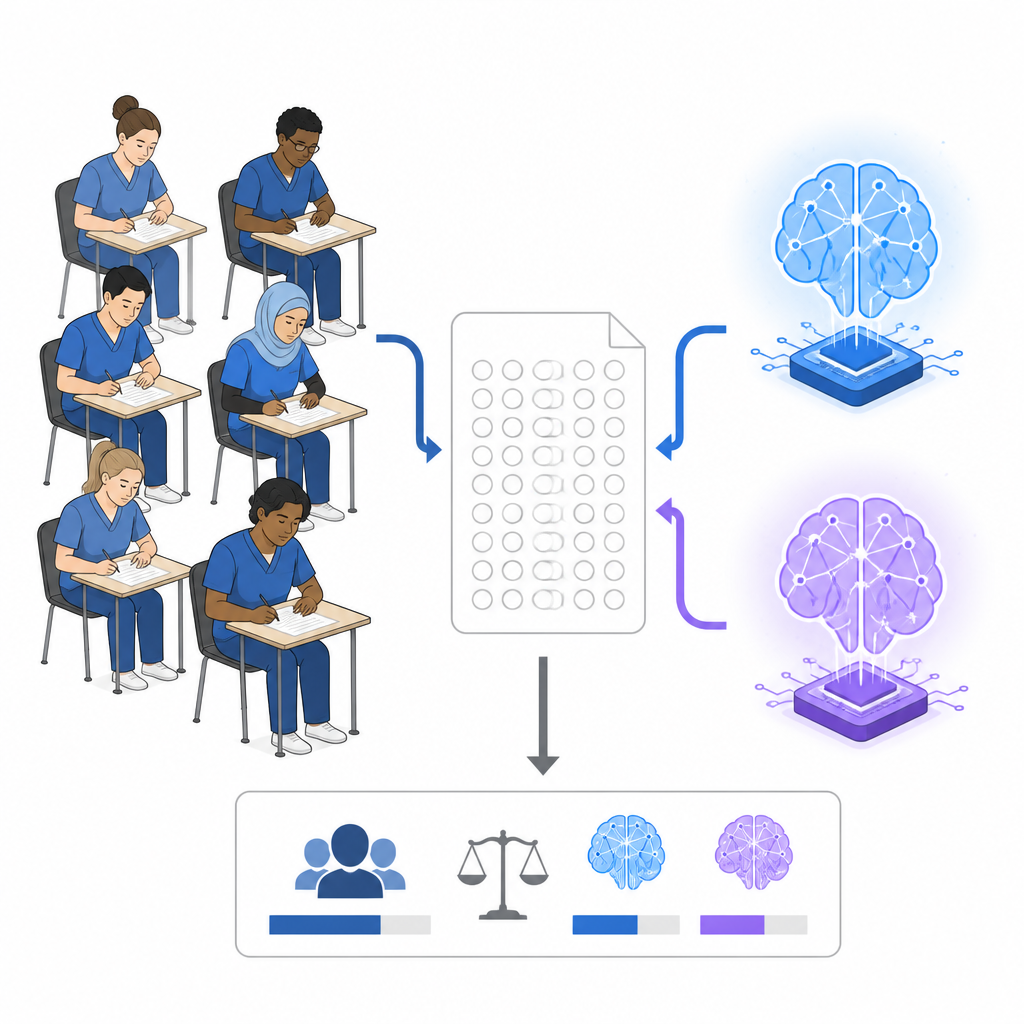

Testning av människor och maskiner på samma prov

Forskarna skaffade tre på varandra följande års israeliska Step 1-anestesiologiska styrelseprov, ett flervalsprov som tas mitt i residenttjänstgöringen. Varje prov innehöll 150 frågor på hebreiska och täckte grundvetenskap, kliniska grunder, subspecialiserad anestesi och akutvård. Vid sidan av anonymiserade gruppresultat från 381 residenter testade teamet också två kommersiella AI-system, Claude 3.7 Sonnet och ChatGPT-4, på alla 450 frågor. Modellerna svarade på hebreiska, såg samma bilder och kurvor som residenterna och förhindrades från att komma ihåg tidigare frågor. Varje modell genomgick varje prov två gånger så att teamet kunde mäta både noggrannhet och intern konsistens.

Hur väl AI-modellerna presterade

I genomsnitt över alla prov svarade Claude 3.7 Sonnet ungefär tre av fyra frågor korrekt, klart över residenternas sammanlagda poäng på lite över tre av fem. ChatGPT-4 presterade något bättre än residenterna men inte med en stor marginal. Claude översteg den officiella godkändnivån vid varje försök, medan ChatGPT-4 klarade gränsen endast hälften av gångerna. När de jämfördes med den översta fjärdedelen av människliga provdeltagare, som i genomsnitt svarade nära fyra av fem rätt, låg dock båda AI-systemen fortfarande efter. Med andra ord överträffade nuvarande modeller den typiska residenten på dessa skriftliga prov men nådde inte upp till de starkaste mänskliga provtagarna.

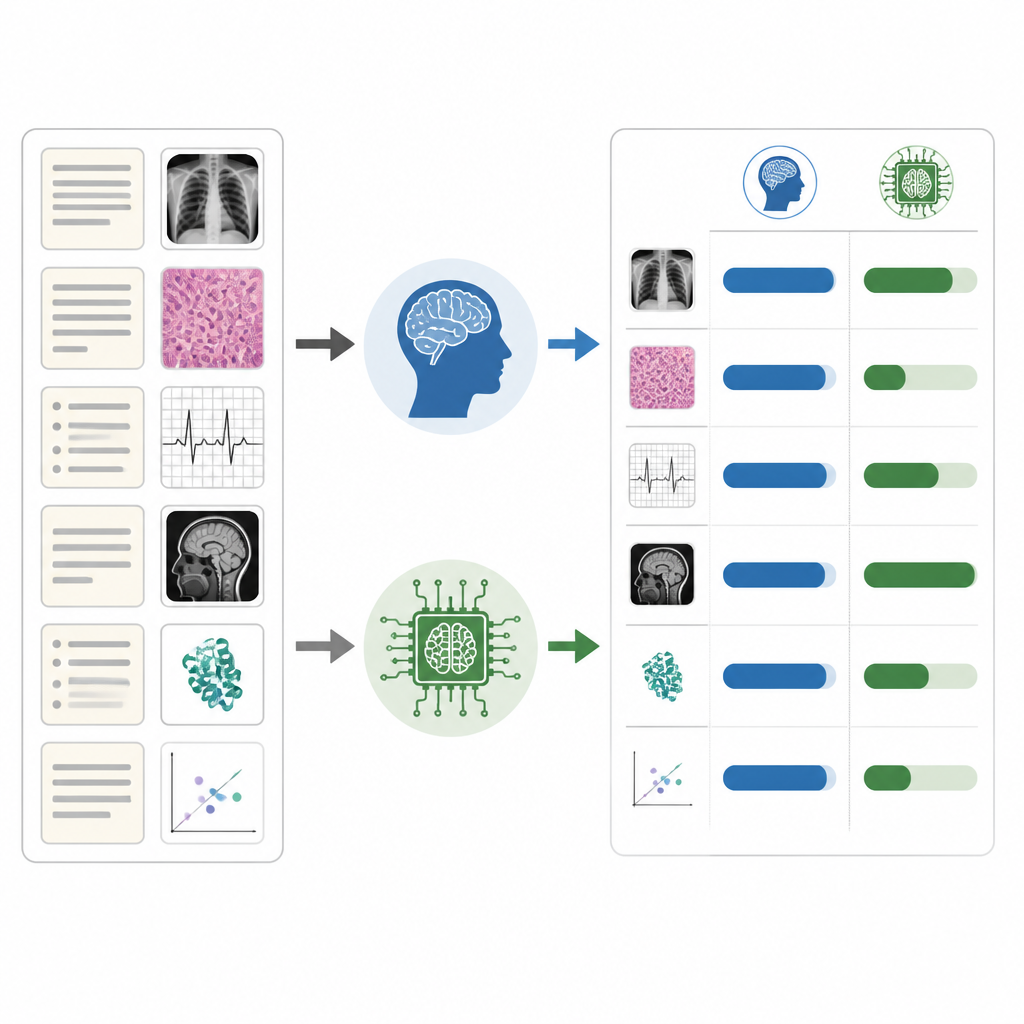

Styrkor, svagheter och ojämn prestation

Studien visade att AI-systemen inte var likvärdigt duktiga över alla frågetyper. Båda modellerna hanterade enklare uppgifter mycket väl och gjorde relativt sett bäst ifrån sig i teoretiska områden som hjärtats funktion, där regler och begrepp är väl etablerade. Deras prestation sjönk på svårare frågor och inom praktiska områden som öppenvårdsanestesi och regional anestesi, där kontext, omdöme och nyanserad klinisk erfarenhet spelar roll. Frågor som inkluderade bilder, skanningar eller övervakningskurvor ställde dem också inför större svårigheter än textbaserade ärenden, medan mänskliga residenter hade liknande poäng på båda formaten. Claude och ChatGPT visade betydande intern konsistens när de fick samma prov två gånger, men de överensstämde endast måttligt med människornas svarsmönster.

Vad detta betyder för medicinsk utbildning

Denna ojämna bild har viktiga konsekvenser för hur AI bör användas i utbildningen av läkare. Eftersom modellernas noggrannhet varierar från nästan perfekt i vissa ämnen till oroande låg i andra, kan ett beroende av dem som huvudsaklig studiekälla vilseleda lärande. En resident kan till exempel få utmärkta förklaringar i hjärt fysiologi men bristfällig vägledning i vissa anestesitekniker utan att märka skillnaden. Författarna hävdar att dessa verktyg bör användas försiktigt i utbildningen, med nära mänsklig övervakning, faktakontroll och tydlig medvetenhet om deras blinda fläckar, särskilt i områden som involverar bilder och komplexa beslut i verkliga situationer.

Slutsats för AI:s och anestesins framtid

Studien drar slutsatsen att avancerade språkmodeller nu överträffar genomsnittet av anestesiologiresidenter på ett utmanande nationellt skriftligt prov, men att de fortfarande ligger efter de bästa människliga presterarna och uppvisar stora skillnader mellan ämnen. Att klara ett flervalsprov är bara en del av vad det innebär att vara en säker anestesiolog — det kräver också praktiska färdigheter, krishantering och kommunikation med patienter och team. Författarna föreslår att AI:s verkliga potential inte ligger i att ersätta kliniker utan i att stödja dem, hjälpa till att stärka lärande och beslutsfattande när det används genomtänkt tillsammans med mänsklig expertis.

Citering: Ronen, A., Fein, S., Orbach-Zinger, S. et al. Large language models versus human examinee performance on Israeli anesthesiology board examinations. Sci Rep 16, 14978 (2026). https://doi.org/10.1038/s41598-026-45411-6

Nyckelord: anestesiologisk utbildning, styrelseprov, stora språkmodeller, medicinsk AI-bedömning, klinisk kompetens