Clear Sky Science · zh

由可信计算驱动的跨机构医疗联邦学习框架优化

为何保护共享医疗数据至关重要

现代医院越来越依赖人工智能来解读影像、早期发现疾病并指导治疗。然而,能救命的算法需要大量患者数据,而跨机构共享这些数据会与严格的隐私法规冲突,并带来被攻击的现实风险。本文探讨了医院如何在不集中原始病历的情况下协同训练强大的 AI 模型,以及如何防范即使数据未离开医院也可能通过微妙硬件攻击泄露秘密的风险。

医院在不共享病历的前提下协作

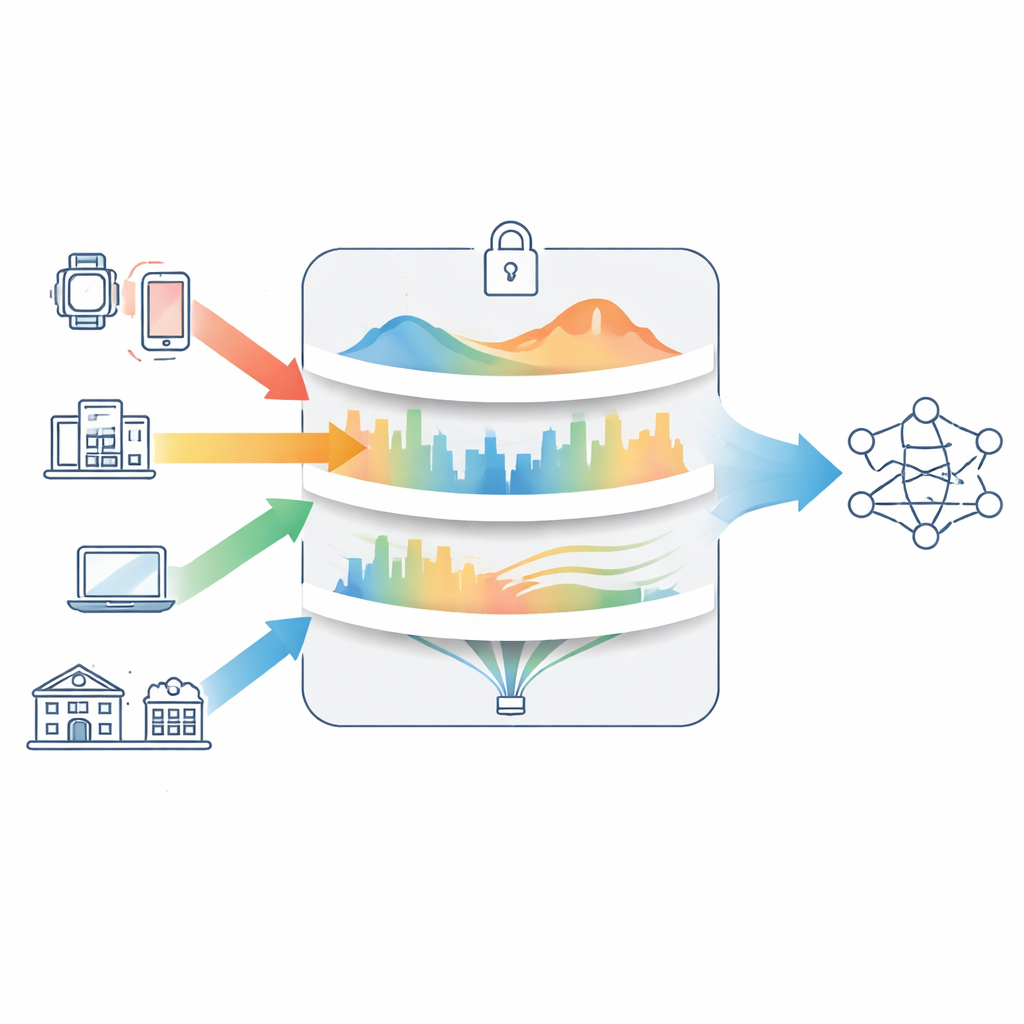

该研究以一种称为联邦学习的技术为核心:每个医疗机构在本地患者数据上训练自身的模型副本。医院不是将图像或记录发往中央服务器,而是仅发送模型更新,服务器将这些更新合并为一个共享模型并返回给各方。经过多轮迭代,这一过程可以产生反映多家医院知识的 AI 系统,同时每个机构将原始数据保留在自己的防火墙后面。这种架构对医疗和金融等领域很有吸引力,因为法律和伦理使得建立大型中央数据湖既危险又不可行。

“安全”硬件内部的隐蔽泄露

为使这种协作更安全,许多系统采用可信计算:即在称为可信执行环境的特殊硬件区域中隔离敏感计算。理论上,这些隔离区能在好奇的内部人员或已被攻破的操作系统面前保护模型训练。然而,实践中它们并非完美。攻击者有时可以通过观察时间特征、缓存使用或其他计算的副作用来推断秘密。现有的联邦学习方法很少明确建模这些泄露。它们也倾向于将隐私、模型准确性和网络成本视为独立的设计选项,尽管在真实部署中医院必须同时权衡这三者。

在准确性、隐私与网络负载之间权衡

作者提出了一种新的训练方法,称为可信计算感知投影梯度下降(CC-PGD)。CC-PGD 不仅关注预测误差,还同时优化三项内容:模型对数据的拟合程度、通过安全硬件内的侧信道可能暴露的信息量,以及医院与中央服务器之间所需的通信量。隐私风险通过模型产生的梯度“形状”来度量:如果只有少数参数占主导,攻击者可能更容易了解特定患者;如果信息更均匀分布,可推断的信息则更少。该方法还包含一个指标,用于指示已知硬件弱点何时更容易被利用,以及一个代价项,用来刻画模型更新的大小及其通过网络传输所需的时间。

一种指导性的方法来调节安全设置

在底层,CC-PGD 的工作原理类似于受约束的常规梯度下降,这是现代 AI 训练的标准方法。论文证明,即使加入了额外的隐私和通信惩罚,他们的优化器在广泛条件下仍能可靠收敛。重要的是,CC-PGD 暴露了两个可调“旋钮”:一个用于加强隐私保护,另一个用于限制通信开销。通过调节这些旋钮,系统设计者可以决定在研究中优先追求最高准确性,还是为网络慢的偏远诊所选择更强的隐私保护和更低的带宽需求。

实验结果说明了什么

为检验该想法,作者模拟了多家医疗机构在公开数据集(MNIST 和 CIFAR-10)上训练图像识别模型的情形。他们将 CC-PGD 与常用的联邦学习方法进行比较,包括标准的联邦平均、添加随机噪声以保护隐私的技术以及针对客户端数据不均衡的变体。在简单和更复杂的图像任务上、在数据平均分配或不均分配的情形下,CC-PGD 在准确性上接近集中式训练能达到的水平。同时,与基线方法相比,它将隐私泄露度量降低了约四分之一到三分之一,并将通信成本降低了大约五分之一。

对真实世界医疗 AI 的意义

通俗地说,这项工作表明医院在联合训练 AI 时无需在模型质量、隐私和可行性之间做出二选一。通过明确建模信息如何可能从所谓的安全硬件中泄露,并在训练过程中将隐私和带宽成本纳入优化,CC-PGD 提供了一种有原则的设计更安全协作系统的途径。尽管实验使用的是基准图像而非真实影像,该框架具有通用性,可应用于更大模型,包括分析病历或网络安全日志的生成式 AI 工具与语言模型。经在真实医院数据上的进一步验证,此类方法可为可信赖的 AI 网络提供支撑,使其在从多家机构学习的同时将每位患者的数据安全地保留在本地。

引用: Xu, F., Wei, X., Zhao, Z. et al. Optimization of cross-institutional medical federated learning framework driven by confidential computing. Sci Rep 16, 14323 (2026). https://doi.org/10.1038/s41598-026-44843-4

关键词: 联邦学习, 可信计算, 医疗人工智能, 隐私保护训练, 可信执行环境