Clear Sky Science · fr

Optimisation d’un cadre de fédération médicale interinstitutionnelle piloté par le calcul confidentiel

Pourquoi la protection des données médicales partagées est importante

Les hôpitaux modernes s’appuient de plus en plus sur l’intelligence artificielle pour lire les images, détecter les maladies plus tôt et guider les traitements. Pourtant, les algorithmes qui sauvent des vies nécessitent d’importantes quantités de données patients, et le partage de ces données entre établissements entre en conflit avec des règles de confidentialité strictes et de réelles inquiétudes liées aux attaques informatiques. Cet article explore comment les hôpitaux peuvent coopérer pour entraîner des modèles d’IA puissants sans centraliser les dossiers bruts des patients, et comment se prémunir contre des attaques matérielles subtiles qui peuvent fuir des secrets même lorsque les données ne quittent jamais l’hôpital.

Des hôpitaux qui travaillent ensemble sans partager les dossiers

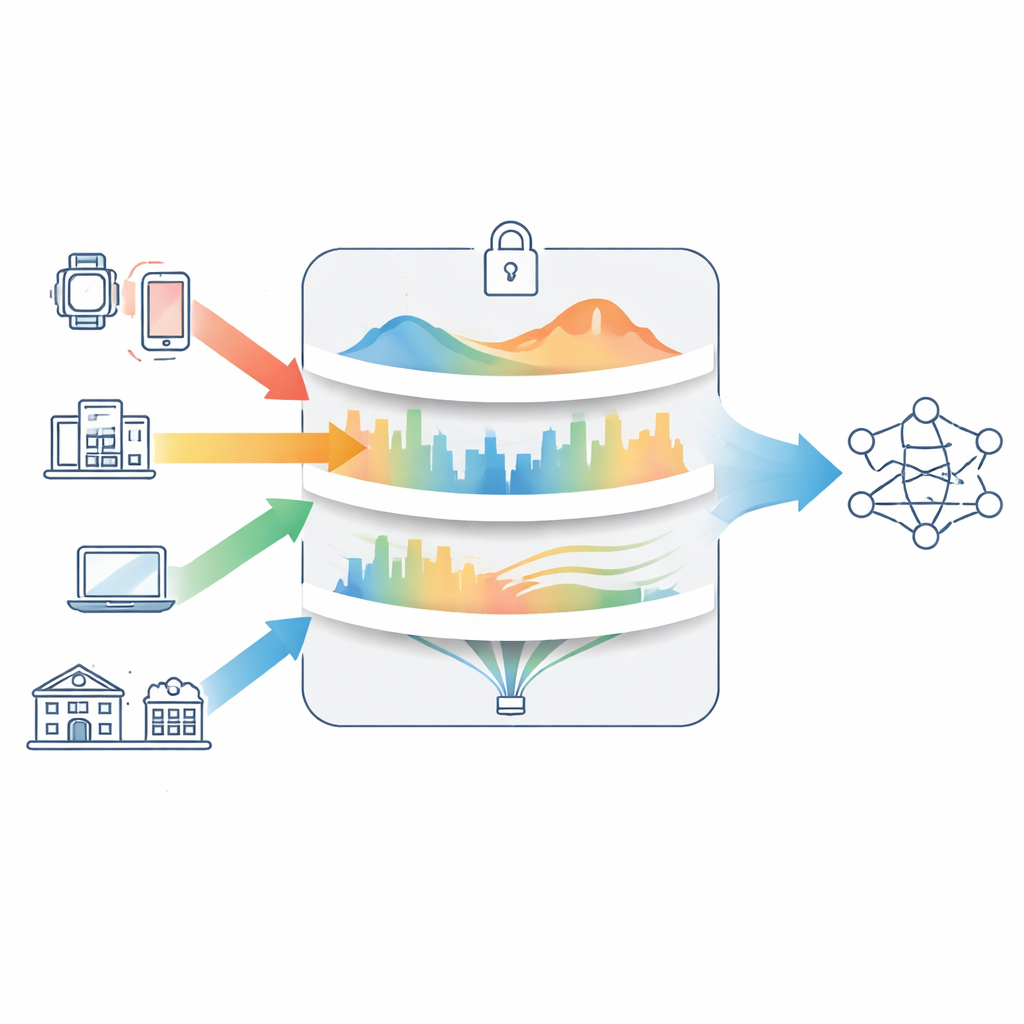

L’étude s’articule autour d’une technique appelée apprentissage fédéré, où chaque institution médicale entraîne sa propre copie d’un modèle d’IA sur des données locales. Plutôt que d’envoyer images ou dossiers à un serveur central, les hôpitaux transmettent seulement des mises à jour de modèle, que le serveur agrège pour former un modèle partagé avant de le renvoyer. Au fil de plusieurs cycles, ce processus peut produire un système d’IA qui reflète le savoir de nombreux établissements, tout en permettant à chacun de conserver ses données brutes derrière son propre pare-feu. Cette configuration est attrayante dans la santé et la finance, où la loi et l’éthique rendent les lacs de données centralisés risqués voire impossibles.

Fuites cachées à l’intérieur du matériel « sécurisé »

Pour rendre cette collaboration plus sûre, de nombreux systèmes utilisent le calcul confidentiel : des zones matérielles spéciales appelées environnements d’exécution de confiance qui isolent les calculs sensibles du reste de l’ordinateur. En théorie, ces enclaves protègent l’entraînement des modèles contre des initiés curieux ou des systèmes d’exploitation compromis. En pratique, elles ne sont pas parfaites. Des attaquants peuvent parfois déduire des secrets en observant le temps d’exécution, l’utilisation du cache ou d’autres effets secondaires du calcul. Les méthodes d’apprentissage fédéré existantes modélisent rarement ces fuites explicitement. Elles ont aussi tendance à traiter la confidentialité, la précision du modèle et le coût réseau comme des choix de conception séparés, alors que dans les déploiements réels les hôpitaux doivent jongler avec les trois en même temps.

Équilibrer précision, confidentialité et charge réseau

Les auteurs proposent une nouvelle méthode d’entraînement appelée Descente de Gradient Projetée consciente du Calcul Confidentiel (CC-PGD). Plutôt que de se concentrer uniquement sur l’erreur de prédiction, CC-PGD optimise trois éléments simultanément : l’ajustement du modèle aux données, la quantité d’information susceptible d’être exposée via des canaux auxiliaires à l’intérieur du matériel sécurisé, et le volume de communication nécessaire entre les hôpitaux et le serveur central. Le risque pour la vie privée est évalué en regardant la « forme » des gradients produits par le modèle : si quelques paramètres dominent, un attaquant peut apprendre davantage sur des patients spécifiques ; si l’information est répartie plus uniformément, moins peut être inféré. La méthode intègre aussi un indicateur des moments où des faiblesses matérielles connues sont plus susceptibles d’être exploitables, ainsi qu’un terme de coût qui capture la taille des mises à jour du modèle et le temps nécessaire pour les transmettre sur les réseaux.

Une manière guidée d’ajuster les paramètres de sécurité

Dans les coulisses, CC-PGD fonctionne comme une version soigneusement contraignante de la descente de gradient ordinaire, l’outil standard de l’entraînement en IA moderne. L’article démontre que, même avec les pénalités supplémentaires de confidentialité et de communication, leur optimiseur converge de manière fiable sous des conditions larges. De manière cruciale, CC-PGD expose deux « boutons » ajustables que les concepteurs de systèmes peuvent tourner : l’un renforce la protection de la vie privée et l’autre limite la charge de communication. Modifier ces boutons permet aux opérateurs de décider, par exemple, s’ils favorisent la précision maximale pour une étude de recherche ou une confidentialité renforcée et une moindre bande passante pour une clinique rurale à internet lent.

Ce que montrent les expériences

Pour tester l’idée, les auteurs simulent plusieurs institutions médicales entraînant des modèles de reconnaissance d’images sur des jeux de données publics bien connus (MNIST et CIFAR-10). Ils comparent CC-PGD à des méthodes fédérées populaires, y compris la moyenne fédérée standard, une technique qui ajoute du bruit aléatoire pour la confidentialité, et une variante conçue pour des données inégalement réparties entre clients. Sur des tâches d’images simples et plus complexes, et avec des répartitions de données homogènes ou hétérogènes, CC-PGD maintient une précision proche de celle obtenue si toutes les données étaient centralisées. Dans le même temps, il réduit les mesures de fuite de confidentialité d’environ un quart à un tiers et abaisse le coût de communication d’environ un cinquième par rapport aux méthodes de référence.

Ce que cela signifie pour l’IA en santé du monde réel

Concrètement, ce travail montre que les hôpitaux n’ont pas à choisir strictement entre qualité de modèle, confidentialité et praticité lorsqu’ils entraînent ensemble une IA. En modélisant explicitement comment l’information pourrait fuir depuis un matériel supposément sécurisé, et en intégrant les coûts de confidentialité et de bande passante directement dans le processus d’entraînement, CC-PGD propose une voie rationnelle pour concevoir des systèmes collaboratifs plus sûrs. Bien que les expériences utilisent des images de référence plutôt que de véritables examens médicaux, le cadre est général et pourrait s’appliquer à des modèles plus larges, y compris des outils d’IA générative et des modèles de langage qui analysent des notes médicales ou des journaux de cybersécurité. Avec une validation supplémentaire sur des données hospitalières réelles, des approches comme celle-ci pourraient soutenir des réseaux d’IA dignes de confiance qui apprennent à partir de nombreux établissements tout en maintenant les données de chaque patient en sécurité sur place.

Citation: Xu, F., Wei, X., Zhao, Z. et al. Optimization of cross-institutional medical federated learning framework driven by confidential computing. Sci Rep 16, 14323 (2026). https://doi.org/10.1038/s41598-026-44843-4

Mots-clés: apprentissage fédéré, calcul confidentiel, IA médicale, entraînement préservant la vie privée, environnements d’exécution de confiance