Clear Sky Science · it

Ottimizzazione del framework di apprendimento federato medico inter-istituzionale guidato dal confidential computing

Perché è importante proteggere i dati medici condivisi

Gli ospedali moderni fanno sempre più affidamento sull’intelligenza artificiale per interpretare le scansioni, individuare le malattie precocemente e guidare le terapie. Tuttavia, gli algoritmi che possono salvare vite richiedono grandi quantità di dati dei pazienti, e la condivisione di tali dati tra istituzioni può entrare in conflitto con rigide norme sulla privacy e reali timori di attacchi informatici. Questo articolo esplora come gli ospedali possano collaborare per addestrare modelli di IA potenti senza aggregare i record grezzi dei pazienti e come difendersi da attacchi hardware sottili che possono fuoriuscire segreti anche quando i dati non lasciano mai l’ospedale.

Ospedali che collaborano senza condividere i record

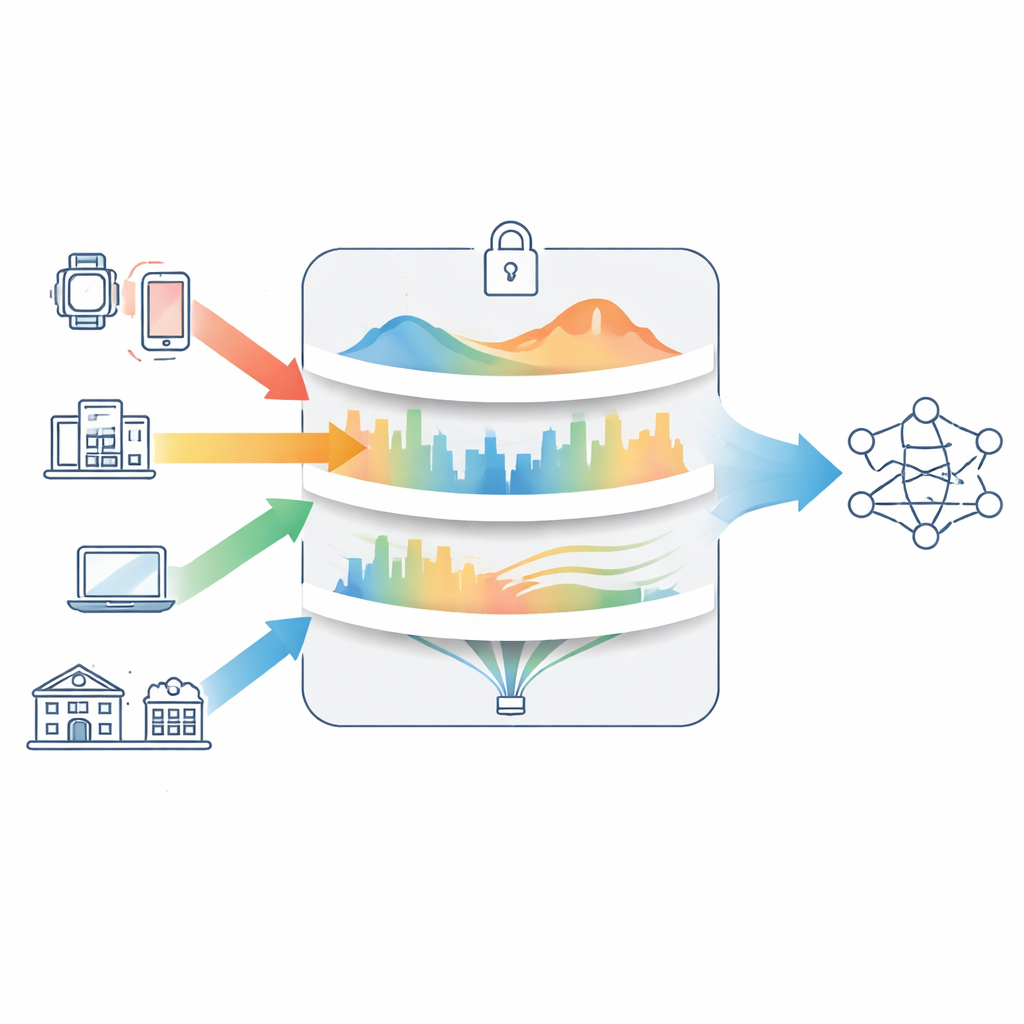

Lo studio si basa su una tecnica chiamata apprendimento federato, in cui ogni istituzione medica addestra la propria copia di un modello di IA sui dati locali dei pazienti. Invece di inviare immagini o cartelle cliniche a un server centrale, gli ospedali inviano solo aggiornamenti del modello, che il server aggrega in un modello condiviso e poi rimanda indietro. Dopo molte iterazioni, questo processo può produrre un sistema di IA che riflette conoscenze provenienti da molti ospedali, mentre ogni istituzione mantiene i dati grezzi dietro il proprio firewall. Questa configurazione è attraente per la sanità e la finanza, dove leggi ed etica rendono rischiosi o impossibili grandi bacini di dati centralizzati.

Perdite nascoste all’interno dell’hardware “sicuro”

Per rendere questa collaborazione più sicura, molti sistemi impiegano il confidential computing: aree hardware speciali chiamate ambienti di esecuzione affidabili che isolano i calcoli sensibili dal resto del computer. In teoria, questi enclavi proteggono l’addestramento del modello da insider curiosi o da sistemi operativi compromessi. In pratica, non sono perfetti. Gli attaccanti possono talvolta dedurre segreti osservando tempi d’esecuzione, uso della cache o altri effetti collaterali del calcolo. Gli approcci esistenti all’apprendimento federato raramente modellano esplicitamente queste perdite. Tendono inoltre a trattare privacy, accuratezza del modello e costo di rete come scelte di progettazione separate, anche se nelle implementazioni reali gli ospedali devono bilanciare tutte e tre contemporaneamente.

Bilanciare accuratezza, privacy e carico di rete

Gli autori propongono un nuovo metodo di addestramento chiamato Confidential Computing-Aware Projected Gradient Descent (CC-PGD). Piuttosto che concentrarsi solo sull’errore di predizione, CC-PGD ottimizza tre aspetti contemporaneamente: quanto bene il modello si adatta ai dati, quante informazioni potrebbero essere esposte attraverso canali laterali all’interno dell’hardware sicuro e quanta comunicazione è necessaria tra gli ospedali e il server centrale. Il rischio per la privacy è misurato usando la “forma” dei gradienti prodotti dal modello: se solo pochi parametri dominano, un attaccante potrebbe apprendere di più su pazienti specifici; se l’informazione è distribuita più uniformemente, si può inferire meno. Il metodo include anche un indicatore per quando le debolezze hardware note sono più probabilmente sfruttabili e un termine di costo che cattura quanto sono grandi gli aggiornamenti del modello e quanto tempo richiedono per essere trasmessi sulle reti.

Un modo guidato per regolare le impostazioni di sicurezza

Nel dettaglio, CC-PGD funziona come una versione attentamente vincolata della discesa del gradiente ordinaria, il metodo standard nell’addestramento moderno di IA. L’articolo dimostra che, anche con le penalità aggiuntive per privacy e comunicazione, il loro ottimizzatore converge ancora in modo affidabile sotto condizioni ampie. È importante che CC-PGD esponga due “manopole” regolabili che i progettisti di sistema possono modificare: una che rafforza la protezione della privacy e una che limita il sovraccarico di comunicazione. Aumentare o diminuire queste manopole consente agli operatori di decidere, per esempio, se favorire la massima accuratezza per uno studio di ricerca o una privacy più forte e una minore larghezza di banda per una clinica rurale con internet lento.

Cosa mostrano gli esperimenti

Per testare l’idea, gli autori simulano più istituzioni mediche che addestrano modelli di riconoscimento di immagini su dataset pubblici noti (MNIST e CIFAR-10). Confrontano CC-PGD con metodi federati popolari, inclusa la federated averaging standard, una tecnica che aggiunge rumore casuale per la privacy e una variante progettata per dati non equilibrati tra i client. Sia nei compiti di immagini semplici sia in quelli più complessi, e sia con dati divisi in modo uniforme sia non uniforme, CC-PGD mantiene l’accuratezza vicina a quella che si otterrebbe centralizzando tutti i dati. Allo stesso tempo, riduce le misure di fuga di informazioni di circa un quarto o un terzo e diminuisce il costo di comunicazione di circa un quinto rispetto ai baseline.

Cosa significa questo per l’IA sanitaria nel mondo reale

In termini semplici, questo lavoro dimostra che gli ospedali non devono scegliere rigidamente tra qualità del modello, privacy e praticità quando addestrano l’IA insieme. Modellando esplicitamente come l’informazione potrebbe fuoriuscire da hardware ritenuto sicuro e incorporando i costi di privacy e larghezza di banda direttamente nel processo di addestramento, CC-PGD offre un modo fondato per progettare sistemi collaborativi più sicuri. Sebbene gli esperimenti utilizzino immagini di benchmark piuttosto che vere scansioni, il framework è generale e potrebbe essere applicato a modelli più grandi, inclusi strumenti generativi di IA e modelli di linguaggio che analizzano note mediche o log di cybersecurity. Con ulteriori validazioni su dati reali di ospedali, approcci come questo potrebbero sostenere reti di IA affidabili che apprendono da molte istituzioni mantenendo però i dati di ogni paziente custoditi in sicurezza localmente.

Citazione: Xu, F., Wei, X., Zhao, Z. et al. Optimization of cross-institutional medical federated learning framework driven by confidential computing. Sci Rep 16, 14323 (2026). https://doi.org/10.1038/s41598-026-44843-4

Parole chiave: apprendimento federato, confidential computing, IA medica, addestramento che preserva la privacy, ambienti di esecuzione affidabili