Clear Sky Science · ar

تحسين إطار التعلم الفيدرالي الطبي عبر المؤسسات بدفع الحوسبة الموثوقة

لماذا حماية البيانات الطبية المشتركة مهمة

تعتمد المستشفيات الحديثة بشكل متزايد على الذكاء الاصطناعي لقراءة الفحوصات، واكتشاف الأمراض مبكرًا، وتوجيه العلاج. لكن الخوارزميات المنقذة للحياة تتطلب كميات هائلة من بيانات المرضى، ومشاركة تلك البيانات بين المؤسسات قد تتعارض مع قواعد الخصوصية الصارمة ومخاوف حقيقية من الهجمات الإلكترونية. تستكشف هذه الورقة كيف يمكن للمستشفيات التعاون لتدريب نماذج ذكاء اصطناعي قوية دون تجميع السجلات الخام للمرضى، وكيفية الحماية من هجمات أجهزة دقيقة قد تسرب أسرارًا حتى عندما لا تغادر البيانات المستشفى.

تعاون المستشفيات دون مشاركة السجلات

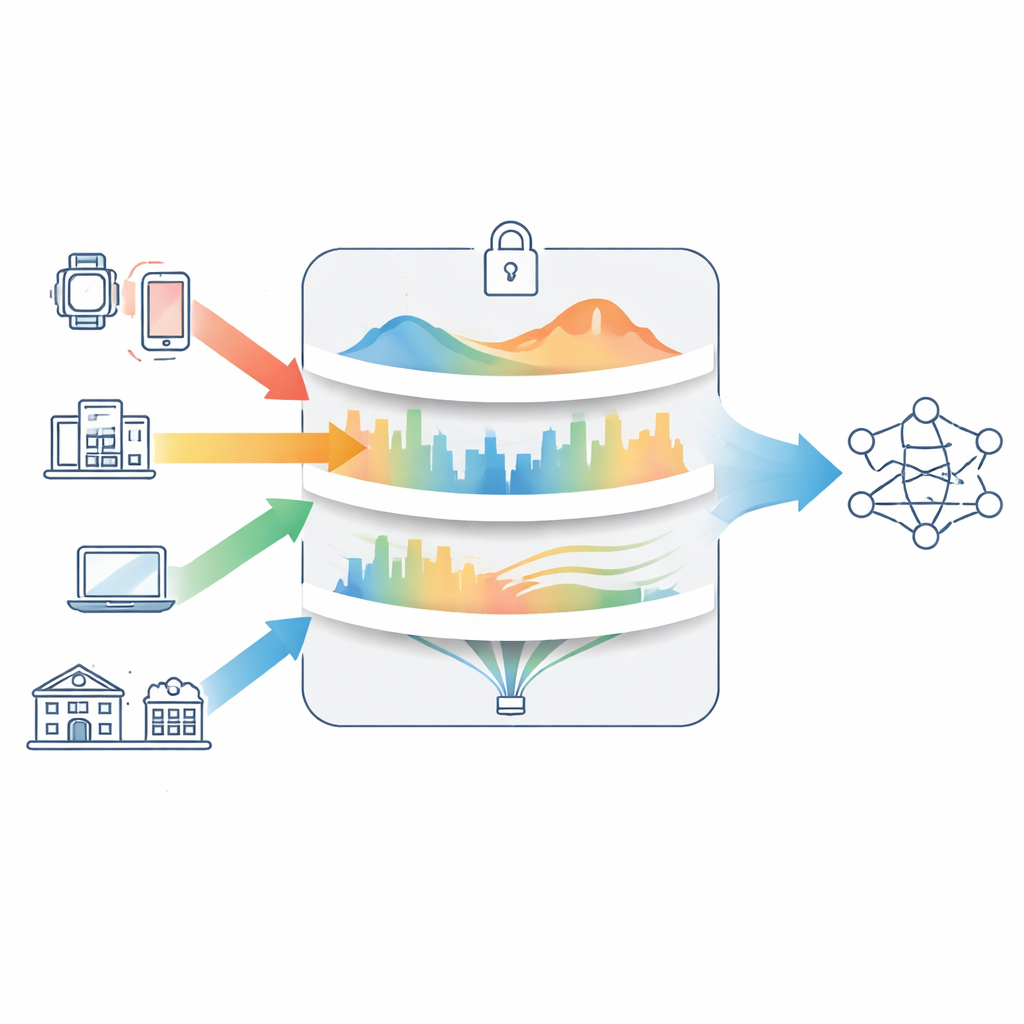

تبني الدراسة على تقنية تسمى التعلم الفيدرالي، حيث تدرب كل مؤسسة طبية نسخة محلية من نموذج الذكاء الاصطناعي على بيانات المرضى الموجودة لديها. بدلاً من إرسال الصور أو السجلات إلى خادم مركزي، ترسل المستشفيات تحديثات النموذج فقط، والتي يجمعها الخادم في نموذج مشترك واحد ثم يعيدها. عبر جولات عديدة، يمكن أن ينتج عن هذا العملية نظام ذكاء اصطناعي يعكس معرفة العديد من المستشفيات، بينما يحتفظ كل مركز بالبيانات الخام خلف جدار الحماية الخاص به. هذا الترتيبجذاب للرعاية الصحية والقطاع المالي، حيث تجعل القوانين والأخلاقيات تخزين قواعد بيانات مركزية ضخمة مخاطرة أو أمرًا مستحيلاً.

تسريبات خفية داخل الأجهزة «الآمنة»

لجعل هذا التعاون أكثر أمانًا، تستخدم العديد من الأنظمة الحوسبة الموثوقة: مناطق خاصة في العتاد تُسمى بيئات التنفيذ الموثوقة تعزل الحسابات الحساسة عن بقية الحاسوب. نظريًا، تحمي هذه الحاضنات تدريب النماذج من المطلعين المتطفلين أو أنظمة التشغيل المخترقة. عمليًا، هي ليست مثالية. يمكن للمهاجمين أحيانًا استدلال أسرار من خلال مراقبة التوقيت أو استخدام الذاكرة المخبئية أو آثار جانبية أخرى للحساب. نادرًا ما تُنمذج أساليب التعلم الفيدرالي الحالية هذه التسريبات صراحةً. كما تميل إلى التعامل مع الخصوصية ودقة النموذج وتكلفة الشبكة كخيارات تصميم منفصلة، رغم أن المستشفيات في التطبيق العملي يجب أن توفق بينها جميعًا في آن واحد.

موازنة الدقة والخصوصية وحمل الشبكة

يقترح المؤلفون طريقة تدريب جديدة تسمى هبوط التدرج المقيد الواعي بالحوسبة الموثوقة (CC-PGD). بدلاً من التركيز فقط على خطأ التنبؤ، يقوم CC-PGD بتحسين ثلاثة أمور في آن واحد: مدى ملاءمة النموذج للبيانات، ومقدار المعلومات التي قد تنكشف عبر القنوات الجانبية داخل العتاد الآمن، ومقدار الاتصال المطلوب بين المستشفيات والخادم المركزي. يُقاس خطر الخصوصية باستخدام «شكل» التدرجات التي ينتجها النموذج: إذا سيطر عدد قليل من المعاملات على التدرجات، قد يتعلم المهاجم مزيدًا عن مرضى محددين؛ وإذا انتشرت المعلومات بتوازن أكبر، يمكن استنتاج أقل. تتضمن الطريقة أيضًا مؤشرًا لمدى قابلية استغلال نقاط الضعف المعروفة في العتاد، ومصطلح تكلفة يعكس حجم تحديثات النموذج ومدة نقلها عبر الشبكات.

طريقة موجهة لضبط إعدادات الأمان

داخل الخوارزمية، يعمل CC-PGD كنسخة مقيدة بعناية من هبوط التدرج العادي، أداة العمل القياسية في تدريب الذكاء الاصطناعي الحديث. تثبت الورقة أنه حتى مع عقوبات الخصوصية والاتصال الإضافية، ما زال المحسّن يتقارب بشكل موثوق تحت شروط واسعة. والأهم أن CC-PGD يفتح «مُقَبِضَيْن» قابلين للتعديل يمكن لمصممي الأنظمة تغييرهما: أحدهما يعزز حماية الخصوصية والآخر يحد من حمل الاتصال. يتيح ضبط هذين المقبضين للمشغلين أن يقرروا، على سبيل المثال، ما إذا كانوا يفضلون أقصى دقة لدراسة بحثية أو خصوصية أقوى ونطاق ترددي أقل لعيادة ريفية ذات إنترنت بطيء.

ماذا أظهرت التجارب

لاختبار الفكرة، يحاكي المؤلفون عدة مؤسسات طبية تدرب نماذج تعرف على الصور على مجموعات بيانات عامة معروفة (MNIST وCIFAR-10). يقارنون CC-PGD مع طرق التعلم الفيدرالي الشائعة، بما في ذلك التوسيط الفيدرالي القياسي، وتقنية تضيف ضوضاء عشوائية للخصوصية، ونوع مصمم للبيانات غير المتوازنة عبر العملاء. عبر مهام الصور البسيطة والأكثر تعقيدًا، وتحت تقسيم بيانات متساوٍ وغير متساوٍ، يحافظ CC-PGD على دقة قريبة مما كان سيتم تحقيقه لو تمركزت كل البيانات. وفي الوقت نفسه، يقلل مقاييس تسرب الخصوصية بحوالي ربع إلى ثلث ويخفض تكلفة الاتصال بنحو خمس مقارنةً بالخطوط الأساسية.

ماذا يعني هذا لذكاء الرعاية الصحية في العالم الحقيقي

بعبارات بسيطة، يظهر هذا العمل أن على المستشفيات ليس عليها الاختيار حصريًا بين جودة النموذج والخصوصية والعملية عند تدريب الذكاء الاصطناعي معًا. من خلال نمذجة صريحة لكيفية تسرب المعلومات من عتاد يُفترض أنه آمن، وبإدماج تكاليف الخصوصية والنطاق الترددي داخل عملية التدريب نفسها، يقدم CC-PGD طريقة مبنية على مبادئ لتصميم أنظمة تعاونية أكثر أمانًا. وبينما تستخدم التجارب صورًا معيارية بدلًا من فحوصات طبية حقيقية، فإن الإطار عام ويمكن تطبيقه على نماذج أكبر، بما في ذلك أدوات الذكاء التوليدية ونماذج اللغة التي تحلل ملاحظات طبية أو سجلات الأمن السيبراني. مع مزيد من التحقق على بيانات مستشفيات حقيقية، قد تؤسس طرق مثل هذه لشبكات ذكاء اصطناعي موثوقة تتعلم من عدة مؤسسات مع إبقاء بيانات كل مريض محمية بأمان في مقرها.

الاستشهاد: Xu, F., Wei, X., Zhao, Z. et al. Optimization of cross-institutional medical federated learning framework driven by confidential computing. Sci Rep 16, 14323 (2026). https://doi.org/10.1038/s41598-026-44843-4

الكلمات المفتاحية: التعلم الفيدرالي, الحوسبة الموثوقة, الذكاء الاصطناعي الطبي, تدريب يحافظ على الخصوصية, بيئات التنفيذ الموثوقة