Clear Sky Science · tr

Gizli hesaplama ile desteklenen kurumlulararası tıbbi federasyon öğrenimi çerçevesinin optimizasyonu

Neden Paylaşılan Tıbbi Veriyi Koruma Önemli?

Modern hastaneler görüntüleri okumak, hastalığı daha erken tespit etmek ve tedaviyi yönlendirmek için giderek daha fazla yapay zekâya güveniyor. Oysa hayat kurtarıcı algoritmalar büyük miktarda hasta verisi gerektirir ve bu verilerin kurumlar arasında paylaşılması katı gizlilik kurallarıyla ve gerçek siber saldırı endişeleriyle çakışabilir. Bu makale, hastanelerin ham hasta kayıtlarını bir araya getirmeden güçlü yapay zekâ modelleri nasıl birlikte eğitebileceklerini ve veriler hastaneden hiç ayrılmasa bile sırlara sızdırabilecek ince donanım saldırılarına karşı nasıl korunabileceklerini inceliyor.

Kayıtları Paylaşmadan Birlikte Çalışan Hastaneler

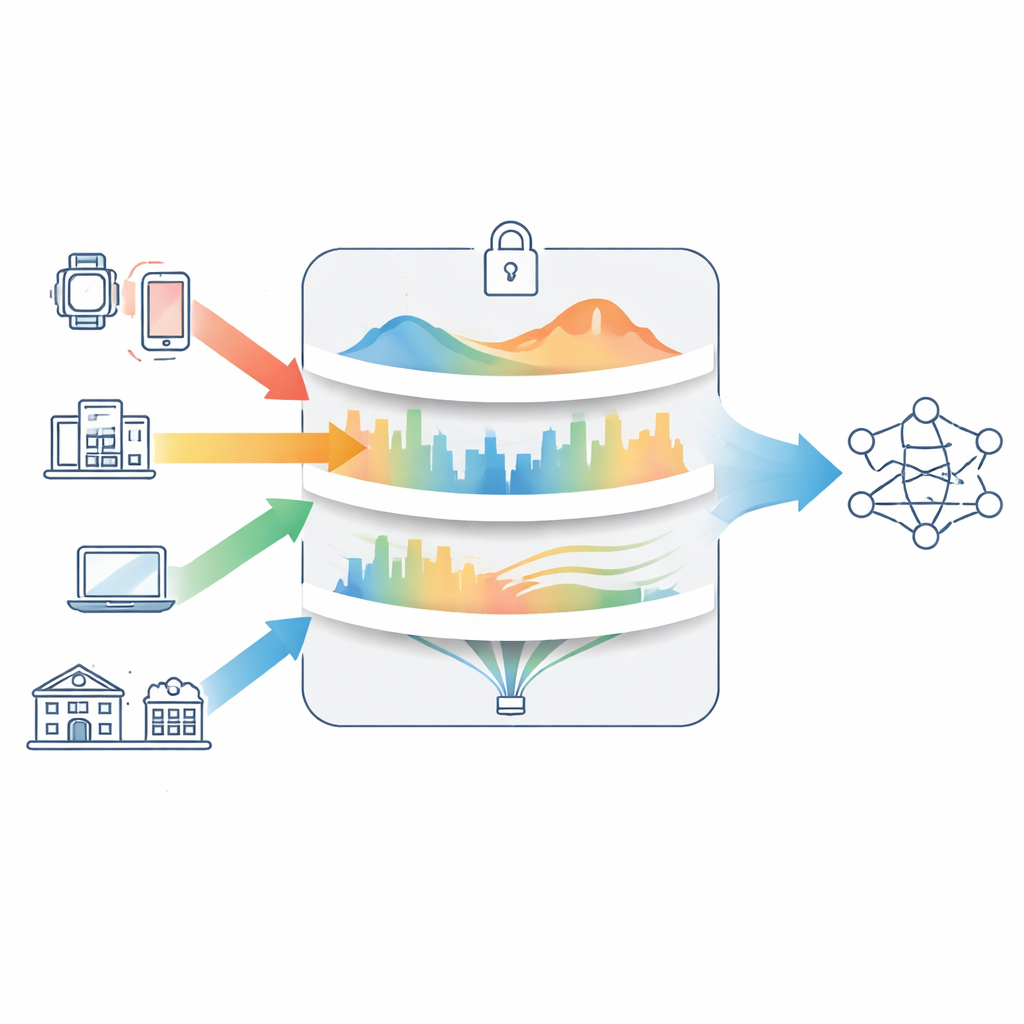

Çalışma, her tıbbi kurumun yerel hasta verisi üzerinde kendi yapay zekâ modelinin bir kopyasını eğittiği federated learning (federasyon öğrenimi) adlı bir tekniğe dayanıyor. Görüntüleri veya kayıtları merkezi bir sunucuya göndermek yerine hastaneler yalnızca model güncelleştirmelerini gönderir; sunucu bunları birleştirip tek bir paylaşılan modeli geri yollar. Çok sayıda tur boyunca bu süreç, her kurumun ham verisini kendi duvarlarının arkasında tutarken birçok hastanenin bilgisini yansıtan bir yapay zekâ sistemi üretebilir. Bu düzenleme, yasalar ve etik kurallar büyük merkezi veri gölleri kurmayı riskli veya imkânsız hale getirdiği sağlık ve finans sektörleri için caziptir.

“Güvenli” Donanım İçindeki Gizli Sızıntılar

Bu iş birliğini daha güvenli kılmak için birçok sistem gizli hesaplamayı kullanır: hassas hesaplamaları bilgisayarın geri kalanından izole eden güvenilir yürütme ortamları adı verilen özel donanım alanları. Teoride bu ortamlar model eğitimini meraklı içeriden kişilerden veya ele geçirilmiş işletim sistemlerinden korur. Ancak pratikte kusursuz değillerdir. Saldırganlar bazen zamanlama, önbellek kullanımı veya hesaplamanın diğer yan etkilerini izleyerek sırları çıkarabilir. Mevcut federated learning yöntemleri genellikle bu sızıntıları açıkça modellemez. Ayrıca gizlilik, model doğruluğu ve ağ maliyetini gerçek konuşlandırmalarda hastanelerin aynı anda yönetmek zorunda olduğu ayrı tasarım tercihleri olarak ele alma eğilimindedirler.

Doğruluk, Gizlilik ve Ağ Yükü Arasında Denge Kurmak

Yazarlar, Confidential Computing-Aware Projected Gradient Descent (CC-PGD) adını verdikleri yeni bir eğitim yöntemi öneriyor. Sadece tahmin hatasına odaklanmak yerine CC-PGD aynı anda üç şeyi optimize ediyor: modelin veriye ne kadar iyi uyduğu, güvenli donanım içindeki yan kanallar aracılığıyla ne kadar bilginin açığa çıkabileceği ve hastaneler ile merkezi sunucu arasındaki iletişim ihtiyacı. Gizlilik riski, modelin ürettiği gradyanların “şekli” kullanılarak ölçülüyor: yalnızca birkaç parametrenin baskın olması durumunda bir saldırgan belirli hastalar hakkında daha fazla bilgi öğrenebilir; bilgi daha yaygın dağıldığında ise daha azı çıkarılabilir. Yöntem ayrıca bilinen donanım zayıflıklarının ne zaman daha muhtemelen sömürülebilir olduğunu gösteren bir gösterge ve model güncelleştirmelerinin boyutunu ve ağ üzerinden iletilme sürelerini yakalayan bir maliyet terimini içeriyor.

Güvenlik Ayarlarını Yönlendiren Bir Yol

Altyapıda CC-PGD, modern yapay zekâ eğitiminin standart işi olan sıradan gradyan inişinin dikkatle kısıtlanmış bir versiyonu gibi çalışıyor. Makale, ek gizlilik ve iletişim cezalarına rağmen, optimize edicilerinin geniş koşullar altında hâlâ güvenilir şekilde yakınsadığını kanıtlıyor. Önemli olarak, CC-PGD sistem tasarımcılarının ayarlayabileceği iki ayarlanabilir “düğme” sunuyor: birisi gizlilik korumasını güçlendiriyor, diğeri iletişim yükünü sınırlıyor. Bu düğmeleri açıp kapamak, operatörlerin örneğin bir araştırma çalışması için maksimum doğruluğu mı yoksa yavaş interneti olan kırsal bir klinik için daha güçlü gizliliği ve daha düşük bant genişliğini mi tercih edeceklerine karar vermelerini sağlıyor.

Deneyler Ne Gösteriyor?

Fikri test etmek için yazarlar, birden çok tıbbi kurumun MNIST ve CIFAR-10 gibi bilinen açık veri setleri üzerinde görüntü tanıma modelleri eğittiği simülasyonlar yapıyor. CC-PGD’yi standart federated averaging, gizlilik için rastgele gürültü ekleyen bir teknik ve düzensiz istemci verileri için tasarlanmış bir varyant da dahil olmak üzere popüler federated learning yöntemleriyle karşılaştırıyorlar. Hem basit hem daha karmaşık görüntü görevlerinde ve hem eşit hem de düzensiz bölünmüş veriler altında, CC-PGD doğruluğu, tüm verilerin merkezileştirilmiş olması durumunda elde edilebilecek seviyeye yakın tutuyor. Aynı zamanda gizlilik sızıntısı ölçümlerini yaklaşık dörtte bir ila üçte bir oranında azaltıyor ve iletişim maliyetini karşılaştırılan yöntemlere göre yaklaşık beşte bir oranında düşürüyor.

Gerçek Dünyada Sağlık Yapay Zekâsı İçin Anlamı

Düz bir anlatımla, bu çalışma hastanelerin birlikte eğitim yaparken model kalitesi, gizlilik ve uygulanabilirlik arasında katı bir seçim yapmak zorunda olmadıklarını gösteriyor. Bilginin sözde güvenli donanımdan nasıl sızabileceğini açıkça modelleyerek ve gizlilik ile bant genişliği maliyetlerini eğitim sürecinin kendisine dahil ederek, CC-PGD daha güvenli iş birliği sistemleri tasarlamak için ilkeli bir yol sunuyor. Deneyler gerçek taramalar yerine kıyaslama görüntüleri kullansa da çerçeve geneldir ve tıbbi notları veya siber güvenlik günlüklerini analiz eden üretken yapay zekâ araçları ve dil modelleri de dahil olmak üzere daha büyük modellere uygulanabilir. Gerçek hastane verileri üzerinde daha fazla doğrulamayla, bu tür yaklaşımlar birçok kurumdan öğrenen ve her hastanın verisini güvenle kendi yerinde tutan güvenilir yapay zekâ ağlarının temelini oluşturabilir.

Atıf: Xu, F., Wei, X., Zhao, Z. et al. Optimization of cross-institutional medical federated learning framework driven by confidential computing. Sci Rep 16, 14323 (2026). https://doi.org/10.1038/s41598-026-44843-4

Anahtar kelimeler: federated learning, gizli hesaplama, tıbbi yapay zeka, gizliliği koruyan eğitim, güvenilir yürütme ortamları