Clear Sky Science · es

Optimización de un marco de aprendizaje federado médico interinstitucional impulsado por computación confidencial

Por qué importa proteger los datos médicos compartidos

Los hospitales modernos dependen cada vez más de la inteligencia artificial para interpretar exploraciones, detectar enfermedades antes y orientar los tratamientos. Sin embargo, los algoritmos que salvan vidas requieren grandes cantidades de datos de pacientes, y compartir esos datos entre instituciones puede chocar con normas de privacidad estrictas y con preocupaciones reales sobre ataques informáticos. Este artículo explora cómo los hospitales pueden colaborar para entrenar modelos de IA potentes sin centralizar los registros de pacientes y cómo defenderse frente a ataques sutiles al hardware que pueden filtrar secretos incluso cuando los datos nunca salen del hospital.

Hospitals que colaboran sin compartir registros

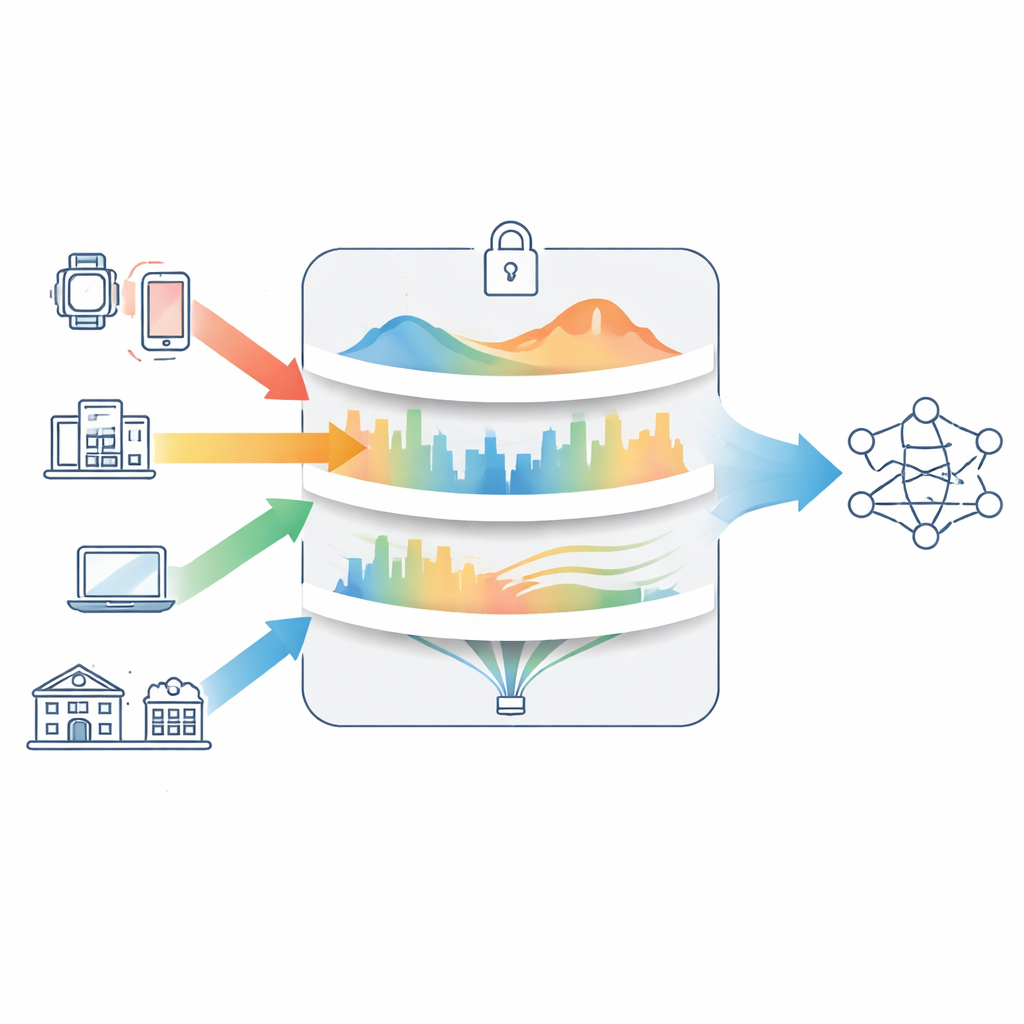

El estudio se basa en una técnica llamada aprendizaje federado, en la que cada institución médica entrena su propia copia de un modelo de IA con datos locales de pacientes. En lugar de enviar imágenes o historiales a un servidor central, los hospitales envían únicamente actualizaciones del modelo, que el servidor combina en un modelo compartido y devuelve. Tras muchas rondas, este proceso puede producir un sistema de IA que integra conocimiento de muchos hospitales, mientras cada institución mantiene los datos sin procesar detrás de su propio cortafuegos. Esta configuración resulta atractiva en sanidad y finanzas, donde las leyes y la ética hacen que grandes depósitos de datos centralizados sean arriesgados o inviables.

Filtraciones ocultas dentro del hardware “seguro”

Para aumentar la seguridad de esta colaboración, muchos sistemas recurren a la computación confidencial: zonas especiales de hardware llamadas entornos de ejecución confiables que aíslan los cálculos sensibles del resto del equipo. En teoría, estos enclaves protegen el entrenamiento del modelo frente a empleados curiosos o sistemas operativos comprometidos. En la práctica no son perfectos. Los atacantes a veces pueden inferir secretos observando tiempos, uso de caché u otros efectos secundarios de la computación. Los métodos de aprendizaje federado existentes rara vez modelan explícitamente estas fugas. Además, tienden a tratar la privacidad, la precisión del modelo y el coste de la red como decisiones de diseño separadas, aunque en despliegues reales los hospitales deben equilibrar las tres a la vez.

Equilibrando precisión, privacidad y carga de red

Los autores proponen un nuevo método de entrenamiento llamado Descenso de Gradiente Proyectado Consciente de la Computación Confidencial (CC-PGD). En lugar de centrarse solo en el error de predicción, CC-PGD optimiza tres aspectos simultáneamente: qué tan bien el modelo ajusta los datos, cuánta información podría exponerse por canales laterales dentro del hardware seguro y cuánta comunicación se requiere entre los hospitales y el servidor central. El riesgo de privacidad se mide usando la “forma” de los gradientes que produce el modelo: si pocos parámetros dominan, un atacante podría aprender más sobre pacientes concretos; si la información está distribuida de forma más uniforme, se puede inferir menos. El método también incorpora un indicador de cuándo las debilidades conocidas del hardware son más explotables y un término de coste que captura el tamaño de las actualizaciones del modelo y el tiempo que tardan en transmitirse por la red.

Una forma guiada de ajustar las configuraciones de seguridad

En el fondo, CC-PGD funciona como una versión cuidadosamente limitada del descenso de gradiente ordinario, la herramienta estándar del entrenamiento moderno de IA. El artículo demuestra que, incluso con las penalizaciones adicionales por privacidad y comunicación, su optimizador converge de forma fiable bajo condiciones amplias. Es importante que CC-PGD exponga dos “perillas” ajustables que los diseñadores del sistema pueden girar: una que refuerza la protección de la privacidad y otra que limita la sobrecarga de comunicación. Ajustar estas perillas hacia arriba o hacia abajo permite a los operadores decidir, por ejemplo, si favorecer la máxima precisión para un estudio de investigación o una mayor privacidad y menor ancho de banda para una clínica rural con internet lento.

Qué muestran los experimentos

Para probar la idea, los autores simulan varias instituciones médicas entrenando modelos de reconocimiento de imágenes con conjuntos de datos públicos bien conocidos (MNIST y CIFAR-10). Comparan CC-PGD con métodos populares de aprendizaje federado, incluido el promedio federado estándar, una técnica que añade ruido aleatorio para privacidad y una variante diseñada para datos desigualmente distribuidos entre clientes. Tanto en tareas de imágenes sencillas como más complejas, y con datos repartidos de forma uniforme o desigual, CC-PGD mantiene la precisión cerca de lo que se lograría si todos los datos estuvieran centralizados. Al mismo tiempo, reduce las medidas de filtración de privacidad en aproximadamente una cuarta a una tercera parte y disminuye el coste de comunicación en torno a una quinta parte en comparación con las líneas base.

Qué significa esto para la IA sanitaria en el mundo real

En términos sencillos, este trabajo muestra que los hospitales no tienen por qué elegir estrictamente entre calidad del modelo, privacidad y practicidad al entrenar IA de forma conjunta. Al modelar explícitamente cómo podría filtrarse la información desde hardware supuestamente seguro y al incorporar los costes de privacidad y ancho de banda en el propio proceso de entrenamiento, CC-PGD ofrece una manera fundamentada de diseñar sistemas colaborativos más seguros. Aunque los experimentos usan imágenes de referencia en lugar de exploraciones reales, el marco es general y podría aplicarse a modelos más grandes, incluidas herramientas generativas de IA y modelos de lenguaje que analicen notas médicas o registros de ciberseguridad. Con mayor validación en datos hospitalarios reales, enfoques como este podrían sustentar redes de IA de confianza que aprendan de muchas instituciones manteniendo los datos de cada paciente seguros en su lugar.

Cita: Xu, F., Wei, X., Zhao, Z. et al. Optimization of cross-institutional medical federated learning framework driven by confidential computing. Sci Rep 16, 14323 (2026). https://doi.org/10.1038/s41598-026-44843-4

Palabras clave: aprendizaje federado, computación confidencial, IA médica, entrenamiento que preserva la privacidad, entornos de ejecución confiables