Clear Sky Science · ja

機密計算に駆動される機関間医療フェデレーテッド学習フレームワークの最適化

共有される医療データの保護が重要な理由

現代の病院はスキャン読み取り、早期疾患検出、治療指針の提示などにますます人工知能を頼っています。しかし、命を救うアルゴリズムには大量の患者データが必要であり、機関間でのデータ共有は厳しいプライバシー規制やハッキングへの懸念と衝突することがあります。本論文は、病院が生の患者記録を集約することなく協調して強力なAIモデルを訓練する方法と、データが病院外に出ない場合でも秘密が漏れる可能性のある微妙なハードウェア攻撃に対処する方法を探ります。

記録を共有せずに協力する病院群

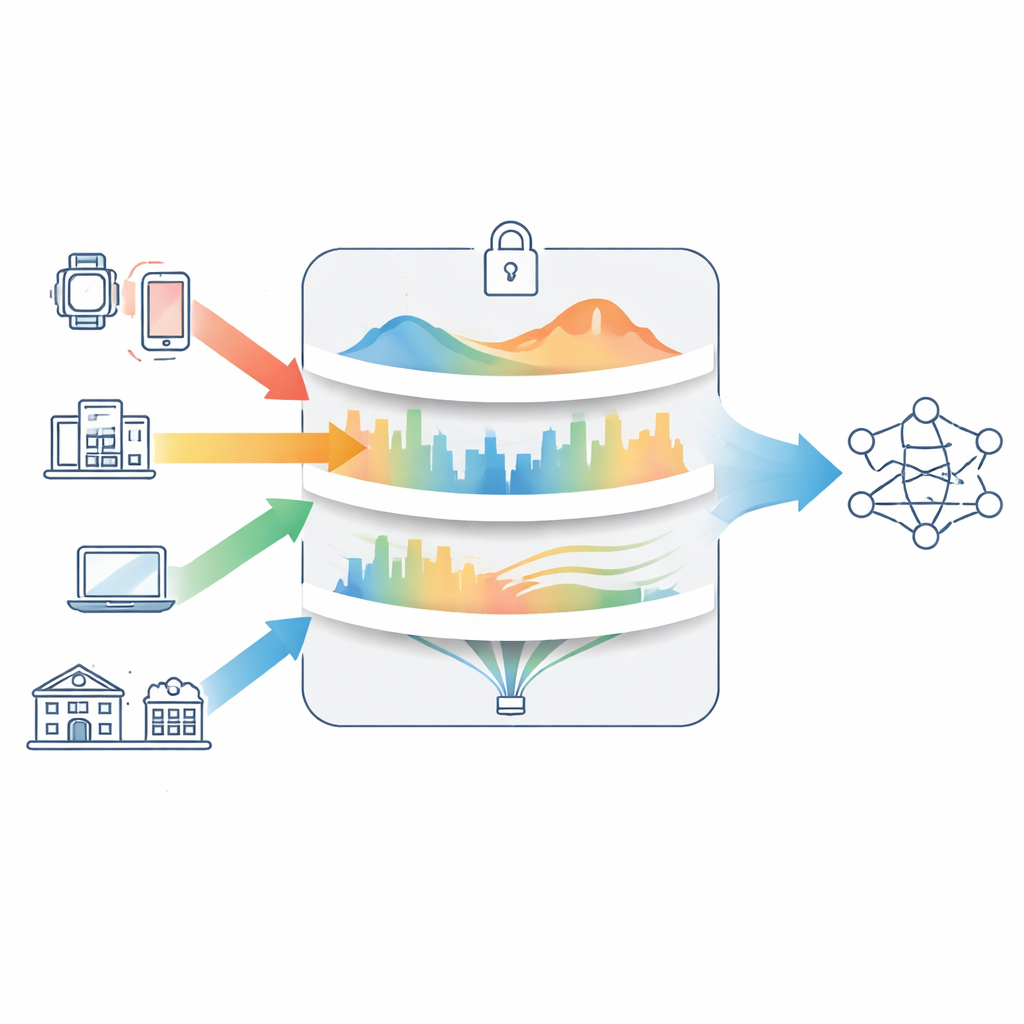

本研究はフェデレーテッドラーニングという手法を中心に構成されています。各医療機関が自施設の患者データでAIモデルのコピーを局所的に学習し、画像や記録そのものを中央サーバに送る代わりにモデル更新のみを送信します。サーバはそれらを統合して共有モデルを生成し、各参加機関に返します。複数ラウンドの繰り返しにより、多くの病院の知見を反映するAIシステムが得られ、各機関は生データを自分のファイアウォール内に保持できます。この仕組みは、法規制や倫理面で大規模な中央データレイクが困難な医療や金融分野にとって魅力的です。

「安全」ハードウェアの内部に潜む情報漏えい

この協調をより安全にするため、多くのシステムは機密計算を利用します。これは機密計算を行うために設計された信頼できる実行環境(TEE)と呼ばれるハードウェア領域で、機密処理を他のシステムから分離します。理論上はこれらのエンクレーブがモデル学習を内部の好奇心旺盛な関係者や侵害されたOSから守りますが、実際には完全ではありません。攻撃者は実行時間、キャッシュ使用、その他の副次的な計測から秘密を推測することがあります。既存のフェデレーテッド学習手法はこうした副チャネル漏えいを明示的にモデル化することが稀であり、プライバシー、モデル精度、ネットワークコストを個別の設計選択として扱いがちですが、実運用では病院はこれら三者を同時に調整しなければなりません。

精度、プライバシー、通信負荷のバランス

著者らはCC-PGD(Confidential Computing-Aware Projected Gradient Descent)と呼ぶ新しい訓練手法を提案します。単に予測誤差に注目するのではなく、CC-PGDは同時に三点を最適化します:モデルがデータにどれだけ適合するか、保護されたハードウェア内部の副チャネルを通じてどれだけ情報が露出しうるか、そして病院と中央サーバ間の通信にどれだけコストがかかるかです。プライバシーリスクはモデルが生成する勾配の「形状」で測られます。少数のパラメータが支配的であれば攻撃者は特定の患者について学びやすく、情報がより均等に分散していれば推測されにくくなります。本手法には既知のハードウェア脆弱性が悪用されやすい状況を示す指標や、モデル更新の大きさとネットワーク送信に要する時間を捉えるコスト項も含まれます。

安全設定を導くためのガイド

内部的には、CC-PGDは通常の勾配降下法を慎重に制約した形で動作します。論文は、追加のプライバシーおよび通信ペナルティがあっても、彼らの最適化手法が広い条件下で依然として収束することを示しています。重要なのは、CC-PGDが設計者が調整できる二つの“ノブ”を明示する点です:一つはプライバシー保護を強化するもの、もう一つは通信オーバーヘッドを制限するものです。これらを調整することで、研究用の最大精度を優先するのか、通信帯域が乏しい農村診療所でプライバシーと低帯域を優先するのかといった運用上の判断が可能になります。

実験が示すもの

アイデアを検証するため、著者らは複数の医療機関が既知の公開データセット(MNISTとCIFAR-10)上で画像認識モデルを学習するシミュレーションを行いました。CC-PGDを標準的なフェデレーテッド平均、プライバシーのためにランダムノイズを加える手法、クライアント間でデータ不均衡に対応した変種と比較しています。単純な画像課題からより複雑な課題まで、均等分配および不均等分配の両条件で、CC-PGDは集中化された全データ利用とほぼ同等の精度を維持します。同時に、プライバシー漏えい指標を概ね25%から33%減少させ、通信コストをベースラインと比べ約20%削減しています。

現実の医療AIにとっての意味合い

平たく言えば、この研究は病院が共同でAIを訓練する際に、モデル品質、プライバシー、実用性の間で一方を厳密に選ばなければならないわけではないことを示しています。想定された安全なハードウェアから情報が漏れる可能性を明示的にモデル化し、プライバシーと帯域幅コストを訓練過程に組み込むことで、CC-PGDはより安全な協調システムを設計するための理にかなった手段を提供します。実験は実際の医療画像ではなくベンチマーク画像を用いているものの、このフレームワークは一般的であり、医療ノートやサイバーセキュリティログを解析する生成系AIや言語モデルなどより大きなモデルにも適用可能です。実病院データでの追加検証が進めば、このようなアプローチは多くの機関から学習しつつ各患者のデータを安全に保つ信頼できるAIネットワークの基盤になり得ます。

引用: Xu, F., Wei, X., Zhao, Z. et al. Optimization of cross-institutional medical federated learning framework driven by confidential computing. Sci Rep 16, 14323 (2026). https://doi.org/10.1038/s41598-026-44843-4

キーワード: フェデレーテッドラーニング, 機密計算, 医療AI, プライバシー保護学習, 信頼できる実行環境