Clear Sky Science · pt

Otimização de um framework de aprendizado federado médico entre instituições impulsionado por computação confidencial

Por que proteger dados médicos compartilhados é importante

Hospitais modernos dependem cada vez mais de inteligência artificial para interpretar exames, detectar doenças mais cedo e orientar tratamentos. Ainda assim, algoritmos que salvam vidas exigem grandes quantidades de dados de pacientes, e compartilhar esses dados entre instituições pode conflitar com regras rigorosas de privacidade e preocupações reais com ataques cibernéticos. Este artigo explora como hospitais podem colaborar para treinar modelos de IA poderosos sem agregar registros brutos de pacientes, e como proteger contra ataques sutis ao hardware que podem vazar segredos mesmo quando os dados nunca deixam a instituição.

Hospitais colaborando sem compartilhar registros

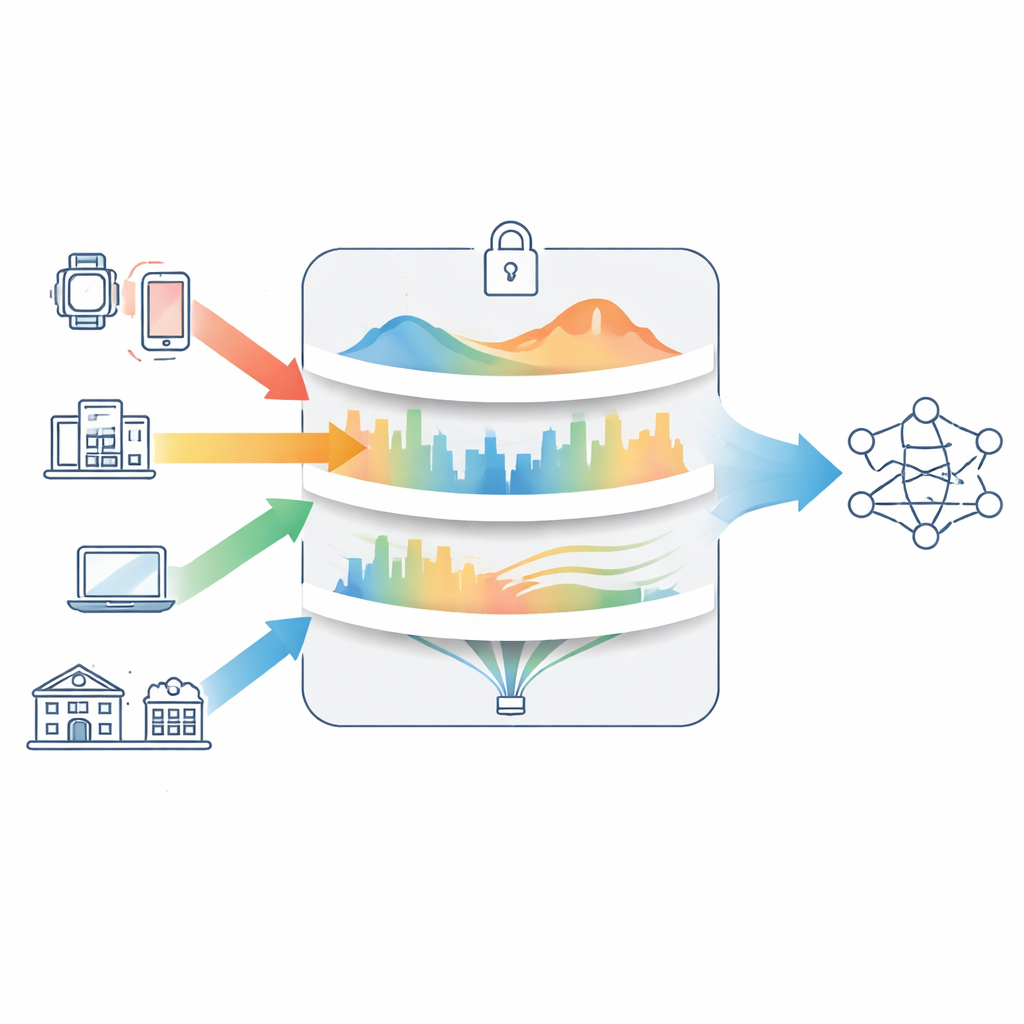

O estudo se baseia em uma técnica chamada aprendizado federado, em que cada instituição médica treina sua própria cópia de um modelo de IA em dados locais de pacientes. Em vez de enviar imagens ou prontuários a um servidor central, os hospitais transmitem apenas atualizações do modelo, que o servidor combina em um modelo compartilhado único e devolve. Ao longo de várias rodadas, esse processo pode produzir um sistema de IA que incorpora conhecimento de muitos hospitais, enquanto cada instituição mantém os dados brutos atrás de seu próprio firewall. Essa configuração é atrativa para saúde e finanças, onde leis e ética tornam lagos de dados centralizados arriscados ou inviáveis.

Vazamentos ocultos dentro de hardware “seguro”

Para tornar essa colaboração mais segura, muitos sistemas usam computação confidencial: áreas especiais de hardware chamadas ambientes de execução confiáveis que isolam cálculos sensíveis do resto do computador. Na teoria, esses enclaves protegem o treinamento do modelo contra funcionários curiosos ou sistemas operacionais comprometidos. Na prática, eles não são perfeitos. Atacantes às vezes podem inferir segredos observando tempos de execução, uso de cache ou outros efeitos colaterais da computação. Métodos existentes de aprendizado federado raramente modelam esses vazamentos explicitamente. Eles também tendem a tratar privacidade, precisão do modelo e custo de rede como escolhas de projeto separadas, embora em implantações reais os hospitais precisem conciliar os três simultaneamente.

Equilibrando precisão, privacidade e carga de rede

Os autores propõem um novo método de treinamento chamado Gradiente Projetado Sensível à Computação Confidencial (CC-PGD, na sigla em inglês). Em vez de focar apenas no erro de predição, o CC-PGD otimiza três aspectos ao mesmo tempo: quão bem o modelo se ajusta aos dados, quanta informação poderia ser exposta por canais laterais dentro do hardware seguro e quanto de comunicação é necessária entre hospitais e o servidor central. O risco de privacidade é medido usando a “forma” dos gradientes que o modelo produz: se apenas alguns parâmetros dominam, um atacante pode aprender mais sobre pacientes específicos; se a informação estiver distribuída de forma mais uniforme, menos pode ser inferido. O método inclui também um indicador de quando fraquezas conhecidas do hardware são mais suscetíveis de serem exploradas, além de um termo de custo que captura o tamanho das atualizações do modelo e quanto tempo levam para serem transmitidas pelas redes.

Uma forma guiada de ajustar configurações de segurança

Na prática, o CC-PGD funciona como uma versão cuidadosamente restringida do gradiente descendente ordinário, o procedimento padrão do treinamento de IA moderno. O artigo demonstra que, mesmo com as penalidades adicionais de privacidade e comunicação, o otimizador ainda converge de forma confiável sob condições amplas. Importante, o CC-PGD oferece dois “botões” ajustáveis que os projetistas de sistemas podem girar: um que fortalece a proteção de privacidade e outro que limita a sobrecarga de comunicação. Ajustar esses botões permite aos operadores decidir, por exemplo, se favorecem máxima precisão para um estudo de pesquisa ou maior privacidade e menor consumo de banda para uma clínica rural com internet lenta.

O que os experimentos mostram

Para testar a ideia, os autores simulam múltiplas instituições médicas treinando modelos de reconhecimento de imagens em conjuntos de dados públicos bem conhecidos (MNIST e CIFAR-10). Eles comparam o CC-PGD com métodos populares de aprendizado federado, incluindo a média federada padrão, uma técnica que adiciona ruído aleatório para privacidade e uma variante projetada para dados desiguais entre clientes. Em tarefas de imagem tanto simples quanto mais complexas, e sob divisionamentos de dados uniformes e desiguais, o CC-PGD mantém a precisão próxima do que seria alcançada se todos os dados fossem centralizados. Ao mesmo tempo, reduz medidas de vazamento de privacidade em cerca de um quarto a um terço e diminui o custo de comunicação em aproximadamente um quinto em comparação com as linhas de base.

O que isso significa para IA em saúde no mundo real

Em termos práticos, este trabalho mostra que hospitais não precisam escolher estritamente entre qualidade do modelo, privacidade e viabilidade ao treinar IA em conjunto. Ao modelar explicitamente como a informação pode vazar de hardware supostamente seguro, e ao incorporar custos de privacidade e largura de banda diretamente no processo de treinamento, o CC-PGD oferece uma forma fundamentada de projetar sistemas colaborativos mais seguros. Embora os experimentos usem imagens de referência em vez de exames reais, o framework é geral e pode ser aplicado a modelos maiores, incluindo ferramentas generativas de IA e modelos de linguagem que analisam notas médicas ou logs de segurança. Com validação adicional em dados reais de hospitais, abordagens como esta podem sustentar redes de IA confiáveis que aprendem a partir de muitas instituições mantendo os dados de cada paciente protegidos em sua origem.

Citação: Xu, F., Wei, X., Zhao, Z. et al. Optimization of cross-institutional medical federated learning framework driven by confidential computing. Sci Rep 16, 14323 (2026). https://doi.org/10.1038/s41598-026-44843-4

Palavras-chave: aprendizado federado, computação confidencial, IA médica, treinamento preservador de privacidade, ambientes de execução confiáveis