Clear Sky Science · sv

Optimering av tvärinstitutionellt federerat lärande för medicin drivs av konfidentiell beräkning

Varför det är viktigt att skydda delade medicinska data

Moderna sjukhus förlitar sig i allt större utsträckning på artificiell intelligens för att läsa avbildningar, upptäcka sjukdomar tidigare och vägleda behandlingar. Livräddande algoritmer behöver dock stora mängder patientdata, och att dela dessa uppgifter mellan institutioner kan kollidera med strikta sekretessregler och verkliga farhågor om intrång. Denna artikel undersöker hur sjukhus kan samarbeta för att träna kraftfulla AI-modeller utan att samla råa patientregister på en central plats, och hur man kan skydda mot subtila hårdvaruattacker som kan läcka hemligheter även när data aldrig lämnar sjukhuset.

Sjukhus som samarbetar utan att dela journaler

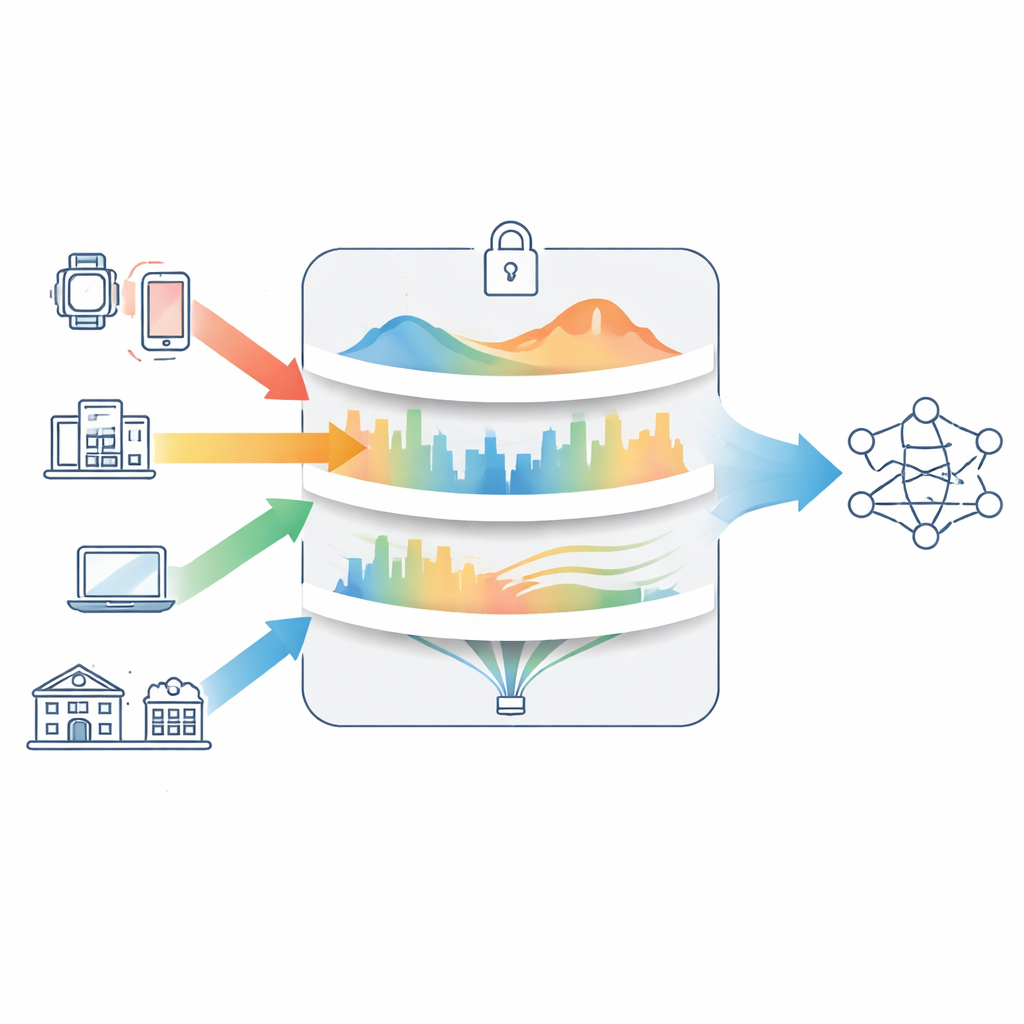

Studien bygger på en teknik kallad federerat lärande, där varje medicinsk institution tränar en egen kopia av en AI-modell på lokal patientdata. I stället för att skicka bilder eller journaler till en central server skickar sjukhusen bara modelluppdateringar, som servern slår samman till en gemensam modell och sedan skickar tillbaka. Över många rundor kan denna process producera ett AI-system som fångar kunskap från många sjukhus, samtidigt som varje institution behåller rådata bakom sin egen brandvägg. Denna lösning är attraktiv för vård och finans, där lagar och etik gör stora centrala datalager riskfyllda eller omöjliga.

Dolda läckor i "säkra" hårdvaruområden

För att göra detta samarbete säkrare använder många system konfidentiell beräkning: speciella hårdvaruområden kallade pålitliga exekveringsmiljöer som isolerar känsliga beräkningar från resten av datorn. I teorin skyddar dessa enclaves modellträning från nyfikna insiderhot eller komprometterade operativsystem. I praktiken är de inte perfekta. Angripare kan ibland sluta sig till hemligheter genom att observera tidsmätningar, cache-användning eller andra sidoeffekter av beräkningen. Befintliga metoder för federerat lärande modellerar sällan dessa läckor explicit. De tenderar också att behandla integritet, modellens noggrannhet och nätverkskostnad som separata designval, trots att sjukhus i verkliga implementationer måste balansera alla tre samtidigt.

Att balansera noggrannhet, integritet och nätverksbelastning

Författarna föreslår en ny träningsmetod kallad Confidential Computing-Aware Projected Gradient Descent (CC-PGD). I stället för att fokusera enbart på prediktionsfel optimerar CC-PGD tre saker samtidigt: hur väl modellen passar datan, hur mycket information som kan exponeras via sido-kanaler inne i säker hårdvara, och hur mycket kommunikation som krävs mellan sjukhusen och den centrala servern. Integritetsrisken mäts med hjälp av "formen" på gradienterna modellen producerar: om bara några få parametrar dominerar kan en angripare lära sig mer om specifika patienter; om informationen är mer jämnt fördelad kan mindre utläsas. Metoden inkluderar också en indikator för när kända hårdvarusvagheter är mer sannolika att utnyttjas, samt en kostnadsterm som fångar hur stora modelluppdateringarna är och hur lång tid de tar att överföra över nätverk.

En vägledd metod för att ställa in säkerhetsinställningar

Under ytan fungerar CC-PGD som en noggrant begränsad version av vanlig gradientnedstigning, den standardmetod som används vid modern AI-träning. Artikeln bevisar att även med de extra straffen för integritet och kommunikation konvergerar deras optimerare fortfarande pålitligt under vida förhållanden. Viktigt är att CC-PGD exponerar två justerbara "vred" som systemdesigners kan vrida på: ett som stärker integritetsskyddet och ett som begränsar kommunikationsöverhuvud. Att vrida dessa vred upp eller ner låter operatörer välja, till exempel, om man ska prioritera maximal noggrannhet för en forskningsstudie eller starkare integritet och lägre bandbredd för en landsbygdsklinik med långsamt internet.

Vad experimenten visar

För att testa idén simulerar författarna flera medicinska institutioner som tränar bildigenkänningsmodeller på välkända offentliga dataset (MNIST och CIFAR-10). De jämför CC-PGD med populära metoder för federerat lärande, inklusive standard federated averaging, en teknik som lägger till slumpmässigt brus för integritet, och en variant utformad för ojämn datafördelning mellan klienter. Både för enkla och mer komplexa bilduppgifter, och vid både jämnt och ojämnt uppdelad data, håller CC-PGD noggrannheten nära vad som uppnås om all data centraliserades. Samtidigt minskar det mått på integritetsläckage med ungefär en fjärdedel till en tredjedel och reducerar kommunikationskostnaden med cirka en femtedel jämfört med baslinjerna.

Vad detta innebär för verklig sjukvårds-AI

Med enkla ord visar detta arbete att sjukhus inte behöver välja strikt mellan modellkvalitet, integritet och praktisk användbarhet när de tränar AI tillsammans. Genom att explicit modellera hur information kan läcka från till synes säker hårdvara, och genom att bygga in integritets- och bandbreddskostnader i själva träningsprocessen, erbjuder CC-PGD ett principfast sätt att utforma säkrare kollaborativa system. Även om experimenten använder benchmark-bilder snarare än verkliga skanningar är ramverket generellt och kan tillämpas på större modeller, inklusive generativa AI-verktyg och språkmodeller som analyserar medicinska anteckningar eller cybersäkerhetsloggar. Med vidare validering på verkliga sjukhusdata skulle tillvägagångssätt som detta kunna ligga till grund för pålitliga AI-nätverk som lär av många institutioner samtidigt som varje patients data hålls säkert kvar hemma.

Citering: Xu, F., Wei, X., Zhao, Z. et al. Optimization of cross-institutional medical federated learning framework driven by confidential computing. Sci Rep 16, 14323 (2026). https://doi.org/10.1038/s41598-026-44843-4

Nyckelord: federerat lärande, konfidentiell beräkning, medicinsk AI, integritetsbevarande träning, pålitliga exekveringsmiljöer