Clear Sky Science · he

אופטימיזציה של מסגרת למידת פדרציה בין-מוסדית בתחום הרפואה מונעת על ידי מחשוב סודי

מדוע חשוב להגן על נתונים רפואיים משותפים

בתי חולים מודרניים נשענים יותר ויותר על בינה מלאכותית לקריאת סריקות, גילוי מחלות מוקדם יותר והנחיית טיפול. יחד עם זאת, אלגוריתמים שיכולים להציל חיים דורשים כמויות עצומות של נתוני מטופלים, ושיתוף נתונים בין מוסדות עלול להתנגש עם תקנות פרטיות מחמירות ודאגות ממשיות מפני פריצות. מאמר זה בוחן כיצד בתי חולים יכולים לשתף פעולה לאימון מודלים חזקים בלי לאחד את רשומות המטופלים הגולמיות, ואיך להגן מפני מתקפות חומרה עדינות שיכולות לדלוף סודות גם כאשר הנתונים לעולם לא עוזבים את המוסד.

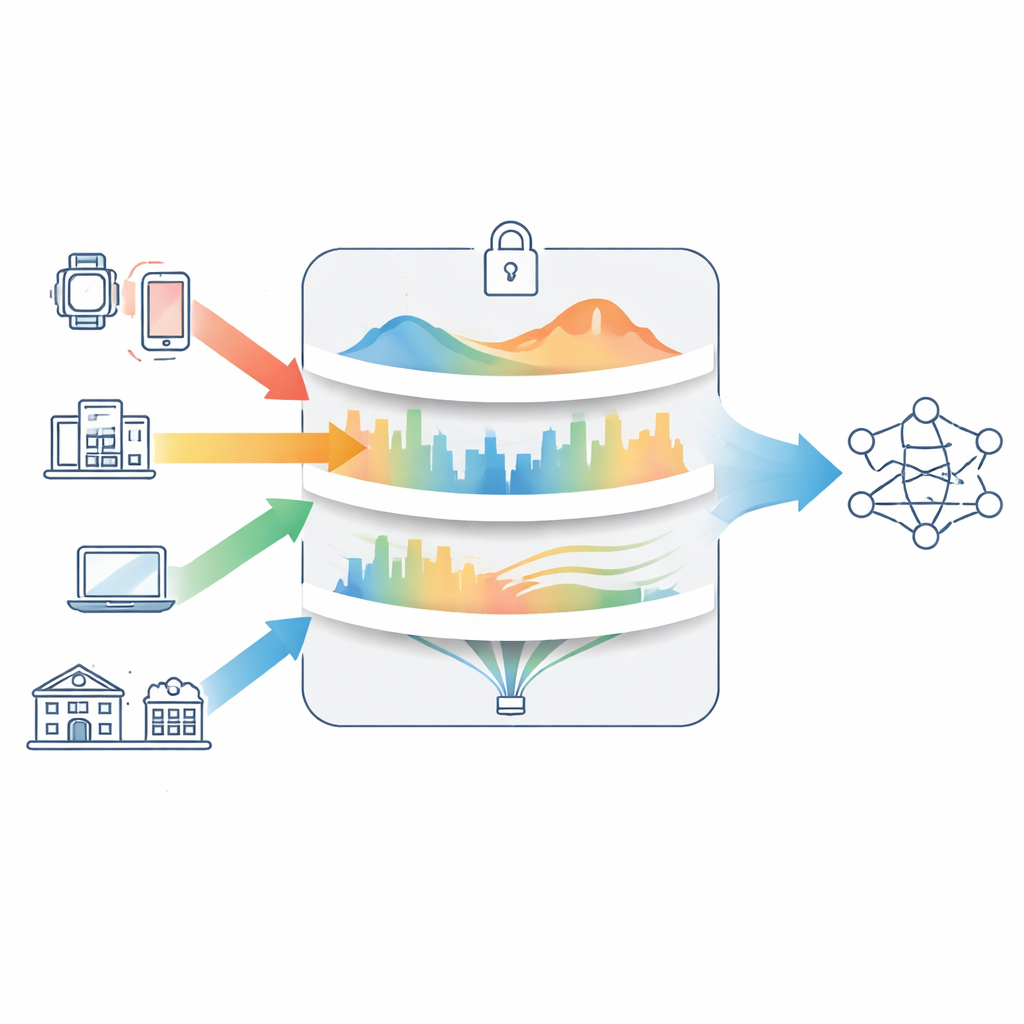

בתי חולים משתפים פעולה ללא שיתוף רשומות

המחקר נשען על טכניקה שנקראת למידת פדרציה, שבה כל מוסד רפואי מאמן עותק מקומי של המודל על נתוני מטופליו. במקום לשלוח תמונות או רשומות לשרת מרכזי, בתי החולים שולחים רק עדכוני מודל, שהשרת משלב למודל משותף אחד ושולח חזרה. לאורך סבבים רבים התהליך יכול להניב מערכת בינה מלאכותית שמשקפת ידע ממספר בתי חולים, בעוד שכל מוסד שומר על הנתונים הגולמיים מאחורי חומת האש שלו. סידור זה מושך במיוחד במקומות בריאותיים ובפיננסים, שבהם חוקים ואתיקה הופכים מאגרים מרכזיים גדולים למסוכנים או בלתי אפשריים.

דליפות נסתרות בתוך חומרה "מאובטחת"

כדי להפוך את שיתוף הפעולה לבטוח יותר, מערכות רבות משתמשות במחשוב סודי: אזורים מיוחדים בחומרה שנקראים סביבות ביצוע מהימנות שמבודדות חישובים רגישים מהשאר במחשב. בתיאוריה, האנקלבים האלה מגנים על אימון המודל מפני עובדים סקרנים או מערכות הפעלה שנפרצו. בפועל, הם אינם מושלמים. תוקפים יכולים לפעמים להסיק סודות על ידי מעקב אחרי זמני ביצוע, שימוש במטמון או תופעות לוואי אחרות של החישוב. שיטות למידת פדרציה קיימות לעתים רחוקות מדמות דליפות כאלה במפורש. בנוסף, הן נוטות לראות פרטיות, דיוק המודל ועלות רשת כחירות עיצוב נפרדות, אף שעל פריסה בעולם האמיתי בתי חולים נאלצים לנווט בין שלושתם במקביל.

איזון בין דיוק, פרטיות ועומס הרשת

המחברים מציעים שיטת אימון חדשה שנקראת Descenso ממוצע מונחה מחשוב סודי (CC-PGD). במקום להתמקד רק בטעות החיזוי, CC-PGD ממטבת שלושה גורמים בו־זמנית: עד כמה המודל מתאים לנתונים, כמה מידע עלול להיחשף דרך ערוצי צד בתוך החומרה המאובטחת, וכמה תקשורת נדרשת בין בתי החולים לשרת המרכזי. סיכון הפרטיות נמדד באמצעות ה"צורה" של הגרדיאנטים שהמודל מייצר: אם מספר קטן של פרמטרים שולט, תוקף עלול ללמוד יותר על מטופלים ספציפיים; אם המידע מפוזר באופן שוויוני יותר, ניתן להסיק פחות. השיטה כוללת גם מדד למצבים שבהם חולשות חומרה ידועות צפויות להיות ניצוליות יותר, ותנאי עלות שמייצג כמה גדולים עדכוני המודל וכמה זמן לוקח לשדרם ברשתות.

דרך מודרכת לכוונון הגדרות הבטיחות

מאחורי הקלעים, CC-PGD פועל כמו גרסה מוגבלת ומפוקחת של ירידה במדרון סטנדרטית, כלי העבודה המקובל באימון בינה מלאכותית מודרנית. המאמר מוכיח שגם עם העונשים הנוספים של פרטיות ותקשורת, המאיץ שלהם עדיין מתכנס באופן מהימן תחת תנאים רחבים. חשיבותית, CC-PGD חושף שני "כפתורים" מתכווננים שעומדי מערכת יכולים לסובב: אחד שמחזק את הגנת הפרטיות ואחד שמגביל עומס תקשורת. כיוון כפתורים אלה מעלה או מטה מאפשר למפעילים להחליט, למשל, האם להעדיף דיוק מקסימלי למחקר או פרטיות חזקה ורוחב פס נמוך למרפאה כפרית עם אינטרנט איטי.

מה המבחנים מראים

כדי לבחון את הרעיון, המחברים מדמים מספר מוסדות רפואיים המאמנים מודלים לזיהוי תמונות על מאגרי תמונות ציבוריים ידועים (MNIST ו‑CIFAR-10). הם משווים את CC-PGD לשיטות פדרציה נפוצות, כולל ממוצע פדרטיבי סטנדרטי, טכניקה שמוסיפה רעש אקראי לשם פרטיות וגרסה המותאמת לנתונים שאינם מאוזנים בין הלקוחות. הן במשימות תמונה פשוטות והן במורכבות גבוהה יותר, ובתנאי חלוקה שוויונית ולא שוויונית של נתונים, CC-PGD שומר על דיוק קרוב למה שהושג אילו כל הנתונים היו מרוכזים. במקביל, הוא מקטין מדדי דליפת פרטיות בכ־25% עד 33% ומפחית עלות תקשורת בכ־20% לעומת השיטות הבסיסיות.

מה המשמעות עבור בינה רפואית בעולם האמיתי

באופן פשוט, עבודה זו מראה שבתי חולים אינם חייבים לבחור באופן חד בין איכות המודל, פרטיות וישימות כשמאמנים בינה מלאכותית במשותף. באמצעות דימות מפורש של האופן שבו מידע עלול לדלוף מחומרה שנתפסת כמאובטחת, ובניית עלויות פרטיות ורוחב פס לתוך תהליך האימון עצמו, CC-PGD מציע דרך מושכלת לתכנן מערכות שיתופיות בטוחות יותר. בעוד שהניסויים משתמשים בתמונות בסיסיות במקום בסריקות רפואיות אמיתיות, המסגרת היא כללית וניתנת ליישום על מודלים גדולים יותר, כולל כלים גנרטיביים ומודלים שעובדים על תמלולי רפואיים או לוגים של אבטחת סייבר. עם אימות נוסף על נתוני בתי חולים אמיתיים, גישות כאלה יכולות לשמש כרשתות בינה אמינות שלומדות ממספר מוסדות תוך שמירה על נתוני כל מטופל נעולים בבטחה במקומם.

ציטוט: Xu, F., Wei, X., Zhao, Z. et al. Optimization of cross-institutional medical federated learning framework driven by confidential computing. Sci Rep 16, 14323 (2026). https://doi.org/10.1038/s41598-026-44843-4

מילות מפתח: למידת פדרציה, מחשוב סודי, בינה רפואית, אימון עם שמירה על פרטיות, סביבות ביצוע מהימנות