Clear Sky Science · pl

Optymalizacja międzyinstytucyjnego ramienia uczenia federacyjnego w medycynie napędzanego przetwarzaniem poufnym

Dlaczego ochrona współdzielonych danych medycznych ma znaczenie

Współczesne szpitale coraz częściej korzystają ze sztucznej inteligencji do odczytywania badań obrazowych, wcześniejszego wykrywania chorób i wspomagania decyzji terapeutycznych. Jednak algorytmy ratujące życie potrzebują ogromnych ilości danych pacjentów, a udostępnianie ich między instytucjami może kolidować z surowymi przepisami o prywatności i realnym ryzykiem włamań. W artykule analizuje się, jak szpitale mogą współpracować przy trenowaniu wydajnych modeli AI bez gromadzenia surowych rekordów pacjentów oraz jak zabezpieczać się przed subtelnymi atakami sprzętowymi, które mogą wyciekać tajemnice nawet wtedy, gdy dane nigdy nie opuszczają placówki.

Szpitale współpracujące bez udostępniania rekordów

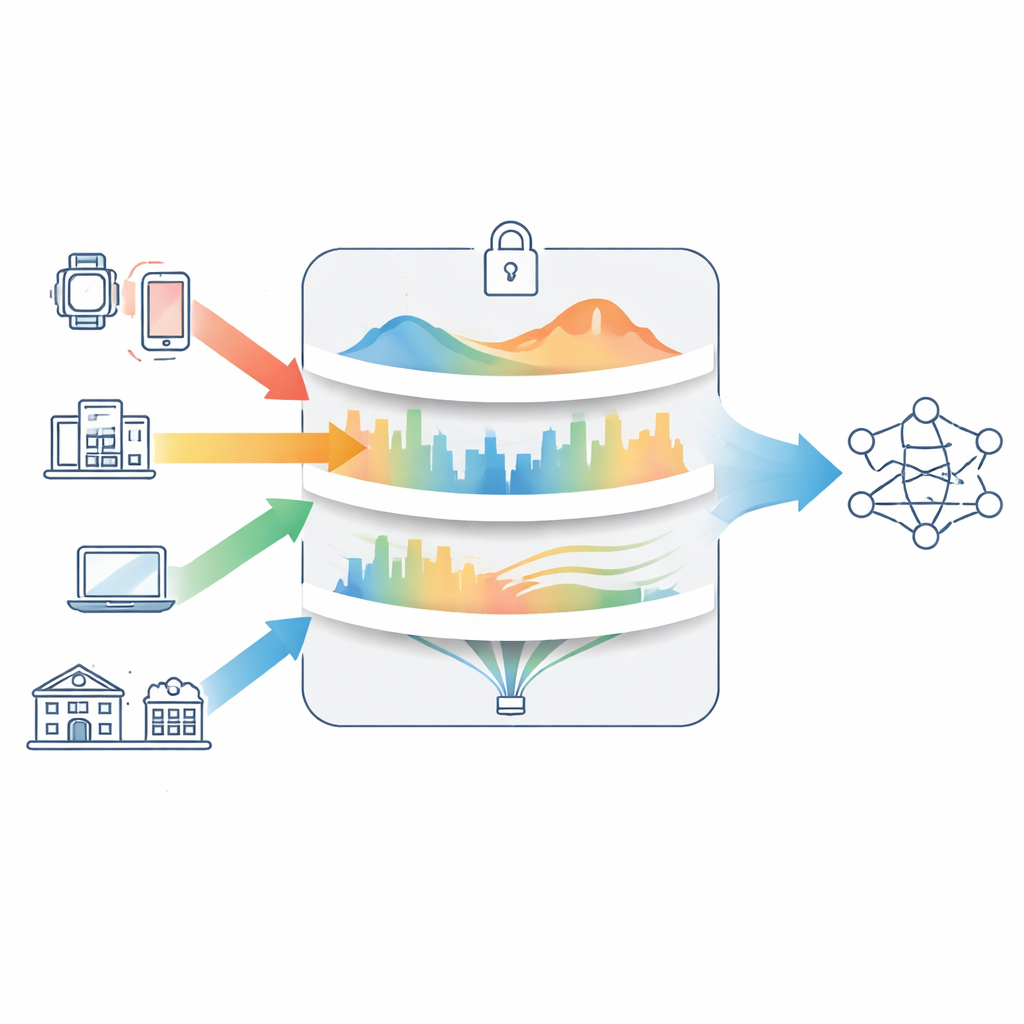

Badanie opiera się na technice zwanej uczeniem federacyjnym, w której każda instytucja medyczna trenuje swoją kopię modelu AI na lokalnych danych pacjentów. Zamiast wysyłać obrazy czy rekordy do centralnego serwera, szpitale przesyłają jedynie aktualizacje modelu, które serwer łączy w jeden wspólny model i odsyła z powrotem. W kolejnych rundach ten proces może dać system AI odzwierciedlający wiedzę z wielu placówek, podczas gdy każda instytucja przechowuje surowe dane za własnym firewallem. Takie podejście jest atrakcyjne w sektorze opieki zdrowotnej i finansów, gdzie przepisy i etyka czynią duże centralne zbiory danych ryzykownymi lub niemożliwymi do zrealizowania.

Ukryte wycieki wewnątrz „bezpiecznego” sprzętu

Aby zwiększyć bezpieczeństwo takiej współpracy, wiele systemów wykorzystuje przetwarzanie poufne: specjalne obszary sprzętowe zwane zaufanymi środowiskami wykonawczymi, które izolują wrażliwe obliczenia od reszty komputera. W teorii te enklawy chronią proces trenowania modelu przed ciekawskimi pracownikami lub skompromitowanym systemem operacyjnym. W praktyce nie są one doskonałe. Atakujący czasami potrafią wywnioskować sekrety, obserwując czas wykonywania, użycie pamięci podręcznej lub inne efekty uboczne obliczeń. Istniejące metody uczenia federacyjnego rzadko modelują takie wycieki wprost. Zwykle traktują też prywatność, dokładność modelu i koszty sieciowe jako odrębne wybory projektowe, choć w rzeczywistych wdrożeniach szpitale muszą równoważyć wszystkie trzy naraz.

Równoważenie dokładności, prywatności i obciążenia sieci

Autorzy proponują nową metodę treningową nazwaną Confidential Computing-Aware Projected Gradient Descent (CC-PGD). Zamiast skupiać się wyłącznie na błędzie predykcji, CC-PGD optymalizuje trzy aspekty jednocześnie: dopasowanie modelu do danych, ilość informacji mogącej wyciec przez kanały boczne w bezpiecznym sprzęcie oraz koszt komunikacji między szpitalami a serwerem centralnym. Ryzyko prywatności mierzone jest za pomocą „kształtu” gradientów wytwarzanych przez model: jeśli tylko kilka parametrów dominuje, atakujący może dowiedzieć się więcej o konkretnych pacjentach; jeśli informacje są rozproszone równomierniej, można wydedukować mniej. Metoda zawiera też wskaźnik sygnalizujący, kiedy znane słabości sprzętowe są bardziej podatne na wykorzystanie, oraz składnik kosztowy odzwierciedlający wielkość aktualizacji modelu i czas ich przesyłu przez sieć.

Przewodnik po regulacji ustawień bezpieczeństwa

W praktyce CC-PGD działa jak ostro ograniczona wersja zwykłego spadku gradientu, standardowego narzędzia trenowania modeli AI. Artykuł dowodzi, że nawet z dodatkowymi karami za prywatność i komunikację ich optymalizator zbiega się wiarygodnie w szerokich warunkach. Co ważne, CC-PGD ujawnia dwa regulowane „pokrętła”, które projektanci systemów mogą ustawiać: jedno wzmacnia ochronę prywatności, drugie ogranicza koszty komunikacyjne. Regulując te parametry, operatorzy mogą zdecydować na przykład, czy faworyzować maksymalną dokładność w badaniu naukowym, czy silniejszą prywatność i niższe wymagania pasma dla wiejskiej kliniki z wolnym internetem.

Co pokazują eksperymenty

Aby przetestować pomysł, autorzy zasymulowali wiele instytucji medycznych trenujących modele rozpoznawania obrazów na znanych publicznych zbiorach danych (MNIST i CIFAR-10). Porównali CC-PGD z popularnymi metodami uczenia federacyjnego, w tym standardowym federated averaging, techniką dodawania losowego szumu dla prywatności oraz wariantem przeznaczonym dla nierównomiernie rozłożonych danych klienta. Zarówno w prostszych, jak i bardziej złożonych zadaniach obrazowych, przy równym i nierównym podziale danych, CC-PGD utrzymuje dokładność bliską tej osiągniętej przy scentralizowaniu wszystkich danych. Jednocześnie zmniejsza miary wycieku prywatności o około jedną czwartą do jednej trzeciej oraz redukuje koszty komunikacji o około jedną piątą w porównaniu z punktami odniesienia.

Co to oznacza dla AI w opiece zdrowotnej w praktyce

Mówiąc prosto, praca pokazuje, że szpitale nie muszą wybierać wyłącznie między jakością modelu, prywatnością i praktycznością podczas wspólnego trenowania AI. Poprzez jawne modelowanie sposobów, w jakie informacje mogą wyciekać z rzekomo bezpiecznego sprzętu, oraz wbudowanie kosztów prywatności i pasma w sam proces treningu, CC-PGD oferuje zasadnicze podejście do projektowania bezpieczniejszych systemów współpracy. Choć eksperymenty używają obrazów testowych zamiast prawdziwych skanów, ramy te są ogólne i mogą zostać zastosowane do większych modeli, w tym narzędzi generatywnych i modeli językowych analizujących notatki medyczne czy logi cyberbezpieczeństwa. Po dalszej walidacji na rzeczywistych danych szpitalnych podejścia takie mogą stać się podstawą zaufanych sieci AI, które uczą się z wielu instytucji, trzymając jednocześnie dane każdego pacjenta bezpiecznie w miejscu ich pochodzenia.

Cytowanie: Xu, F., Wei, X., Zhao, Z. et al. Optimization of cross-institutional medical federated learning framework driven by confidential computing. Sci Rep 16, 14323 (2026). https://doi.org/10.1038/s41598-026-44843-4

Słowa kluczowe: uczenie federacyjne, przetwarzanie poufne, AI w medycynie, trenowanie z zachowaniem prywatności, zaufane środowiska wykonawcze