Clear Sky Science · nl

Optimalisatie van een cross-institutioneel medisch federated learning-framework aangedreven door confidential computing

Waarom het beschermen van gedeelde medische gegevens belangrijk is

Moderne ziekenhuizen vertrouwen steeds vaker op kunstmatige intelligentie om scans te lezen, ziektes eerder te detecteren en behandelingen te begeleiden. Toch hebben levensreddende algoritmen enorme hoeveelheden patiëntgegevens nodig, en het delen van die gegevens tussen instellingen kan botsen met strikte privacyregels en reële zorgen over hacks. Dit artikel onderzoekt hoe ziekenhuizen kunnen samenwerken om krachtige AI-modellen te trainen zonder ruwe patiëntgegevens te centraliseren, en hoe ze zich kunnen beschermen tegen subtiele hardware-aanvallen die geheimen kunnen lekken, zelfs wanneer de data nooit de instelling verlaat.

Ziekenhuizen werken samen zonder dossiers te delen

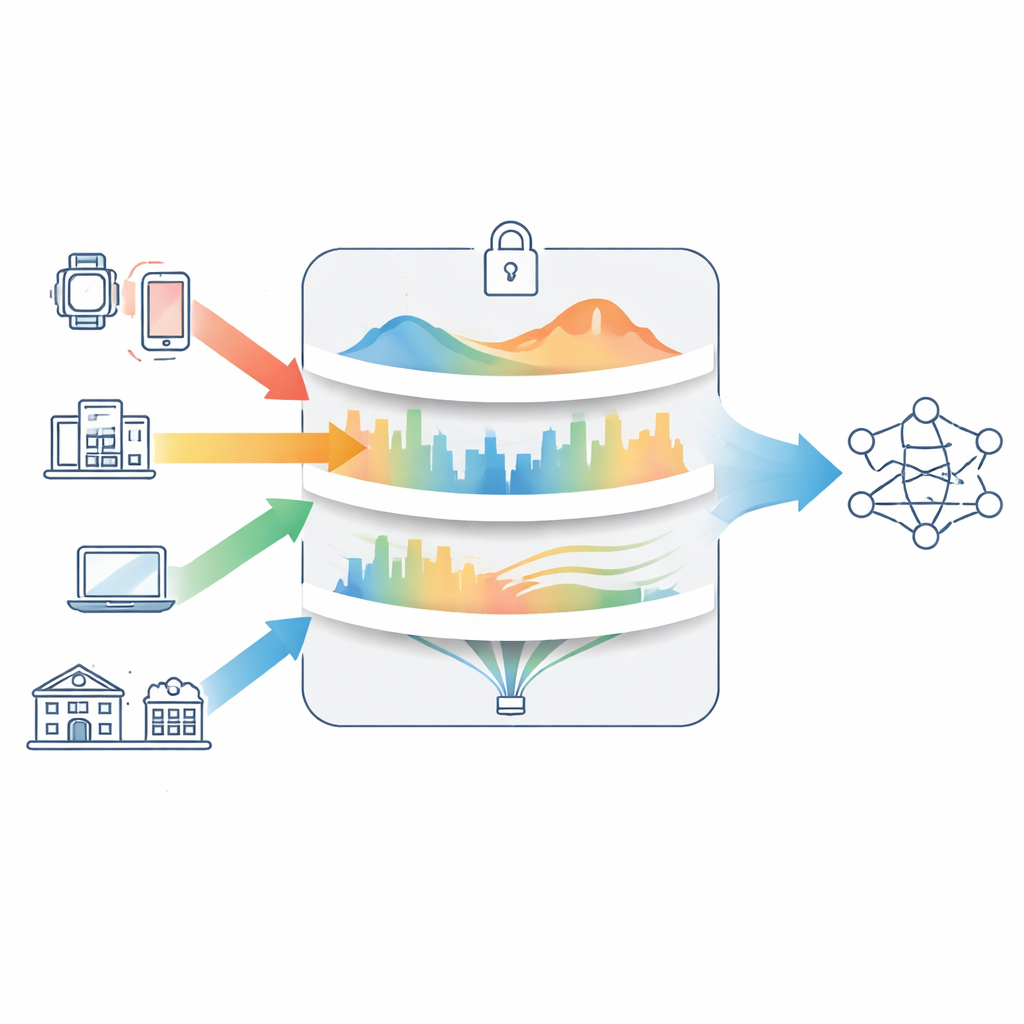

De studie is opgebouwd rond een techniek genaamd federated learning, waarbij elke medische instelling een eigen kopie van een AI-model traint op lokale patiëntgegevens. In plaats van afbeeldingen of dossiers naar een centrale server te sturen, sturen ziekenhuizen alleen modelupdates, die de server samenvoegt tot één gedeeld model en terugstuurt. Over vele rondes kan dit proces een AI-systeem opleveren dat kennis van veel ziekenhuizen bevat, terwijl elke instelling ruwe data achter zijn eigen firewall houdt. Deze opzet is aantrekkelijk voor de gezondheidszorg en de financiële sector, waar wetten en ethiek grote centrale data-meren risicovol of onmogelijk maken.

Verborgen lekken binnen “veilige” hardware

Om deze samenwerking veiliger te maken, gebruiken veel systemen confidential computing: speciale hardware-gebieden genaamd trusted execution environments die gevoelige berekeningen isoleren van de rest van de computer. In theorie beschermen deze enclaves het modelteren tegen nieuwsgierige insiders of gecompromitteerde besturingssystemen. In de praktijk zijn ze niet perfect. Aanvallers kunnen soms geheimen afleiden door tijdsverschillen, cachegebruik of andere bijeffecten van berekeningen te observeren. Bestaande federated learning-methoden modelleren deze lekken zelden expliciet. Ze behandelen privacy, modelnauwkeurigheid en netwerkbelastingen vaak als afzonderlijke ontwerpkeuzes, terwijl ziekenhuizen in echte implementaties met alle drie tegelijk moeten jongleren.

Balanceren van nauwkeurigheid, privacy en netwerkbelasting

De auteurs stellen een nieuwe trainingsmethode voor genaamd Confidential Computing-Aware Projected Gradient Descent (CC-PGD). In plaats van zich alleen op voorspellingsfouten te richten, optimaliseert CC-PGD tegelijk drie aspecten: hoe goed het model bij de data past, hoeveel informatie via zijkanalen in beveiligde hardware blootgesteld kan worden, en hoeveel communicatie nodig is tussen ziekenhuizen en de centrale server. Het privacyrisico wordt gemeten aan de hand van de “vorm” van de gradiënten die het model produceert: als slechts een paar parameters domineren, kan een aanvaller mogelijk meer over specifieke patiënten leren; als informatie breder verspreid is, kan er minder worden afgeleid. De methode bevat ook een indicator voor wanneer bekende hardwarezwaktes waarschijnlijker misbruikbaar zijn, en een kostterm die vastlegt hoe groot de modelupdates zijn en hoe lang ze over netwerken duren om te verzenden.

Een geleide manier om veiligheidsinstellingen af te stemmen

Onder de motorkap werkt CC-PGD als een zorgvuldig begrensde versie van gewone gradient descent, de standaardmethode voor moderne AI-training. Het artikel bewijst dat, zelfs met de extra privacy- en communicatiepenalty's, hun optimizer nog steeds betrouwbaar convergeert onder ruime voorwaarden. Belangrijk is dat CC-PGD twee verstelbare “knoppen” blootlegt die systeemontwerpers kunnen draaien: één die de privacybescherming versterkt en één die de communicatie-overhead beperkt. Aanpassen van deze knoppen laat operators bijvoorbeeld beslissen of ze maximale nauwkeurigheid voor een onderzoeksstudie verkiezen, of sterkere privacy en lagere bandbreedte voor een landelijke kliniek met traag internet.

Wat de experimenten laten zien

Om het idee te testen, simuleren de auteurs meerdere medische instellingen die beeldherkenningsmodellen trainen op bekende publieke datasets (MNIST en CIFAR-10). Ze vergelijken CC-PGD met gangbare federated learning-methoden, waaronder standaard federated averaging, een techniek die willekeurige ruis toevoegt voor privacy, en een variant die is ontworpen voor ongelijke data over clients. Zowel bij eenvoudige als complexere beeldtaken, en bij gelijkmatig en ongelijk verdeeld data, houdt CC-PGD de nauwkeurigheid dicht bij wat bereikt zou worden als alle data gecentraliseerd waren. Tegelijk reduceert het maatregelen voor privacylekken met ongeveer een kwart tot een derde en vermindert het communicatiekosten met ongeveer een vijfde vergeleken met de basislijnen.

Wat dit betekent voor AI in de praktijk in de gezondheidszorg

Simpel gezegd toont dit werk aan dat ziekenhuizen niet strikt hoeven te kiezen tussen modelkwaliteit, privacy en praktische toepasbaarheid wanneer ze samen AI trainen. Door expliciet te modelleren hoe informatie zou kunnen lekken uit zogenaamd veilige hardware, en door privacy- en bandbreedtekosten in het trainingsproces zelf in te bouwen, biedt CC-PGD een principiële manier om veiligere collaboratieve systemen te ontwerpen. Hoewel de experimenten benchmark-afbeeldingen gebruiken in plaats van echte scans, is het framework algemeen en zou het toegepast kunnen worden op grotere modellen, waaronder generatieve AI-tools en taalmodellen die medische aantekeningen of cybersecuritylogs analyseren. Met verdere validatie op echte ziekenhuisdata zouden benaderingen als deze betrouwbare AI-netwerken kunnen ondersteunen die van veel instellingen leren terwijl ieders patiëntgegevens veilig lokaal blijven opgeslagen.

Bronvermelding: Xu, F., Wei, X., Zhao, Z. et al. Optimization of cross-institutional medical federated learning framework driven by confidential computing. Sci Rep 16, 14323 (2026). https://doi.org/10.1038/s41598-026-44843-4

Trefwoorden: federated learning, confidential computing, medische AI, privacy-behoudende training, trusted execution environments