Clear Sky Science · zh

使用强化学习的多目标库存优化:盈利能力与碳排放的比较研究

这项研究为何与日常商业和地球息息相关

现代企业面临一个艰难问题:如何既保证货架充足、客户满意并获得可观利润,同时又能减少碳足迹?本文考察了一类称为强化学习的人工智能能否帮助管理者自动找到既能赚钱又能减少温室气体排放的库存策略,而不是将气候影响当作事后考虑。

在盈利与排放之间取得平衡

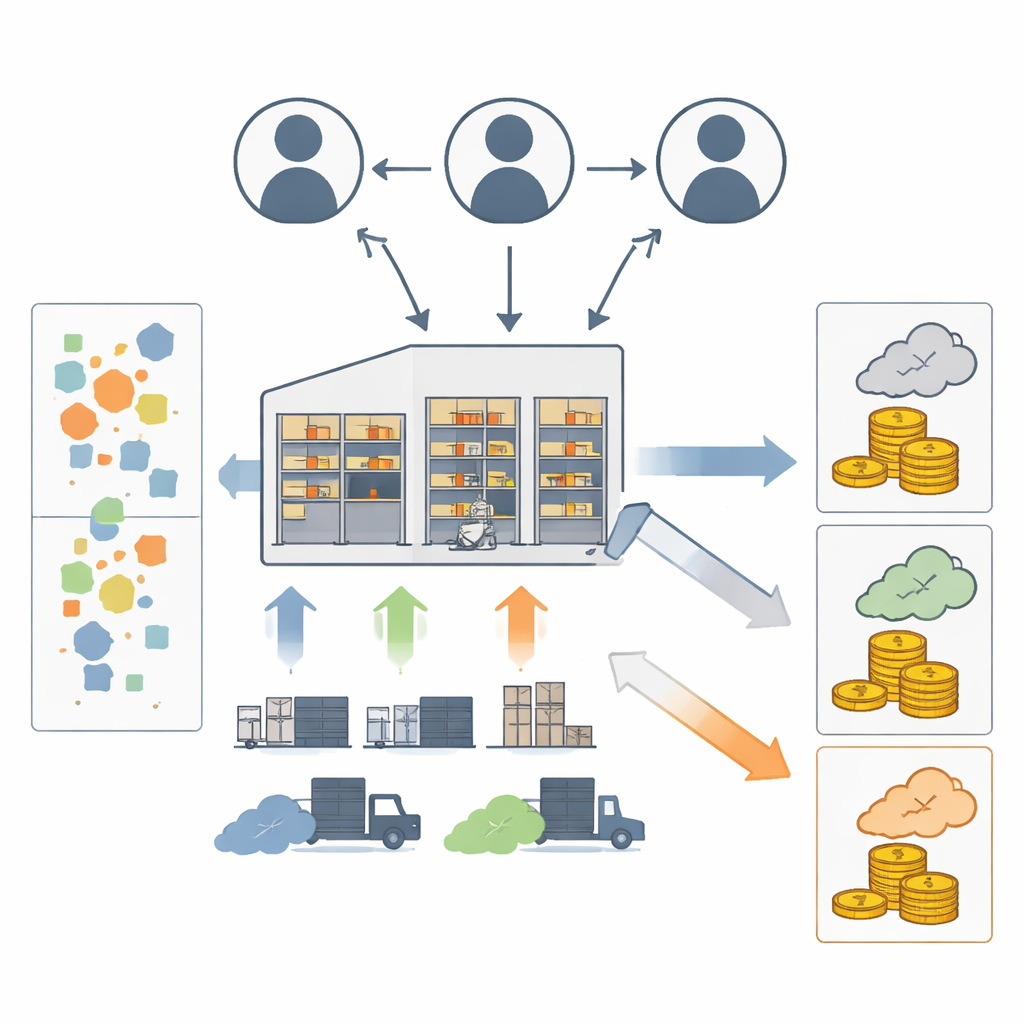

库存管理位于供应链的核心,影响成本、交付速度和损耗。传统上,数学模型帮助企业决定何时以及订购多少。近年来,可持续性问题促使研究者将碳排放纳入考量,通常通过在成本公式中加入惩罚或税收来体现。这种方法将金钱与排放混为一体,掩盖了为环境收益所牺牲的利润量。本研究则将利润与碳排放视为两个独立目标,以便清晰地审视二者之间的权衡。研究聚焦于一个从供应商订货并服务客户需求的单一仓库,同时考虑仓库运行与卡车运输产生的排放。

在不确定性下教会AI管理库存

作者构建了一个模拟仓库,其中客户需求随时间随机变化。在每个步骤,软件代理以固定批量选择订货量。环境追踪手头库存、积压订单、待发货量和提前期,并据此计算收入、成本(订货、持有和缺货罚金)以及运输与储存产生的碳排放。代理收到的奖励将利润与排放按照可调权重结合:利润增加奖励,而排放减少奖励。通过与该虚拟仓库反复交互,代理学习哪些订货模式在长期内能带来更高的回报。

比较四种学习策略

在相同条件下测试了四种流行的强化学习算法:近端策略优化(PPO)、阶段性策略梯度(PPG)、优势演员-评论家(A2C)和双重深度Q网络(DDQN)。它们看到相同的需求模式、成本和排放参数。研究人员跟踪每种算法达到稳定策略的速度、累计利润以及产生的碳排放量。他们还在两种不同需求模式下重复实验(一个宽范围的均匀分布和一个更窄的泊松分布),以检验当环境变得更可预测时结果是否一致。

算法学会了做什么

对比显示每种方法具有不同特点。PPG 一贯实现最高利润,但相对于其他方法只带来适度的排放增加。PPO 在利润上位列第二,但排放略低,作者将其描述为在金钱与碳之间提供了一种平衡的权衡。DDQN 比其他方法更快学会良好策略——它在更少的训练回合中达到稳定,但最终采取的决策产生的总体利润较低,尽管排放相对较低。A2C 在利润上处于中间位置,但往往产生最高的排放。当需求模式用泊松分布平滑后,PPG 仍然是利润领先者,DDQN 仍然是学习速度最快的,强化了主要结论。

在绿色目标与收益之间调整优先级

为了模拟不同的商业优先级,作者调整了告诉代理在奖励中应如何在利润与排放之间权衡的权重。如预期,增加对利润的权重会带来更高的收益但也更多碳排放,而强调排放会降低利润。然而,各算法的反应方式不同。PPO 在不同权重设置下表现最稳定且可预测,保持了合理的利润和排放。PPG 倾向于聚集在高利润解附近,对权重的小幅变化敏感性较低。DDQN 和 A2C 在性能上表现出更多不规则的变化。当排放被赋予极端权重时,所有算法都会陷入几乎不下单的策略,以避免排放但也损失收益——这是一个不现实但富有启发性的极端案例,显示了奖励设计的局限性。

这对现实决策者的意义

对管理者而言,该研究表明强化学习可以作为探索利润与碳排放权衡的灵活工具,即便在没有碳税或碳交易体系的情况下亦然。PPG 似乎最适合那些以利润为优先但仍关注排放的企业,而 PPO 在偏好或条件变化时提供了最可靠的平衡与稳健性。DDQN 适合在快速部署和快速学习至关重要的场景,A2C 则可作为资源受限时的简单基线。作者警告说,他们的模型依赖于对需求、提前期和产能的简化假设,并且极端强调排放会将AI推向不现实的策略。他们主张未来研究应放宽这些假设,并更全面地探寻可能的利润—排放折衷范围。尽管如此,这项研究为使用学习算法做出既在财务上又在环境上更明智的库存决策提供了早期路线图。

引用: Sorour, A., Sadek, Y. & Elshalakani, M. Multi-objective inventory optimization using reinforcement learning: a comparative study on profitability and carbon emissions. Sci Rep 16, 13635 (2026). https://doi.org/10.1038/s41598-026-44293-y

关键词: 库存管理, 强化学习, 碳排放, 可持续供应链, 多目标优化