Clear Sky Science · sv

Flermålsoptimering av lager med förstärkningsinlärning: en jämförande studie av lönsamhet och koldioxidutsläpp

Varför den här studien är viktig för företag och planeten

Moderna företag står inför en svår fråga: hur kan de hålla hyllorna välfyllda och kunderna nöjda, generera god vinst och samtidigt minska sitt koldioxidavtryck? Denna artikel undersöker om en typ av artificiell intelligens, kallad förstärkningsinlärning, kan hjälpa chefer att automatiskt hitta lagerpolicies som både genererar vinst och reducerar växthusgasutsläpp, istället för att behandla klimatpåverkan som en eftertanke.

Att väga intäkter mot utsläpp

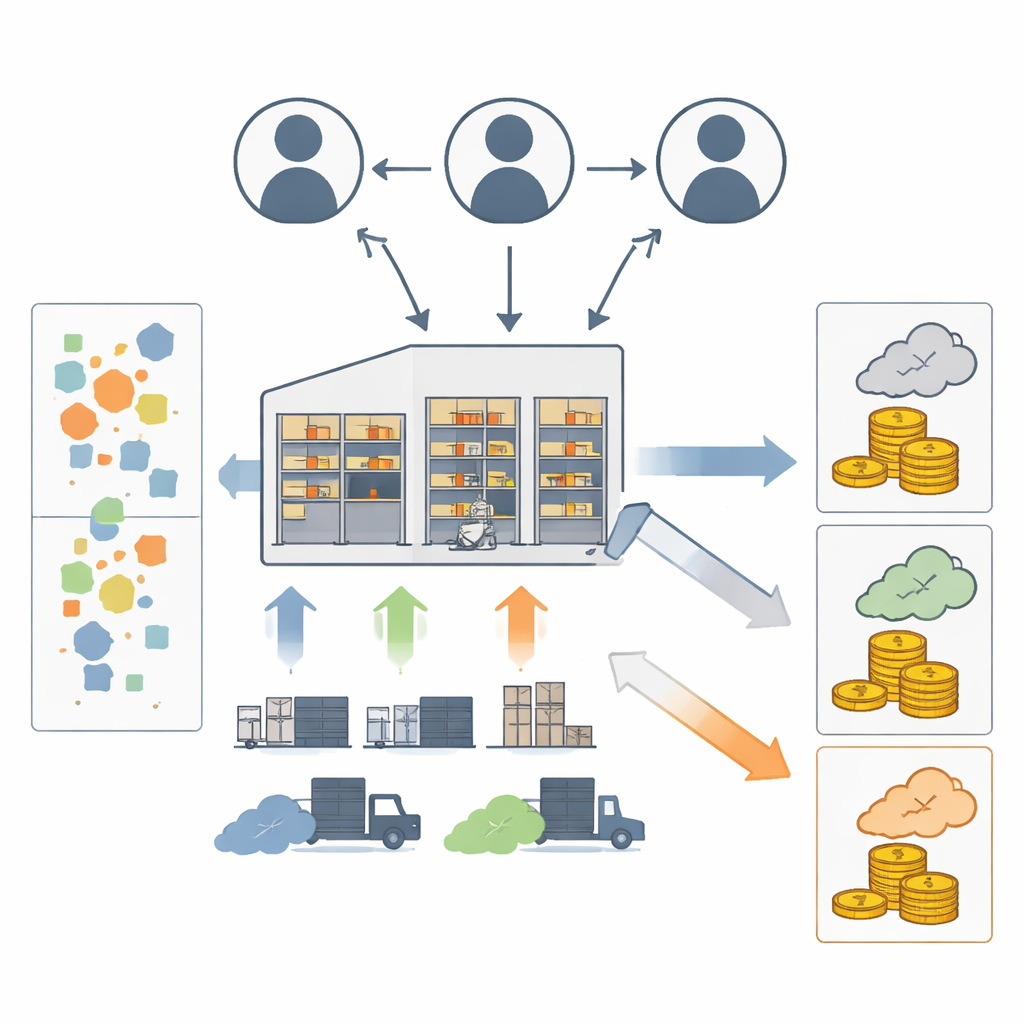

Lagerhantering ligger i hjärtat av leverantörskedjor och påverkar kostnader, leveranstid och svinn. Traditionellt har matematiska modeller hjälpt företag att bestämma när och hur mycket som ska beställas. På senare tid har hållbarhetsaspekter fått forskare att inkludera koldioxidutsläpp, ofta genom att lägga till penaliseringar eller skatter i kostnadsformler. Denna metod blandar pengar och utsläpp i en enda måttstock, vilket döljer hur mycket vinst som offras för miljövinster. Denna studie behandlar i stället vinst och koldioxid som två separata mål, så att deras spänning kan undersökas tydligt. Fokus ligger på ett enskilt lager som beställer från en leverantör och betjänar kundernas efterfrågan, samtidigt som utsläpp genereras från lagerdrift och lastbilstransporter.

Att lära en AI att sköta lager under osäkerhet

Författarna bygger en simulerad lageranläggning där kundernas efterfrågan varierar slumpmässigt över tid. Vid varje steg väljer en mjukvaruagentration ett beställningsantal i fasta partier. Miljön håller reda på lagerbeholdning, eftersläpade beställningar, pågående leveranser och ledtid. Utifrån dessa beräknas intäkter, kostnader (beställnings-, lagerhållnings- och eftersläpningstraff) samt koldioxidutsläpp från transporter och lagring. Agenten får en belöning som kombinerar vinst och utsläpp med justerbara vikter: vinst läggs till belöningen medan utsläpp dras av. Genom att upprepade gånger interagera med detta virtuella lager lär sig agenten vilka beställningsmönster som tenderar att ge bättre långsiktiga belöningar.

Jämförelse av fyra inlärningsstrategier

Fyra populära förstärkningsinlärningsalgoritmer testas under identiska förhållanden: Proximal Policy Optimization (PPO), Phasic Policy Gradient (PPG), Advantage Actor–Critic (A2C) och Double Deep Q-Network (DDQN). Alla exponeras för samma efterfrågemönster samt samma kostnads- och utsläppsparametrar. Forskarna följer hur snabbt varje algoritm ”stabiliserar” sig till en policy, hur mycket ackumulerad vinst den genererar och hur mycket koldioxid den producerar. Experimenten upprepas också under två olika efterfrågemönster (ett brett uniformt intervall och en snävare Poisson-fördelning) för att kontrollera om resultaten håller när miljön blir mer förutsägbar.

Vad algoritmerna lärde sig göra

Den direkt jämförande studien visar tydliga personligheter för varje metod. PPG uppnår konsekvent högst vinst, till priset av endast en måttlig ökning av utsläpp jämfört med konkurrenterna. PPO kommer på andra plats i fråga om vinst men levererar något lägre utsläpp, och erbjuder vad författarna beskriver som en balanserad avvägning mellan pengar och koldioxid. DDQN lär sig bra policies snabbare än de andra—den når stabilitet i färre träningsavsnitt—men landar slutligen i beslut som ger lägre total vinst, även om utsläppen är relativt låga. A2C hamnar i mitten vad gäller vinst samtidigt som den tenderar att ge de högsta utsläppen. När efterfrågan jämnas ut med Poisson-fördelningen förblir PPG vinstledaren och DDQN den snabbaste inläraren, vilket stärker huvudslutsatserna.

Ställa in prioriteringar mellan gröna mål och intäkter

För att efterlikna olika affärsprioriteringar justerar författarna de vikter som talar om för agenten hur mycket den ska värdera vinst respektive utsläpp i sin belöning. Som väntat leder högre vikt på vinst till större intäkter men också mer koldioxid, medan fokus på utsläpp sänker vinsterna. Hur varje algoritm reagerar skiljer sig dock åt. PPO visar den mest stabila och förutsägbara beteendet över olika viktinställningar och behåller rimliga nivåer av både vinst och utsläpp. PPG tenderar att samlas kring högvinstlösningar med begränsad känslighet för små viktförändringar. DDQN och A2C uppvisar mer oregelbundna förändringar i prestanda. När utsläpp ges extrema vikter antar alla algoritmer nästan noll-beställningsstrategier som undviker utsläpp men också förlorar pengar—ett orealistiskt men informativt kantfall som visar begränsningarna i belöningsdesignen.

Vad detta innebär för beslutsfattare i verkligheten

För beslutsfattare antyder studien att förstärkningsinlärning kan fungera som ett flexibelt verktyg för att utforska avvägningar mellan vinst och koldioxidutsläpp, även när ingen koldioxidskatt eller kvothandel finns. PPG framstår som mest lämplig för företag som prioriterar vinst samtidigt som de bryr sig om utsläpp, medan PPO erbjuder den mest pålitliga balansen och robustheten när preferenser eller förhållanden ändras. DDQN kan vara attraktiv när snabb driftsättning och snabb inlärning är avgörande, och A2C kan fungera som en enklare referens i resursbegränsade miljöer. Författarna varnar för att deras modell bygger på förenklade antaganden om efterfrågan, ledtider och kapacitet, och att extremt fokus på utsläpp kan pressa AI:n mot orealistiska policies. De menar att framtida arbete bör släppa på dessa antaganden och i större utsträckning söka efter hela spektrat av möjliga vinst–utsläppsavvägningar. Ändå ger studien en tidig färdplan för att använda inlärningsalgoritmer för att fatta lagerbeslut som är både ekonomiskt och miljömässigt klokare.

Citering: Sorour, A., Sadek, Y. & Elshalakani, M. Multi-objective inventory optimization using reinforcement learning: a comparative study on profitability and carbon emissions. Sci Rep 16, 13635 (2026). https://doi.org/10.1038/s41598-026-44293-y

Nyckelord: lagerhantering, förstärkningsinlärning, koldioxidutsläpp, hållbara leverantörskedjor, flermålsoptimering