Clear Sky Science · tr

Güçlendirmeli öğrenme kullanılarak çok hedefli stok optimizasyonu: kârlılık ve karbon emisyonları üzerine karşılaştırmalı bir çalışma

Bu çalışmanın günlük iş dünyası ve gezegen için önemi

Modern şirketler zor bir dengeyle uğraşıyor: rafları dolu tutup müşterileri memnun ederken nasıl sağlıklı kâr elde edebilirler ve aynı zamanda karbon ayak izlerini nasıl azaltabilirler? Bu makale, güçlendirmeli öğrenme adı verilen bir tür yapay zekânın yöneticilere ikisini birden —kârı artıran ve sera gazı emisyonlarını azaltan— stok politikalarını otomatik olarak bulmada yardımcı olup olamayacağını araştırıyor; iklim etkisini sonra düşünülmesi gereken bir unsur olarak ele almak yerine doğrudan hedef haline getiriyor.

Kazanç ile salınım arasındaki denge

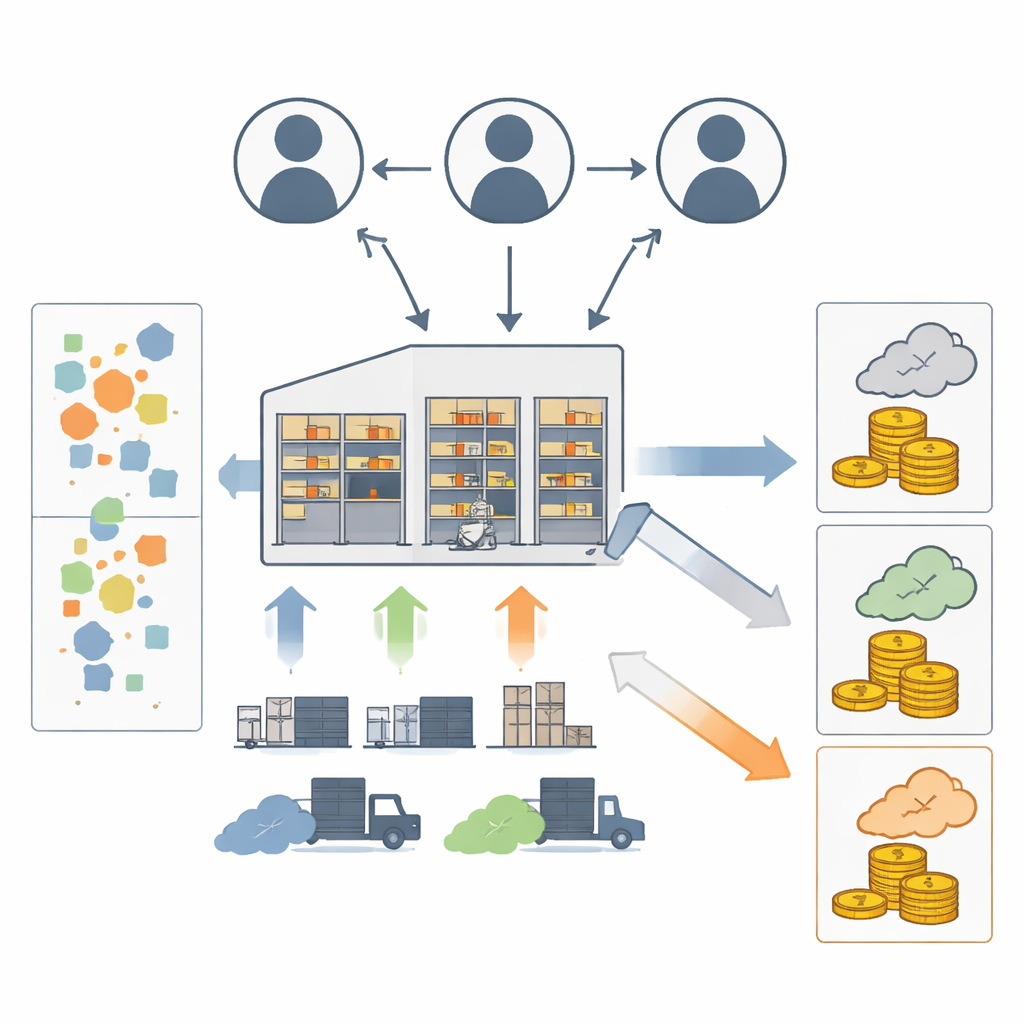

Stok yönetimi tedarik zincirlerinin merkezinde yer alır; maliyetleri, teslimat hızını ve atığı etkiler. Geleneksel olarak matematiksel modeller firmalara ne zaman ve ne kadar sipariş verileceğine karar vermede yardımcı oldu. Son zamanlarda sürdürülebilirlik kaygıları, maliyet formüllerine cezalar veya vergiler ekleyerek karbon emisyonlarını dahil etmeye yöneltti. Bu yaklaşım parayı ve emisyonu tek bir ölçüte indirger; böylece çevresel kazanımlar için ne kadar kârdan vazgeçildiği görünmez hale gelir. Bu çalışma ise kârı ve karbonu iki ayrı hedef olarak ele alıyor, böylece aralarındaki gerilim net şekilde incelenebiliyor. Odak noktası, bir tedarikçiden sipariş veren ve müşteri talebini karşılayan tek bir depo; depo işletmesi ve kamyon sevkiyatlarından kaynaklanan emisyonlar da hesaba katılıyor.

Belirsizlik altında stoğu yönetmeyi bir yapay zekâya öğretmek

Yazarlar, müşteri talebinin zaman içinde rastgele değiştiği simüle bir depo kuruyorlar. Her adımda bir yazılım ajanı sabit büyüklükte partiler halinde bir sipariş miktarı seçiyor. Ortam eldeki stok, gecikmiş siparişler, bekleyen teslimatlar ve tedarik süresini izliyor. Bunlardan gelir, maliyetler (sipariş, stok tutma ve gecikme cezaları) ve taşımacılık ile depolamadan kaynaklanan karbon emisyonları hesaplanıyor. Ajan, kârı ve emisyonları ayarlanabilir ağırlıklarla birleştiren bir ödül alıyor: kâr ödüle ekleniyor, emisyonlar ise ödülden düşülüyor. Bu sanal depo ile tekrar tekrar etkileşim kurarak ajan, hangi sipariş verme kalıplarının uzun vadede daha iyi ödüller ürettiğini öğreniyor.

Dört öğrenme stratejisinin karşılaştırılması

Aynı koşullar altında dört popüler güçlendirmeli öğrenme algoritması test ediliyor: Proximal Policy Optimization (PPO), Phasic Policy Gradient (PPG), Advantage Actor–Critic (A2C) ve Double Deep Q-Network (DDQN). Hepsi aynı talep örüntülerini ve maliyet ile emisyon parametrelerini görüyor. Araştırmacılar her algoritmanın ne kadar hızlı ‘‘kararlı’’ bir politikaya oturduğunu, ne kadar kümülatif kâr elde ettiğini ve ne kadar karbon ürettiğini izliyor. Ayrıca sonuçların ortam daha öngörülebilir hale geldiğinde de geçerli olup olmadığını kontrol etmek için deneyleri iki farklı talep örüntüsü (geniş bir uniform aralık ve daha dar bir Poisson dağılımı) altında tekrarlıyorlar.

Algoritmaların öğrendikleri

Kafa kafaya karşılaştırma her yöntemin ayrı kişilikler sergilediğini ortaya koyuyor. PPG tutarlı biçimde en yüksek kârı elde ediyor; bu, rakiplerine kıyasla yalnızca ılımlı bir emisyon artışıyla gerçekleşiyor. PPO kârlılıkta ikinci sırada ama biraz daha düşük emisyon sağlıyor; yazarların açıkladığı üzere para ve karbon arasında dengeli bir takas sunuyor. DDQN diğerlerine göre daha hızlı iyi politikalar öğreniyor—daha az eğitim bölümü verip kararlılığa ulaşıyor—ancak nihai olarak daha düşük toplam kâr üreten kararlar alıyor, buna karşın emisyonları nispeten düşük kalıyor. A2C kâr açısından ortada yer alırken en yüksek emisyonu üretme eğiliminde oluyor. Talep örüntüsü Poisson ile düzleştirildiğinde, PPG kâr liderliğini koruyor ve DDQN en hızlı öğrenen olarak kalıyor; bu da ana sonuçları pekiştiriyor.

Yeşil hedeflerle kazanç arasındaki önceliklerin ayarlanması

Farklı işletme önceliklerini taklit etmek için yazarlar, ajanın ödülünde kâr ile emisyonu ne kadar önemseyeceğini belirleyen ağırlıkları ayarlıyorlar. Beklendiği gibi, kâra daha fazla ağırlık vermek daha yüksek kazançlara ama aynı zamanda daha fazla karbona yol açarken, emisyonları vurgulamak kârları düşürüyor. Ancak her algoritmanın tepki verme biçimi farklı. PPO ağırlık ayarları arasında en istikrarlı ve öngörülebilir davranışı gösteriyor; makul kârlar ve emisyon seviyelerini koruyor. PPG küçük ağırlık değişikliklerine sınırlı duyarlılıkla yüksek-kâr çözümleri etrafında kümelenme eğiliminde. DDQN ve A2C performansta daha düzensiz kaymalar sergiliyor. Emisyonlara aşırı derece ağırlık verildiğinde, tüm algoritmalar emisyonlardan kaçınmak ama aynı zamanda para kaybetmek anlamına gelen neredeyse sıfır sipariş stratejilerine saplanıyor—ödül tasarımının sınırlarını gösteren gerçek dışı ama bilgilendirici bir uç örnek.

Gerçek dünyadaki karar vericiler için anlamı

Yöneticiler için çalışma, güçlendirmeli öğrenmenin kâr ve karbon emisyonları arasındaki takasları keşfetmek için esnek bir araç olarak hizmet edebileceğini gösteriyor; üstelik bir karbon vergisi veya emisyon ticareti sistemi olmasa bile. PPG, emisyona de önem verirken kârı önceliklendiren firmalar için en uygun görünürken, PPO tercihlerin veya koşulların değiştiği durumlarda en güvenilir dengeyi ve sağlamlığı sunuyor. Hızlı dağıtım ve hızlı öğrenmenin kritik olduğu durumlarda DDQN cazip olabilir ve sınırlı kaynaklarda A2C daha basit bir temel olarak kullanılabilir. Yazarlar modelin talep, tedarik süreleri ve kapasite hakkında basitleştirici varsayımlara dayandığı ve emisyonlara aşırı vurgu yapmanın AI’yı gerçek dışı politikalara itebileceği konusunda uyarıda bulunuyorlar. Gelecek çalışmaların bu varsayımları gevşetmesi ve mümkün olan kâr–emisyon uzlaşmalarının daha geniş bir aralığını araştırması gerektiğini savunuyorlar. Buna rağmen bu çalışma, hem finansal hem de çevresel açıdan daha akıllı stok kararları almak için öğrenme algoritmalarının kullanımına yönelik erken bir yol haritası sunuyor.

Atıf: Sorour, A., Sadek, Y. & Elshalakani, M. Multi-objective inventory optimization using reinforcement learning: a comparative study on profitability and carbon emissions. Sci Rep 16, 13635 (2026). https://doi.org/10.1038/s41598-026-44293-y

Anahtar kelimeler: stok yönetimi, güçlendirmeli öğrenme, karbon emisyonları, sürdürülebilir tedarik zincirleri, çok hedefli optimizasyon