Clear Sky Science · es

Optimización de inventarios multiobjetivo mediante aprendizaje por refuerzo: un estudio comparativo sobre rentabilidad y emisiones de carbono

Por qué este estudio importa para la empresa cotidiana y el planeta

Las empresas modernas se enfrentan a una pregunta difícil: ¿cómo mantener las estanterías abastecidas y a los clientes satisfechos, obtener beneficios saludables y, al mismo tiempo, reducir su huella de carbono? Este artículo explora si un tipo de inteligencia artificial llamado aprendizaje por refuerzo puede ayudar a los gestores a encontrar automáticamente políticas de inventario que, a la vez, generen beneficios y reduzcan las emisiones de gases de efecto invernadero, en lugar de tratar el impacto climático como una consideración secundaria.

Equilibrar ingresos y emisiones liberadas

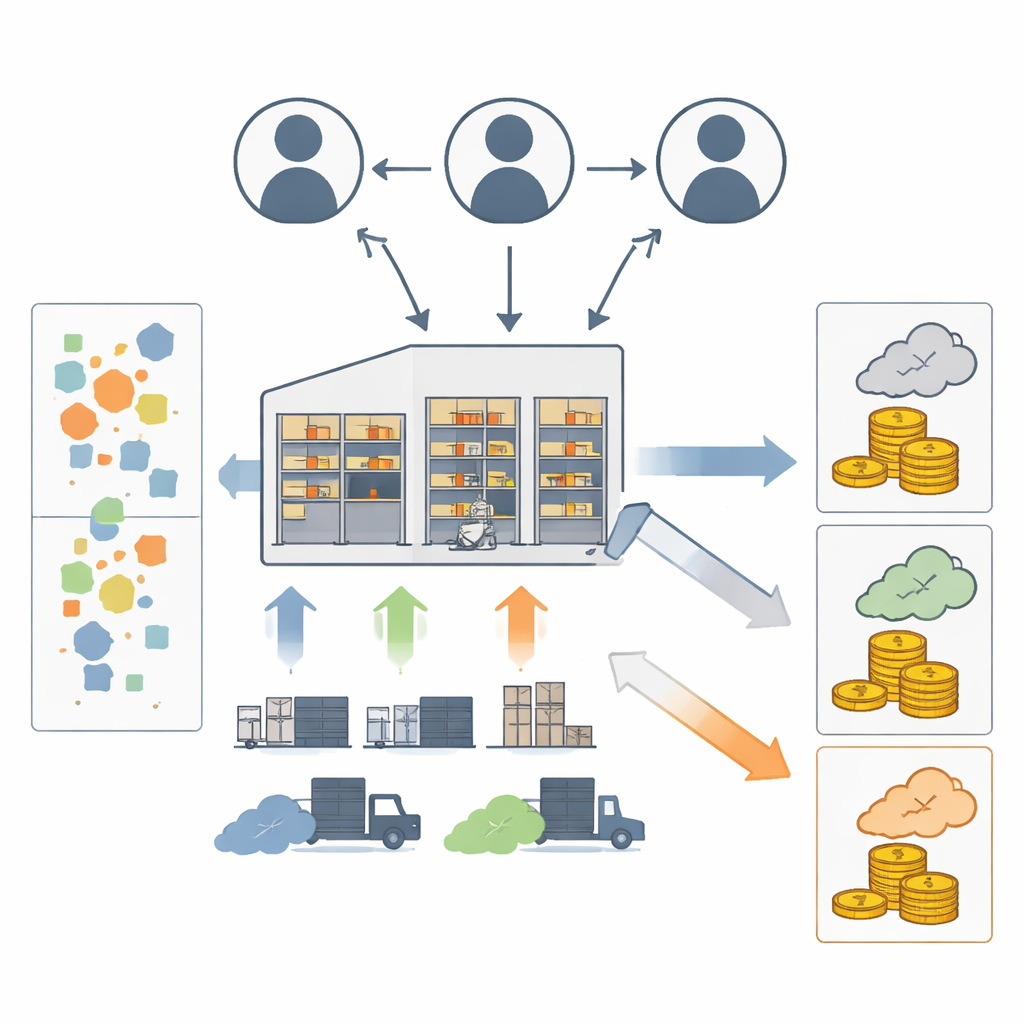

La gestión de inventarios está en el centro de las cadenas de suministro e influye en costes, velocidad de entrega y desperdicio. Tradicionalmente, modelos matemáticos han ayudado a las empresas a decidir cuándo y cuánto pedir. Más recientemente, las preocupaciones por la sostenibilidad han llevado a los investigadores a incluir las emisiones de carbono, a menudo añadiendo penalizaciones o impuestos en las fórmulas de coste. Ese enfoque mezcla dinero y emisiones en una sola medida, lo que oculta cuánto beneficio se está sacrificando por mejoras medioambientales. Este estudio, en cambio, trata el beneficio y el carbono como dos objetivos separados, de modo que su tensión pueda examinarse con claridad. El foco es un único almacén que pide a un proveedor y atiende la demanda de clientes, generando emisiones por el funcionamiento del almacén y por los trayectos en camión.

Enseñar a una IA a gestionar stock en condiciones de incertidumbre

Los autores construyen un almacén simulado donde la demanda de los clientes varía aleatoriamente en el tiempo. En cada paso, un agente de software elige una cantidad de pedido en lotes de tamaño fijo. El entorno registra el inventario disponible, pedidos atrasados, entregas pendientes y el tiempo de entrega. A partir de estos datos calcula ingresos, costes (de pedido, de mantenimiento y penalizaciones por retrasos) y emisiones de carbono por transporte y almacenamiento. El agente recibe una recompensa que combina beneficio y emisiones usando pesos ajustables: el beneficio suma a la recompensa, mientras que las emisiones la restan. Al interactuar repetidamente con este almacén virtual, el agente aprende qué patrones de pedido tienden a producir mejores recompensas a largo plazo.

Comparación de cuatro estrategias de aprendizaje

Se prueban cuatro algoritmos populares de aprendizaje por refuerzo en condiciones idénticas: Proximal Policy Optimization (PPO), Phasic Policy Gradient (PPG), Advantage Actor–Critic (A2C) y Double Deep Q-Network (DDQN). Todos ellos experimentan los mismos patrones de demanda y los mismos parámetros de coste y emisiones. Los investigadores registran la rapidez con la que cada algoritmo “se estabiliza” en una política, cuánto beneficio acumulado obtiene y cuánto carbono produce. También repiten los experimentos con dos patrones de demanda distintos (un rango uniforme amplio y una distribución de Poisson más estrecha) para comprobar si los resultados se mantienen cuando el entorno se vuelve más predecible.

Lo que aprendieron los algoritmos a hacer

La comparación cara a cara revela personalidades distintas para cada método. PPG alcanza de forma consistente el mayor beneficio, a costa de un aumento moderado de emisiones en comparación con sus competidores. PPO ocupa el segundo puesto en beneficio pero ofrece emisiones ligeramente inferiores, proporcionando lo que los autores describen como un intercambio equilibrado entre dinero y carbono. DDQN aprende buenas políticas más rápido que los demás: alcanza la estabilidad en menos episodios de entrenamiento, pero finalmente se decanta por decisiones que generan un beneficio global menor, aunque con emisiones relativamente bajas. A2C queda en una posición intermedia en beneficio mientras tiende a generar las emisiones más altas. Cuando el patrón de demanda se suaviza usando la distribución de Poisson, PPG sigue liderando en beneficio y DDQN continúa siendo el aprendiz más rápido, lo que refuerza las conclusiones principales.

Ajustar prioridades entre objetivos verdes y ganancias

Para imitar diferentes prioridades empresariales, los autores ajustan los pesos que indican al agente cuánto valorar el beneficio frente a las emisiones en su recompensa. Como era de esperar, dar más peso al beneficio conduce a mayores ganancias pero también a más carbono, mientras que enfatizar las emisiones reduce los beneficios. Sin embargo, la reacción de cada algoritmo es diferente. PPO muestra el comportamiento más estable y predecible a través de las distintas configuraciones de pesos, manteniendo beneficios y emisiones razonables. PPG tiende a agruparse en soluciones de alto beneficio con sensibilidad limitada a pequeños cambios en los pesos. DDQN y A2C muestran cambios más irregulares en su rendimiento. Cuando las emisiones reciben un peso extremo, todos los algoritmos caen en estrategias de pedir casi cero unidades que evitan emisiones pero también pierden dinero: un caso extremo poco realista pero informativo que muestra los límites del diseño de la recompensa.

Qué significa esto para los responsables de la toma de decisiones en el mundo real

Para los gestores, el estudio sugiere que el aprendizaje por refuerzo puede servir como una herramienta flexible para explorar los equilibrios entre beneficios y emisiones de carbono, incluso cuando no existe un impuesto al carbono o un sistema de mercado de emisiones. PPG parece más adecuado para empresas que priorizan el beneficio sin dejar de preocuparse por las emisiones, mientras que PPO ofrece el equilibrio más fiable y la mayor robustez cuando las preferencias o las condiciones cambian. DDQN puede resultar atractivo cuando el despliegue rápido y el aprendizaje veloz son cruciales, y A2C puede servir como una línea base más sencilla en entornos con recursos limitados. Los autores advierten que su modelo se basa en supuestos simplificadores sobre la demanda, los tiempos de entrega y la capacidad, y que un énfasis extremo en las emisiones puede empujar a la IA hacia políticas irreales. Proponen que trabajos futuros relajen estas suposiciones y exploren más a fondo el rango de posibles compromisos entre beneficio y emisiones. Aun así, este estudio ofrece una hoja de ruta inicial para usar algoritmos de aprendizaje en la toma de decisiones de inventario que sean, a la vez, financieramente y medioambientalmente más inteligentes.

Cita: Sorour, A., Sadek, Y. & Elshalakani, M. Multi-objective inventory optimization using reinforcement learning: a comparative study on profitability and carbon emissions. Sci Rep 16, 13635 (2026). https://doi.org/10.1038/s41598-026-44293-y

Palabras clave: gestión de inventarios, aprendizaje por refuerzo, emisiones de carbono, cadenas de suministro sostenibles, optimización multiobjetivo