Clear Sky Science · he

אופטימיזציה רב-מטרית של מלאי באמצעות למידה בחיזוק: מחקר השוואתי על רווחיות ופליטת פחמן

מדוע המחקר הזה חשוב לעסקים יומיומיים ולכדור הארץ

חברות מודרניות מתמודדות עם שאלה קשה: כיצד לשמור על מדפים מלאים ולשמור על שביעות רצון לקוחות, להרוויח דיו ומהצד השני להקטין את טביעת הרגל הפחמנית? מאמר זה בוחן האם סוג של בינה מלאכותית המכונה למידה בחיזוק יכול לעזור למנהלים למצוא אוטומטית מדיניות מלאי שממקסמת הן רווחים והן הפחתת פליטות גזי חממה, במקום להתייחס להשפעה על האקלים כעניין משני.

איזון בין רווחים לפליטות

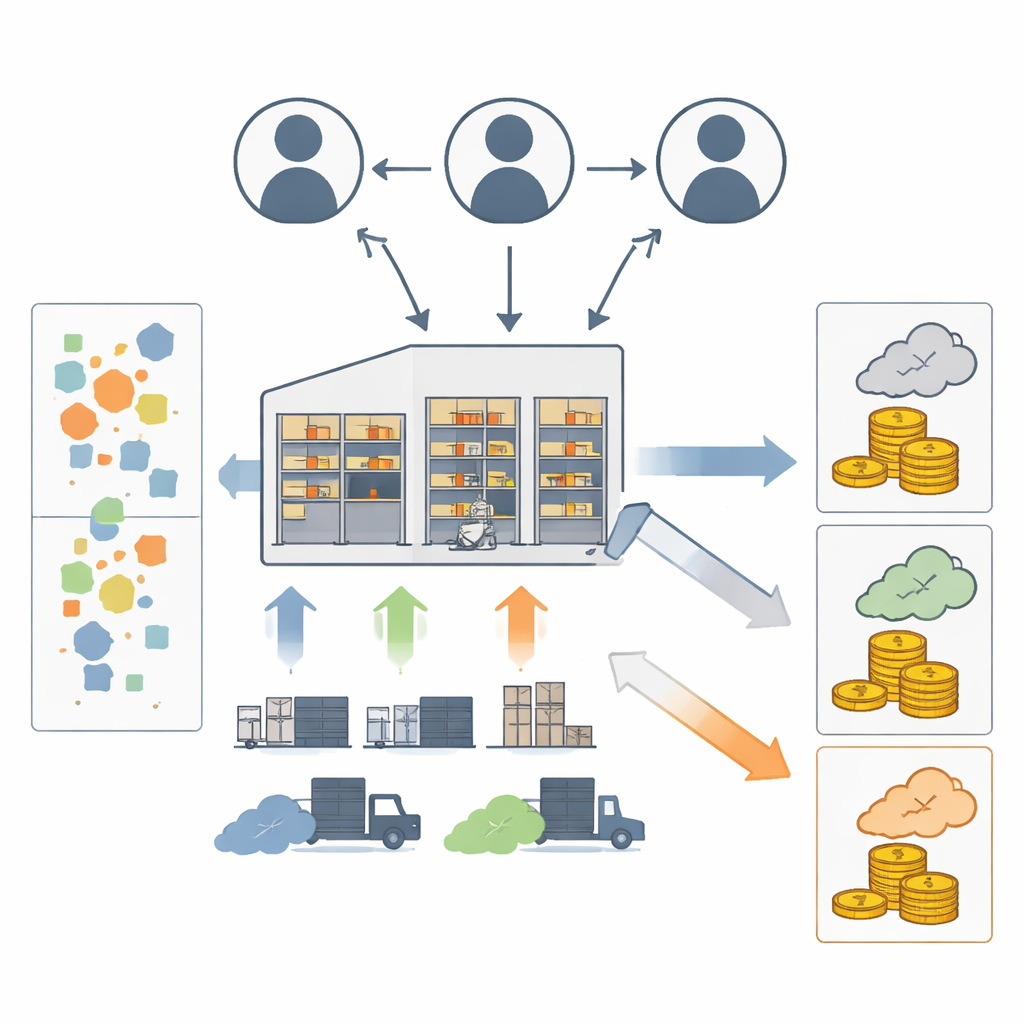

ניהול מלאי נמצא בלב שרשראות האספקה ומושפע עלויות, מהירות אספקה ובזבוז. באופן מסורתי מודלים מתמטיים סייעו לחברות להחליט מתי וכמה להזמין. בשנים האחרונות דאגות הקיימות דחפו חוקרים להכניס פליטות פחמן לשיקולי עלות, לעתים באמצעות קנסות או מיסים במשוואות העלות. גישה זו מערבבת כסף ופליטות למדד יחיד, מה שמסתיר את הוויתור על רווחים עבור השגת תועלות סביבתיות. מחקר זה, לעומת זאת, מתייחס לרווח ולפחמן כשתי מטרות נפרדות, כדי לבחון את המתיחות ביניהן באופן ברור. המודל מתמקד במחסן יחיד שמזמין מספק ומספק דרישת לקוחות, כשהוא מייצר פליטות מפעילות המחסן ומנסיעות משאיות.

להדריך בינה מלאכותית לנהל מלאי תחת אי-וודאות

המחברים בונים סימולציה של מחסן שבו דרישת הלקוחות משתנה באקראי לאורך זמן. בכל שלב סוכן תוכנה בוחר כמות הזמנה באצוות בגדלים קבועים. הסביבה עוקבת אחרי מלאי זמין, הזמנות בגירעון, משלוחים ממתינים וזמן אספקה. מהנתונים האלה היא מחשבת הכנסות, עלויות (הזמנה, אחסון וקנסות עבור גירעונות) ופליטות פחמן מתחבורה ואחסון. הסוכן מקבל תגמול שמאחד רווח ופליטות באמצעות משקלים ניתנים לכוונון: רווח מוסיף לתגמול ואילו פליטות מנכות ממנו. באמצעות אינטראקציה חוזרת עם המחסן הווירטואלי הסוכן לומד אילו דפוסי הזמנה נוטים להניב תגמולים ארוכי-טווח טובים יותר.

השוואה בין ארבע אסטרטגיות למידה

נבדקות ארבע אלגוריתמי למידה בחיזוק פופולריים בתנאים זהים: Proximal Policy Optimization (PPO), Phasic Policy Gradient (PPG), Advantage Actor–Critic (A2C) ו-Double Deep Q-Network (DDQN). כל האלגוריתמים נחשפים לדפוסי דרישה זהים ולפרמטרים של עלות ופליטה. החוקרים עוקבים כמה מהר כל אלגוריתם "מתייצב" למדיניות יציבה, כמה רווח מצטבר הוא מרוויח וכמה פחמן מיוצר. הם משחזרים ניסויים תחת שני דפוסי דרישה שונים (טווח אחיד רחב והתפלגות פואסון צנועה יותר) כדי לבדוק האם המסקנות עומדות כאשר הסביבה נהיית צפויה יותר.

מה האלגוריתמים למדו לעשות

ההשוואה הגילתה אופי שונה לכל שיטה. PPG משיגה בעקביות את הרווח הגבוה ביותר, במחיר של עלייה מתונה בלבד בפליטות יחסית למתחרים. PPO מדורגת שנייה מבחינת רווח אך מספקת פליטות מעט נמוכות יותר, ומציעה מה שהמחברים מתארים כפשרה מאוזנת בין כסף לפחמן. DDQN לומדת מדיניות טובות מהר יותר מהאחרות—היא מגיעה ליציבות במספר פרקי אימון קטן יותר—אבל בסופו של דבר בוחרת החלטות שמניבות רווח כולל נמוך יותר, אם כי עם פליטות יחסית נמוכות. A2C נמצאת באמצע מבחינת רווח אך נוטה לייצר את הפליטות הגבוהות ביותר. כאשר דפוס הדרישה מתחלף להתפלגות פואסון החלקה, PPG נשארת מובילת הרווח ו-DDQN נשארת הלומדת המהירה, מה שמחזק את המסקנות המרכזיות.

כוונון עדיפויות בין מטרות ירוקות להכנסות

כדי לדמות עדיפויות עסקיות שונות, המחברים מכוונים את המשקלים שקובעים כמה הסוכן מעריך רווח לעומת פליטות בתגמולו. כמצופה, מתן משקל גבוה יותר לרווח מוביל להכנסות גבוהות יותר אך גם לעלייה בפליטות, בעוד הדגשת פליטות מורידה רווחים. עם זאת, האופן שבו כל אלגוריתם מגיב שונה. PPO מציג את ההתנהגות היציבה והצפויה ביותר על פני הגדרות המשקלים, תוך שמירה על רווחים ופליטות סבירים. PPG נוטה להתרכז בפתרונות בעלי רווח גבוה עם רגישות מוגבלת לשינויים קטנים במשקלים. DDQN ו-A2C מציגים שינויים לא סדירים יותר בביצועים. כאשר משקל הפליטות קיצוני, כל האלגוריתמים נופלים לאסטרטגיות כמעט של אי-הזמנה שמונעות פליטות אך גם מפסידות כסף—מקרה קיצוני שלא מציאותי אך אינפורמטיבי לגבי מגבלות עיצוב התגמול.

מה זה אומר עבור מקבלי ההחלטות בעולם האמיתי

עבור מנהלים, הממצאים מציעים שלמידה בחיזוק יכולה לשמש ככלי גמיש לחקירת פשרות בין רווחים ופליטות פחמן, אפילו כאשר אין מס פחמן או מערכת סחר בפחמן. PPG נראה מתאים יותר לחברות שמעמידות בעדיפות רווח תוך שמירה על דאגה לפליטות, בעוד PPO מציע את האיזון האמין והחוסן הגבוה ביותר כאשר העדפות או תנאים משתנים. DDQN עשוי להתאים כאשר פריסה מהירה ולמידה מהירה הן קריטיות, ו-A2C יכול לשמש כקו בסיס פשוט יותר בהקשרים עם משאבים מוגבלים. המחברים מזהירים שהמודל שלהם נשען על הנחות פישוט לגבי דרישה, זמני אספקה וקיבולת, וכי הדגשה קיצונית של פליטות עלולה לדחוף את ה-AI למדיניות לא מציאותית. הם טוענים שעבודה עתידית צריכה להרפות הנחות אלה ולחפש באופן מלא יותר את טווח הפשרות האפשריות בין רווח לפליטות. עם זאת, המחקר מספק מפת דרכים מוקדמת לשימוש באלגוריתמי למידה בקבלת החלטות מלאי שתהיינה חכמות יותר כלכלית וסביבתית.

ציטוט: Sorour, A., Sadek, Y. & Elshalakani, M. Multi-objective inventory optimization using reinforcement learning: a comparative study on profitability and carbon emissions. Sci Rep 16, 13635 (2026). https://doi.org/10.1038/s41598-026-44293-y

מילות מפתח: ניהול מלאי, למידה בחיזוק, פליטות פחמן, שרשראות אספקה ברות-קיימא, אופטימיזציה רב-מטרית