Clear Sky Science · ja

強化学習を用いた多目的在庫最適化:収益性と炭素排出に関する比較研究

この研究が日常のビジネスと地球にとって重要な理由

現代の企業は難しい問いに直面しています:棚を埋めて顧客を満足させ、健全な利益を確保しつつ、同時に炭素排出を削減するにはどうすればよいか。本論文は、強化学習と呼ばれる人工知能の一種が、気候影響を後回しにするのではなく、利益を上げつつ温室効果ガス排出を削減するような在庫ポリシーを自動的に見つけられるかを検証します。

収益と排出のバランス

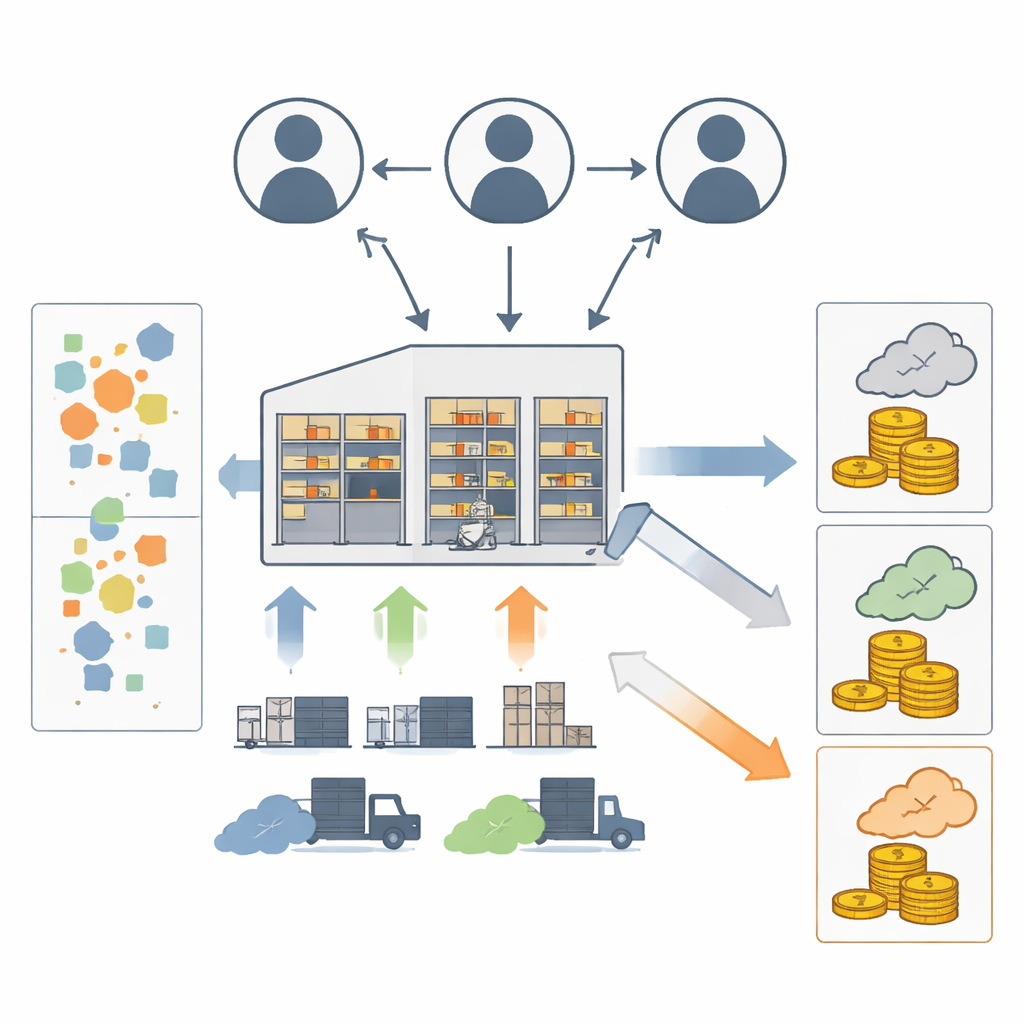

在庫管理はサプライチェーンの中心にあり、コスト、配送速度、廃棄に影響します。従来は数学モデルが、いつどれだけ発注するかを決める助けとなってきました。近年は持続可能性への関心から、炭素排出をコスト式に罰則や税として組み込む研究が増えています。しかしその方法は収益と排出を単一の尺度に混ぜてしまい、どれだけの利益が環境改善のために犠牲になっているかが見えにくくなります。本研究では代わりに収益と炭素を別々の目的として扱い、そのトレードオフを明確に検討します。対象は、サプライヤーから発注し顧客需要に応える単一倉庫で、倉庫運営とトラック輸送から排出が発生します。

不確実性下で在庫を管理するAIの学習

著者らは、顧客需要が時間とともにランダムに変動する模擬倉庫を構築します。各ステップでエージェントは定量バッチで発注量を選択します。環境は手持ち在庫、バックログ、配送待ち、リードタイムなどを追跡し、そこから収益、コスト(発注・保管・バックオーダー罰則)および輸送と保管による炭素排出を算出します。エージェントは収益と排出を調整可能な重みで組み合わせた報酬を受け取ります:収益は報酬を増やし、排出は差し引かれます。この仮想倉庫と繰り返し相互作用することで、長期的に高い報酬を生む発注パターンをエージェントが学習します。

4つの学習戦略の比較

同一条件下で4つの代表的な強化学習アルゴリズムを検証します:Proximal Policy Optimization(PPO)、Phasic Policy Gradient(PPG)、Advantage Actor–Critic(A2C)、および Double Deep Q-Network(DDQN)。いずれも同じ需要パターンとコスト・排出パラメータを与えられます。研究者らは各アルゴリズムが安定した方策にどれだけ速く到達するか、累積収益がどれほどか、総炭素排出がどれほどかを追跡します。また、環境がより予測可能になる場合に結果が維持されるかを確認するため、広い一様分布と狭いポアソン分布の2種類の需要パターンで実験を繰り返します。

アルゴリズムが学んだこと

直接比較により、各手法の特徴が明らかになります。PPGは一貫して最高の収益を達成しますが、それは他手法に比べてわずかな排出増を伴います。PPOは収益で2位ですが、やや低い排出を示し、著者が述べるように収益と炭素のバランスが良い選択肢です。DDQNは他よりも短い学習エピソードで安定に到達し、学習の速さが際立ちますが、最終的には全体収益が低めで比較的低い排出に落ち着きます。A2Cは収益で中間に位置しつつ、最も高い排出を生む傾向がありました。需要パターンをポアソン分布で平滑化しても、PPGが収益首位、DDQNが最速学習者という主要な結論は変わりませんでした。

環境目標と収益の優先度調整

ビジネス上の異なる優先順位を模倣するため、著者らは報酬内で収益と排出の重みを調整します。予想通り、収益の重みを高くすると収益は上がるが炭素も増え、排出の重みを重視すると収益は下がります。ただし各アルゴリズムの反応の仕方は異なります。PPOは重み設定の変化に対して最も安定的で予測可能な振る舞いを示し、合理的な収益と排出を維持します。PPGは高収益の解に集中的に落ち着きやすく、重みの小さな変化に対する感度が低い傾向があります。DDQNとA2Cは性能の変動がより不規則です。排出に極端な重みを与えると、すべてのアルゴリズムがほぼ発注を行わない戦略に陥り、排出を回避する一方で収益を失います—これは非現実的ながら報酬設計の限界を示す示唆に富むエッジケースです。

現場の意思決定者への示唆

マネージャーにとって、本研究は強化学習が炭素排出と収益のトレードオフを探索する柔軟なツールになり得ることを示唆します。PPGは収益を重視しつつ排出も気にする企業に向き、PPOは嗜好や状況が変わっても最も信頼できるバランスと堅牢性を提供します。迅速な導入と学習速度が重要な場合はDDQNが魅力的であり、A2Cはリソースの限られた環境での簡便なベースラインとなり得ます。著者らはモデルが需要、リードタイム、能力に関して単純化した仮定に依存している点と、排出を極端に重視するとAIが非現実的な方策に傾く可能性を注意喚起しています。将来の研究ではこれらの仮定を緩め、収益と排出の妥協点をより広く探索すべきだと主張します。それでも、本研究は学習アルゴリズムを用いて財務的かつ環境的により賢明な在庫判断を行うための初期のロードマップを提供しています。

引用: Sorour, A., Sadek, Y. & Elshalakani, M. Multi-objective inventory optimization using reinforcement learning: a comparative study on profitability and carbon emissions. Sci Rep 16, 13635 (2026). https://doi.org/10.1038/s41598-026-44293-y

キーワード: 在庫管理, 強化学習, 炭素排出, 持続可能なサプライチェーン, 多目的最適化