Clear Sky Science · ar

تحسين المخزون متعدد الأهداف باستخدام التعلم المعزز: دراسة مقارنة على الربحية وانبعاثات الكربون

لماذا تهم هذه الدراسة الأعمال اليومية والكوكب

تواجه الشركات الحديثة سؤالاً صعباً: كيف تحافظ على رفوف ممتلئة ورضا العملاء، وتحقق أرباحاً جيدة، وفي الوقت نفسه تقلل بصمتها الكربونية؟ تستقصي هذه الورقة ما إذا كان نوع من الذكاء الاصطناعي يُسمى التعلم المعزز يمكنه مساعدة المديرين في العثور تلقائياً على سياسات مخزون تحقق الأرباح وتخفض انبعاثات غازات الاحتباس الحراري معاً، بدلاً من التعامل مع تأثير المناخ كأمر ثانوي.

موازنة الأرباح مع الانبعاثات

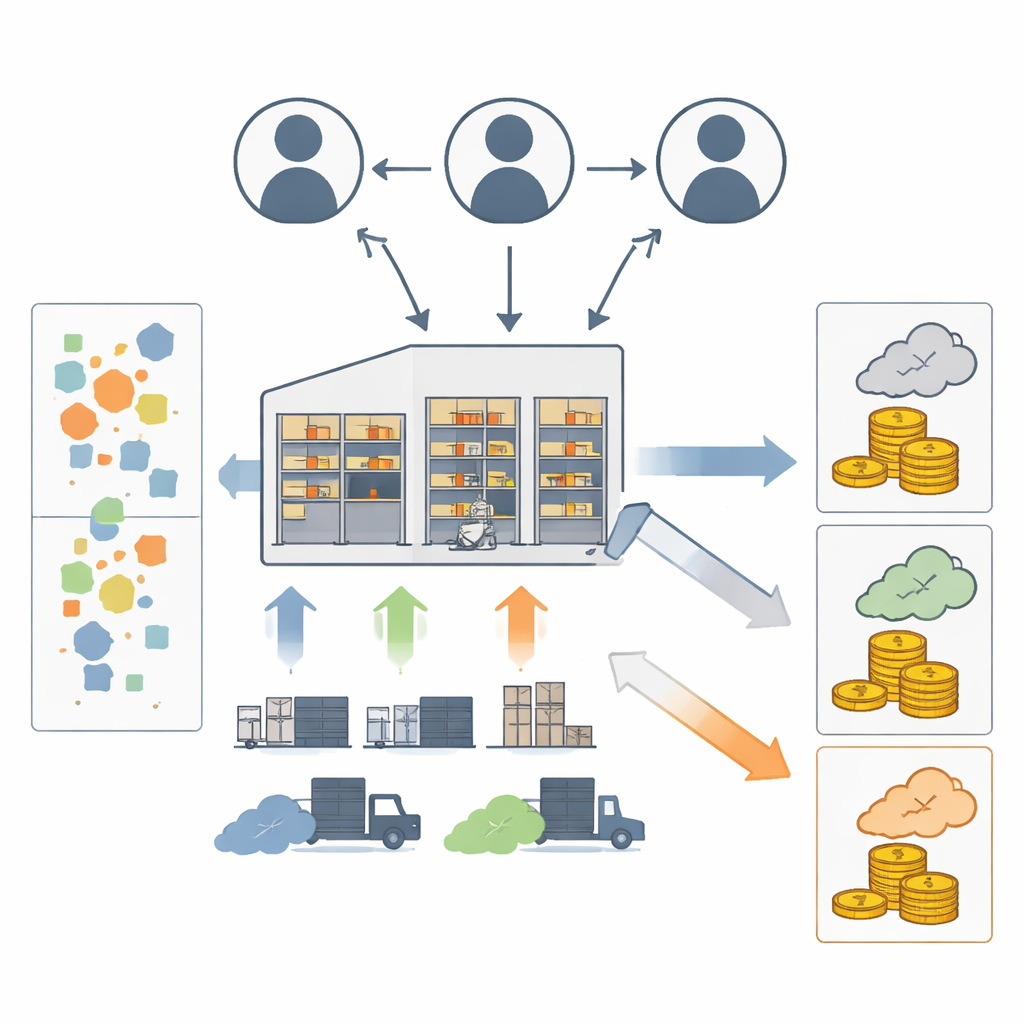

تقع إدارة المخزون في قلب سلاسل التوريد، فهي تؤثر في التكاليف وسرعة التسليم والهدر. تقليدياً، ساعدت النماذج الرياضية الشركات على تقرير متى وبكمية كم تطلب المواد. في الآونة الأخيرة، دفعت مخاوف الاستدامة الباحثين لإدراج انبعاثات الكربون، غالباً بإضافة عقوبات أو ضرائب في صيغ التكلفة. يمزج هذا النهج بين المال والانبعاثات في مقياس واحد، ما يخفي مقدار الأرباح المتنازل عنها لتحقيق مكاسب بيئية. تتعامل هذه الدراسة بدلاً من ذلك مع الربح والكربون كهدفين منفصلين، حتى يمكن فحص التوتر بينهما بوضوح. يركز البحث على مستودع واحد يطلب من مورد ويخدم طلبات العملاء، بينما تنشأ الانبعاثات من تشغيل المستودع ومن رحلات الشاحنات.

تعليم الذكاء الاصطناعي إدارة المخزون تحت عدم اليقين

يبني المؤلفون مستودعاً محاكياً حيث يتغير طلب العملاء بصورة عشوائية مع الزمن. في كل خطوة، يختار وكيل برمجي كمية طلب على دفعات بحجم ثابت. يتتبع البيئة المخزون المتاح والطلبات المتأخرة والتسليمات المعلقة وزمن التوريد. ومن هذه المعطيات تحسب الإيرادات والتكاليف (تكاليف الطلب والتخزين وعقوبات الطلب المتأخر) وانبعاثات الكربون من النقل والتخزين. يتلقى الوكيل مكافأة تجمع بين الربح والانبعاثات باستخدام أوزان قابلة للتعديل: يضيف الربح إلى المكافأة بينما تخصم الانبعاثات منها. من خلال التفاعل المتكرر مع هذا المستودع الافتراضي، يتعلم الوكيل أنماط الطلب التي تميل إلى إنتاج مكافآت أفضل على المدى الطويل.

مقارنة أربع استراتيجيات تعلم

تُختبر أربع خوارزميات شائعة في التعلم المعزز تحت شروط متطابقة: التحسين السياسي التقريبي (PPO)، وانحدار السياسة الطوري (PPG)، والممثل–الناقد المفضل (A2C)، وشبكة Q العميقة المزدوجة (DDQN). كل الخوارزميات تواجه نفس أنماط الطلب ومعلمات التكلفة والانبعاث. يتتبع الباحثون مدى سرعة «استقرار» كل خوارزمية إلى سياسة ثابتة، وكم من الربح التراكمي تحقق، وكم من الكربون تنتج. يكررون أيضاً التجارب تحت نمطين مختلفين للطلب (نطاق موحد واسع وتوزيع بواسون أضيق) للتحقق مما إذا كانت النتائج ثابتة عندما يصبح البيئة أكثر قابلية للتنبؤ.

ما الذي تعلمته الخوارزميات أن تفعله

يكشف المقارنة وجهاً لوجه عن شخصيات مميزة لكل طريقة. تحقق PPG أعلى مستوى ربح باستمرار، مقابل زيادة طفيفة فقط في الانبعاثات مقارنة بالمنافسين. تأتي PPO في المرتبة الثانية من حيث الربح لكنها تنتج انبعاثات أقل قليلاً، مقدمة ما يصفه المؤلفون بأنه مقايضة متوازنة بين المال والكربون. تتعلم DDQN سياسات جيدة بسرعة أكبر من البقية—تصل إلى الاستقرار في عدد أقل من حلقات التدريب—ولكنها في النهاية تستقر على قرارات تولد ربحاً أقل إجمالاً، رغم أن انبعاثاتها منخفضة نسبياً. يقع A2C في منتصف نطاق الأرباح بينما يميل إلى توليد أعلى الانبعاثات. عندما يُملَس نمط الطلب باستخدام توزيع بواسون، تبقى PPG في الصدارة من حيث الربح وتظل DDQN الأسرع تعلمًا، ما يعزز الاستنتاجات الرئيسية.

ضبط الأولويات بين الأهداف البيئية والأرباح

لمحاكاة أولويات تجارية مختلفة، يضيف المؤلفون أوزاناً تُخبر الوكيل بمدى تقديره للربح مقابل الانبعاثات في مكافأته. كما هو متوقع، يؤدي وضع وزن أكبر على الربح إلى أرباح أعلى لكنه أيضاً يزيد الكربون، بينما يؤدي التأكيد على الانبعاثات إلى خفض الأرباح. ومع ذلك، تختلف استجابة كل خوارزمية. تُظهر PPO السلوك الأكثر استقراراً وتوقعاً عبر إعدادات الأوزان، محافظةً على أرباح وانبعاثات معقولة. تميل PPG إلى التجمع حول حلول ذات ربح مرتفع مع حساسية محدودة للتغيرات الصغيرة في الأوزان. تظهر DDQN وA2C تغيُّرات أكثر عدم انتظام في الأداء. عندما تُعطى الانبعاثات وزنًا متطرفًا، تقع كل الخوارزميات تقريباً في استراتيجيات عدم الطلب التي تتجنب الانبعاثات لكنها تخسر المال—حالة هامشية غير واقعية لكنها مفيدة لتوضيح حدود تصميم المكافأة.

ما الذي يعنيه هذا لصانعي القرار في العالم الحقيقي

بالنسبة للمديرين، تشير الدراسة إلى أن التعلم المعزز يمكن أن يكون أداة مرنة لاستكشاف المقايضات بين الأرباح وانبعاثات الكربون، حتى عندما لا يوجد ضريبة كربون أو نظام تجارة انبعاثات. تبدو PPG الأنسب للشركات التي تعطي الأولوية للربح مع مراعاة الانبعاثات، في حين تقدم PPO التوازن والأكثر موثوقية والمرونة عند تغير التفضيلات أو الظروف. قد تجذب DDQN عندما يكون الطرح السريع والتعلم السريع أمرين حاسمين، ويمكن أن يعمل A2C كمرجع أبسط في بيئات محدودة الموارد. يحذر المؤلفون من أن نموذجهم يعتمد على فروض تبسيطية حول الطلب وأزمنة التوريد والقدرات، وأن التركيز المفرط على الانبعاثات قد يدفع الذكاء الاصطناعي إلى سياسات غير واقعية. ويؤكدون أن الأعمال المستقبلية ينبغي أن تُرخِّص هذه الفروض وتبحث بشكل أوسع في نطاق مقايضات الربح–الانبعاث. ومع ذلك، توفر هذه الدراسة خارطة طريق مبكرة لاستخدام خوارزميات التعلم لاتخاذ قرارات مخزون أكثر ذكاءً مالياً وبيئياً.

الاستشهاد: Sorour, A., Sadek, Y. & Elshalakani, M. Multi-objective inventory optimization using reinforcement learning: a comparative study on profitability and carbon emissions. Sci Rep 16, 13635 (2026). https://doi.org/10.1038/s41598-026-44293-y

الكلمات المفتاحية: إدارة المخزون, التعلم المعزز, انبعاثات الكربون, سلاسل التوريد المستدامة, التحسين متعدد الأهداف