Clear Sky Science · ru

Многокритериальная оптимизация запасов с помощью обучения с подкреплением: сравнительное исследование прибыльности и выбросов углерода

Почему это исследование важно для бизнеса и планеты

Современные компании сталкиваются со сложной задачей: как одновременно поддерживать заполненные полки и довольных клиентов, обеспечивать солидную прибыль и при этом сокращать углеродный след? В этой работе исследуется, может ли тип искусственного интеллекта — обучение с подкреплением — помочь менеджерам автоматически находить политики управления запасами, которые одновременно приносят прибыль и уменьшают выбросы парниковых газов, вместо того чтобы рассматривать климатическое воздействие как второстепенный фактор.

Баланс между доходом и выбросами

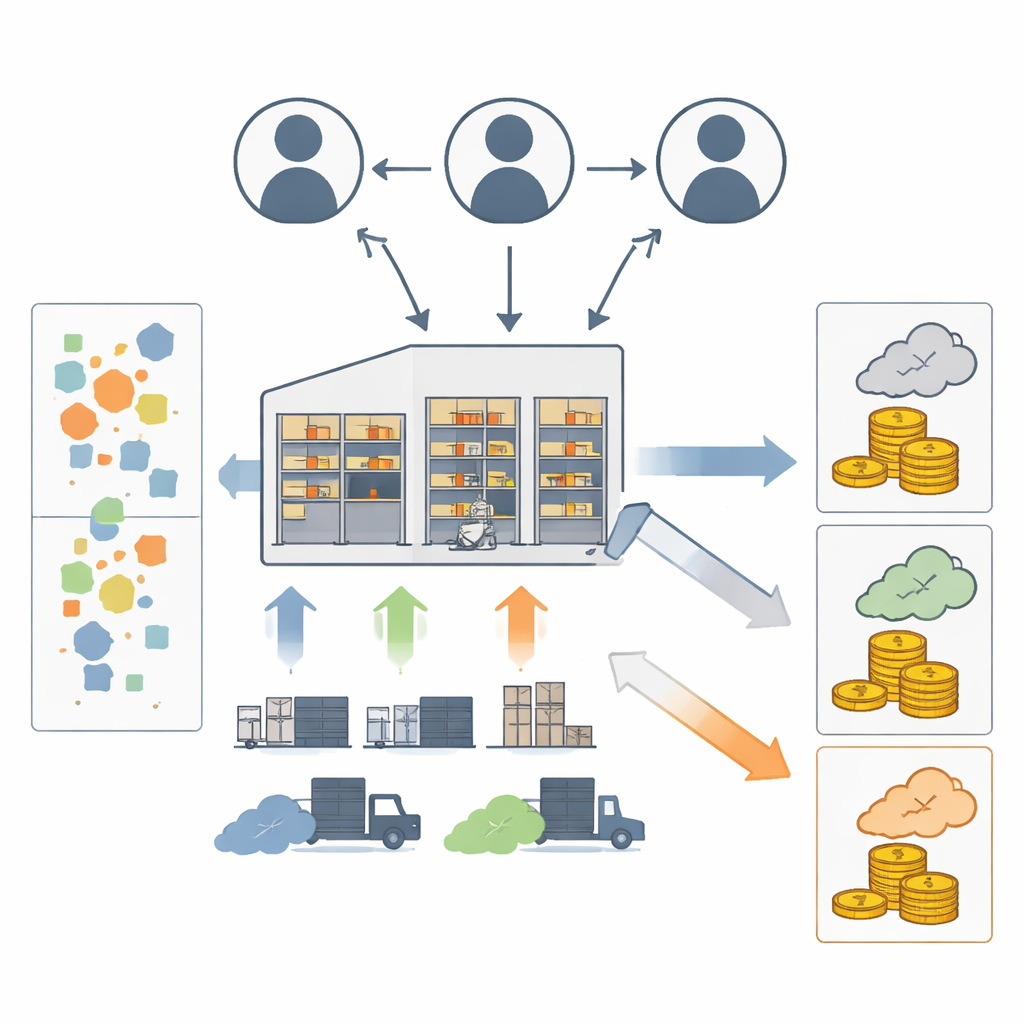

Управление запасами находится в центре цепочек поставок, влияя на затраты, скорость доставки и количество отходов. Традиционно фирмы использовали математические модели, чтобы решать, когда и сколько заказывать. В последнее время вопросы устойчивости подтолкнули исследователей включать выбросы углерода, часто добавляя штрафы или налоги в формулы затрат. Такой подход сводит деньги и выбросы в единый показатель, что скрывает, насколько прибыль жертвуется ради экологических выгод. В этом исследовании прибыль и углерод рассматриваются как две отдельные цели, чтобы их противоречие можно было явно изучить. В центре внимания — один склад, который заказывает у поставщика и обслуживает спрос клиентов, при этом выбросы генерируются как от работы склада, так и от транпортных рейсов.

Обучение ИИ управлению запасами при неопределённости

Авторы создают имитируемый склад, где спрос клиентов случайно меняется со временем. На каждом шаге программный агент выбирает количество заказа с кратностью фиксированных партий. Окружение отслеживает наличные запасы, отложенные заказы, ожидающие поставки и время выполнения заказа. На их основе вычисляются выручка, затраты (за заказы, хранение и штрафы за нехватку) и выбросы углерода от транспорта и хранения. Агент получает награду, которая комбинирует прибыль и выбросы с помощью настраиваемых весов: прибыль увеличивает награду, а выбросы её уменьшают. Многократное взаимодействие с виртуальным складом позволяет агенту выучить модели заказов, которые в долгосрочной перспективе дают лучшие суммарные награды.

Сравнение четырёх стратегий обучения

При идентичных условиях протестированы четыре популярных алгоритма обучения с подкреплением: Proximal Policy Optimization (PPO), Phasic Policy Gradient (PPG), Advantage Actor–Critic (A2C) и Double Deep Q-Network (DDQN). Все они видят одинаковые паттерны спроса и параметры затрат и выбросов. Исследователи отслеживают, как быстро каждый алгоритм «устаканивается» в стабильную политику, какую совокупную прибыль он приносит и сколько углерода производит. Эксперименты также повторяются при двух разных моделях спроса (широкий равномерный диапазон и более узкое распределение Пуассона), чтобы проверить устойчивость результатов при повышении предсказуемости среды.

Чему алгоритмы научились

Прямое сравнение выявляет отличительные «характеры» каждого метода. PPG стабильно достигает самой высокой прибыли, с ценой в виде лишь умеренного роста выбросов по сравнению с конкурентами. PPO занимает второе место по прибыли, при этом даёт немного меньшие выбросы, предлагая авторам сбалансированный компромисс между деньгами и углеродом. DDQN учится быстрее остальных — он достигает стабильности за меньшее число эпизодов обучения — но в конечном итоге сходится к решениям с более низкой общей прибылью, хотя и с относительно низкими выбросами. A2C находится в середине по прибыли, при этом склонен порождать наибольшие выбросы. При сглаживании паттерна спроса распределением Пуассона PPG остаётся лидером по прибыли, а DDQN — самым быстрым обучаемым, что подкрепляет основные выводы.

Настройка приоритетов между экологией и доходами

Чтобы смоделировать разные бизнес‑приоритеты, авторы варьируют веса, которые указывают агенту, насколько ценить прибыль по сравнению с выбросами в награде. Как и ожидалось, увеличение веса прибыли ведёт к росту заработка, но и к большему объёму выбросов, тогда как акцент на выбросах понижает прибыль. Однако реакции алгоритмов различаются. PPO демонстрирует наиболее стабильное и предсказуемое поведение при разных настройках весов, поддерживая разумные уровни прибыли и выбросов. PPG склонен концентрироваться на решениях с высокой прибылью и слабо реагирует на небольшие изменения весов. DDQN и A2C проявляют более нерегулярные сдвиги в показателях. При экстремально высоком весе выбросов все алгоритмы сводятся к почти полной стратегии отказа от заказов, что позволяет избежать выбросов, но приводит к убыткам — нереалистичный, но информативный крайний случай, показывающий пределы дизайна награды.

Что это означает для практических решений

Для менеджеров исследование указывает, что обучение с подкреплением может служить гибким инструментом для изучения компромиссов между прибылью и выбросами, даже когда отсутствуют углеродные налоги или системы торговли выбросами. PPG кажется наиболее подходящим для компаний, которые ставят в приоритет прибыль, но всё ещё заботятся о выбросах; в то время как PPO предлагает наиболее надёжный баланс и устойчивость при изменении предпочтений или условий. DDQN может привлекать, когда важна быстрая развертка и быстрое обучение, а A2C служит простым базовым вариантом в условиях ограниченных ресурсов. Авторы предупреждают, что их модель опирается на упрощающие допущения о спросе, времени выполнения заказов и ёмкости, и что экстремальный акцент на выбросах может привести ИИ к нереалистичным политикам. Они предлагают в дальнейшем ослабить эти допущения и более полно исследовать множество возможных компромиссов между прибылью и выбросами. Тем не менее это исследование даёт раннюю дорожную карту по использованию алгоритмов обучения для принятия решений по запасам, которые одновременно умнее с финансовой и экологической точек зрения.

Цитирование: Sorour, A., Sadek, Y. & Elshalakani, M. Multi-objective inventory optimization using reinforcement learning: a comparative study on profitability and carbon emissions. Sci Rep 16, 13635 (2026). https://doi.org/10.1038/s41598-026-44293-y

Ключевые слова: управление запасами, обучение с подкреплением, выбросы углерода, устойчивые цепочки поставок, многокритериальная оптимизация