Clear Sky Science · nl

Multi-objectieve voorraadoptimalisatie met reinforcement learning: een vergelijkende studie over winstgevendheid en CO2-uitstoot

Waarom deze studie ertoe doet voor bedrijven en de planeet

Moderne bedrijven staan voor een lastige vraag: hoe kunnen ze schappen gevuld houden en klanten tevreden stellen, gezonde winsten behalen en tegelijkertijd hun CO2-voetafdruk verminderen? Dit artikel onderzoekt of een vorm van kunstmatige intelligentie, reinforcement learning, managers kan helpen automatisch voorraadbeleid te vinden dat zowel winstgevend is als de uitstoot vermindert, in plaats van klimaatimpact als bijzaak te behandelen.

Balanceren van verdiend geld en uitgestoten emissies

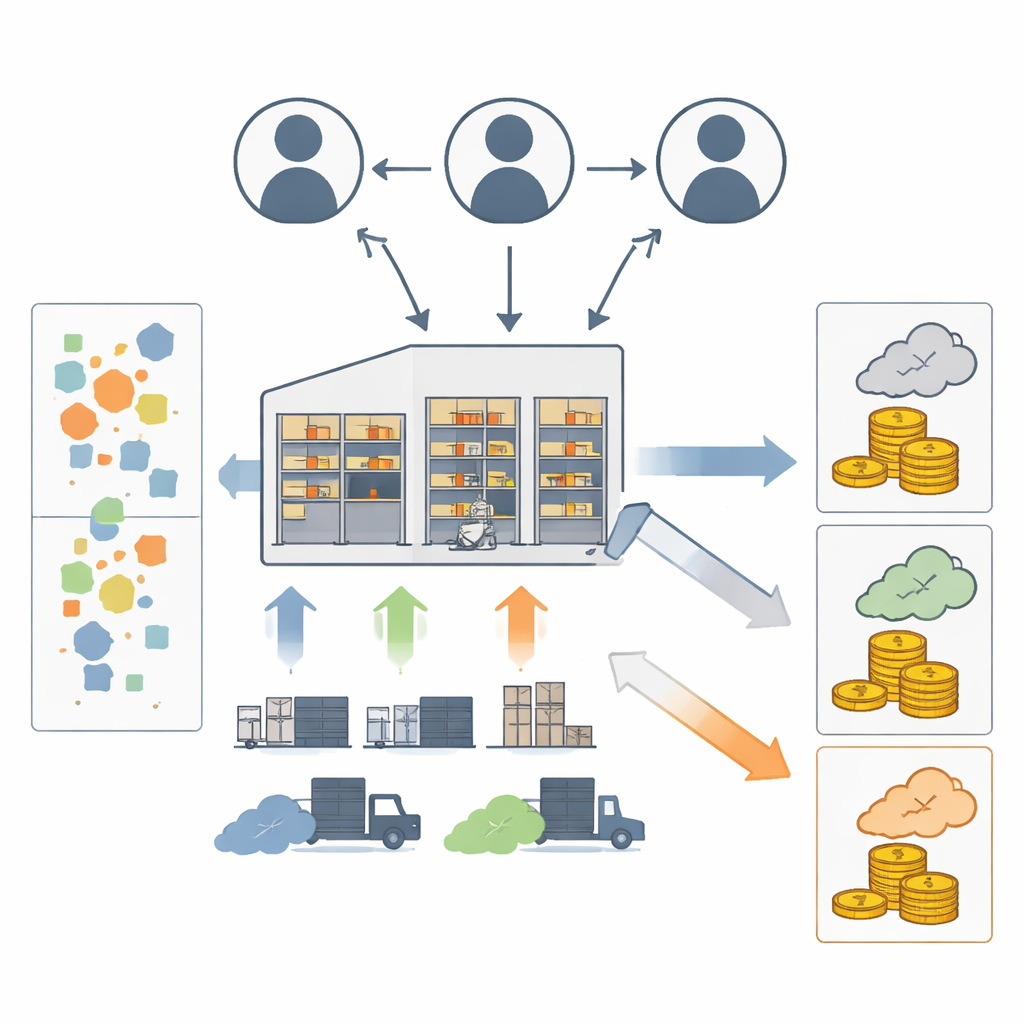

Voorraadbeheer staat centraal in toeleveringsketens en beïnvloedt kosten, levertijden en verspilling. Traditioneel helpen wiskundige modellen bedrijven beslissen wanneer en hoeveel te bestellen. Recent hebben duurzaamheidszorgen onderzoekers ertoe gebracht CO2-uitstoot mee te nemen, vaak door boetes of heffingen toe te voegen aan kostenformules. Die aanpak mengt geld en emissies tot één maatstaf, waardoor verborgen blijft hoeveel winst wordt opgeofferd voor milieuwinst. Deze studie behandelt winst en CO2 daarentegen als twee afzonderlijke doelen, zodat hun spanning duidelijk onderzocht kan worden. De focus ligt op één magazijn dat bestelt bij een leverancier en klantvraag bedient, terwijl emissies ontstaan door het runnen van het magazijn en vrachtwagenritten.

Een AI leren voorraad te beheren onder onzekerheid

De auteurs bouwen een gesimuleerd magazijn waarin klantvraag willekeurig in de tijd verandert. In elke stap kiest een softwareagent een bestelgrootte in vaste batches. De omgeving houdt voorraad, achterstallige orders, lopende leveringen en levertijd bij. Daaruit berekent zij omzet, kosten (bestelkosten, houdkosten en boetes voor achterstanden) en CO2-uitstoot door transport en opslag. De agent ontvangt een beloning die winst en uitstoot combineert met aanpasbare gewichten: winst voegt toe aan de beloning, terwijl emissies er van af gaan. Door herhaaldelijk met dit virtuele magazijn te interageren, leert de agent welke bestelpatronen meestal betere langetermijnbeloningen opleveren.

Vergelijking van vier leerstrategieën

Vier veelgebruikte reinforcement learning-algoritmen worden getest onder identieke omstandigheden: Proximal Policy Optimization (PPO), Phasic Policy Gradient (PPG), Advantage Actor–Critic (A2C) en Double Deep Q-Network (DDQN). Ze zien allemaal dezelfde vraagpatronen en kosten- en emissieparameters. De onderzoekers volgen hoe snel elk algoritme een stabiel beleid “vindt”, hoeveel cumulatieve winst het behaalt en hoeveel CO2 het produceert. Ze herhalen de experimenten ook onder twee verschillende vraagpatronen (een brede uniforme range en een smallere Poisson-verdeling) om te controleren of de resultaten standhouden wanneer de omgeving voorspelbaarder wordt.

Wat de algoritmen leerden doen

De directe vergelijking onthult verschillende karakteristieken per methode. PPG behaalt consequent de hoogste winst, tegen slechts een bescheiden toename van de uitstoot ten opzichte van de concurrenten. PPO staat op de tweede plaats wat winst betreft maar levert iets lagere emissies, en biedt volgens de auteurs een gebalanceerde afweging tussen geld en CO2. DDQN leert sneller goede beleidsregels dan de anderen — het bereikt stabiliteit in minder trainingsepisodes — maar komt uiteindelijk tot beslissingen die minder totale winst opleveren, al met relatief lage emissies. A2C bevindt zich in het midden qua winst maar neigt naar de hoogste uitstoot. Wanneer het vraagpatroon wordt gesmoord met de Poisson-verdeling, blijft PPG de winstleider en blijft DDQN de snelste leerling, wat de hoofdconclusies versterkt.

Prioriteiten afstemmen tussen groene doelen en inkomsten

Om verschillende bedrijfsprioriteiten na te bootsen, passen de auteurs de gewichten aan die de agent vertellen hoeveel waarde te hechten aan winst versus uitstoot in zijn beloning. Zoals verwacht leidt meer gewicht op winst tot hogere inkomsten maar ook tot meer CO2, terwijl nadruk op emissies de winst verlaagt. De reactie van elk algoritme verschilt echter. PPO toont het meest stabiele en voorspelbare gedrag over verschillende gewichtinstellingen, met redelijke winsten en emissies. PPG neigt te clusteren rond hoog-winstoplossingen met beperkte gevoeligheid voor kleine gewichtsveranderingen. DDQN en A2C laten onregelmatiger prestatieverschuivingen zien. Bij een extreem gewicht voor emissies vallen alle algoritmen terug op bijna geen-bestelstrategieën die emissies vermijden maar ook geld verliezen — een onrealistische maar informatieve randvoorwaarde die de grenzen van het beloningsontwerp laat zien.

Wat dit betekent voor beslissers in de praktijk

Voor managers suggereert de studie dat reinforcement learning kan dienen als een flexibel instrument om afwegingen tussen winst en CO2-uitstoot te verkennen, zelfs zonder CO2-belasting of cap-and-trade-systeem. PPG lijkt het meest geschikt voor bedrijven die winst prioriteren maar ook geven om emissies, terwijl PPO de meest betrouwbare balans en robuustheid biedt wanneer voorkeuren of omstandigheden veranderen. DDQN kan aantrekkelijk zijn wanneer snelle implementatie en snel leren cruciaal zijn, en A2C kan dienen als een eenvoudiger referentie in situaties met beperkte middelen. De auteurs waarschuwen dat hun model leunt op vereenvoudigende aannames over vraag, levertijden en capaciteit, en dat extreme nadruk op emissies de AI naar onrealistische beleidsregels kan duwen. Ze bepleiten dat toekomstig werk deze aannames zou moeten versoepelen en vollediger naar het scala aan mogelijke winst–emissieverhoudingen zou moeten zoeken. Toch biedt deze studie een vroeg kader voor het gebruik van leeralgoritmen bij voorraadbeslissingen die zowel financieel als ecologisch slimmer zijn.

Bronvermelding: Sorour, A., Sadek, Y. & Elshalakani, M. Multi-objective inventory optimization using reinforcement learning: a comparative study on profitability and carbon emissions. Sci Rep 16, 13635 (2026). https://doi.org/10.1038/s41598-026-44293-y

Trefwoorden: voorraadbeheer, reinforcement learning, CO2-uitstoot, duurzame toeleveringsketens, multi-objectieve optimalisatie