Clear Sky Science · de

Multi-Objective-Inventaroptimierung mittels Reinforcement Learning: eine vergleichende Studie zu Rentabilität und CO2-Emissionen

Warum diese Studie für Unternehmen und den Planeten wichtig ist

Moderne Unternehmen stehen vor einer schwierigen Frage: Wie lassen sich Regale gefüllt und Kundinnen und Kunden zufrieden halten, gute Gewinne erzielen und gleichzeitig der CO2-Fußabdruck reduzieren? Dieses Paper untersucht, ob eine Form künstlicher Intelligenz, bekannt als Reinforcement Learning, Manager dabei unterstützen kann, automatisiert Bestandsstrategien zu finden, die sowohl profitabel sind als auch Treibhausgasemissionen verringern — statt den Klimaeffekt als nachträglichen Gedanken zu behandeln.

Geldverdienen und Emissionen in Balance bringen

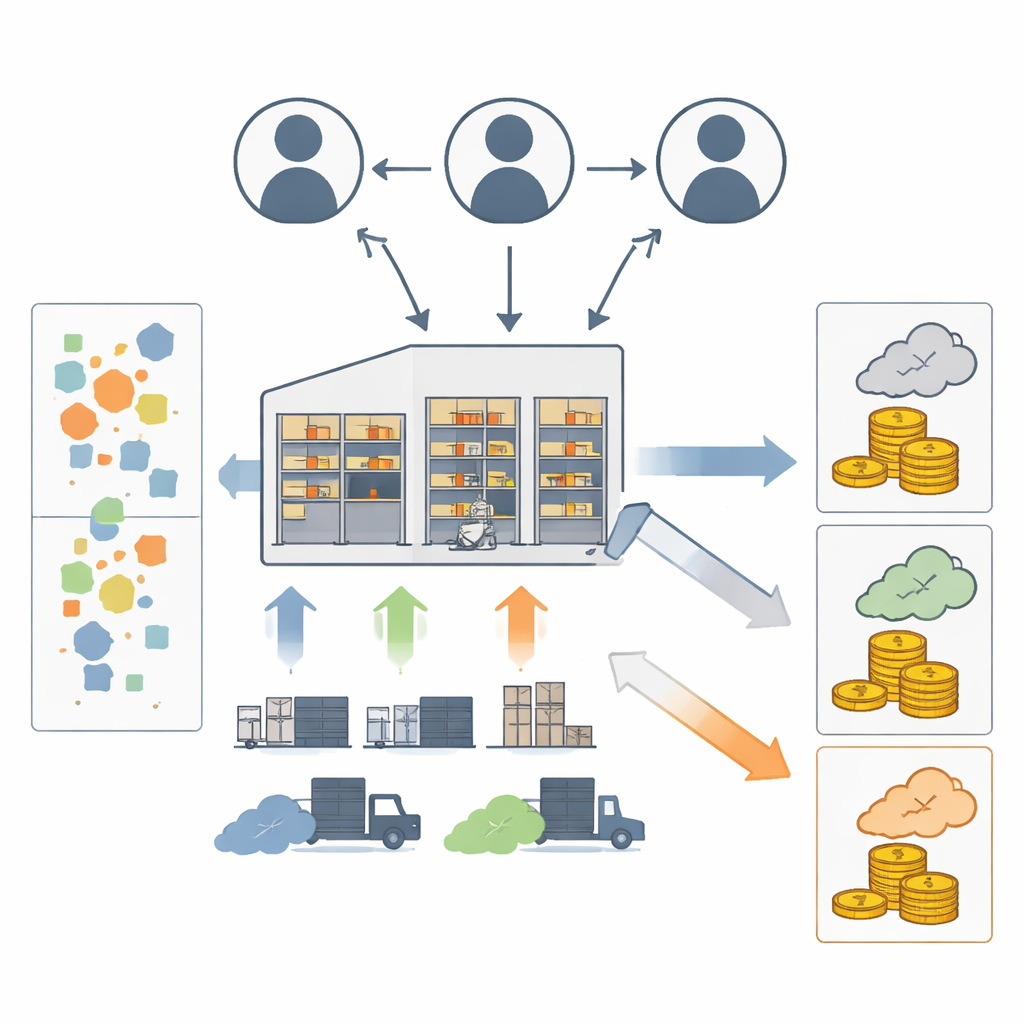

Bestandsmanagement steht im Zentrum von Lieferketten und beeinflusst Kosten, Liefergeschwindigkeit und Verschwendung. Traditionell helfen mathematische Modelle Firmen zu entscheiden, wann und wie viel bestellt werden soll. Neuerdings drängen Nachhaltigkeitsaspekte Forscher dazu, CO2-Emissionen einzubeziehen, häufig durch Strafzahlungen oder Abgaben in Kostenformeln. Dieser Ansatz vermischt Geld und Emissionen zu einem einzigen Maßstab und verdeckt, wie viel Gewinn für Umweltvorteile aufgegeben wird. Diese Studie behandelt Gewinn und CO2 stattdessen als zwei getrennte Ziele, sodass ihr Zielkonflikt klar untersucht werden kann. Untersucht wird ein einzelnes Lager, das bei einem Lieferanten bestellt und Kundennachfrage bedient, wobei Emissionen durch Lagerbetrieb und Lkw-Fahrten entstehen.

Ein KI-System beibringen, Lagerbestand unter Unsicherheit zu steuern

Die Autoren bauen ein simuliertes Lager auf, in dem die Kundennachfrage zufällig variiert. In jedem Schritt wählt ein Software-Agent eine Bestellmenge in festen Losgrößen. Die Umgebung verfolgt den Lagerbestand, Rückstände, ausstehende Lieferungen und die Vorlaufzeit. Daraus werden Umsatz, Kosten (Bestell-, Lager- und Rückstandskosten) sowie CO2-Emissionen aus Transport und Lagerhaltung berechnet. Der Agent erhält eine Belohnung, die Gewinn und Emissionen mit einstellbaren Gewichtungen kombiniert: Gewinn erhöht die Belohnung, Emissionen ziehen sie ab. Durch wiederholte Interaktion mit diesem virtuellen Lager lernt der Agent, welche Bestellmuster langfristig bessere Belohnungen erzeugen.

Vergleich von vier Lernstrategien

Vier verbreitete Reinforcement-Learning-Algorithmen werden unter identischen Bedingungen getestet: Proximal Policy Optimization (PPO), Phasic Policy Gradient (PPG), Advantage Actor–Critic (A2C) und Double Deep Q-Network (DDQN). Alle sehen dieselben Nachfragemuster sowie Kosten- und Emissionsparameter. Die Forschenden verfolgen, wie schnell jeder Algorithmus eine stabile Strategie findet, welchen kumulierten Gewinn er erzielt und wie viel CO2 er erzeugt. Experimente werden zudem für zwei unterschiedliche Nachfragemuster wiederholt (eine weite uniforme Spanne und eine engere Poisson-Verteilung), um zu prüfen, ob die Ergebnisse bei vorhersehbareren Bedingungen erhalten bleiben.

Was die Algorithmen zu tun lernten

Der direkte Vergleich offenbart unterschiedliche Charakteristika der Methoden. PPG erzielt konstant den höchsten Gewinn, bei nur moderat höheren Emissionen im Vergleich zu den Konkurrenten. PPO liegt beim Gewinn an zweiter Stelle, erzeugt dabei leicht niedrigere Emissionen und bietet laut den Autoren einen ausgeglichenen Kompromiss zwischen Geld und CO2. DDQN lernt schneller zu brauchbaren Politiken — es erreicht Stabilität in weniger Trainingsepisoden — geht aber letztlich Entscheidungen ein, die insgesamt geringere Gewinne bringen, wenn auch mit relativ niedrigen Emissionen. A2C liegt mittig beim Gewinn, neigt jedoch zu den höchsten Emissionen. Wenn die Nachfrage durch die Poisson-Verteilung geglättet wird, bleibt PPG Spitzenreiter beim Gewinn und DDQN der schnellste Lerner, was die wichtigsten Schlussfolgerungen untermauert.

Prioritäten zwischen Nachhaltigkeit und Ertrag justieren

Um unterschiedliche Unternehmensprioritäten nachzubilden, passen die Autorinnen und Autoren die Gewichtungen an, die dem Agenten sagen, wie sehr Gewinn gegenüber Emissionen in der Belohnung zählt. Erwartungsgemäß führt ein stärkeres Gewicht auf Gewinn zu höheren Einnahmen, aber auch zu mehr CO2, während die Betonung von Emissionen die Gewinne verringert. Allerdings reagiert jeder Algorithmus unterschiedlich. PPO zeigt über die Gewichtseinstellungen hinweg das stabilste und vorhersagbarste Verhalten und hält vernünftige Gewinne und Emissionen. PPG tendiert zu Lösungen mit hohem Gewinn und zeigt geringe Sensitivität gegenüber kleinen Gewichtungsänderungen. DDQN und A2C weisen unregelmäßigere Leistungsverschiebungen auf. Bei extrem hoher Gewichtung der Emissionen verfallen alle Algorithmen in fast nicht-bestellende Strategien, die Emissionen vermeiden, aber auch Geld verlieren — ein unrealistischer, jedoch lehrreicher Grenzfall, der die Grenzen des Belohnungsdesigns aufzeigt.

Was das für Entscheider in der Praxis bedeutet

Für Manager legt die Studie nahe, dass Reinforcement Learning ein flexibles Werkzeug sein kann, um Trade-offs zwischen Gewinn und CO2-Emissionen zu erkunden, selbst wenn keine CO2-Steuer oder ein Emissionshandel existiert. PPG erscheint am besten geeignet für Firmen, die Profit priorisieren und gleichzeitig Emissionen berücksichtigen wollen, während PPO die verlässlichste Balance und Robustheit bietet, wenn Präferenzen oder Bedingungen variieren. DDQN kann interessant sein, wenn schnelle Einführung und rasches Lernen entscheidend sind, und A2C eignet sich als einfachere Referenzlösung bei beschränkten Ressourcen. Die Autoren warnen, dass ihr Modell vereinfachende Annahmen zu Nachfrage, Vorlaufzeiten und Kapazitäten enthält und dass extreme Betonung von Emissionen die KI zu unrealistischen Politiken treiben kann. Sie empfehlen, diese Annahmen in künftigen Arbeiten zu lockern und die Bandbreite möglicher Gewinn-Emissions-Kompromisse weiter zu erkunden. Dennoch liefert die Studie eine frühe Roadmap dafür, Lernalgorithmen zu nutzen, um Inventarentscheidungen sowohl finanziell als auch ökologisch klüger zu machen.

Zitation: Sorour, A., Sadek, Y. & Elshalakani, M. Multi-objective inventory optimization using reinforcement learning: a comparative study on profitability and carbon emissions. Sci Rep 16, 13635 (2026). https://doi.org/10.1038/s41598-026-44293-y

Schlüsselwörter: Bestandsmanagement, Reinforcement Learning, CO2-Emissionen, nachhaltige Lieferketten, Multi-Objective-Optimierung