Clear Sky Science · pt

Otimização multiobjetivo de estoques usando aprendizado por reforço: um estudo comparativo sobre lucratividade e emissões de carbono

Por que este estudo importa para o dia a dia das empresas e para o planeta

Empresas modernas enfrentam uma questão difícil: como manter as prateleiras abastecidas e os clientes satisfeitos, obter lucros saudáveis e, ao mesmo tempo, reduzir sua pegada de carbono? Este artigo investiga se um tipo de inteligência artificial chamado aprendizado por reforço pode ajudar gestores a encontrar automaticamente políticas de estoque que gerem lucro e reduzam as emissões de gases de efeito estufa, em vez de tratar o impacto climático como um adendo.

Equilibrando ganhos financeiros e emissões

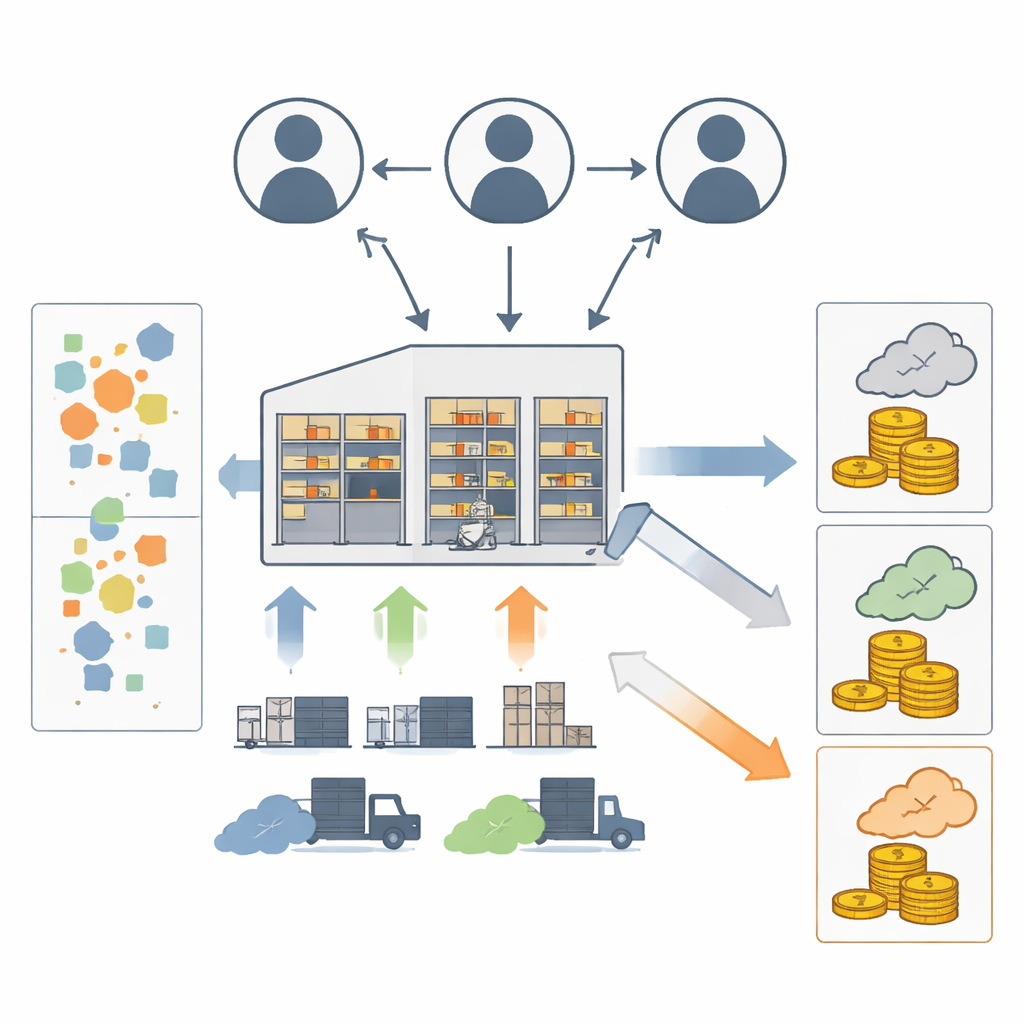

A gestão de estoques está no coração das cadeias de suprimento, influenciando custos, velocidade de entrega e desperdício. Tradicionalmente, modelos matemáticos ajudavam empresas a decidir quando e quanto pedir. Mais recentemente, preocupações com a sustentabilidade levaram pesquisadores a incluir emissões de carbono, muitas vezes adicionando penalidades ou impostos nas fórmulas de custo. Essa abordagem mistura dinheiro e emissões em uma única métrica, ocultando quanto lucro é sacrificado por ganhos ambientais. Este estudo, em vez disso, trata lucro e carbono como dois objetivos separados, permitindo examinar claramente sua tensão. O foco é um único armazém que pede a um fornecedor e atende à demanda de clientes, gerando emissões pela operação do armazém e pelas viagens de caminhão.

Ensinando uma IA a gerir estoque sob incerteza

Os autores constroem um armazém simulado onde a demanda dos clientes varia aleatoriamente ao longo do tempo. Em cada passo, um agente de software escolhe uma quantidade de pedido em lotes de tamanho fixo. O ambiente acompanha o estoque disponível, pedidos em atraso, entregas pendentes e o tempo de fornecimento. A partir disso, calcula receita, custos (pedido, armazenamento e penalidades por atraso) e emissões de carbono do transporte e do armazenamento. O agente recebe uma recompensa que combina lucro e emissões usando pesos ajustáveis: o lucro soma à recompensa, enquanto as emissões subtraem. Ao interagir repetidamente com esse armazém virtual, o agente aprende quais padrões de pedido tendem a produzir melhores recompensas no longo prazo.

Comparando quatro estratégias de aprendizado

Quatro algoritmos populares de aprendizado por reforço são testados em condições idênticas: Proximal Policy Optimization (PPO), Phasic Policy Gradient (PPG), Advantage Actor–Critic (A2C) e Double Deep Q-Network (DDQN). Todos experimentam os mesmos padrões de demanda e parâmetros de custo e emissão. Os pesquisadores acompanham com que rapidez cada algoritmo se estabiliza em uma política, quanto lucro acumulado obtém e quanta emissão de carbono produz. Eles também repetem os experimentos sob dois padrões de demanda diferentes (um intervalo uniforme amplo e uma distribuição de Poisson mais estreita) para verificar se os resultados se mantêm quando o ambiente fica mais previsível.

O que os algoritmos aprenderam a fazer

A comparação direta revela personalidades distintas para cada método. PPG atinge consistentemente o maior lucro, ao custo de um aumento modesto nas emissões em relação aos concorrentes. PPO fica em segundo lugar em lucro, mas entrega emissões ligeiramente menores, oferecendo o que os autores descrevem como um equilíbrio entre dinheiro e carbono. DDQN aprende boas políticas mais rápido que os outros — alcança estabilidade em menos episódios de treino — mas acaba adotando decisões que geram menor lucro geral, embora com emissões relativamente baixas. A2C fica no meio em termos de lucro, tendendo a gerar as maiores emissões. Quando o padrão de demanda é suavizado pela distribuição de Poisson, PPG permanece líder em lucro e DDQN continua sendo o aprendiz mais rápido, reforçando as conclusões principais.

Ajustando prioridades entre metas verdes e ganhos

Para imitar diferentes prioridades empresariais, os autores ajustam os pesos que dizem ao agente quanto valor dar ao lucro versus às emissões em sua recompensa. Como esperado, dar mais peso ao lucro leva a ganhos maiores, mas também a mais carbono, enquanto enfatizar as emissões reduz os lucros. No entanto, a reação de cada algoritmo é distinta. PPO mostra o comportamento mais estável e previsível entre as configurações de peso, mantendo lucros e emissões razoáveis. PPG tende a se agrupar em soluções de alto lucro com sensibilidade limitada a pequenas mudanças nos pesos. DDQN e A2C apresentam mudanças de desempenho mais irregulares. Quando as emissões recebem um peso extremo, todos os algoritmos adotam estratégias quase de não-pedido que evitam emissões, mas também deixam de gerar lucro — um caso limite irrealista, porém informativo, que mostra os limites do desenho da recompensa.

O que isso significa para tomadores de decisão no mundo real

Para gestores, o estudo sugere que o aprendizado por reforço pode servir como uma ferramenta flexível para explorar trade-offs entre lucros e emissões de carbono, mesmo na ausência de um imposto sobre carbono ou sistema de cap-and-trade. PPG parece mais adequado para empresas que priorizam lucro sem abandonar a preocupação com emissões, enquanto PPO oferece o equilíbrio mais confiável e robusto quando preferências ou condições mudam. DDQN pode ser atraente quando implantação rápida e aprendizado veloz são cruciais, e A2C pode servir como uma linha de base mais simples em contextos com recursos limitados. Os autores alertam que seu modelo depende de suposições simplificadoras sobre demanda, tempos de entrega e capacidade, e que ênfase extrema nas emissões pode levar a políticas irreais. Argumentam que trabalhos futuros devem relaxar essas suposições e buscar mais plenamente a gama de compromissos possíveis entre lucro e emissões. Ainda assim, este estudo fornece um roteiro inicial para usar algoritmos de aprendizado na tomada de decisões de estoque que sejam mais inteligentes financeiramente e ambientalmente.

Citação: Sorour, A., Sadek, Y. & Elshalakani, M. Multi-objective inventory optimization using reinforcement learning: a comparative study on profitability and carbon emissions. Sci Rep 16, 13635 (2026). https://doi.org/10.1038/s41598-026-44293-y

Palavras-chave: gestão de estoques, aprendizado por reforço, emissões de carbono, cadeias de suprimento sustentáveis, otimização multiobjetivo