Clear Sky Science · fr

Optimisation d’inventaire multi-objectifs par apprentissage par renforcement : étude comparative sur la rentabilité et les émissions de carbone

Pourquoi cette étude importe pour les entreprises et la planète

Les entreprises modernes affrontent une question difficile : comment maintenir les étagères approvisionnées et les clients satisfaits, dégager des bénéfices sains, tout en réduisant leur empreinte carbone ? Cet article examine si un type d’intelligence artificielle appelé apprentissage par renforcement peut aider les décideurs à découvrir automatiquement des politiques d’approvisionnement qui génèrent à la fois des profits et une réduction des gaz à effet de serre, plutôt que de traiter l’impact climatique comme une réflexion secondaire.

Concilier gains financiers et émissions

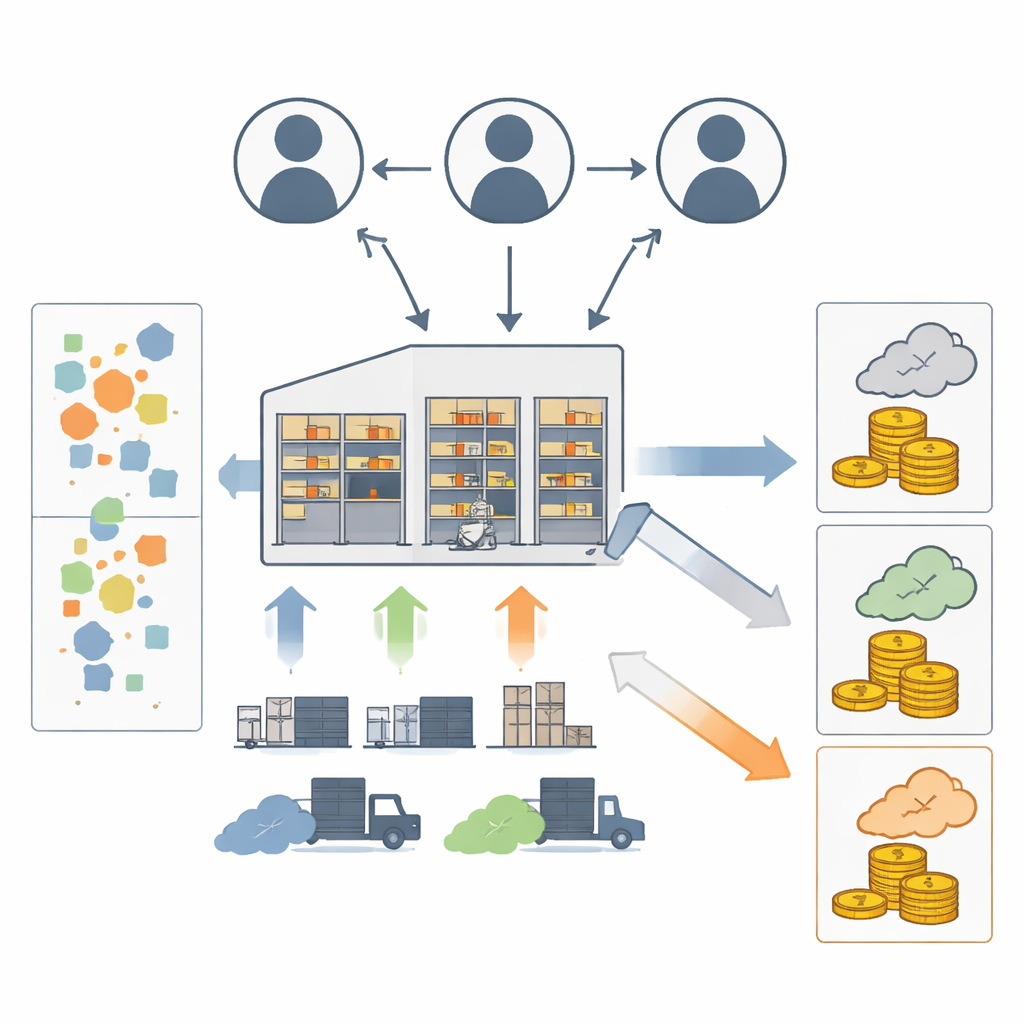

La gestion des stocks est au cœur des chaînes d’approvisionnement, influant sur les coûts, la vitesse de livraison et le gaspillage. Traditionnellement, des modèles mathématiques aident les entreprises à décider quand et combien commander. Plus récemment, les préoccupations de durabilité ont poussé les chercheurs à intégrer les émissions de carbone, souvent en ajoutant des pénalités ou des taxes dans les formules de coût. Cette approche confond monnaie et émissions en une seule métrique, masquant ainsi le compromis de profit pour des gains environnementaux. Cette étude traite au contraire le profit et le carbone comme deux objectifs distincts, afin d’examiner clairement leur tension. Le cas étudié est un entrepôt unique qui commande auprès d’un fournisseur et sert une demande client, générant des émissions liées au fonctionnement de l’entrepôt et aux trajets en camion.

Apprendre à gérer les stocks sous incertitude

Les auteurs construisent un entrepôt simulé où la demande client varie aléatoirement dans le temps. À chaque étape, un agent logiciel choisit une quantité de commande en lots de taille fixe. L’environnement suit l’inventaire disponible, les commandes en retard, les livraisons en attente et le délai d’acheminement. À partir de ces éléments, il calcule le chiffre d’affaires, les coûts (commande, stockage et pénalités de rupture) et les émissions de carbone liées au transport et au stockage. L’agent reçoit une récompense qui combine profit et émissions à l’aide de poids ajustables : le profit augmente la récompense tandis que les émissions la diminuent. En interagissant répétitivement avec cet entrepôt virtuel, l’agent apprend quels schémas de commande tendent à produire de meilleures récompenses sur le long terme.

Comparaison de quatre stratégies d’apprentissage

Quatre algorithmes d’apprentissage par renforcement populaires sont testés dans des conditions identiques : Proximal Policy Optimization (PPO), Phasic Policy Gradient (PPG), Advantage Actor–Critic (A2C) et Double Deep Q-Network (DDQN). Ils disposent tous des mêmes motifs de demande et des mêmes paramètres de coûts et d’émissions. Les chercheurs suivent la vitesse à laquelle chaque algorithme « se stabilise » sur une politique, le profit cumulé qu’il génère et les émissions de carbone produites. Ils répètent également les expériences sous deux profils de demande différents (une large distribution uniforme et une distribution de Poisson plus étroite) pour vérifier si les résultats tiennent lorsque l’environnement devient plus prévisible.

Ce que les algorithmes ont appris

La comparaison directe révèle des caractéristiques distinctes pour chaque méthode. PPG obtient systématiquement le profit le plus élevé, au prix d’une augmentation modeste des émissions par rapport à ses concurrents. PPO se classe deuxième en profit mais affiche des émissions légèrement inférieures, offrant ce que les auteurs décrivent comme un compromis équilibré entre gains financiers et carbone. DDQN apprend de bonnes politiques plus rapidement que les autres — il atteint la stabilité en moins d’épisodes d’entraînement — mais finit par adopter des décisions qui génèrent un profit global inférieur, bien que ses émissions restent relativement faibles. A2C se situe au milieu en termes de profit tout en ayant tendance à produire les émissions les plus élevées. Lorsque le profil de demande est lissé avec la distribution de Poisson, PPG reste en tête sur le profit et DDQN conserve son avantage de rapidité d’apprentissage, ce qui renforce les conclusions principales.

Ajuster les priorités entre objectifs verts et gains

Pour simuler différentes priorités d’entreprise, les auteurs ajustent les poids qui indiquent à l’agent combien valoriser le profit par rapport aux émissions dans sa récompense. Comme prévu, accorder plus de poids au profit conduit à des gains supérieurs mais aussi à plus de carbone, tandis que mettre l’accent sur les émissions réduit les profits. Cependant, la réaction de chaque algorithme diffère. PPO montre le comportement le plus stable et prévisible à travers les réglages de poids, maintenant des profits et émissions raisonnables. PPG a tendance à se concentrer sur des solutions à fort profit avec une sensibilité limitée aux petits changements de poids. DDQN et A2C présentent des variations de performance plus irrégulières. Lorsqu’on donne un poids extrême aux émissions, tous les algorithmes tombent dans des stratégies quasi-sans-commande qui évitent les émissions mais perdent aussi de l’argent — un cas de bord irréaliste mais instructif montrant les limites de la conception de la récompense.

Ce que cela implique pour les décideurs

Pour les gestionnaires, l’étude suggère que l’apprentissage par renforcement peut servir d’outil flexible pour explorer les compromis entre profits et émissions de carbone, même en l’absence d’une taxe carbone ou d’un système de plafonnement et d’échange. PPG semble mieux adapté aux entreprises qui privilégient le profit tout en se souciant des émissions, alors que PPO offre l’équilibre et la robustesse les plus fiables lorsque les préférences ou les conditions changent. DDQN peut séduire lorsque le déploiement rapide et l’apprentissage accéléré sont cruciaux, et A2C peut servir de référence plus simple dans des contextes de ressources limitées. Les auteurs mettent en garde que leur modèle repose sur des hypothèses simplificatrices concernant la demande, les délais et la capacité, et que l’accent extrême sur les émissions peut pousser l’IA vers des politiques irréalistes. Ils préconisent que les travaux futurs assouplissent ces hypothèses et explorent plus largement l’éventail des compromis profit–émissions possibles. Néanmoins, cette étude fournit une feuille de route initiale pour l’utilisation d’algorithmes d’apprentissage afin de prendre des décisions d’inventaire à la fois plus judicieuses financièrement et écologiquement.

Citation: Sorour, A., Sadek, Y. & Elshalakani, M. Multi-objective inventory optimization using reinforcement learning: a comparative study on profitability and carbon emissions. Sci Rep 16, 13635 (2026). https://doi.org/10.1038/s41598-026-44293-y

Mots-clés: gestion des stocks, apprentissage par renforcement, émissions de carbone, chaînes d’approvisionnement durables, optimisation multi-objectifs