Clear Sky Science · pl

Optymalizacja zapasów o wielokrotnych celach przy użyciu uczenia ze wzmocnieniem: studium porównawcze rentowności i emisji dwutlenku węgla

Dlaczego to badanie ma znaczenie dla biznesu i dla planety

Współczesne firmy stoją przed trudnym dylematem: jak utrzymać półki zaopatrzone i zadowolić klientów, osiągać zdrowe zyski, a jednocześnie zmniejszać ślad węglowy? W artykule badano, czy rodzaj sztucznej inteligencji zwany uczeniem ze wzmocnieniem może pomóc menedżerom w automatycznym odnajdywaniu polityk magazynowych, które jednocześnie przynoszą zysk i redukują emisje gazów cieplarnianych, zamiast traktować wpływ na klimat jako dodatek.

Równoważenie zysków i emisji

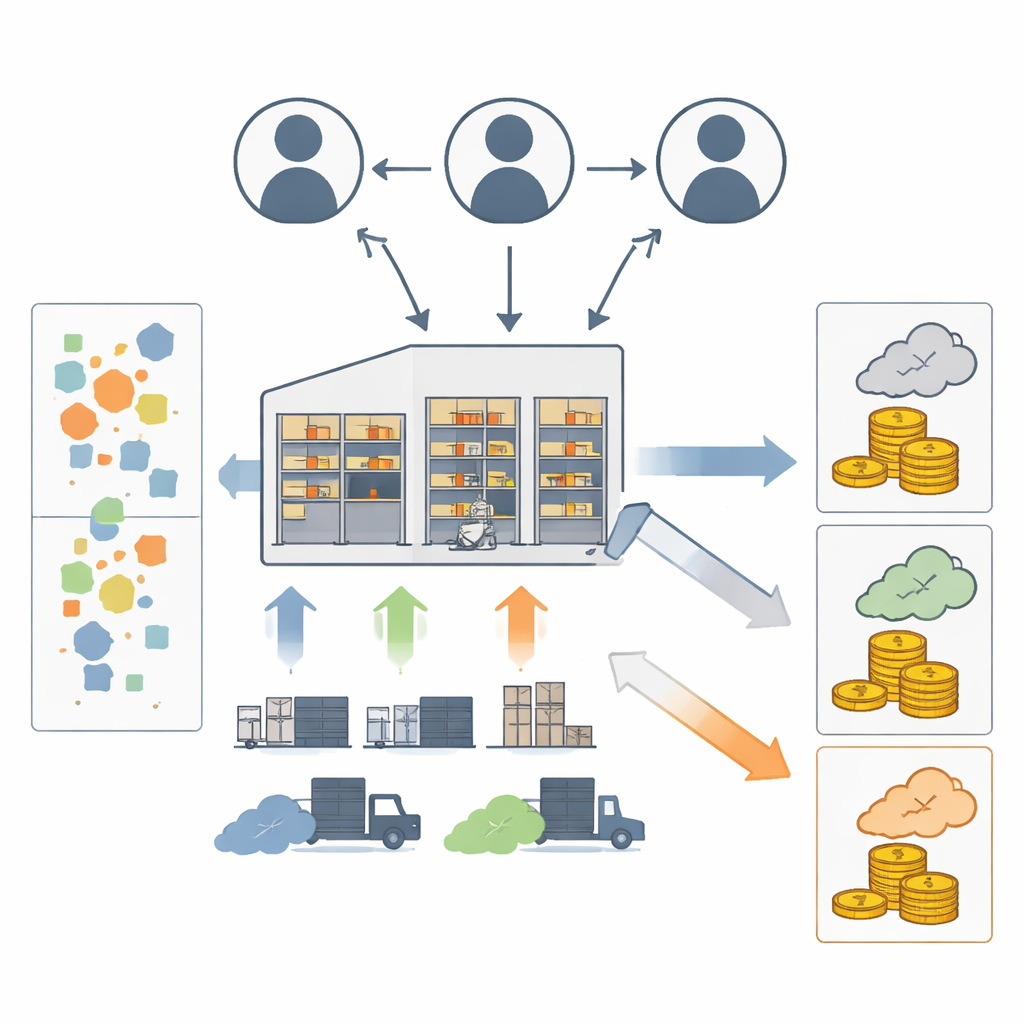

Zarządzanie zapasami leży w centrum łańcuchów dostaw i wpływa na koszty, szybkość dostaw oraz straty. Tradycyjnie modele matematyczne pomagały firmom decydować, kiedy i ile zamawiać. Ostatnio względy zrównoważonego rozwoju skłoniły badaczy do uwzględniania emisji dwutlenku węgla, często przez dodawanie kar lub podatków do formuł kosztowych. Takie podejście łączy pieniądze i emisje w jedną miarę, co zaciera, ile zysku jest poświęcane na korzyści środowiskowe. W tym badaniu przyjęto zamiast tego dwa odrębne cele — zysk i emisje — aby móc wyraźnie przyjrzeć się ich napięciu. Badanie koncentruje się na jednym magazynie, który zamawia od dostawcy i obsługuje popyt klientów, generując emisje z działalności magazynu oraz z transportu ciężarowego.

Uczenie AI zarządzania zapasami w warunkach niepewności

Autorzy zbudowali symulowany magazyn, w którym popyt klientów zmienia się losowo w czasie. Na każdym kroku agent programowy wybiera ilość zamówienia w stałych partiach. Środowisko śledzi zapas dostępny, zamówienia z zaległościami, oczekujące dostawy i czas realizacji. Na ich podstawie oblicza przychody, koszty (zamawiania, magazynowania i kary za zaległe zamówienia) oraz emisje dwutlenku węgla związane z transportem i przechowywaniem. Agent otrzymuje nagrodę łączącą zysk i emisje za pomocą regulowanych wag: zysk zwiększa nagrodę, a emisje ją zmniejszają. Poprzez wielokrotne interakcje z wirtualnym magazynem, agent uczy się, które wzorce zamawiania prowadzą do lepszych długoterminowych nagród.

Porównanie czterech strategii uczenia

Przetestowano cztery popularne algorytmy uczenia ze wzmocnieniem w tych samych warunkach: Proximal Policy Optimization (PPO), Phasic Policy Gradient (PPG), Advantage Actor–Critic (A2C) oraz Double Deep Q-Network (DDQN). Wszystkie widzą te same wzorce popytu oraz parametry kosztów i emisji. Badacze monitorowali, jak szybko każdy algorytm „ustala się” w stabilnej polityce, ile kumulatywnego zysku generuje i ile dwutlenku węgla emituje. Eksperymenty powtórzono także przy dwóch różnych wzorcach popytu (szeroki zakres jednorodny i węższe rozkłady Poissona), aby sprawdzić, czy wyniki utrzymują się, gdy środowisko staje się bardziej przewidywalne.

Czego algorytmy się nauczyły

Porównanie „jeden na jednego” ujawnia odrębne cechy każdego podejścia. PPG konsekwentnie osiąga najwyższy zysk, kosztem jedynie umiarkowanego wzrostu emisji względem konkurentów. PPO zajmuje drugie miejsce pod względem zysku, ale generuje nieco niższe emisje, oferując — jak opisują autorzy — zrównoważony kompromis między pieniędzmi a emisjami. DDQN uczy się szybciej niż pozostałe — osiąga stabilność w mniejszej liczbie epizodów treningowych — lecz ostatecznie przyjmuje decyzje skutkujące niższym całkowitym zyskiem, choć stosunkowo niskimi emisjami. A2C plasuje się pośrodku pod względem zysku, ale zwykle generuje najwyższe emisje. Gdy wzorzec popytu wygładza się za pomocą rozkładu Poissona, PPG pozostaje liderem pod względem zysku, a DDQN zachowuje przewagę szybkości uczenia, co wzmacnia główne wnioski.

Dostosowywanie priorytetów między celami ekologicznymi a przychodami

Aby odwzorować różne priorytety biznesowe, autorzy regulowali wagi, które mówią agentowi, jak bardzo ma cenić zysk versus emisje w swojej nagrodzie. Jak można się spodziewać, większy nacisk na zysk prowadzi do wyższych przychodów, ale też większych emisji, natomiast akcentowanie emisji obniża zyski. Reakcje poszczególnych algorytmów są jednak różne. PPO wykazuje najbardziej stabilne i przewidywalne zachowanie w różnych ustawieniach wag, utrzymując rozsądne zyski i emisje. PPG ma tendencję do skupiania się wokół rozwiązań o wysokim zysku z ograniczoną wrażliwością na niewielkie zmiany wag. DDQN i A2C wykazują bardziej nieregularne przesunięcia wydajności. Gdy emisjom przypisano ekstremalną wagę, wszystkie algorytmy przechodzą do niemal zerowych strategii zamawiania, unikając emisji, ale też tracąc pieniądze — nierealistyczny lecz pouczający przypadek graniczny pokazujący ograniczenia projektu funkcji nagrody.

Co to oznacza dla decydentów

Dla menedżerów badanie sugeruje, że uczenie ze wzmocnieniem może być elastycznym narzędziem do badania kompromisów między zyskami a emisjami dwutlenku węgla, nawet gdy brak jest podatku węglowego czy systemu handlu emisjami. PPG wydaje się najlepiej nadawać firmom, które priorytetowo traktują zysk przy jednoczesnym dbaniu o emisje, podczas gdy PPO oferuje najbardziej niezawodne równoważenie i odporność, gdy preferencje lub warunki się zmieniają. DDQN może być atrakcyjny tam, gdzie ważne jest szybkie wdrożenie i szybkie uczenie, a A2C może służyć jako prostsza baza w warunkach ograniczonych zasobów. Autorzy zastrzegają, że ich model opiera się na upraszczających założeniach dotyczących popytu, czasów realizacji i zdolności, oraz że skrajne podkreślenie emisji może doprowadzić AI do nierealistycznych polityk. Zalecają, by przyszłe prace łagodziły te założenia i szerzej poszukiwały zakresu możliwych kompromisów zysk–emisje. Mimo to badanie stanowi wczesną mapę drogową wykorzystania algorytmów uczących się do podejmowania decyzji zapasowych, które są jednocześnie mądrzejsze finansowo i środowiskowo.

Cytowanie: Sorour, A., Sadek, Y. & Elshalakani, M. Multi-objective inventory optimization using reinforcement learning: a comparative study on profitability and carbon emissions. Sci Rep 16, 13635 (2026). https://doi.org/10.1038/s41598-026-44293-y

Słowa kluczowe: zarządzanie zapasami, uczenie ze wzmocnieniem, emisje dwutlenku węgla, zrównoważone łańcuchy dostaw, optymalizacja wielokryterialna