Clear Sky Science · it

Ottimizzazione dell’inventario multi-obiettivo tramite apprendimento per rinforzo: uno studio comparativo su redditività ed emissioni di CO2

Perché questo studio è importante per le aziende di tutti i giorni e per il pianeta

Le aziende moderne devono affrontare una domanda difficile: come mantenere gli scaffali riforniti e i clienti soddisfatti, ottenere profitti sostenibili e allo stesso tempo ridurre la propria impronta di carbonio? Questo articolo indaga se un tipo di intelligenza artificiale chiamato apprendimento per rinforzo possa aiutare i manager a trovare automaticamente politiche di inventario che generino sia profitto sia minori emissioni di gas serra, invece di considerare l’impatto climatico come un ripensamento.

Bilanciare i guadagni e le emissioni prodotte

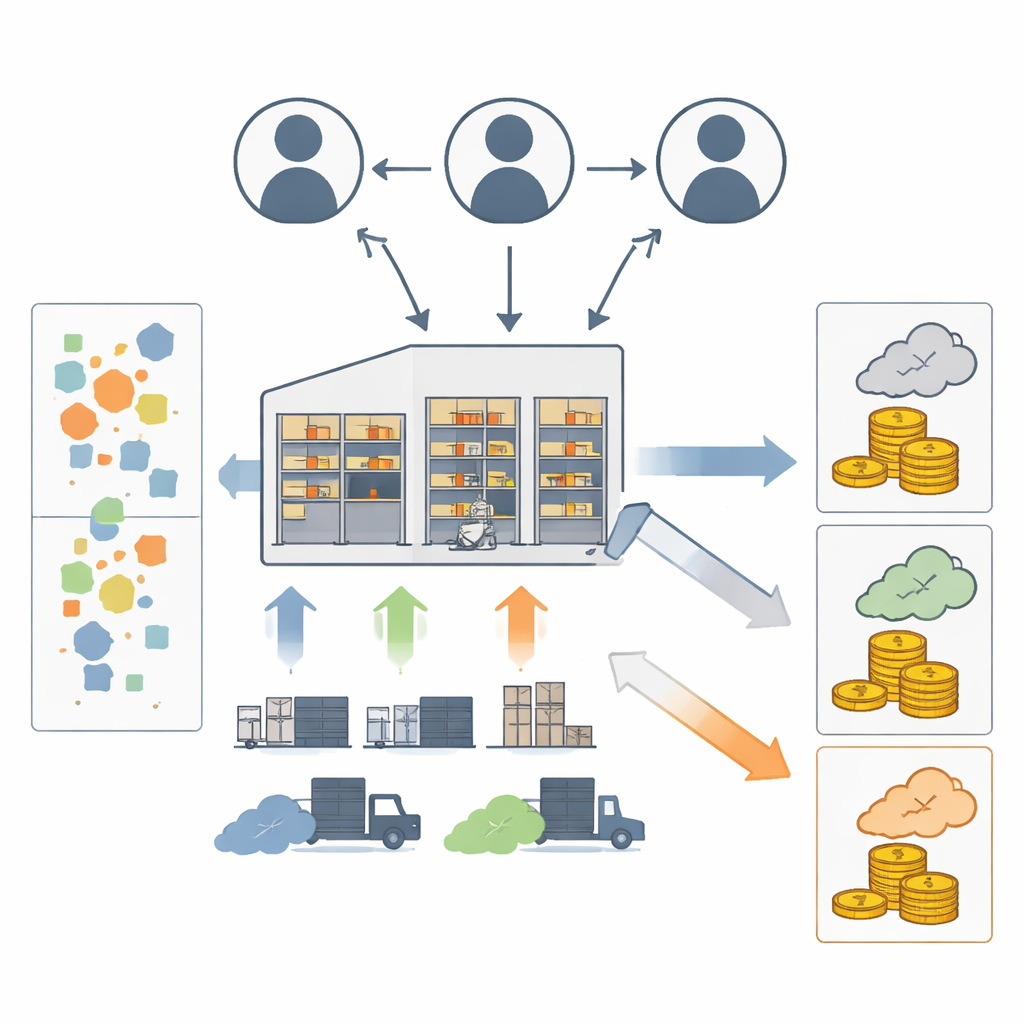

La gestione dell’inventario è al centro delle catene di fornitura, influenzando costi, velocità di consegna e sprechi. Tradizionalmente, modelli matematici hanno aiutato le aziende a decidere quando e quanto ordinare. Più recentemente, le preoccupazioni per la sostenibilità hanno spinto i ricercatori a includere le emissioni di carbonio, spesso introducendo penalità o tasse nelle formule dei costi. Tale approccio fonde denaro ed emissioni in un unico indicatore, mascherando quanto profitto venga sacrificato per ottenere vantaggi ambientali. Questo studio invece tratta profitto e carbonio come due obiettivi separati, in modo da poter esaminare chiaramente la loro tensione. L’oggetto è un unico magazzino che ordina da un fornitore e serve la domanda dei clienti, generando emissioni sia per il funzionamento del magazzino sia per i viaggi dei camion.

Insegnare a un’IA a gestire le scorte in condizioni di incertezza

Gli autori costruiscono un magazzino simulato in cui la domanda dei clienti varia in modo casuale nel tempo. A ogni passo, un agente software sceglie una quantità da ordinare in lotti di dimensione fissa. L’ambiente tiene traccia delle scorte disponibili, degli ordini arretrati, delle consegne in arrivo e dei tempi di approvvigionamento. Da questi elementi calcola ricavi, costi (di ordinazione, di stoccaggio e penalità per arretrati) ed emissioni di carbonio dovute a trasporto e immagazzinamento. L’agente riceve una ricompensa che combina profitto ed emissioni usando pesi regolabili: il profitto aumenta la ricompensa, mentre le emissioni la riducono. Interagendo ripetutamente con questo magazzino virtuale, l’agente apprende quali schemi di ordinazione tendono a produrre ricompense migliori nel lungo periodo.

Confronto tra quattro strategie di apprendimento

Quattro algoritmi di apprendimento per rinforzo noti vengono testati in condizioni identiche: Proximal Policy Optimization (PPO), Phasic Policy Gradient (PPG), Advantage Actor–Critic (A2C) e Double Deep Q-Network (DDQN). Tutti osservano gli stessi pattern di domanda e gli stessi parametri di costo ed emissione. I ricercatori monitorano la velocità con cui ogni algoritmo si «stabilizza» in una politica coerente, quanto profitto cumulativo ottiene e quante emissioni produce. Ripetono inoltre gli esperimenti con due diversi schemi di domanda (un ampio intervallo uniforme e una distribuzione di Poisson più ristretta) per verificare se i risultati valgono anche quando l’ambiente diventa più prevedibile.

Cosa hanno imparato gli algoritmi

Il confronto diretto rivela personalità distinte per ciascun metodo. PPG ottiene costantemente il profitto più elevato, a costo di un aumento solo modesto delle emissioni rispetto ai concorrenti. PPO si piazza al secondo posto per profitto ma produce emissioni leggermente inferiori, offrendo quello che gli autori descrivono come un compromesso equilibrato tra denaro e carbonio. DDQN apprende buone politiche più rapidamente degli altri—raggiunge la stabilità in meno episodi di addestramento—ma si stabilizza su decisioni che generano un profitto complessivo inferiore, seppure con emissioni relativamente basse. A2C si trova nella media per profitto ma tende a generare le emissioni più alte. Quando il pattern di domanda è smussato usando la distribuzione di Poisson, PPG rimane leader di profitto e DDQN resta l’apprendista più veloce, rafforzando le conclusioni principali.

Regolare le priorità tra obiettivi ambientali e guadagni

Per simulare diverse priorità aziendali, gli autori aggiustano i pesi che dicono all’agente quanto valorizzare il profitto rispetto alle emissioni nella sua ricompensa. Come prevedibile, dare più peso al profitto porta a guadagni maggiori ma anche a più carbonio, mentre dare maggiore importanza alle emissioni riduce i profitti. Tuttavia, la reazione di ciascun algoritmo è diversa. PPO mostra il comportamento più stabile e prevedibile al variare dei pesi, mantenendo profitti ed emissioni ragionevoli. PPG tende a concentrarsi su soluzioni ad alto profitto con una sensibilità limitata a piccoli cambiamenti di peso. DDQN e A2C mostrano spostamenti di performance più irregolari. Quando le emissioni ricevono un peso estremo, tutti gli algoritmi convergono verso strategie di quasi nessuna ordinazione che evitano le emissioni ma perdono anche denaro—un caso limite irrealistico ma informativo che mostra i limiti della progettazione della ricompensa.

Cosa significa per i decisori del mondo reale

Per i manager, lo studio suggerisce che l’apprendimento per rinforzo può essere uno strumento flessibile per esplorare i compromessi tra profitti ed emissioni di carbonio, anche in assenza di una tassa sul carbonio o di un sistema di cap-and-trade. PPG appare il più adatto per le aziende che danno priorità al profitto pur tenendo conto delle emissioni, mentre PPO offre il bilanciamento più affidabile e la maggiore robustezza quando le preferenze o le condizioni cambiano. DDQN può risultare interessante quando è cruciale una rapida messa in produzione e un apprendimento veloce, e A2C può fungere da baseline più semplice in contesti con risorse limitate. Gli autori avvertono che il loro modello si basa su assunzioni semplificative su domanda, tempi di consegna e capacità, e che un’enfasi estrema sulle emissioni può spingere l’IA verso politiche irrealistiche. Propongono che lavori futuri rilassino queste assunzioni e esplorino più a fondo l’insieme dei possibili compromessi profitto–emissioni. Nonostante ciò, questo studio fornisce una prima roadmap per l’uso di algoritmi di apprendimento nel prendere decisioni di inventario più intelligenti, sia finanziariamente sia dal punto di vista ambientale.

Citazione: Sorour, A., Sadek, Y. & Elshalakani, M. Multi-objective inventory optimization using reinforcement learning: a comparative study on profitability and carbon emissions. Sci Rep 16, 13635 (2026). https://doi.org/10.1038/s41598-026-44293-y

Parole chiave: gestione dell'inventario, apprendimento per rinforzo, emissioni di carbonio, catene di approvvigionamento sostenibili, ottimizzazione multi-obiettivo