Clear Sky Science · zh

通过缓冲拒绝在差分隐私随机梯度下降中稳定更新

为什么私有学习很重要

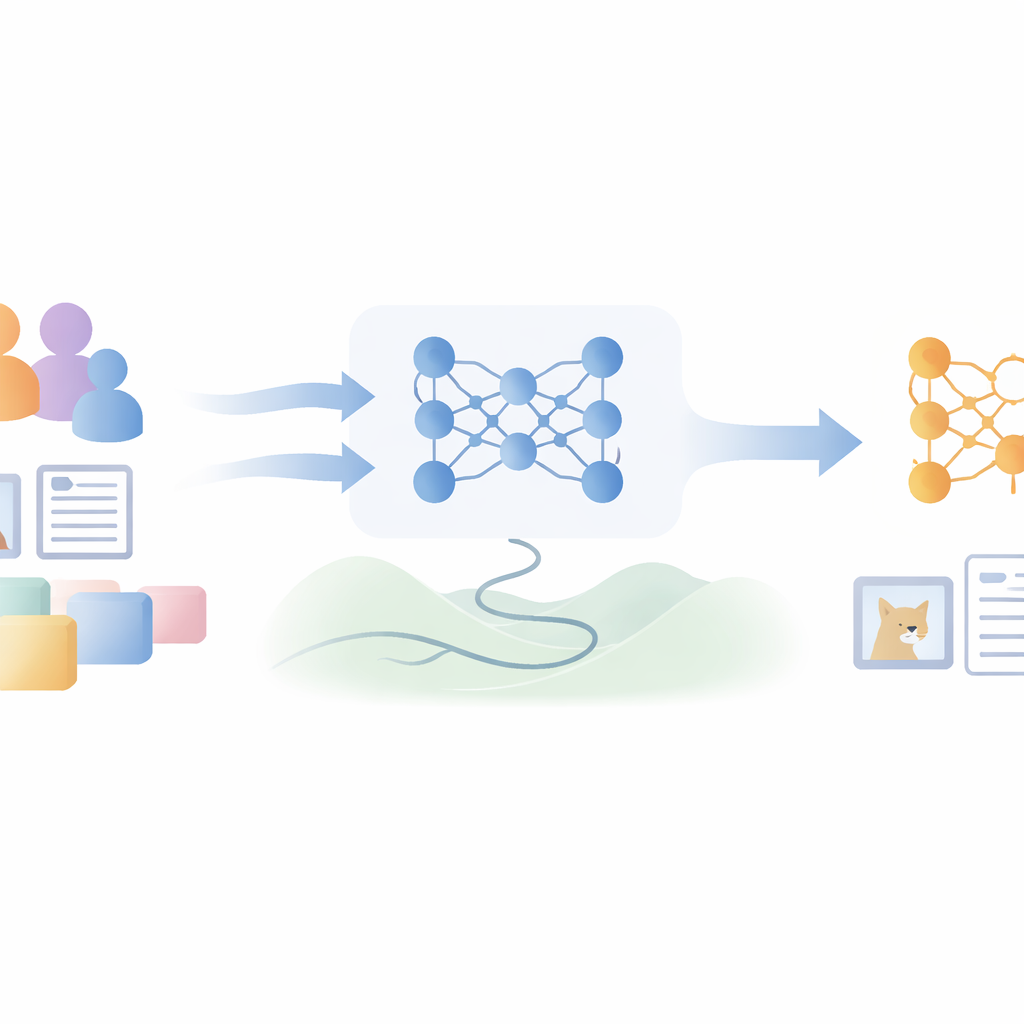

现代应用从大量照片、病历和个人消息中学习。虽然这些数据可以提升机器学习模型的能力,但也带来风险:模型可能会无意中泄露其训练数据中个人的信息。差分隐私是一套旨在防止这种情况发生的数学工具。本文摘要所依据的论文提出了一种训练深度神经网络的方法,能够在保持强隐私保证的同时,恢复因隐私噪声通常损失的一部分准确性。

噪声训练的挑战

为保护个体,差分隐私训练在模型学习的每个小步骤中注入随机噪声。噪声隐藏了任何单个个体在数据中的贡献,但也使学习更困难:模型的更新变得不稳定、进展变慢,并且与非隐私训练相比最终准确性下降。早期方法尝试更有选择性地进行更新,基于小的验证批评估并跳过看起来无益的更新。然而,这些决策仍依赖于单次有噪测量,因此可能丢弃好的更新或意外接受坏的更新,从而浪费了用于限制数据访问量的有限“隐私预算”。

用小内存选择更好的步骤

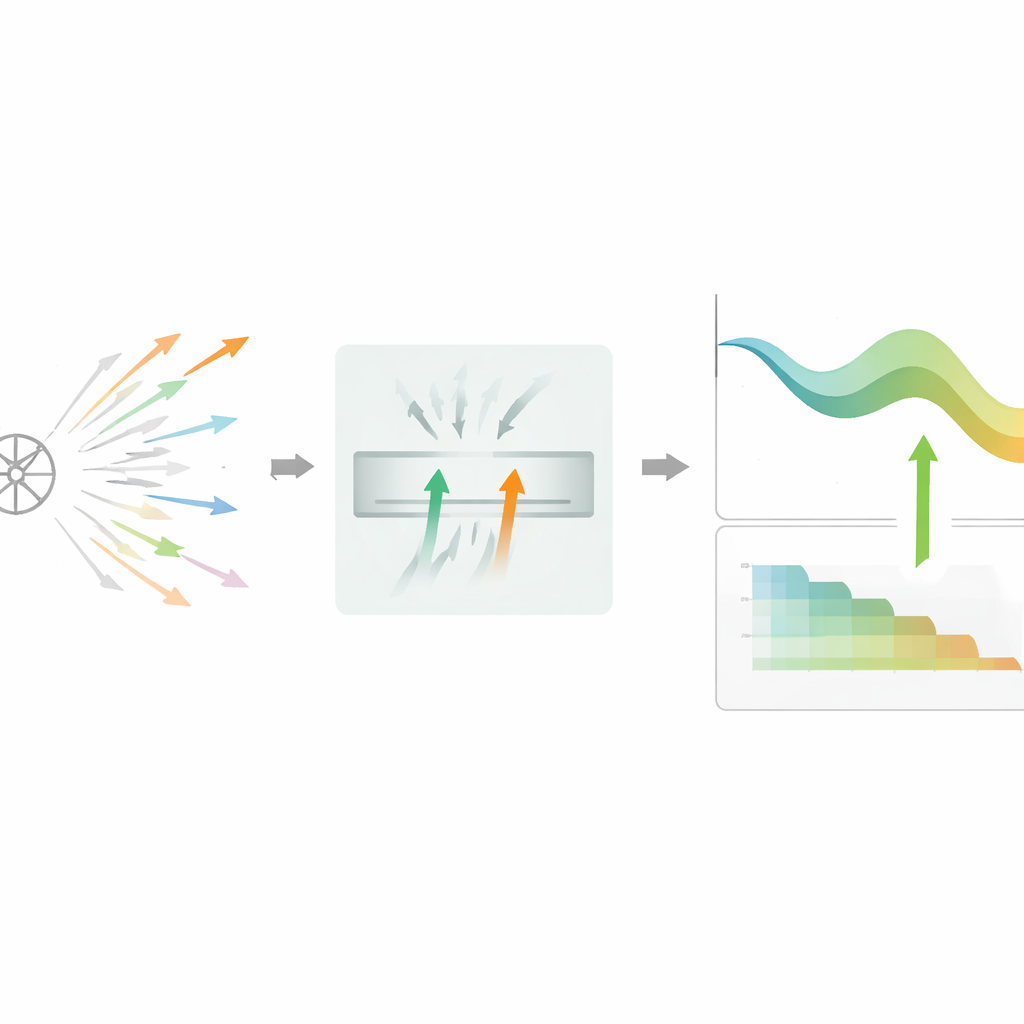

作者提出了 DPSGD-BR,这是一种改变模型决定保留哪些学习步骤的算法。它不是一次评判一个候选更新,而是保留一个包含两个已通过快速私有检查的有前景候选项的小缓冲区。然后比较它们的有噪损失下降,并偏好看起来更有帮助的那个;如果两者看起来同样好,有时会随机选择。这样的双向比较抵消了部分随机性,使决策对单次有噪读数的敏感性降低。如果过滤器变得过于严格、导致连续许多候选被拒绝,算法会自动切换到更简单的单候选模式,以免在损失表面平坦或困难区域附近训练停滞。

随时间自适应噪声与步长

除了更智能的选择之外,DPSGD-BR 还在训练期间自适应调整其关键参数。在每次接受更新后,它会检查验证精度的改善幅度。当模型学习迅速时,该方法更积极地减少噪声水平和学习率,帮助模型尽早从高度噪声的初期阶段进入更稳定的阶段。后来当进展放缓时,它以更温和的速度衰减这些量并放宽拒绝规则,允许更多更新通过以便模型进行微调。所有这些都在严格的记账框架下进行,该框架跟踪已消耗的隐私预算,并在接近预设上限时停止进一步的衰减。

实验证明了什么

研究人员在知名基准上测试了 DPSGD-BR:两个手写和服装图像数据集(MNIST 与 Fashion-MNIST)、一个更复杂的自然图像集(CIFAR-10)以及电影评论情感分析(IMDb)。在匹配的隐私预算下,他们的方法在测试准确率上持续优于标准差分隐私训练和一种领先的选择性更新方法,通常高出约 0.5 到 2 个百分点。它也以更平滑、更快速的收敛达到了这些准确率。针对成员推断攻击(攻击者试图判断某个特定人的数据是否被用于训练)的易受性测量接近随机猜测水平,表明准确性提升并未以削弱经验隐私为代价。

对注重隐私的学习的启示

简言之,论文表明,通过仅在慎重挑选的更新上花费隐私预算并将噪声水平与训练阶段相匹配,私有深度学习可以同时变得更安全和更有效。借助用于比较候选步骤的微小缓冲区和逐步平稳学习过程的调度,DPSGD-BR 将相同的形式化隐私保证转化为更有用的学习进展。对于实践者来说,这提示了一条实用路径,使模型在尊重个人数据的同时,在现实世界的视觉和语言任务上仍保持竞争力的准确性。

引用: Deng, S., Zhang, K., Zhang, W. et al. Stabilizing updates in differentially private stochastic gradient descent with buffered rejection. Sci Rep 16, 13961 (2026). https://doi.org/10.1038/s41598-026-44009-2

关键词: 差分隐私, 深度学习, 随机梯度下降, 隐私保护训练, 成员推断