Clear Sky Science · es

Estabilización de las actualizaciones en descenso por gradiente estocástico diferencialmente privado con rechazo en búfer

Por qué importa el aprendizaje privado

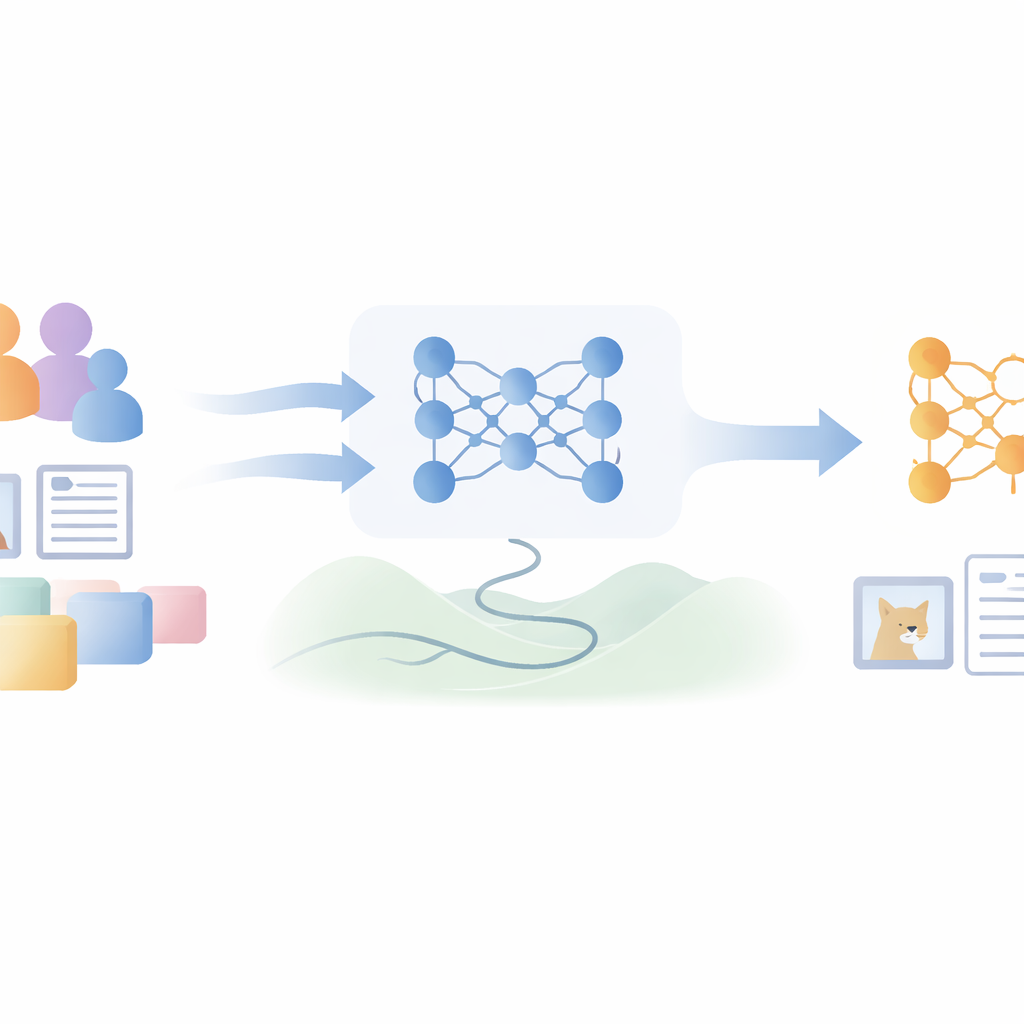

Las aplicaciones modernas aprenden a partir de grandes colecciones de fotos, historiales médicos y mensajes personales. Estos datos pueden hacer que los modelos de aprendizaje automático sean más inteligentes, pero también generan riesgos: un modelo podría revelar accidentalmente información sobre las personas de las que aprendió. La privacidad diferencial es un conjunto matemático de herramientas que pretende evitar esto. El artículo que resume este texto presenta una forma de entrenar redes neuronales profundas que mantiene garantías sólidas de privacidad a la vez que recupera parte de la precisión que normalmente se pierde por el ruido añadido para preservar la privacidad.

El reto del entrenamiento ruidoso

Para proteger a las personas, el entrenamiento con privacidad diferencial inyecta ruido aleatorio en cada pequeño paso que da el modelo durante el aprendizaje. Este ruido oculta la contribución de cualquier persona en los datos, pero también dificulta el aprendizaje: las actualizaciones del modelo se vuelven inestables, el progreso se ralentiza y la precisión final cae respecto al entrenamiento no privado. Métodos anteriores intentaron ser más selectivos, omitiendo actualizaciones que parecían poco útiles al evaluarlas con un pequeño lote de validación. Sin embargo, esas decisiones seguían dependiendo de una única medida ruidosa, por lo que buenas actualizaciones podían descartarse y malas aceptarse por error, desperdiciando el limitado “presupuesto de privacidad” que regula cuánto acceso a los datos está permitido.

Elegir mejores pasos con poca memoria

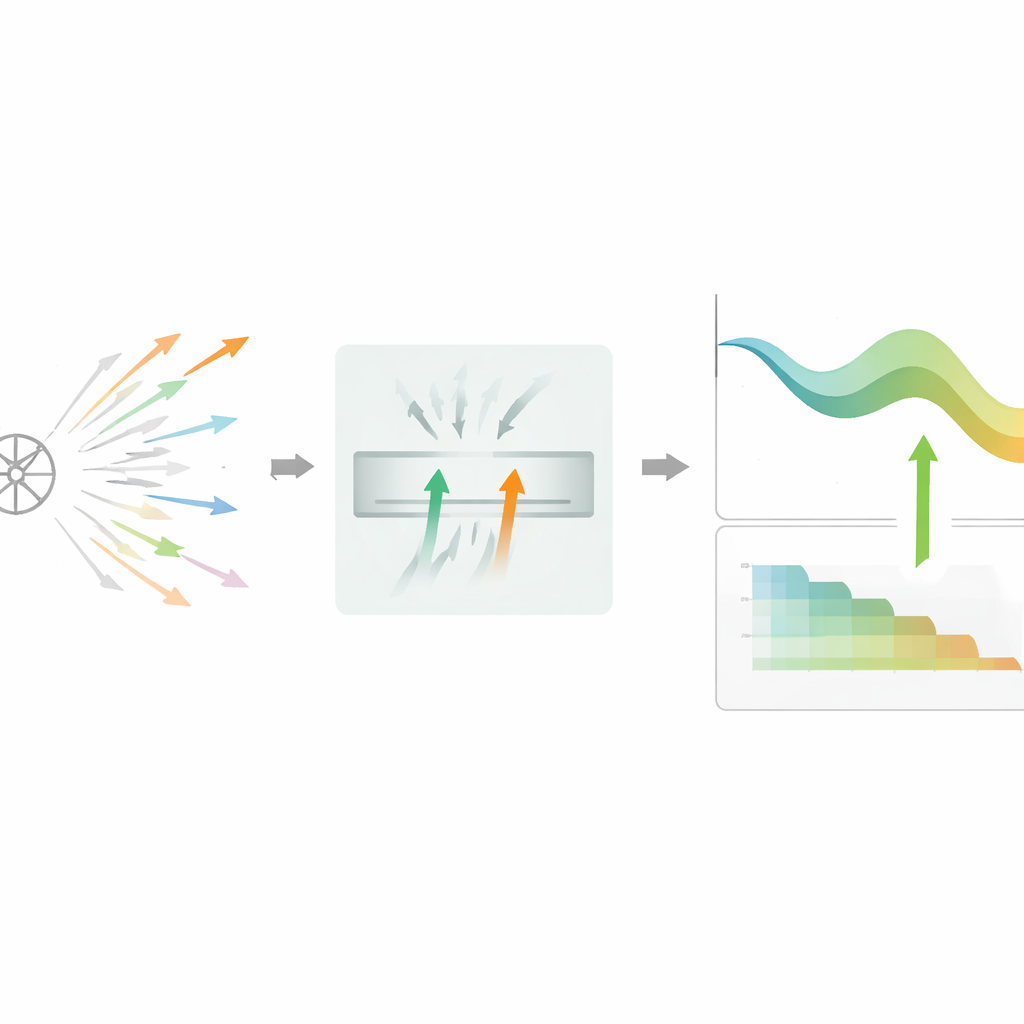

Los autores proponen DPSGD-BR, un algoritmo que cambia la forma en que el modelo decide qué pasos de aprendizaje conservar. En lugar de juzgar una actualización candidata a la vez, el método mantiene un pequeño búfer de dos candidatos prometedores que ya han pasado una comprobación privada rápida. Luego compara sus reducciones de pérdida ruidosas y prefiere la que parezca más útil, a veces eligiendo al azar si ambas parecen igualmente buenas. Esta comparación entre dos vías cancela parte de la aleatoriedad, haciendo las decisiones menos sensibles a una sola lectura ruidosa. Si el filtro se vuelve demasiado estricto y se rechazan muchas candidaturas seguidas, el algoritmo cambia automáticamente a un modo más sencillo de candidato único para que el entrenamiento no se estanque cerca de regiones planas o difíciles de la superficie de pérdida.

Adaptación del ruido y del tamaño de paso a lo largo del tiempo

Más allá de una selección más inteligente, DPSGD-BR también adapta sus parámetros clave a lo largo del entrenamiento. Tras cada actualización aceptada, comprueba cuánto ha mejorado la precisión en validación. Cuando el modelo aprende con rapidez, el método reduce tanto el nivel de ruido como la tasa de aprendizaje de forma más agresiva, ayudando a salir de una fase temprana muy ruidosa hacia un régimen más estable. Más adelante, cuando el progreso se ralentiza, decrementa estas cantidades más suavemente y relaja la regla de rechazo, permitiendo pasar más actualizaciones para que el modelo pueda afinarse. Todo esto ocurre dentro de un marco de contabilidad estricto, que rastrea cuánto presupuesto de privacidad se ha gastado y detiene la mayor reducción una vez que se aproxima un límite predefinido.

Qué muestran los experimentos

Los investigadores probaron DPSGD-BR en conjuntos de referencia conocidos: dos conjuntos de imágenes manuscritas y de ropa (MNIST y Fashion-MNIST), un conjunto de imágenes naturales más complejo (CIFAR-10) y análisis de sentimiento en reseñas de películas (IMDb). Con presupuestos de privacidad equivalentes, su método consiguió de forma consistente mayor precisión en test que el entrenamiento diferencialmente privado estándar y que un método selectivo de referencia, normalmente entre aproximadamente medio punto porcentual y dos puntos. También alcanzó esas precisiones con una convergencia más suave y rápida. Las mediciones de vulnerabilidad frente a ataques de inferencia de membresía —donde un adversario intenta determinar si los datos de una persona concreta se usaron para el entrenamiento— se mantuvieron cerca del nivel de adivinanza aleatoria, lo que indica que las ganancias de precisión no vinieron a costa de una privacidad empírica más débil.

Conclusión para el aprendizaje consciente de la privacidad

En términos sencillos, el artículo muestra que el aprendizaje profundo privado puede hacerse a la vez más seguro y más eficaz gastando el presupuesto de privacidad solo en actualizaciones bien elegidas y ajustando los niveles de ruido al estadio del entrenamiento. Con un pequeño búfer que compara pasos candidatos y un calendario que calma gradualmente el proceso de aprendizaje, DPSGD-BR convierte la misma garantía formal de privacidad en un progreso de aprendizaje más útil. Para los profesionales, esto sugiere un camino práctico hacia modelos que respetan los datos de las personas sin dejar de ser competitivos en precisión en tareas reales de visión y lenguaje.

Cita: Deng, S., Zhang, K., Zhang, W. et al. Stabilizing updates in differentially private stochastic gradient descent with buffered rejection. Sci Rep 16, 13961 (2026). https://doi.org/10.1038/s41598-026-44009-2

Palabras clave: privacidad diferencial, aprendizaje profundo, descenso por gradiente estocástico, entrenamiento con preservación de la privacidad, inferencia de membresía