Clear Sky Science · tr

Arabeliğe dayalı reterktif reddetme ile farklı gizlilikli stokastik gradyan inişinde güncelleştirmeleri dengeleme

Neden özel öğrenme önemli

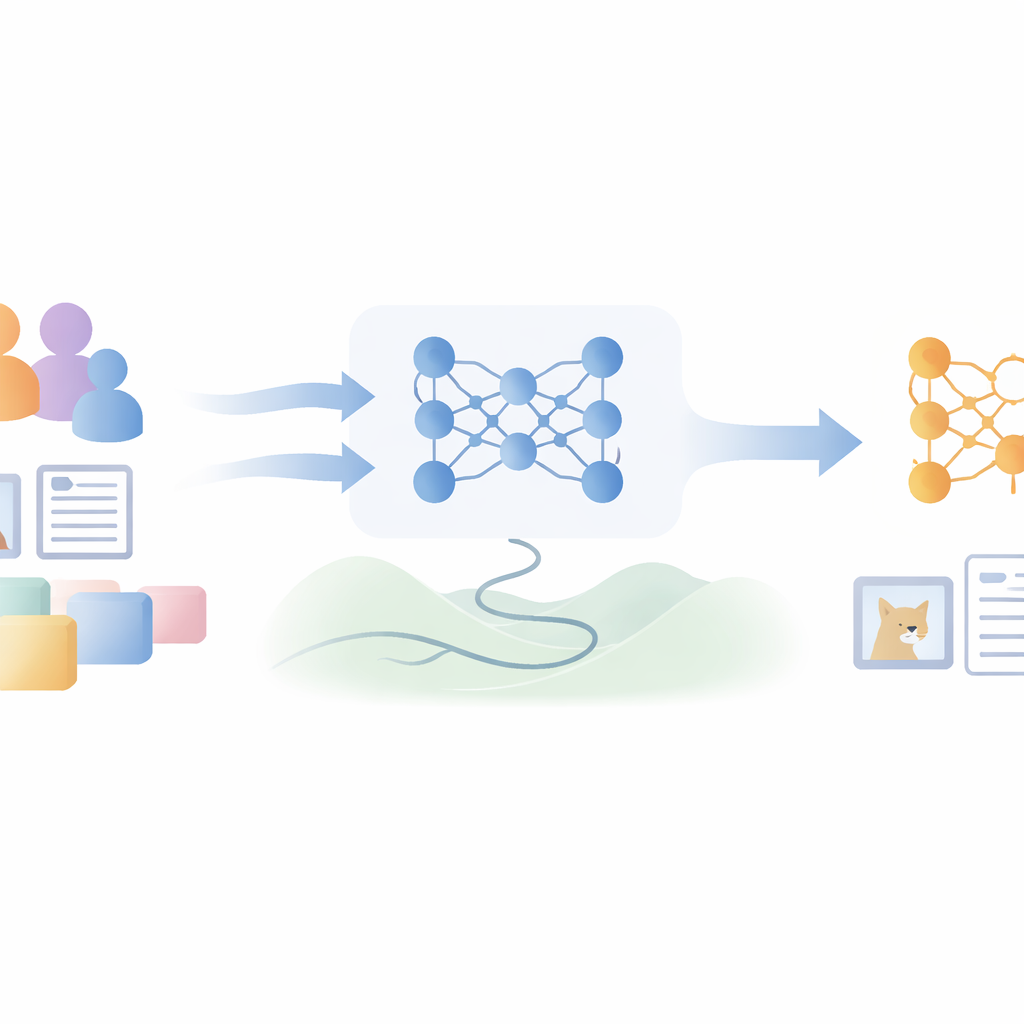

Modern uygulamalar büyük fotoğraf, tıbbi kayıt ve kişisel mesaj koleksiyonlarından öğrenir. Bu veriler makine öğrenmesi modellerini daha akıllı yapabilir, ancak aynı zamanda riskler yaratır: bir model öğrendiği kişiler hakkında istemeden bilgi açığa çıkarabilir. Farklı gizlilik, bunu engellemeyi amaçlayan matematiksel bir araç takımıdır. Bu özetin dayandığı makale, güçlü gizlilik garantilerini korurken gizliliği koruyan gürültü yüzünden genellikle kaybedilen bazı doğrulukları geri kazandıran bir derin sinir ağı eğitme yöntemi sunuyor.

Gürültülü eğitim sorunu

Bireyleri korumak için farklı gizlilikli eğitim, modelin öğrenme sırasında attığı her küçük adımda rastgele gürültü enjekte eder. Bu gürültü, verideki tek bir kişinin katkısını gizler, ancak öğrenmeyi de zorlaştırır: modelin güncelleştirmeleri sarsıntılı hale gelir, ilerleme yavaşlar ve nihai doğruluk, gizliliksiz eğitime kıyasla düşer. Önceki yöntemler daha seçici olmaya çalışarak küçük bir doğrulama partisi üzerinde yararsız görünen güncelleştirmeleri atlamayı denediler. Ancak bu kararlar hâlâ tek bir gürültülü ölçüme dayanıyordu, bu yüzden iyi güncelleştirmeler elenebilir ve kötü olanlar kazayla kabul edilebilirdi; bu da ne kadar veri erişimine izin verildiğini yöneten sınırlı “gizlilik bütçesini” boşa harcar.

Küçük bir bellekle daha iyi adımlar seçmek

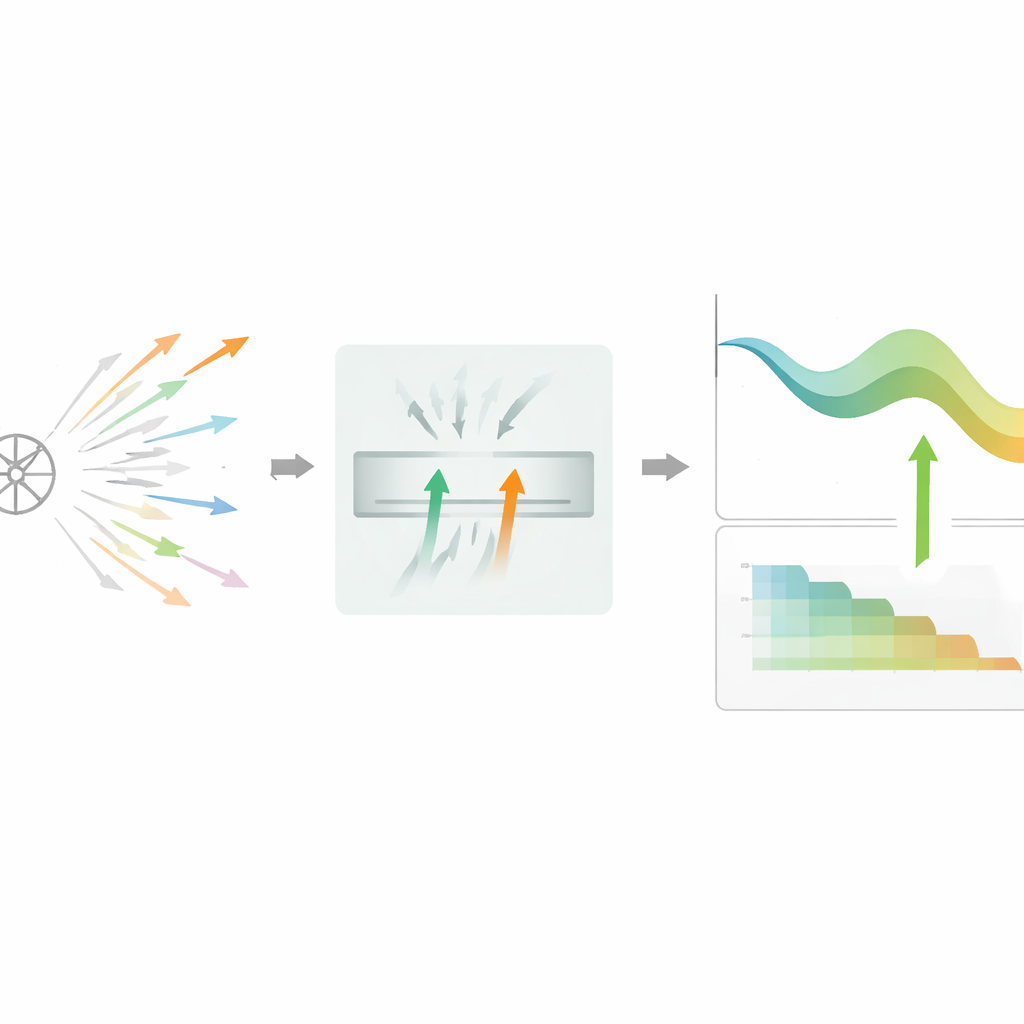

Yazarlar, modelin hangi öğrenme adımlarını tutacağına karar verme şeklini değiştiren DPSGD-BR adlı bir algoritma öneriyor. Aday bir güncelleştirmeyi tek başına değerlendirmek yerine, yöntem hızlı bir özel kontrolden geçmiş iki umut vaat eden adayı küçük bir tamponda tutar. Ardından bunların gürültülü kayıp azalmalarını karşılaştırır ve daha faydalı görüneni tercih eder; eşit görünürlerse bazen rastgele seçim yapar. Bu iki yönlü karşılaştırma rastgeleliğin bir kısmını iptal eder ve kararları tek bir gürültülü okumaya daha az duyarlı kılar. Filtre çok katı hale gelip ardışık olarak birçok aday reddedilirse, algoritma otomatik olarak tek adaylı daha basit bir moda geçer, böylece eğitim kayıp yüzeyinin düz veya zor bölgelerinde takılmaz.

Zaman içinde gürültü ve adım boyutunu uyarlamak

Daha akıllı seçimlerin ötesinde, DPSGD-BR eğitim boyunca temel düğmelerini de uyarlıyor. Her kabul edilen güncellemeden sonra doğrulama doğruluğunun ne kadar iyileştiğini kontrol eder. Model hızla öğreniyorsa, yöntem gürültü seviyesini ve öğrenme oranını daha agresif biçimde azaltır; bu, çok gürültülü erken aşamadan daha kararlı bir rejime geçmeye yardımcı olur. İlerleme yavaşladığında ise bu değerleri daha nazikçe azaltır ve reddetme kuralını gevşetir; böylece daha fazla güncelleme geçer ve model ince ayar yapabilir. Tüm bunlar, harcanan gizlilik bütçesini izleyen sıkı bir muhasebe çerçevesi altında gerçekleşir ve önceden belirlenmiş bir sınıra yaklaşılınca daha fazla azalmaya izin verilmez.

Deneyler ne gösteriyor

Araştırmacılar DPSGD-BR’yi tanınmış ölçütler üzerinde test etti: iki el yazısı ve giysi görsel veri seti (MNIST ve Fashion-MNIST), daha karmaşık bir doğal görüntü seti (CIFAR-10) ve film incelemesi duygu analizini (IMDb). Eşleştirilmiş gizlilik bütçeleri altında, yöntemleri standart farklı gizlilikli eğitim ve önde gelen seçici güncelleme yöntemine kıyasla tutarlı biçimde daha yüksek test doğruluğu elde etti; genellikle yaklaşık yarım ila iki puan daha iyi. Ayrıca bu doğruluklara daha düzgün, daha hızlı yakınsama ile ulaştı. Bir düşmanın belirli bir kişinin verisinin eğitimde kullanılıp kullanılmadığını anlamaya çalıştığı üyelik çıkarımı saldırılarına karşı kırılganlık ölçümleri, rastgele tahmin seviyesine yakın kaldı; bu da doğruluk kazançlarının zayıf ampirik gizlilik pahasına olmadığına işaret ediyor.

Gizliliğe duyarlı öğrenme için çıkarım

Basitçe söylemek gerekirse, makale özel derin öğrenmenin yalnızca iyi seçilmiş güncellemelere gizlilik bütçesi harcayarak ve gürültü seviyelerini eğitimin aşamasına göre eşleştirerek hem daha güvenli hem de daha etkili hâle getirilebileceğini gösteriyor. Aday adımları karşılaştıran küçük bir tampon ve öğrenme sürecini kademeli olarak sakinleştiren bir zaman çizelgesiyle, DPSGD-BR aynı biçimsel gizlilik garantisini daha kullanışlı öğrenme ilerlemesine dönüştürüyor. Uygulayıcılar için bu, bireylerin verilerine saygı gösterirken gerçek dünya görsel ve dil görevlerinde doğruluk açısından rekabetçi kalmayı sağlayacak pratik bir yol sunuyor.

Atıf: Deng, S., Zhang, K., Zhang, W. et al. Stabilizing updates in differentially private stochastic gradient descent with buffered rejection. Sci Rep 16, 13961 (2026). https://doi.org/10.1038/s41598-026-44009-2

Anahtar kelimeler: farklı gizlilik, derin öğrenme, stokastik gradyan inişi, gizliliği koruyan eğitim, üyelik çıkarımı