Clear Sky Science · ru

Стабилизация обновлений в дифференциально-приватном стохастическом градиентном спуске с буферным отбрасыванием

Почему приватное обучение важно

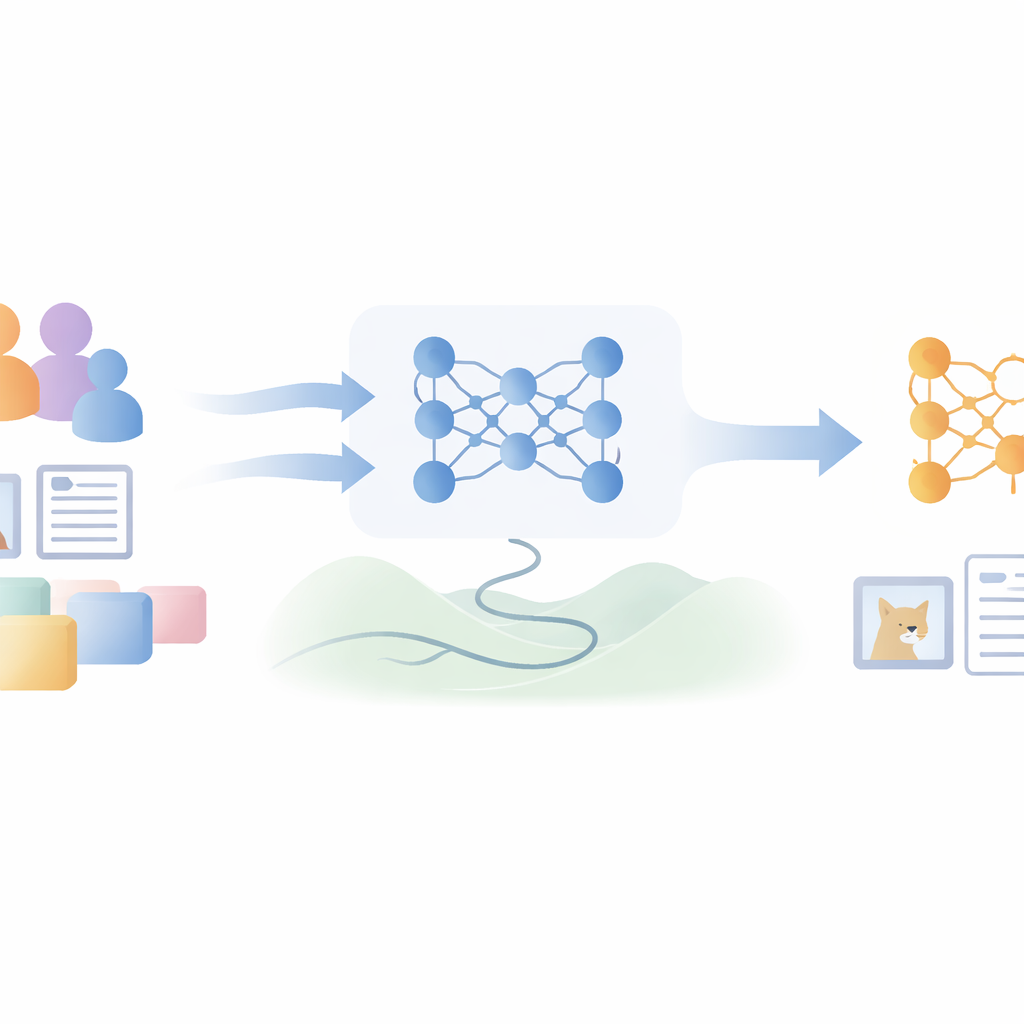

Современные приложения обучаются на огромных наборах фотографий, медицинских записей и личных сообщений. Эти данные делают модели машинного обучения умнее, но они также создают риски: модель может случайно раскрыть сведения о людях, на которых обучалась. Дифференциальная приватность — это математический набор инструментов, цель которого — предотвратить такие утечки. Статья, кратко изложенная здесь, предлагает способ обучения глубоких нейронных сетей, который сохраняет строгие гарантии приватности, одновременно частично возвращая точность, обычно теряемую из‑за шумов, вводимых ради приватности.

Проблема шумного обучения

Чтобы защитить личности, при дифференциально‑приватном обучении в каждый малый шаг модели вводят случайный шум. Этот шум скрывает вклад любого отдельного человека в данные, но также затрудняет обучение: обновления модели становятся колебательными, прогресс замедляется, а итоговая точность снижается по сравнению с непиватным обучением. Ранее предлагали методы более избирательного подхода — пропускать обновления, которые выглядят бесполезными по оценке на небольшой проверочной выборке. Однако такие решения по‑прежнему опирались на одиночное шумное измерение, поэтому хорошие обновления могли отвергаться, а плохие — случайно приниматься, тратя ограниченный «бюджет приватности», который определяет, сколько обращений к данным разрешено.

Выбор лучших шагов с небольшой памятью

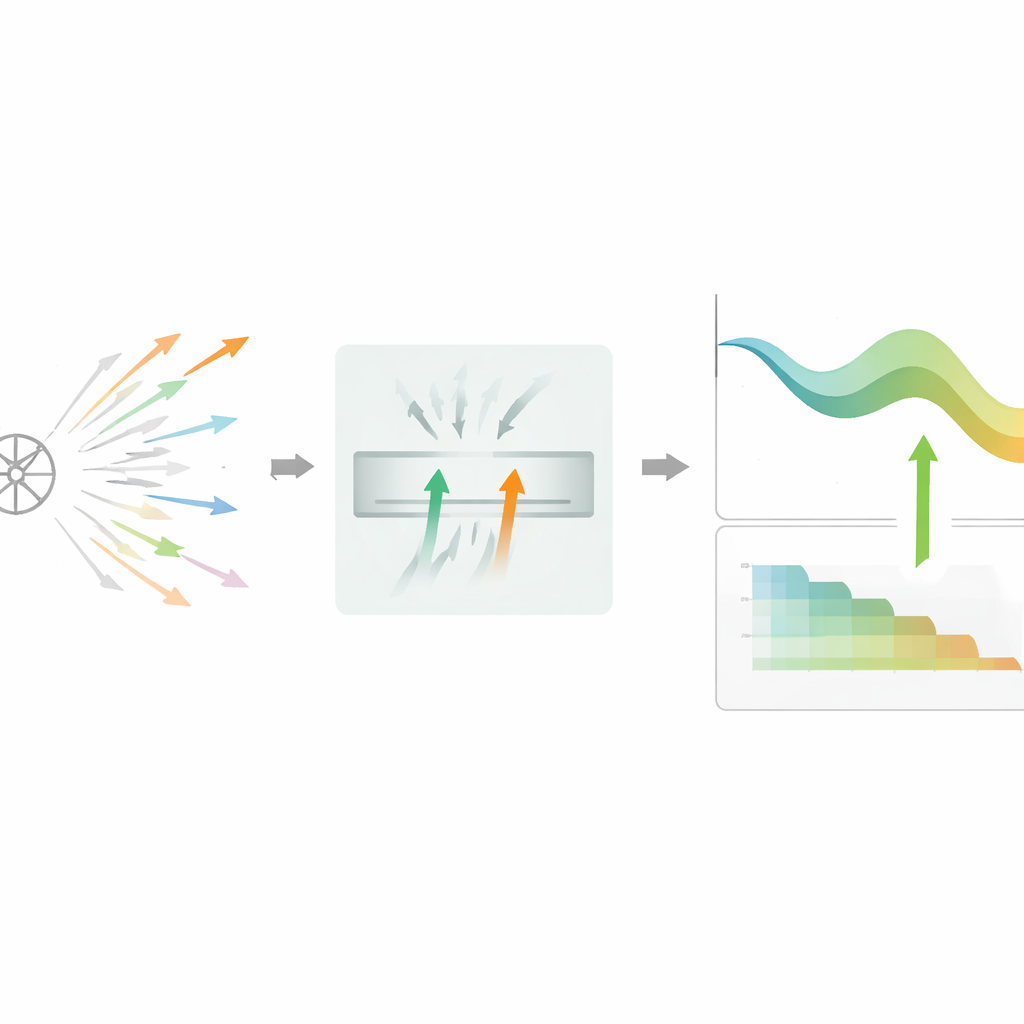

Авторы предлагают DPSGD‑BR — алгоритм, меняющий способ принятия решения о том, какие шаги обучения сохранить. Вместо оценки одного кандидата за раз метод хранит крошечный буфер из двух перспективных кандидатов, уже прошедших быстрое приватное тестирование. Затем он сравнивает их шумные уменьшения функции потерь и предпочитает тот, который выглядит более полезным, иногда выбирая случайно, если они кажутся равноценными. Такое двустороннее сравнение частично нейтрализует случайность, делая решения менее зависимыми от одного шумного измерения. Если фильтр становится слишком строгим и подряд отвергается много кандидатов, алгоритм автоматически переключается в более простой режим с одним кандидатом, чтобы обучение не застопорилось вблизи плоских или сложных участков поверхности потерь.

Адаптация шума и шага по ходу обучения

Помимо более умного отбора, DPSGD‑BR также адаптирует ключевые настройки в ходе обучения. После каждого принятого обновления он проверяет, насколько улучшилась валидационная точность. Когда модель учится быстро, метод более агрессивно снижает и уровень шума, и шаг обучения, помогая выйти из очень шумной ранней фазы в более стабильный режим. Позже, когда прогресс замедляется, эти величины убывают мягче, а правило отбрасывания смягчается, позволяя пропускать больше обновлений, чтобы модель могла доводить тонкую настройку. Всё это происходит в рамках строгого учёта, который отслеживает, сколько приватного бюджета уже потрачено, и прекращает дальнейшее ослабление по мере приближения к заранее заданному пределу.

Что показывают эксперименты

Исследователи протестировали DPSGD‑BR на известных бенчмарках: двух наборах изображений рукописных цифр и одежды (MNIST и Fashion‑MNIST), более сложном наборе натуральных изображений (CIFAR‑10) и анализе тональности обзоров фильмов (IMDb). При сопоставимых бюджетах приватности их метод последовательно показывал более высокую тестовую точность по сравнению со стандартным дифференциально‑приватным обучением и ведущим методом с селективным отбором обновлений, обычно на ~0.5–2 процентных пункта. Он также достигал этой точности с более плавной и быстрой сходимостью. Измерения уязвимости к атакам на выявление членства — когда злоумышленник пытается определить, использовались ли данные конкретного человека при обучении — оставались близкими к уровню случайного угадывания, что указывает на то, что прирост точности не сопровождался ослаблением эмпирической приватности.

Вывод для практиков, заботящихся о приватности

Проще говоря, статья показывает, что приватное глубокое обучение можно сделать одновременно безопаснее и эффективнее, тратя бюджет приватности только на тщательно отобранные обновления и подбирая уровни шума в зависимости от стадии обучения. С крошечным буфером для сравнения кандидатов и графиком, который постепенно успокаивает процесс обучения, DPSGD‑BR превращает формальное требование приватности в более полезный прогресс обучения. Для практиков это указывает на практический путь к моделям, уважающим данные людей и при этом конкурентоспособным по точности в реальных задачах компьютерного зрения и обработки языка.

Цитирование: Deng, S., Zhang, K., Zhang, W. et al. Stabilizing updates in differentially private stochastic gradient descent with buffered rejection. Sci Rep 16, 13961 (2026). https://doi.org/10.1038/s41598-026-44009-2

Ключевые слова: дифференциальная приватность, глубокое обучение, стохастический градиентный спуск, обучение с сохранением приватности, атаки на выявление членства