Clear Sky Science · pt

Estabilizando atualizações no gradiente descendente estocástico diferencialmente privado com rejeição em buffer

Por que o aprendizado privado importa

Aplicativos modernos aprendem a partir de grandes coleções de fotos, prontuários médicos e mensagens pessoais. Esses dados podem tornar modelos de aprendizado de máquina mais inteligentes, mas também criam riscos: um modelo pode revelar acidentalmente algo sobre as pessoas com as quais foi treinado. Privacidade diferencial é um arcabouço matemático que busca evitar isso. O artigo resumido aqui propõe uma forma de treinar redes neurais profundas que mantém fortes garantias de privacidade enquanto recupera parte da acurácia normalmente perdida pelo ruído usado para preservar a privacidade.

O desafio do treinamento ruidoso

Para proteger indivíduos, o treinamento diferencialmente privado injeta ruído aleatório em cada pequeno passo que o modelo dá durante o aprendizado. Esse ruído oculta a contribuição de qualquer pessoa nos dados, mas também dificulta o aprendizado: as atualizações do modelo ficam instáveis, o progresso desacelera e a acurácia final cai em comparação com o treinamento não privado. Métodos anteriores tentaram ser mais seletivos, pulando atualizações que parecessem pouco úteis quando avaliadas em um pequeno lote de validação. No entanto, essas decisões ainda dependiam de uma única medição ruidosa, de modo que boas atualizações podiam ser descartadas e atualizações ruins aceitas por engano, desperdiçando o “orçamento de privacidade” limitado que governa quanto acesso aos dados é permitido.

Escolhendo passos melhores com uma pequena memória

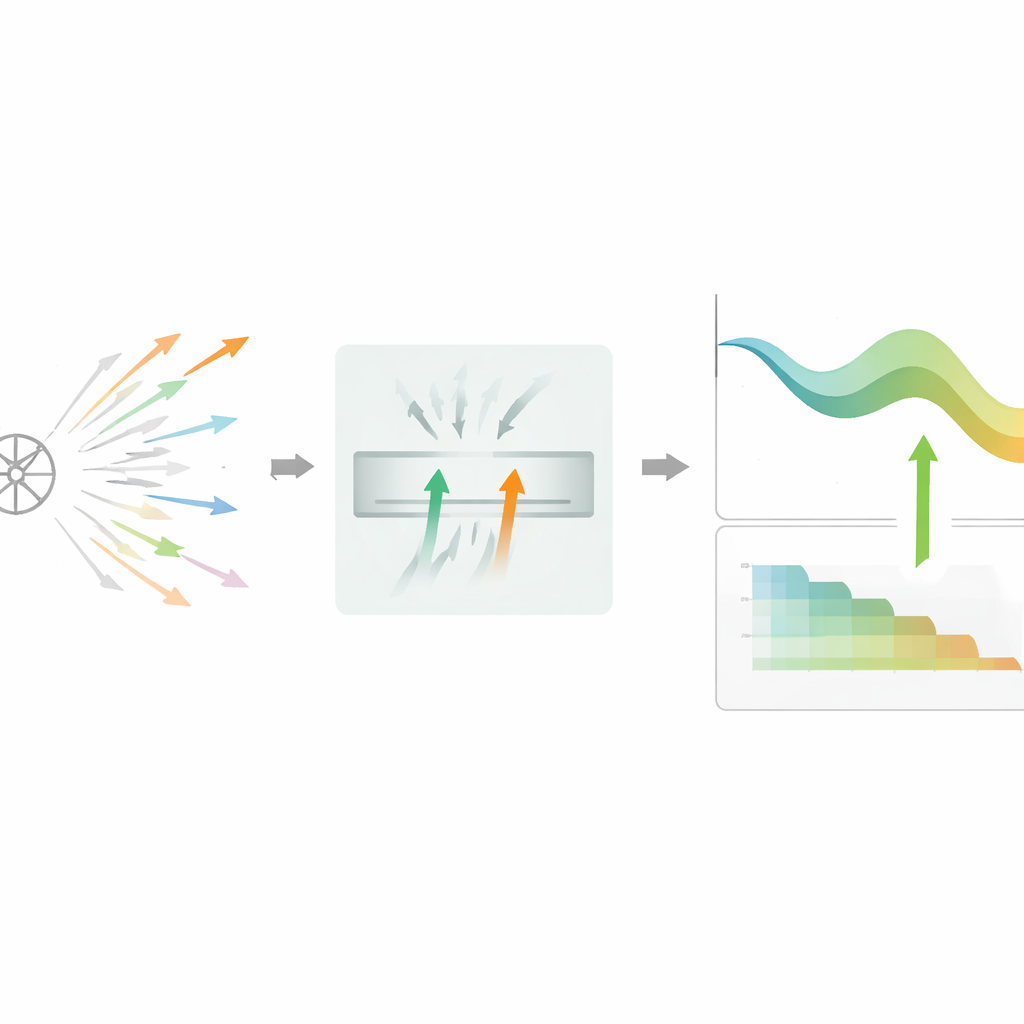

Os autores propõem DPSGD-BR, um algoritmo que altera como o modelo decide quais passos de aprendizado manter. Em vez de julgar uma atualização candidata por vez, o método mantém um pequeno buffer com dois candidatos promissores que já passaram por uma verificação privada rápida. Em seguida compara suas reduções de perda ruidosas e prefere a que parece mais útil, às vezes escolhendo aleatoriamente se elas parecerem igualmente boas. Essa comparação dupla cancela parte da aleatoriedade, tornando as decisões menos sensíveis a uma única leitura ruidosa. Se o filtro ficar muito severo e muitos candidatos forem rejeitados em sequência, o algoritmo muda automaticamente para um modo mais simples de candidato único para que o treinamento não estacione próximo a regiões planas ou difíceis da superfície de perda.

Adaptando ruído e taxa de aprendizado ao longo do tempo

Além da seleção mais inteligente, o DPSGD-BR também adapta seus principais parâmetros ao longo do treinamento. Após cada atualização aceita, verifica quanto a acurácia de validação melhorou. Quando o modelo aprende rapidamente, o método reduz tanto o nível de ruído quanto a taxa de aprendizado de forma mais agressiva, ajudando a sair de uma fase inicial muito ruidosa rumo a um regime mais estável. Mais tarde, quando o progresso desacelera, decai essas quantidades mais suavemente e relaxa a regra de rejeição, permitindo mais atualizações para que o modelo possa afinar-se. Tudo isso ocorre sob um rigoroso enquadramento de contabilização, que rastreia quanto do orçamento de privacidade foi gasto e interrompe mais decaimentos quando um limite predefinido está próximo.

O que os experimentos mostram

Os pesquisadores testaram o DPSGD-BR em benchmarks conhecidos: dois conjuntos de imagens manuscritas e de roupas (MNIST e Fashion-MNIST), um conjunto de imagens naturais mais complexo (CIFAR-10) e análise de sentimento de resenhas de filmes (IMDb). Com orçamentos de privacidade equivalentes, o método alcançou consistentemente maior acurácia de teste do que o treinamento diferencialmente privado padrão e um método seletivo de referência, geralmente por cerca de meio ponto percentual até dois pontos. Também alcançou essas acurácias com convergência mais suave e mais rápida. Medidas de vulnerabilidade a ataques de inferência de pertencimento — onde um adversário tenta determinar se os dados de uma pessoa específica foram usados no treinamento — permaneceram próximas ao nível de um palpite aleatório, indicando que os ganhos de acurácia não ocorreram às custas de uma privacidade empírica mais fraca.

Conclusão para aprendizado com foco em privacidade

Em termos simples, o artigo mostra que o aprendizado profundo privado pode ser tanto mais seguro quanto mais eficaz ao gastar orçamento de privacidade apenas em atualizações bem escolhidas e ao adequar os níveis de ruído ao estágio do treinamento. Com um pequeno buffer que compara passos candidatos e um cronograma que acalma gradualmente o processo de aprendizado, o DPSGD-BR transforma a mesma garantia formal de privacidade em progresso de aprendizado mais útil. Para praticantes, isso sugere um caminho prático para modelos que respeitam os dados dos indivíduos enquanto permanecem competitivos em acurácia em tarefas reais de visão e linguagem.

Citação: Deng, S., Zhang, K., Zhang, W. et al. Stabilizing updates in differentially private stochastic gradient descent with buffered rejection. Sci Rep 16, 13961 (2026). https://doi.org/10.1038/s41598-026-44009-2

Palavras-chave: privacidade diferencial, aprendizado profundo, gradiente descendente estocástico, treinamento que preserva privacidade, inferência de pertencimento