Clear Sky Science · nl

Stabiliseren van updates in differentieel privé stochastische gradiëntdescent met gebufferde afwijzing

Waarom privé leren ertoe doet

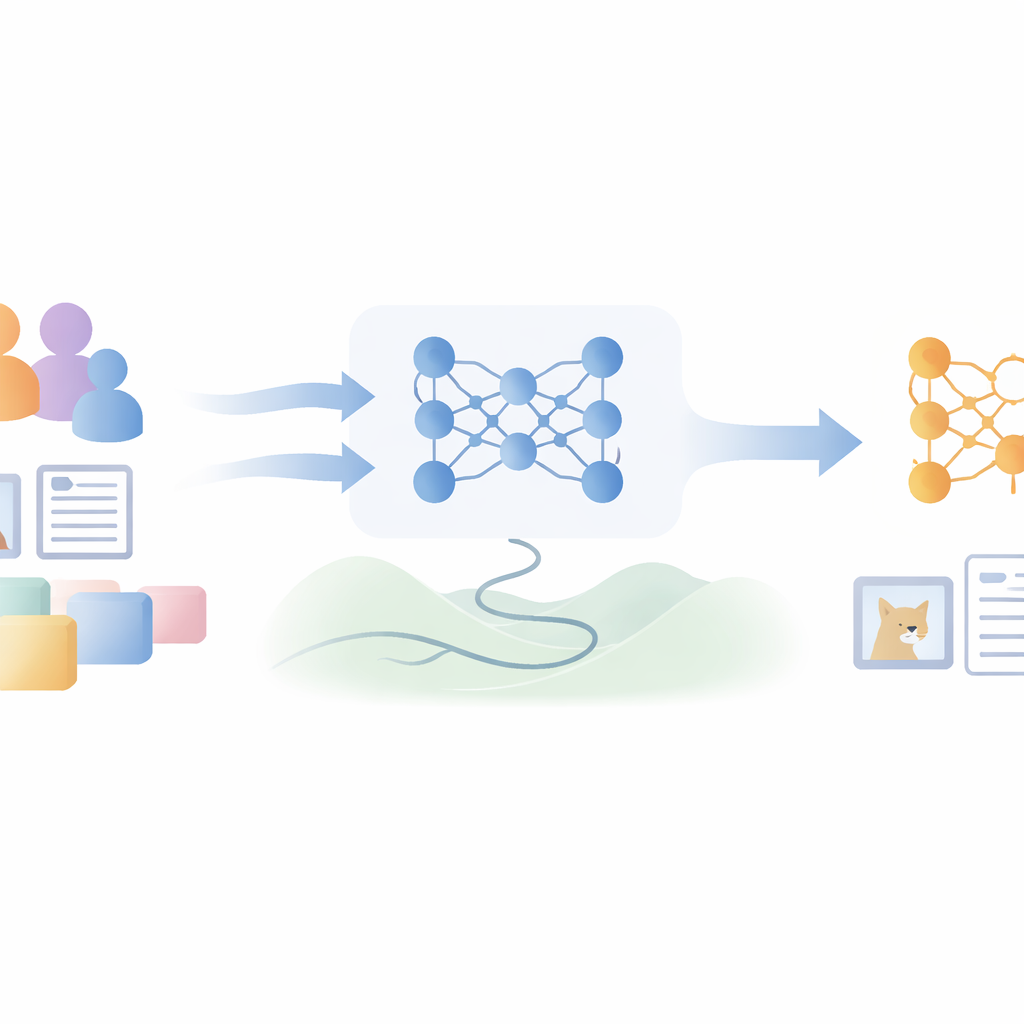

Moderne apps leren van enorme verzamelingen foto’s, medische dossiers en persoonlijke berichten. Deze data kan machine learning-modellen slimmer maken, maar ze brengt ook risico’s met zich mee: een model kan per ongeluk iets onthullen over de mensen waar het van geleerd heeft. Differentiële privacy is een wiskundig gereedschap dat tot doel heeft dit te voorkomen. Het artikel achter deze samenvatting introduceert een manier om diepe neurale netwerken te trainen die sterke privacygaranties behoudt terwijl het een deel van de nauwkeurigheid terugwint die gewoonlijk verloren gaat door privacybehoudende ruis.

De uitdaging van ruisrijke training

Om individuen te beschermen, voegt differentieel privé trainen willekeurige ruis toe aan elke kleine stap die het model tijdens het leren maakt. Deze ruis verbergt de bijdrage van één enkele persoon in de data, maar maakt het leren ook moeilijker: de updates van het model worden wankel, vooruitgang vertraagt en de uiteindelijke nauwkeurigheid daalt vergeleken met niet-prive training. Eerdere methoden probeerden selectiever te zijn en sloegen updates over die onbruikbaar leken bij evaluatie op een kleine validatiebatch. Die beslissingen waren echter nog steeds gebaseerd op één enkele rumoerige meting, waardoor goede updates weggegooid en slechte per ongeluk geaccepteerd konden worden, en daarmee de beperkte “privacybudget” die bepaalt hoeveel toegang tot data is toegestaan, verspild werd.

Beter stappen kiezen met een klein geheugen

De auteurs stellen DPSGD-BR voor, een algoritme dat verandert hoe het model beslist welke leerstappen behouden worden. In plaats van één kandidaat-update tegelijk te beoordelen, houdt de methode een klein buffer bij van twee veelbelovende kandidaten die al een snelle privécontrole hebben doorstaan. Vervolgens vergelijkt het hun rumoerige verliesreducties en geeft de voorkeur aan degene die nuttiger lijkt, en kiest soms willekeurig als ze even goed lijken. Deze vergelijking tussen twee kandidaten heft een deel van de willekeur op, waardoor beslissingen minder gevoelig worden voor één enkele rumoerige meting. Als de filter te streng wordt en veel kandidaten achtereenvolgens worden afgewezen, schakelt het algoritme automatisch over naar een eenvoudigere modus met één kandidaat zodat de training niet vastloopt nabij vlakke of moeilijke gebieden van het verliesoppervlak.

Ruis en stapgrootte in de tijd aanpassen

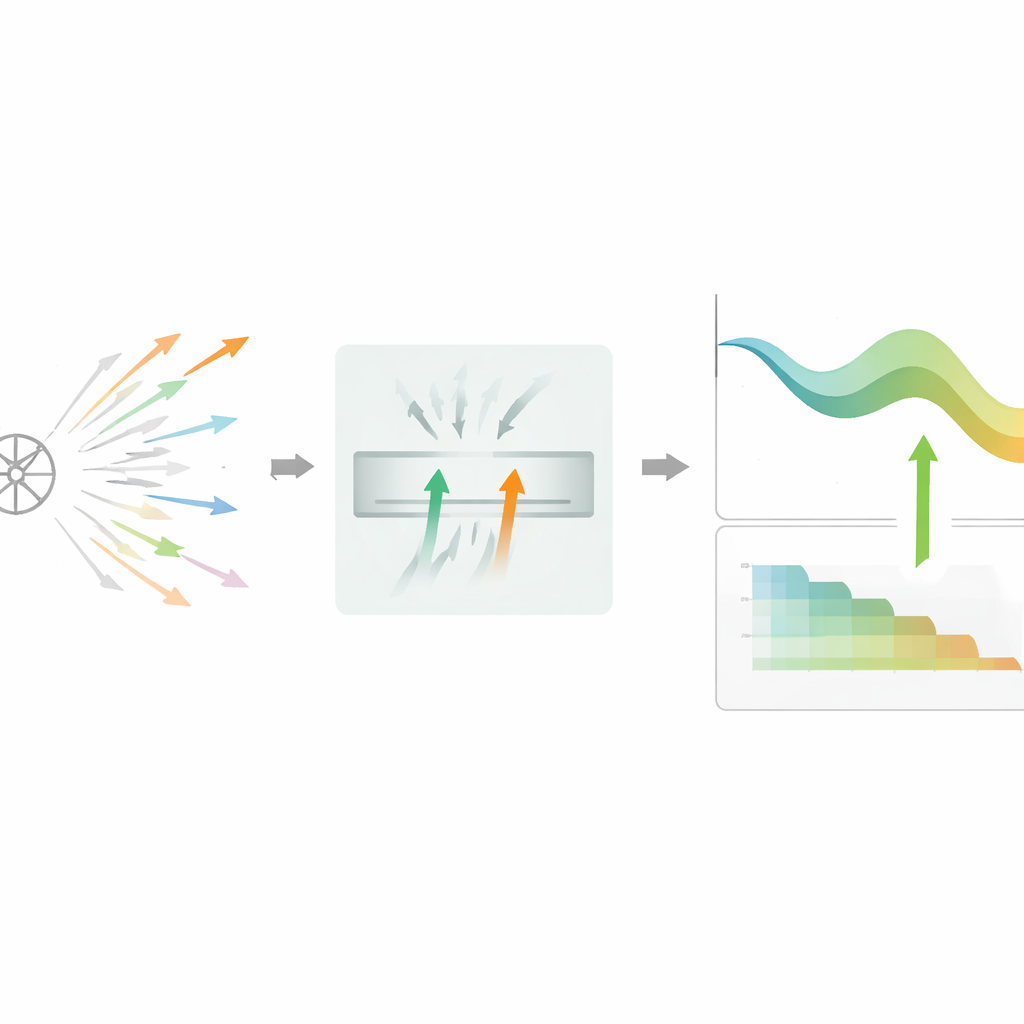

Naast slimmer selecteren past DPSGD-BR ook zijn belangrijkste knoppen gedurende de training aan. Na elke geaccepteerde update controleert het hoeveel validatienauwkeurigheid is verbeterd. Wanneer het model snel leert, verlaagt de methode zowel het ruisniveau als de leersnelheid agressiever, waardoor het kan ontwaken uit een zeer rumoerige vroege fase naar een stabieler regime. Later, wanneer de vooruitgang afneemt, verlaagt het deze grootheden geleidelijker en versoepelt het de afwijzingsregel, zodat meer updates worden doorgelaten en het model kan fijnslijpen. Dit alles gebeurt binnen een strikt verantwoordingkader, dat bijhoudt hoeveel privacybudget is besteed en verdere afname stopt zodra een vooraf ingesteld limiet in zicht komt.

Wat de experimenten laten zien

De onderzoekers testten DPSGD-BR op bekende benchmarks: twee handgeschreven en kledingbeeldsets (MNIST en Fashion-MNIST), een complexere set natuurlijke beelden (CIFAR-10) en sentimentanalyse van filmrecensies (IMDb). Bij gelijke privacybudgetten behaalde hun methode consequent een hogere testnauwkeurigheid dan standaard differentieel privé trainen en een toonaangevende selectieve-update methode, meestal met ongeveer een halve procentpunt tot twee punten verschil. Het bereikte deze nauwkeurigheden ook met vloeiendere, snellere convergentie. Metingen van kwetsbaarheid voor lidmaatschapsinference-aanvallen — waarbij een aanvaller probeert te bepalen of de data van een specifieke persoon voor training is gebruikt — bleven dicht bij het niveau van willekeurige gokking, wat aangeeft dat de nauwkeurigheidswinst niet ten koste ging van zwakkere empirische privacy.

Conclusie voor privacybewust leren

Simpel gezegd laat het artikel zien dat privé deep learning zowel veiliger als effectiever kan worden gemaakt door privacybudget alleen te besteden aan zorgvuldig gekozen updates en door ruisniveaus af te stemmen op de fase van de training. Met een kleine buffer die kandidaatstappen vergelijkt en een schema dat het leerproces geleidelijk kalmeert, zet DPSGD-BR dezelfde formele privacygarantie om in meer bruikbare leerprogressie. Voor praktijkmensen suggereert dit een praktisch pad naar modellen die de data van individuen respecteren en toch competitief blijven qua nauwkeurigheid op realistische visie- en taaktaken.

Bronvermelding: Deng, S., Zhang, K., Zhang, W. et al. Stabilizing updates in differentially private stochastic gradient descent with buffered rejection. Sci Rep 16, 13961 (2026). https://doi.org/10.1038/s41598-026-44009-2

Trefwoorden: differentiële privacy, deep learning, stochastische gradiëntdescent, privacy-beschermende training, lidmaatschapsinference