Clear Sky Science · ar

تثبيت التحديثات في الانحدار التدرُّجي العشوائي الخاص تفاضليًا مع الرفض المخزن مؤقتًا

لماذا يهم التعلّم الخاص

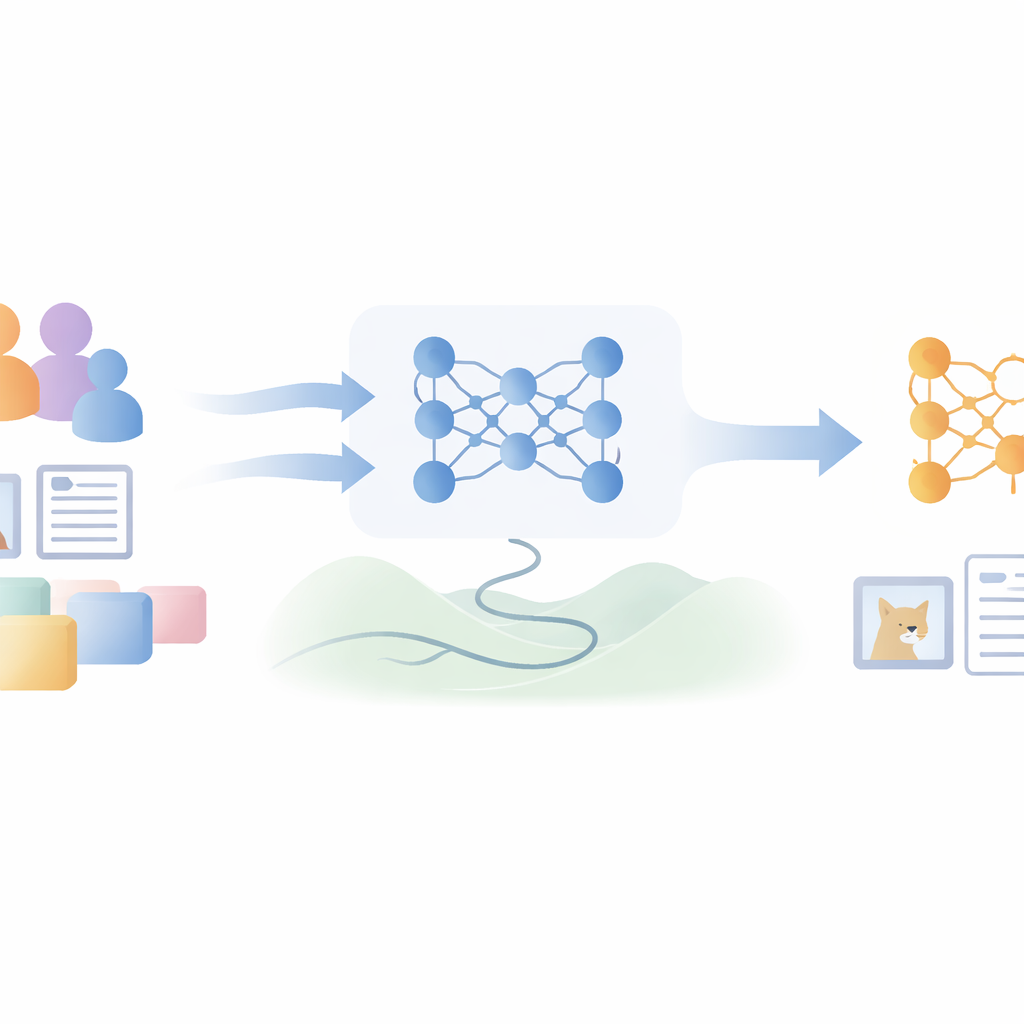

تعتمد التطبيقات الحديثة على مجموعات ضخمة من الصور والسجلات الطبية والرسائل الشخصية للتعلّم. يمكن لهذه البيانات أن تجعل نماذج التعلم الآلي أكثر ذكاءً، لكنها تثير أيضًا مخاطر: فقد يكشف النموذج عن معلومات تخص الأشخاص الذين تعلّم منهم. الخصوصية التفاضلية هي مجموعة أدوات رياضية تهدف إلى منع ذلك. الورقة البحثية الموجزة هنا تقترح طريقة لتدريب الشبكات العصبية العميقة تضمن حماية خصوصية قوية مع استعادة جزء من الدقة التي تُفقد عادةً بسبب الضوضاء المضافة للحفاظ على الخصوصية.

تحدي التدريب المشوش

لحماية الأفراد، يضيف التدريب الخاص تفاضليًا ضوضاء عشوائية إلى كل خطوة صغيرة يتخذها النموذج أثناء التعلّم. تخفي هذه الضوضاء إسهام أي فرد واحد في البيانات، لكنها تجعل التعلم أكثر صعوبة: تصبح تحديثات النموذج هشة، ويتباطأ التقدّم، وتنخفض الدقة النهائية مقارنة بالتدريب غير الخاص. حاولت طرق سابقة أن تكون أكثر انتقائية، متخطيةً التحديثات التي تبدو غير مفيدة عند تقييمها على دفعة تحقق صغيرة. لكن تلك القرارات اعتمدت على قياس صاخب واحد، لذا قد تُرفض تحديثات جيدة أو تُقبل تحديثات سيئة عن طريق الخطأ، مما يهدر "ميزانية الخصوصية" المحدودة التي تتحكم في مدى السماح بالوصول إلى البيانات.

اختيار خطوات أفضل بذاكرة صغيرة

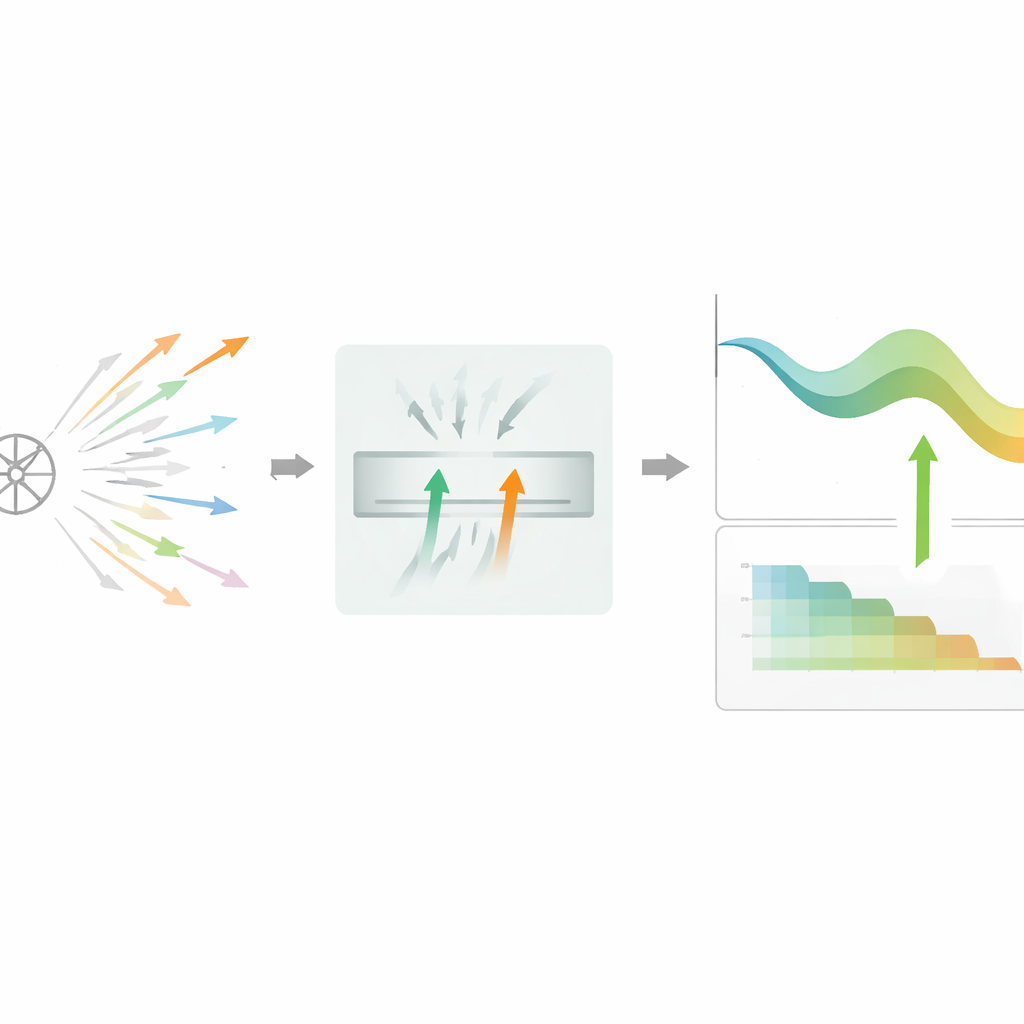

يقترح المؤلفون خوارزمية DPSGD-BR التي تغيّر طريقة قرار النموذج بشأن أي خطوات التعلم يحتفظ بها. بدلاً من حكم على تحديث مرشح واحد في كل مرة، تحتفظ الطريقة بمخزن صغير مكوّن من مرشّحين واعدين اثنين قد تجاوزا فحصًا خاصًا سريعًا. ثم تقارن تخفيضات الفقد المشوشة بينهما وتفضّل تلك التي تبدو أكثر فائدة، أحيانًا تختار عشوائيًا إذا بدتا متساويتين. تُلغِي هذه المقارنة الثنائية جزءًا من العشوائية، مما يجعل القرارات أقل حساسية لأي قياس صاخب منفرد. إذا صار الفلتر صارمًا جدًا وتم رفض العديد من المرشحين على التوالي، تتحوّل الخوارزمية تلقائيًا إلى وضع المرشح الفردي الأبسط حتى لا يتعطل التدريب قرب مناطق مسطحة أو صعبة من سطح الفقد.

تكييف الضوضاء وحجم الخطوة مع الزمن

بخلاف الاختيار الأذكى، يقوم DPSGD-BR أيضًا بتكييف معاييره الرئيسية طوال التدريب. بعد كل تحديث مقبول، يتحقق من مدى تحسّن دقة التحقق. عندما يتعلّم النموذج بسرعة، تقلل الطريقة مستوى الضوضاء ومعدل التعلم بشكل أكثر عدوانية، مما يساعده على الخروج من مرحلة مبكرة شديدة الضوضاء إلى نظام أكثر استقرارًا. لاحقًا، عندما يتباطأ التقدّم، تُبطأ هذه القيم بشكل ألطف ويُرخى قيد الرفض، مما يسمح بمرور المزيد من التحديثات ليتمكن النموذج من الضبط الدقيق. كل ذلك يحدث وفق إطار حسابي صارم يتتبع مقدار ميزانية الخصوصية المستهلكة ويوقف المزيد من التناقص بمجرد الاقتراب من الحد المسبق.

ماذا تُظهر التجارب

اختبر الباحثون DPSGD-BR على مجموعات مرجعية معروفة: مجموعتا صور لخط اليد والملابس (MNIST وFashion-MNIST)، ومجموعة صور طبيعية أكثر تعقيدًا (CIFAR-10)، وتحليل مشاعر مراجعات الأفلام (IMDb). تحت ميزانيات خصوصية متطابقة، حقق طريقتهم باستمرار دقة اختبار أعلى من التدريب الخاص التفاضلي القياسي ومن أسلوب انتقائي رائد، عادةً بما يتراوح بين نحو نصف نقطة إلى نقطتين مئويتين. كما وصلت إلى هذه الدقات بتقارب أكثر سلاسة وسرعة. بقيت قياسات القابلية لهجمات استدلال العضوية — حيث يحاول مهاجم تحديد ما إذا كانت بيانات شخص معين استُخدمت في التدريب — قرب مستوى التخمين العشوائي، مما يشير إلى أن مكاسب الدقة لم تأتِ على حساب ضعف الخصوصية التجريبية.

خلاصة للممارسين المهتمين بالخصوصية

بعبارات بسيطة، تُظهر الورقة أن التعلّم العميق الخاص يمكن أن يصبح أكثر أمانًا وفعالية عن طريق إنفاق ميزانية الخصوصية فقط على التحديثات المختارة جيدًا ومزامنة مستويات الضوضاء مع مرحلة التدريب. مع مخزن صغير يقارن الخطوات المرشحة وجدول يهدئ عملية التعلّم تدريجيًا، يحول DPSGD-BR نفس الضمان الرسمي للخصوصية إلى تقدم تعلمي أكثر فائدة. للممارسين، يقترح هذا مسارًا عمليًا نحو نماذج تحترم بيانات الأفراد مع الحفاظ على تنافسية الدقة في مهام الرؤية واللغة الواقعية.

الاستشهاد: Deng, S., Zhang, K., Zhang, W. et al. Stabilizing updates in differentially private stochastic gradient descent with buffered rejection. Sci Rep 16, 13961 (2026). https://doi.org/10.1038/s41598-026-44009-2

الكلمات المفتاحية: الخصوصية التفاضلية, التعلّم العميق, الانحدار التدرُّجي العشوائي, التدريب المُحافظ على الخصوصية, استدلال العضوية