Clear Sky Science · sv

Stabilisering av uppdateringar i differentiellt privat stokastisk gradientnedstigning med buffrad avvisning

Varför privat inlärning är viktigt

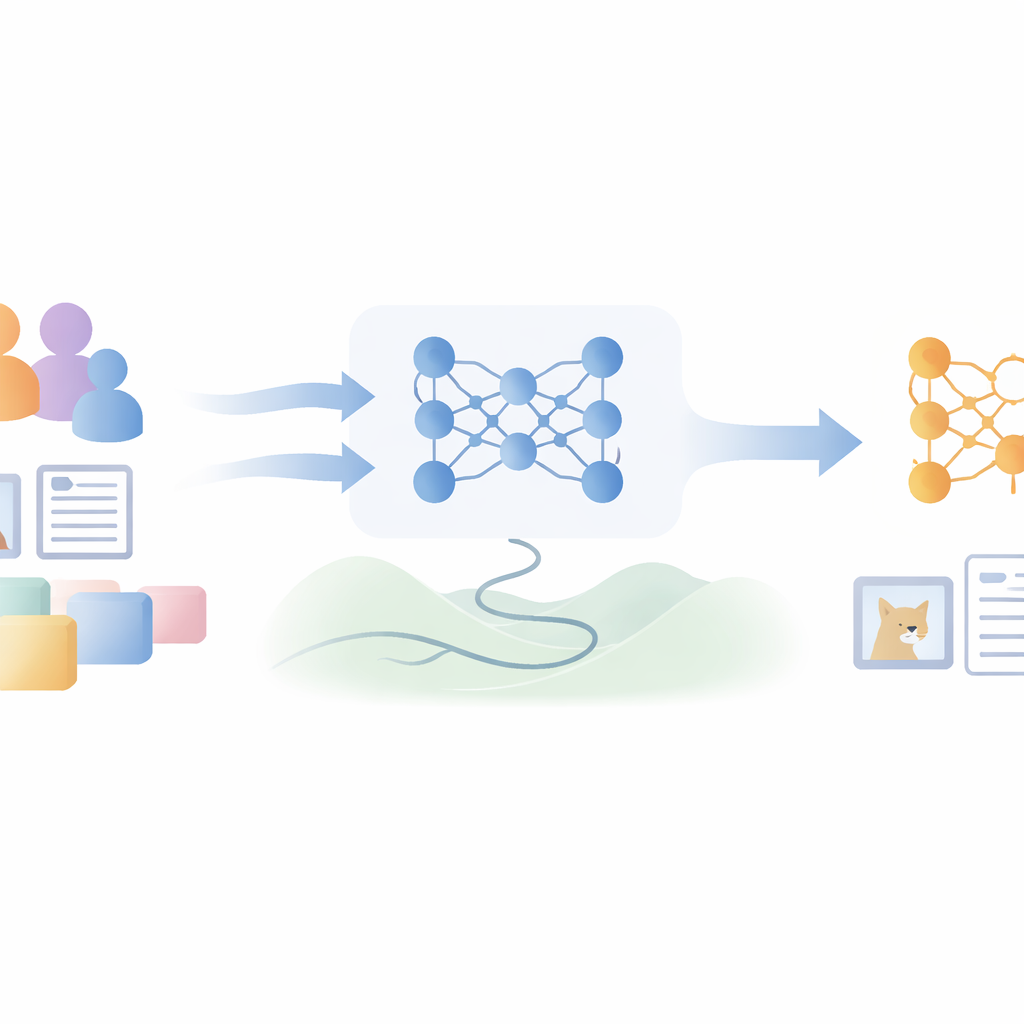

Moderna appar lär sig från stora samlingar av foton, journaler och personliga meddelanden. Dessa data kan göra maskininlärningsmodeller smartare, men de skapar också risker: en modell kan av misstag avslöja något om de människor den har lärt sig från. Differentiell integritet är ett matematiskt verktyg som syftar till att förhindra detta. Artikeln bakom denna sammanfattning presenterar ett sätt att träna djupa neurala nätverk som bibehåller starka sekretessgarantier samtidigt som en del av den noggrannhet som vanligtvis går förlorad på grund av sekretessbevarande brus återvinns.

Utmaningen med brusig träning

För att skydda individer injicerar differentierat privat träning slumpmässigt brus i varje litet steg modellen tar under inlärningen. Detta brus döljer enskilda individers bidrag i datan, men det gör också inlärningen svårare: modellens uppdateringar blir skakiga, framstegen bromsas och slutlig noggrannhet minskar jämfört med icke-privat träning. Tidigare metoder försökte vara mer selektiva och hoppa över uppdateringar som verkade okloka när de utvärderades på ett litet valideringsbatch. Dessa beslut byggde dock fortfarande på en enda brusig mätning, så bra uppdateringar kunde slängas bort och dåliga accepteras av misstag, vilket slösade bort den begränsade ”sekretessbudget” som styr hur mycket datatillgång som är tillåten.

Välja bättre steg med ett litet minne

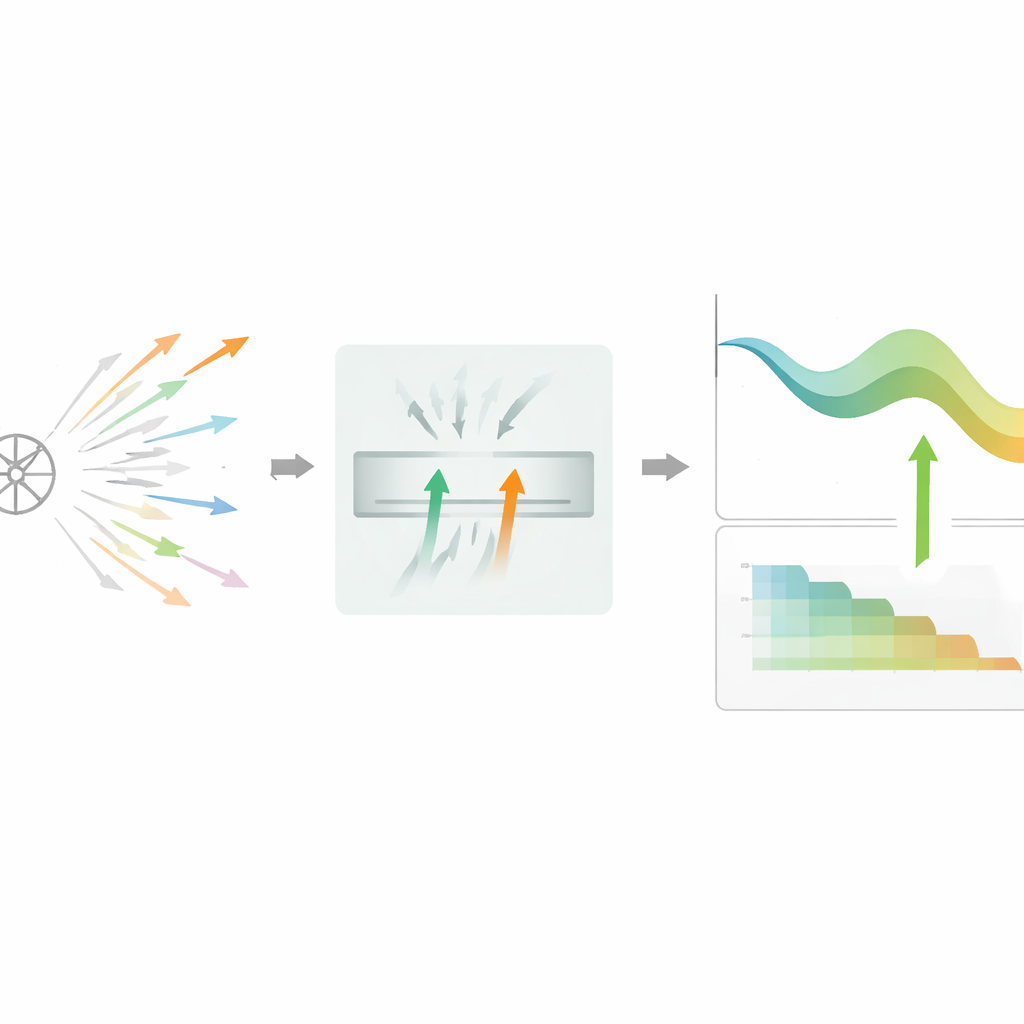

Författarna föreslår DPSGD-BR, en algoritm som ändrar hur modellen bestämmer vilka inlärningssteg som ska behållas. Istället för att bedöma en kandidatuppdatering åt gången behåller metoden en liten buffert med två lovande kandidater som redan klarat en snabb privat kontroll. Den jämför sedan deras brusiga förlustreduceringar och föredrar den som verkar mest hjälpsam, ibland genom att välja slumpmässigt om de verkar lika bra. Denna tvåvägsjämförelse neutraliserar en del av slumpmässigheten, vilket gör besluten mindre känsliga för en enskild brusig mätning. Om filtret blir för strikt och många kandidater avvisas i följd växlar algoritmen automatiskt till ett enklare en-kandidatläge så att träningen inte stannar upp nära platta eller svåra regioner i förlustytan.

Anpassning av brus och steglängd över tid

Utöver smartare urval anpassar DPSGD-BR också sina huvudparametrar under träningens gång. Efter varje accepterad uppdatering kontrollerar den hur mycket valideringsnoggrannheten förbättrats. När modellen lär sig snabbt minskar metoden både brusnivån och inlärningshastigheten mer aggressivt, vilket hjälper den att ta sig ur ett mycket brusigt tidigt skede in i ett mer stabilt regime. Senare, när framstegen saktar, dämpar den dessa kvantiteter mer varsamt och mildrar avvisningsregeln, vilket tillåter fler uppdateringar så att modellen kan finslipa. Allt detta sker inom en strikt redovisningsram som spårar hur mycket sekretessbudget som använts och stoppar vidare dämpning när en förinställd gräns närmar sig.

Vad experimenten visar

Forskarlaget testade DPSGD-BR på välkända benchmarks: två handskrivna och klädavbildningsdatamängder (MNIST och Fashion-MNIST), en mer komplex naturlig bildmängd (CIFAR-10) och sentimentanalys av filmrecensioner (IMDb). Vid matchade sekretessbudgetar uppnådde deras metod konsekvent högre testnoggrannhet än standard differentierat privat träning och en ledande selektiv-uppdateringsmetod, vanligtvis med omkring en halv till två procentenheter. Den nådde också dessa noggrannheter med jämnare och snabbare konvergens. Mätningar av sårbarhet för medlemskapsinferensattacker — där en angripare försöker avgöra om en viss persons data användes vid träningen — låg nära slumpnivån, vilket indikerar att noggrannhetsvinsterna inte skedde på bekostnad av svagare empirisk sekretess.

Slutsats för sekretessmedveten inlärning

Enkelt uttryckt visar artikeln att privat djupinlärning kan göras både säkrare och mer effektiv genom att spendera sekretessbudget endast på välvalda uppdateringar och genom att matcha brusnivåer till träningsfasen. Med en liten buffert som jämför kandidatsteg och ett schema som gradvis lugnar inlärningsprocessen omvandlar DPSGD-BR samma formella sekretessgaranti till mer användbar inlärningsframgång. För praktiker föreslår detta en praktisk väg till modeller som respekterar individers data samtidigt som de håller sig konkurrenskraftiga i noggrannhet på verkliga uppgifter inom bild- och språkbehandling.

Citering: Deng, S., Zhang, K., Zhang, W. et al. Stabilizing updates in differentially private stochastic gradient descent with buffered rejection. Sci Rep 16, 13961 (2026). https://doi.org/10.1038/s41598-026-44009-2

Nyckelord: differentiell integritet, djupinlärning, stokastisk gradientnedstigning, sekretessbevarande träning, medlemskapsinferens