Clear Sky Science · fr

Stabilisation des mises à jour dans la descente de gradient stochastique différemment privée avec rejet bufferisé

Pourquoi l’apprentissage privé est important

Les applications modernes apprennent à partir d’immenses collections de photos, de dossiers médicaux et de messages personnels. Ces données peuvent rendre les modèles d’apprentissage automatique plus performants, mais elles créent aussi des risques : un modèle pourrait révéler par inadvertance des informations sur les personnes dont il a appris. La confidentialité différentielle est un ensemble d’outils mathématiques visant à prévenir cela. L’article résumé ici propose une méthode d’entraînement de réseaux de neurones profonds qui conserve de fortes garanties de confidentialité tout en récupérant une partie de la précision généralement perdue à cause du bruit ajouté pour préserver la vie privée.

Le défi de l’entraînement bruité

Pour protéger les individus, l’entraînement différemment privé injecte du bruit aléatoire à chaque petit pas que le modèle effectue pendant l’apprentissage. Ce bruit masque la contribution d’une personne individuelle dans les données, mais il complique aussi l’apprentissage : les mises à jour du modèle deviennent instables, les progrès ralentissent et la précision finale diminue par rapport à un entraînement non privé. Les méthodes antérieures essayaient d’être plus sélectives en sautant les mises à jour qui semblaient peu utiles lorsqu’elles étaient évaluées sur un petit lot de validation. Cependant, ces décisions reposaient encore sur une unique mesure bruitée, si bien que de bonnes mises à jour pouvaient être écartées et de mauvaises acceptées par erreur, gaspillant le « budget de confidentialité » limité qui régit l’accès aux données.

Choisir de meilleurs pas avec une petite mémoire

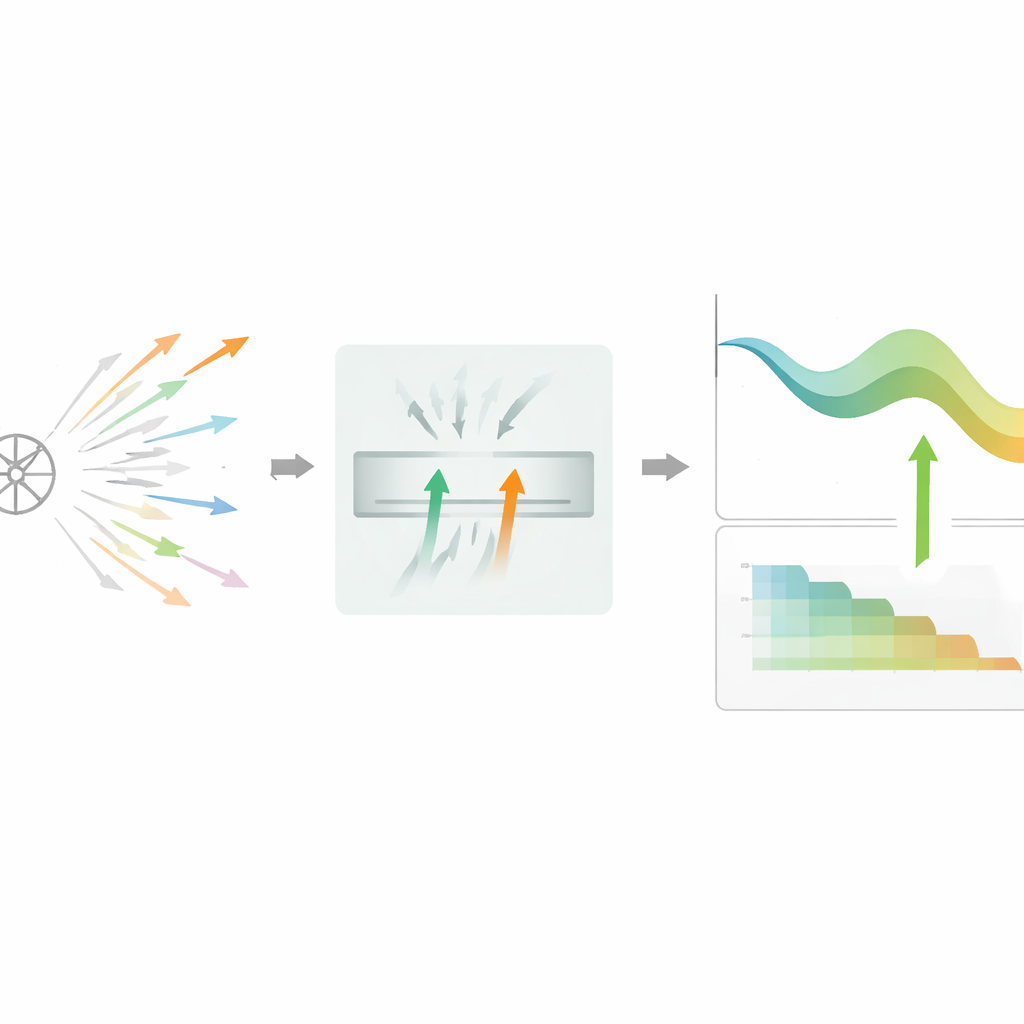

Les auteurs proposent DPSGD-BR, un algorithme qui modifie la façon dont le modèle décide quelles étapes d’apprentissage conserver. Plutôt que de juger un candidat à la fois, la méthode conserve un tout petit tampon de deux candidats prometteurs qui ont déjà passé un court contrôle privé. Elle compare ensuite leurs réductions de perte bruitées et préfère celle qui semble la plus utile, choisissant parfois au hasard si elles paraissent équivalentes. Cette comparaison binaire annule une partie de l’aléa, rendant les décisions moins sensibles à une seule lecture bruitée. Si le filtre devient trop strict et que de nombreux candidats sont rejetés consécutivement, l’algorithme passe automatiquement en mode simple à candidat unique pour éviter que l’entraînement ne stagne près de régions plates ou difficiles de la surface de perte.

Adapter le bruit et la taille de pas au fil du temps

Au-delà d’une sélection plus intelligente, DPSGD-BR adapte aussi ses paramètres clés tout au long de l’entraînement. Après chaque mise à jour acceptée, il vérifie l’amélioration de l’exactitude sur la validation. Lorsque le modèle apprend rapidement, la méthode réduit plus agressivement à la fois le niveau de bruit et le taux d’apprentissage, l’aidant à sortir d’une phase initiale très bruitée vers un régime plus stable. Plus tard, lorsque les progrès ralentissent, elle décroît ces quantités plus doucement et assouplit la règle de rejet, laissant passer davantage de mises à jour pour permettre un réglage fin. Tout cela s’effectue sous un cadre strict de comptabilité, qui suit le budget de confidentialité dépensé et arrête la diminution une fois qu’une limite prédéfinie est approchée.

Ce que montrent les expériences

Les chercheurs ont testé DPSGD-BR sur des jeux de référence bien connus : deux ensembles d’images manuscrites et de vêtements (MNIST et Fashion-MNIST), un ensemble d’images naturelles plus complexe (CIFAR-10) et l’analyse de sentiments de critiques de films (IMDb). Pour des budgets de confidentialité équivalents, leur méthode a systématiquement obtenu une meilleure précision sur le test que l’entraînement différentiel privé standard et qu’une méthode de mise à jour sélective de premier plan, généralement d’environ un demi-point à deux points de pourcentage. Elle atteignait aussi ces précisions avec une convergence plus lisse et plus rapide. Les mesures de vulnérabilité aux attaques d’inférence d’appartenance — où un adversaire tente de déterminer si les données d’une personne spécifique ont servi à l’entraînement — restaient proches du niveau d’un tirage aléatoire, indiquant que les gains de précision n’ont pas été obtenus au détriment d’une confidentialité empirique plus faible.

Conclusion pour l’apprentissage soucieux de la vie privée

En termes simples, l’article montre que l’apprentissage profond privé peut être rendu à la fois plus sûr et plus efficace en dépensant le budget de confidentialité uniquement sur des mises à jour bien choisies et en adaptant le niveau de bruit à la phase d’entraînement. Avec un tout petit tampon qui compare des pas candidats et un calendrier qui calme progressivement le processus d’apprentissage, DPSGD-BR transforme une même garantie formelle de confidentialité en un progrès d’apprentissage plus utile. Pour les praticiens, cela suggère une voie pratique vers des modèles qui respectent les données des individus tout en restant compétitifs en précision sur des tâches réelles de vision et de langage.

Citation: Deng, S., Zhang, K., Zhang, W. et al. Stabilizing updates in differentially private stochastic gradient descent with buffered rejection. Sci Rep 16, 13961 (2026). https://doi.org/10.1038/s41598-026-44009-2

Mots-clés: confidentialité différentielle, apprentissage profond, descente de gradient stochastique, entraînement préservant la vie privée, inférence d’appartenance