Clear Sky Science · pl

Stabilizowanie aktualizacji w różnicowo prywatnym stochastycznym spadku gradientu z buforowanym odrzuceniem

Dlaczego prywatne uczenie ma znaczenie

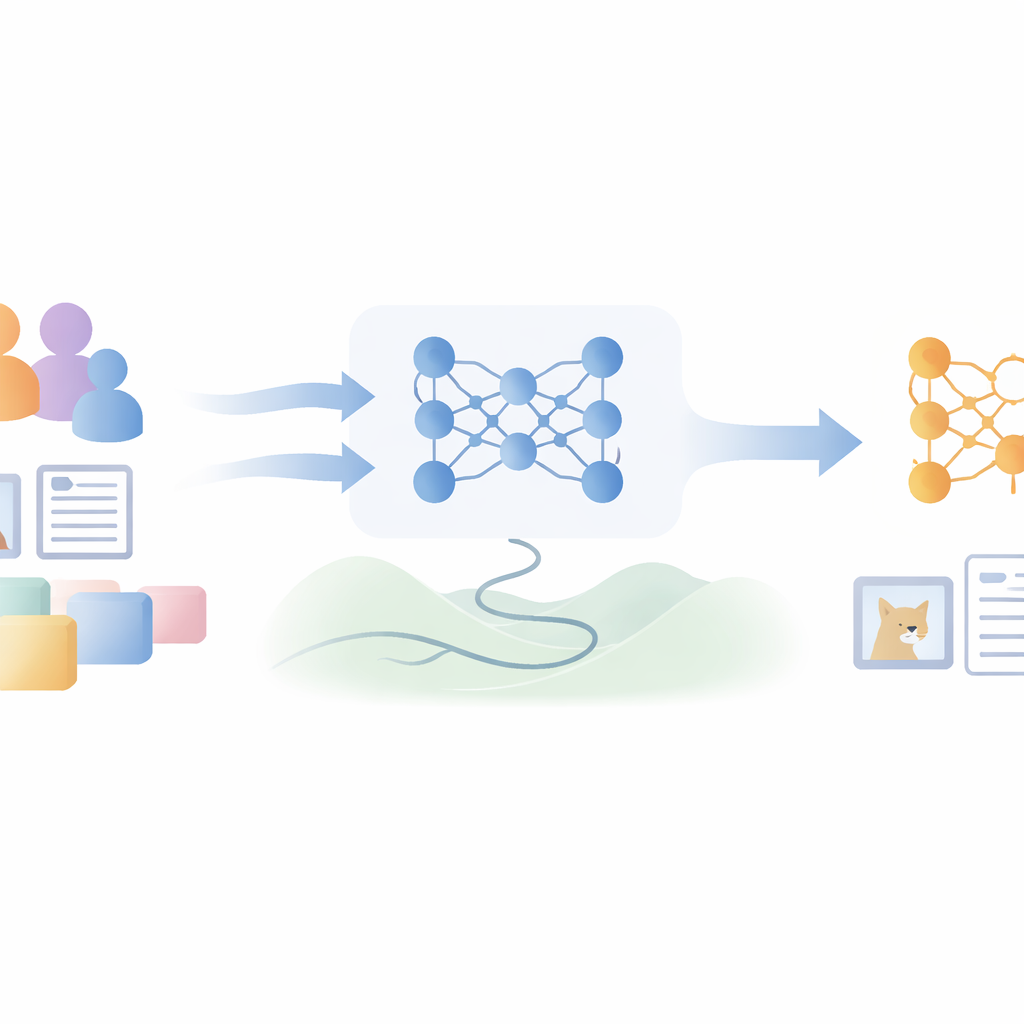

Nowoczesne aplikacje uczą się na ogromnych zbiorach zdjęć, kartotek medycznych i prywatnych wiadomości. Dane te mogą uczynić modele uczenia maszynowego mądrzejszymi, ale równocześnie stwarzają ryzyko: model może przypadkowo ujawnić coś o osobach, na których się uczył. Różnicowa prywatność to matematyczny zestaw narzędzi mający na celu zapobieganie temu. Artykuł będący podstawą tego streszczenia przedstawia sposób trenowania głębokich sieci neuronowych, który zachowuje silne gwarancje prywatności, jednocześnie odzyskując część dokładności zwykle traconej przez szumy wprowadzane dla ochrony prywatności.

Wyzwaniem jest trening z szumem

Aby chronić osoby, różnicowo prywatne trenowanie wprowadza losowy szum do każdego małego kroku, jaki wykonuje model podczas uczenia. Ten szum ukrywa wkład pojedynczej osoby w danych, ale też utrudnia uczenie: aktualizacje modelu stają się chwiejne, postęp zwalnia, a końcowa dokładność spada w porównaniu z treningiem bez prywatności. Wcześniejsze metody starały się być bardziej selektywne, pomijając aktualizacje, które wydawały się nieprzydatne po ocenie na małej walidacyjnej porcji danych. Jednak te decyzje wciąż zależały od pojedynczego zaszumionego pomiaru, więc dobre aktualizacje mogły być odrzucone, a złe — przypadkowo zaakceptowane, marnując ograniczony „budżet prywatności”, który określa, ile dostępu do danych jest dozwolone.

Wybieranie lepszych kroków przy małej pamięci

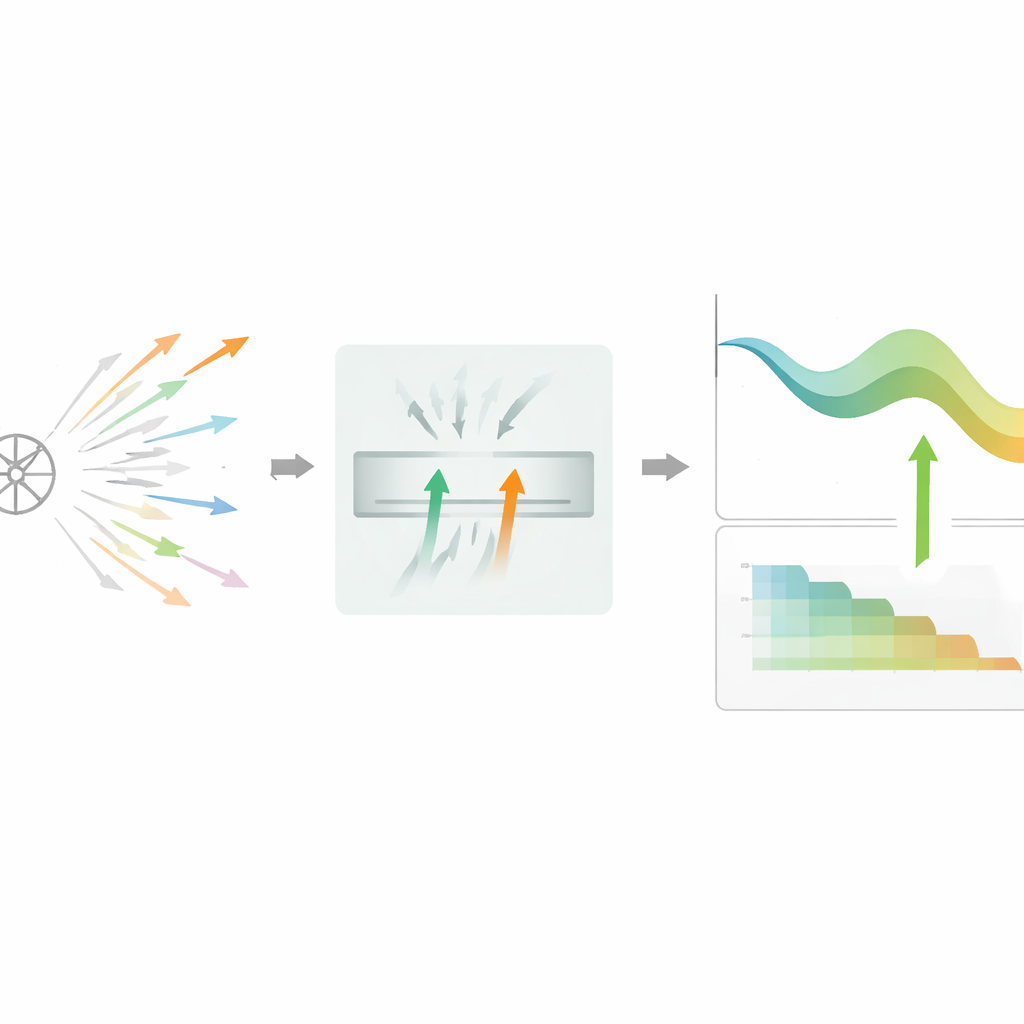

Autorzy proponują DPSGD-BR, algorytm zmieniający sposób, w jaki model decyduje, które kroki uczenia zachować. Zamiast oceniać jedną proponowaną aktualizację naraz, metoda utrzymuje niewielki bufor dwóch obiecujących kandydatów, które przeszły szybki prywatny filtr. Następnie porównuje ich zaszumione spadki funkcji straty i preferuje ten, który wydaje się bardziej pomocny, czasem wybierając losowo, jeśli wyglądają równie dobrze. To porównanie dwukierunkowe znosi część losowości, przez co decyzje są mniej wrażliwe na pojedynczy zaszumiony odczyt. Jeśli filtr stanie się zbyt rygorystyczny i wiele kandydatów zostanie odrzuconych z rzędu, algorytm automatycznie przełącza się w prostszy tryb z pojedynczym kandydatem, aby trening nie zamarł w pobliżu płaskich lub trudnych obszarów powierzchni straty.

Dostosowywanie szumu i wielkości kroku w czasie

Ponadto DPSGD-BR adaptuje swoje kluczowe parametry w trakcie treningu. Po każdej zaakceptowanej aktualizacji sprawdza, o ile poprawiła się walidacyjna dokładność. Gdy model uczy się szybko, metoda silniej zmniejsza zarówno poziom szumu, jak i współczynnik uczenia, pomagając przejść z bardzo zaszumionego początku do stabilniejszego reżimu. Później, gdy postęp zwalnia, te wielkości są redukowane łagodniej, a reguła odrzucania jest poluzowana, co pozwala na przejście większej liczby aktualizacji, aby model mógł dopracować się. Wszystko to odbywa się w ramach ścisłego rozliczania budżetu prywatności, które śledzi, ile już wydano, i zatrzymuje dalsze zmiany, gdy zbliży się do ustalonego limitu.

Co pokazują eksperymenty

Naukowcy przetestowali DPSGD-BR na znanych benchmarkach: dwóch zbiorach obrazów odręcznych i odzieżowych (MNIST i Fashion-MNIST), bardziej złożonym zbiorze obrazów naturalnych (CIFAR-10) oraz analizie sentymentu recenzji filmowych (IMDb). Przy porównywalnych budżetach prywatności ich metoda konsekwentnie osiągała wyższą dokładność testową niż standardowe różnicowo prywatne trenowanie i wiodąca metoda selektywnego aktualizowania, zwykle o około pół punktu procentowego do dwóch punktów. Osiągała też te wyniki z płynniejszą i szybszą zbieżnością. Pomiary podatności na ataki wnioskowania o przynależność — w których przeciwnik próbuje ustalić, czy dane konkretnej osoby były użyte do treningu — pozostawały blisko poziomu losowego zgadywania, co wskazuje, że zyski w dokładności nie odbywały się kosztem słabszej empirycznej prywatności.

Wnioski dla uczących się z dbałością o prywatność

Mówiąc wprost, artykuł pokazuje, że prywatne uczenie głębokie może być jednocześnie bezpieczniejsze i skuteczniejsze, gdy budżet prywatności jest wydawany tylko na starannie wybrane aktualizacje, a poziomy szumu są dopasowane do etapu treningu. Dzięki niewielkiemu buforowi porównującemu kroki-kandydatów i harmonogramowi, który stopniowo uspokaja proces uczenia, DPSGD-BR przekłada tę samą formalną gwarancję prywatności na bardziej użyteczny postęp w nauce. Dla praktyków to sugeruje praktyczną drogę do modeli szanujących dane osób, a jednocześnie konkurencyjnych pod względem dokładności w zadaniach wizji i przetwarzania języka w rzeczywistych zastosowaniach.

Cytowanie: Deng, S., Zhang, K., Zhang, W. et al. Stabilizing updates in differentially private stochastic gradient descent with buffered rejection. Sci Rep 16, 13961 (2026). https://doi.org/10.1038/s41598-026-44009-2

Słowa kluczowe: różnicowa prywatność, uczenie głębokie, stochastyczny spadek gradientu, trenowanie z zachowaniem prywatności, wnioskowanie o przynależności