Clear Sky Science · zh

基于 RGBD 摄像头与 LiDAR 数据的二维网格地图构建

为日常空间打造更智能的机器人地图

从在托盘间穿行的仓库机器人到在家具间绕行的家庭机器人,移动机器需要可靠的地图以确保安全。然而,它们用来“看见”世界的传感器——激光扫描仪和深度相机——各自存在盲点。该研究展示了如何将一台简单的激光扫描仪与一台廉价的深度相机结合,并在运行中自动校正相机误差,从而为小型室内机器人提供更清晰、更安全的环境地图。

单一传感器的局限

现今机器人常依赖深度相机(能获取颜色与距离)或激光扫描仪(用光脉冲测距)中的一种。深度相机体积小、价格低,但在光线昏暗、强烈眩光或几米以外时表现欠佳,而且随距离增加其距离读数会逐渐漂移。相比之下,激光扫描仪非常精确且在黑暗中也能工作,但通常只感知水平的一薄片区域,会漏检位于该平面之上或之下的物体,比如低矮托盘、悬挂货架或中空结构。此外,激光系统通常更昂贵且计算开销更大。单独使用任一类传感器,都难以在狭窄空间和拥挤的室内物流场景中提供所需的全面可靠视图。

将两种视角融合为一幅清晰画面

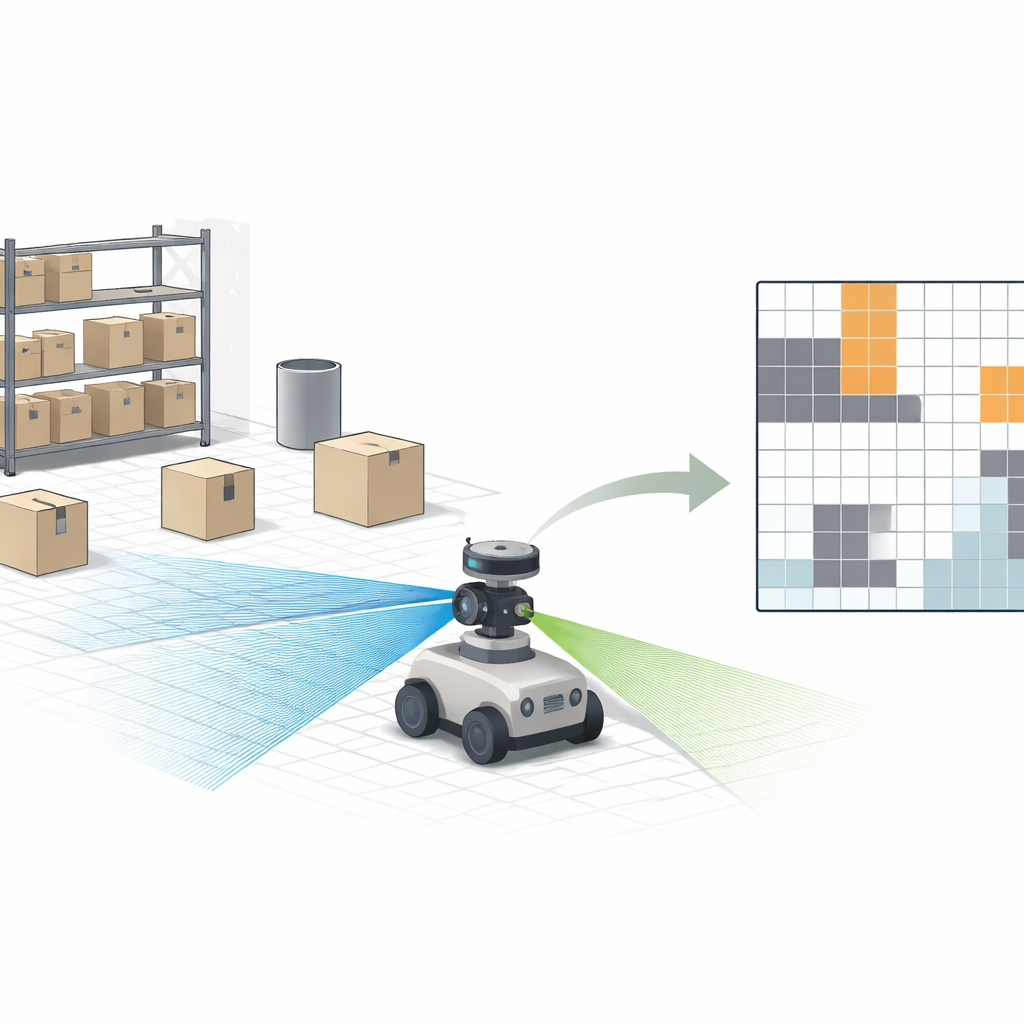

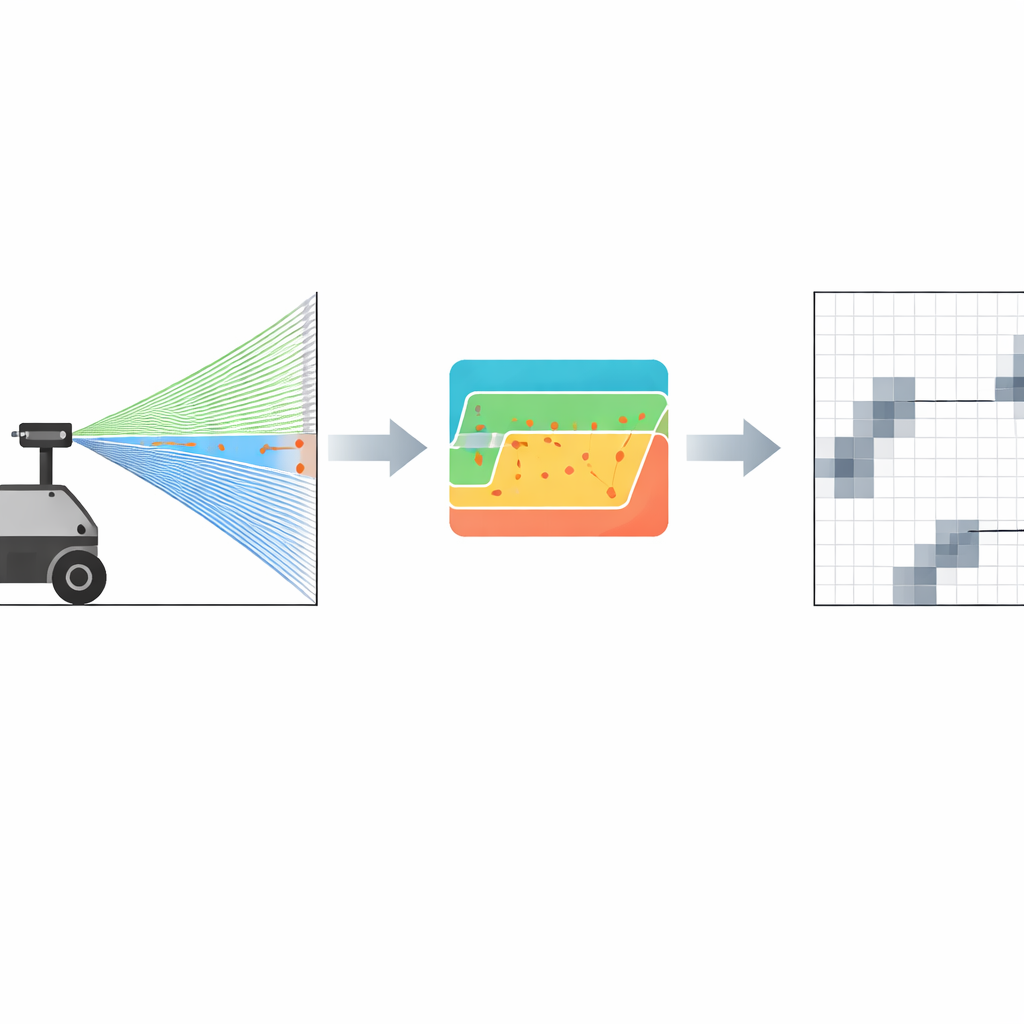

作者通过将两种传感器的优势融合到单一二维网格地图中来弥补这一空白——这种地图将地面划分为小方格,标记为空闲或被占用。机器人搭载了一台低成本 RGBD(彩色+深度)相机和一台平面 LiDAR 扫描仪。首先,他们将所有测量对齐到共同参考系,使相机或激光观测到的点在地图上落到相同位置。随后,他们不尝试保持完整的三维模型,而是将相关的三维点投影到地面平面,滤除天花板与地面杂物。一个概率性方案根据各传感器在给定距离上的可信度更新每个网格单元:在工作距离内激光读数被视为高度可靠,而随距离增加相机噪声增大,其影响则逐步减弱。

让激光来校正相机

一项关键创新是一个轻量级的校准步骤,使机器人能在现场持续校正相机的深度偏差。当机器人面向一面平整的墙时,它将激光的毫米级精度距离视为“真值”。一个稳健的拟合过程从激光数据中估计出该墙的精确距离,即便存在噪声也能工作。系统随后将此与相机报告的距离进行比较,并调整一个单一的深度偏移量,使相机的平均读数与激光一致。重要的是,这一过程不需要复杂的棋盘图案、受控运动臂或完整的六自由度标定;只要视野中出现合适的平面,就能在真实仓库中快速触发。这种即时调整直接降低了系统性相机误差,避免机器人误判障碍物位置。

从更干净的深度数据到更安全的路径

研究人员在一台配备两台低成本激光扫描仪和一台 Intel RealSense 深度相机的小型仓库风格机器人上评估了他们的方法。在与激光真值的受控测试中,校准后相机的距离误差显著下降——例如在约 2.16 米处,平均误差从 0.604 米降至 0.340 米,约减少 43%。当团队比较不同的建图模式时,仅用相机的设置无法构建稳健地图,即使将未经校正的相机数据与 LiDAR 进行简单融合也会产生许多虚假障碍,地面被误标为占用。经校准的融合则生成了更清晰且不确定性更低的地图,检测到激光单独会漏掉的细薄或低矮障碍,并提升了回环闭合的准确性,同时运行速度足以支持实时导航。

对现实机器人的意义

在实践层面,这项工作提供了一种简单方案,使室内机器人在不使用昂贵高端传感器的情况下变得更安全、更可靠。通过让精确但视域有限的激光悄然“教会”更便宜的深度相机,然后将它们的读数合并到统一的二维网格中,机器人能获得更真实的周遭图景——尤其是在空心货架、金属网格和低矮物体等棘手特征上。尽管这种额外智能会消耗一定计算资源并不能完全解决极端光照等问题,但它使低成本机器人更接近在繁忙仓库、工厂及其他需人与机器安全共享地面的室内空间中所需的稳健可信感知能力。

引用: Delhibabu, R., Zhukova, N.A. & Gizzatov, A. 2D grid map creation based on RGBD-camera and LiDAR data. Sci Rep 16, 10591 (2026). https://doi.org/10.1038/s41598-026-42698-3

关键词: 机器人建图, 传感器融合, LiDAR, 深度相机, 室内导航