Clear Sky Science · pl

Tworzenie dwuwymiarowej mapy siatkowej na podstawie danych z kamery RGBD i LiDAR

Inteligentniejsze mapy robotów dla codziennych przestrzeni

Od robotów magazynowych omijających palety po domowe roboty lawirujące między meblami — maszyny poruszające się w środowisku potrzebują dobrych map, by działać bezpiecznie. Jednak używane przez nie sensory do „widzenia” — skanery laserowe i kamery głębi — mają własne martwe pola. Badanie to pokazuje, jak połączenie prostego skanera laserowego z niedrogą kamerą głębi RGBD oraz automatyczne korygowanie błędów kamery w locie może dostarczyć małym robotom wewnątrz budynków czytelniejsze, bezpieczniejsze mapy otoczenia.

Dlaczego pojedyncze sensory zawodzą

Współczesne roboty często polegają albo na kamerze głębi (która rejestruje kolor i odległość), albo na skanerze laserowym (który mierzy dystans za pomocą impulsów świetlnych). Kamery głębi są tanie i kompaktowe, ale mają problemy przy słabym oświetleniu, silnych odblaskach lub na większych dystansach; ich pomiary odległości z czasem coraz mniej odzwierciedlają rzeczywistość wraz ze wzrostem zasięgu. Skanery laserowe są z kolei bardzo precyzyjne i działają w ciemności, lecz zwykle rejestrują tylko cienką, poziomą warstwę świata i mogą nie dostrzec obiektów znajdujących się powyżej lub poniżej tej płaszczyzny, takich jak niskie palety, wystające półki czy puste konstrukcje. Dodatkowo systemy laserowe bywają droższe i bardziej wymagające obliczeniowo. Samodzielnie żaden z tych sensorów nie zapewnia wystarczająco bogatego i wiarygodnego obrazu potrzebnego w ciasnych przestrzeniach i zatłoczonych, wewnętrznych hubach logistycznych.

Scalenie dwóch perspektyw w jedną czytelną całość

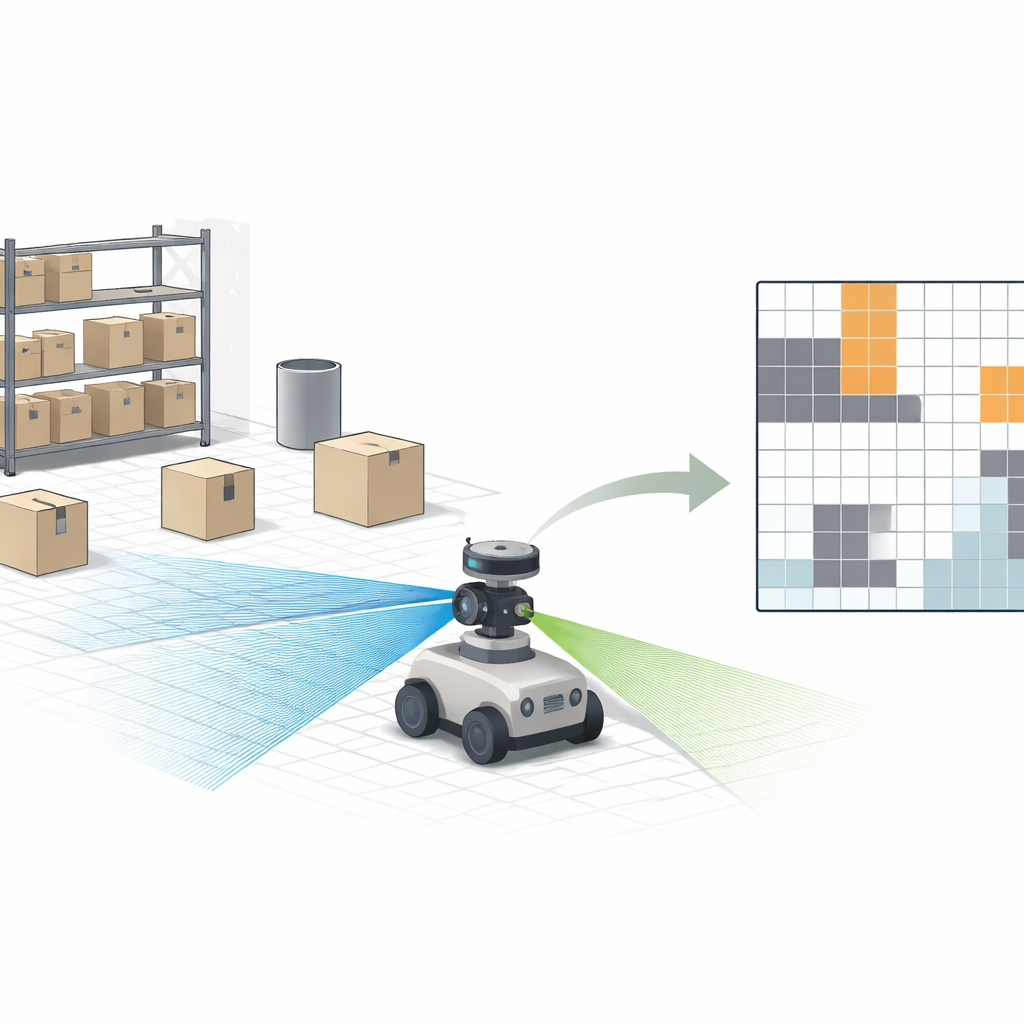

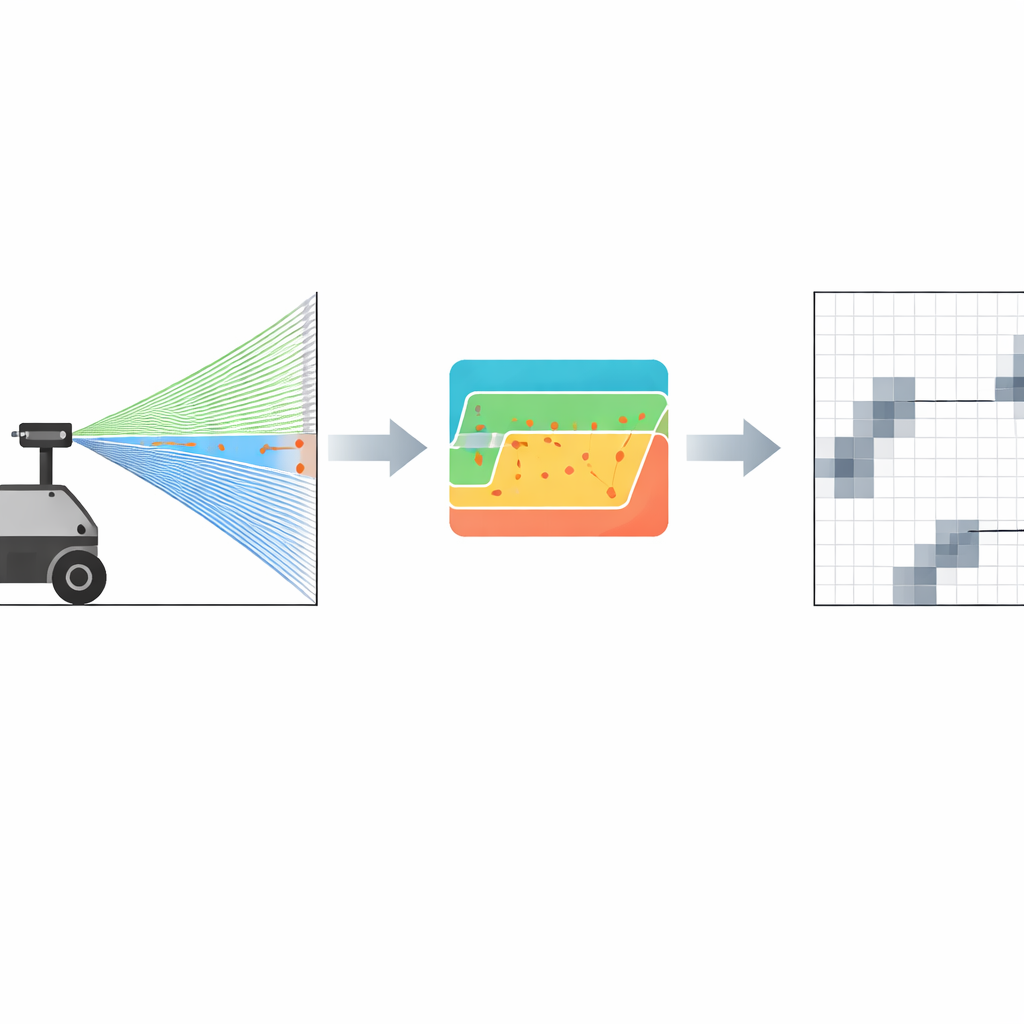

Autorzy rozwiązują tę lukę poprzez połączenie zalet obu sensorów w jedną dwuwymiarową mapę siatkową — taką, gdzie podłoga dzielona jest na małe kwadraty oznaczone jako wolne lub zajęte. Robot wyposażony jest w tanią kamerę RGBD (kolor plus głębia) oraz planarny skaner LiDAR. Najpierw wszystkie pomiary są wyrównywane do wspólnej ramy odniesienia, tak aby punkt zarejestrowany przez kamerę lub laser znalazł się w tym samym miejscu na mapie. Zamiast utrzymywać pełny model 3D, projektuje się jedynie istotne punkty 3D na płaszczyznę podłogi, filtrując elementy sufitu i nadmiary z podłoża. Probabilistyczny schemat aktualizuje każdą komórkę siatki na podstawie tego, jak wiarygodny jest dany sensor na określonej odległości: odczyty laserowe traktowane są jako wysoce niezawodne w zakresie roboczym, podczas gdy wpływ kamery stopniowo maleje wraz ze wzrostem szumu przy większych dystansach.

Pozwolenie laserowi na korektę kamery

Kluczową innowacją jest lekki krok kalibracyjny, który pozwala robotowi ciągłe korygowanie biasu głębokości kamery w terenie. Gdy robot stoi naprzeciw płaskiej ściany, wykorzystuje milimetrowo dokładne odczyty lasera jako „prawdę odniesienia”. Odporna procedura dopasowania estymuje precyzyjną odległość do tej ściany na podstawie danych laserowych, nawet w obecności szumu. System porównuje to następnie z raportem kamery i dostosowuje jedną wartość przesunięcia głębokości, tak aby średni odczyt kamery zgadzał się z laserem. Co istotne, proces ten nie wymaga skomplikowanych wzorców szachownicowych, ramion sterowanych ruchem ani pełnej sześciostopniowej kalibracji; można go szybko wywołać w prawdziwym magazynie, kiedy odpowiednia płaska powierzchnia znajdzie się w polu widzenia. Takie strojenie w locie bezpośrednio redukuje systematyczne błędy kamery, które w przeciwnym razie powodowałyby błędne oceny położenia przeszkód.

Od oczyszczonej głębi do bezpieczniejszych tras

Badacze przetestowali swoją metodę na niewielkim robocie magazynowym wyposażonym w dwa tanie skanery laserowe i kamerę głębi Intel RealSense. W kontrolowanych testach w porównaniu z laserową prawdą odniesienia błąd odległości kamery znacząco spadł po kalibracji — na przykład przy około 2,16 metra średni błąd zmniejszył się z 0,604 metra do 0,340 metra, co stanowi redukcję rzędu 43 procent. Przy porównaniu różnych trybów mapowania konfiguracja oparta wyłącznie na kamerze nie zdołała zbudować stabilnej mapy, a nawet prosta fuzja niekorygowanych danych kamery z LiDAR generowała wiele fałszywych przeszkód, gdyż podłoga była błędnie oznaczana jako zajęta. Skorzystanie z skalibrowanej fuzji dało jednak bardziej ostre mapy o niższej niepewności, wykrywało cienkie i nisko położone przeszkody, które sam laser pomijał, oraz poprawiło dokładność zamykania pętli, wszystko przy wydajności wystarczającej do nawigacji w czasie rzeczywistym.

Co to oznacza dla robotów w praktyce

W praktycznym ujęciu praca oferuje prosty przepis na uczynienie robotów wewnętrznych bezpieczniejszymi i bardziej niezawodnymi bez uciekania się do drogich, high-endowych sensorów. Pozwalając precyzyjnemu, ale ograniczonemu laserowi „uczyć” tańszej kamery głębi, a następnie łącząc ich pomiary w wspólnej dwuwymiarowej siatce, robot zyskuje bardziej wiarygodny obraz otoczenia — szczególnie dla trudnych elementów, takich jak puste regały, siatki druciane czy niskie obiekty. Chociaż ta dodatkowa inteligencja wymaga pewnej mocy obliczeniowej i nie rozwiązuje w pełni problemów takich jak ekstremalne warunki oświetleniowe, przybliża tanie roboty do rodzaju odpornego, wiarygodnego postrzegania niezbędnego w ruchliwych magazynach, fabrykach i innych przestrzeniach wewnętrznych, gdzie ludzie i maszyny muszą bezpiecznie współdzielić podłogę.

Cytowanie: Delhibabu, R., Zhukova, N.A. & Gizzatov, A. 2D grid map creation based on RGBD-camera and LiDAR data. Sci Rep 16, 10591 (2026). https://doi.org/10.1038/s41598-026-42698-3

Słowa kluczowe: mapowanie robotów, fuzja sensorów, LiDAR, kamera głębi, nawigacja wewnątrz budynków